NLTK与其他NLP库的比较:NLTK在生态系统中的定位

发布时间: 2024-10-04 18:55:01 阅读量: 7 订阅数: 7

# 1. 自然语言处理(NLP)简介

自然语言处理(NLP)是计算机科学和人工智能领域中一项重要的分支,它致力于使计算机能够理解和处理人类语言。随着人工智能的快速发展,NLP已经成为了连接人类与计算机的重要桥梁。在这一章中,我们将首先对NLP的基本概念进行介绍,随后探讨其在各种实际应用中的表现和影响。

## 1.1 NLP的基本概念

自然语言处理主要涉及计算机理解、解析、生成和操控人类语言的能力。其核心目标是缩小机器理解和人类表达之间的差距。NLP技术包括语音识别、文本分类、情感分析、机器翻译等多个方面。

## 1.2 NLP的应用场景

NLP的应用广泛,涵盖了从个人助理、社交媒体分析、搜索引擎优化到医疗健康等多个领域。例如,聊天机器人通过NLP技术与用户进行自然对话,而自动翻译工具则利用NLP对不同语言进行转换。

## 1.3 NLP的挑战和趋势

虽然NLP取得了长足的进步,但仍面临诸如上下文理解、歧义消除和语言多样性等挑战。随着深度学习等技术的发展,NLP正朝着更智能、更高效的方向迈进,预示着未来无限的可能性。

通过介绍NLP的基本概念、应用及其挑战与趋势,本章为读者提供了NLP领域的概览,为深入了解后续内容打下基础。

# 2. NLTK库概述与核心功能

自然语言处理(Natural Language Processing,简称NLP)是计算机科学与人工智能领域的一个重要分支,旨在赋予计算机理解人类语言的能力。NLTK(Natural Language Toolkit)是Python编程语言中最强大的NLP库之一,它为处理自然语言提供了丰富的接口和工具,广泛用于学术研究、商业应用以及教育领域。

### NLTK库的安装与环境配置

NLTK库可以通过Python的包管理工具pip进行安装。打开终端或命令提示符,输入以下命令即可安装:

```bash

pip install nltk

```

安装完成后,可以通过Python交互式环境导入NLTK包来验证安装是否成功:

```python

import nltk

```

如果没有错误提示,说明NLTK已经正确安装。

### NLTK的核心数据包

NLTK库提供了一系列预先下载好的语言数据集和模型,这些数据集被称为NLTK的数据包(corpora)。以下是一些核心的数据包及其功能:

- `nltk.book`:包含了用于教学目的的文本,如莎士比亚的作品。

- `nltk.corpus`: 包含多种语言的语料库,例如`nltk.corpus.sinica_treebank`是中文树库,`nltk.corpus.udhr`包含多种语言的人权声明文本。

- `nltk corpora`:包含了许多语料库,例如`nltk.corpus.stopwords`提供了多种语言的停用词列表。

下面是一个加载并使用NLTK中的数据包进行简单操作的例子:

```python

import nltk

from nltk.book import *

# 查看NLTK中已下载的语料集

nltk.corpus.stopwords.words('english') # 输出英文停用词列表

```

### NLTK的常用功能与模块

NLTK提供了许多用于处理和分析自然语言的模块,包括但不限于以下几种:

- 分词(Tokenization):将文本分割为单独的词汇单元。

- 标注(Tagging):识别词汇单元的词性,如动词、名词等。

- 解析(Parsing):分析句子的句法结构。

- 语义分析(Semantic Analysis):理解文本的含义,包括词义消歧。

- 词干提取(Stemming)和词形还原(Lemmatization):将词汇还原为基本形式。

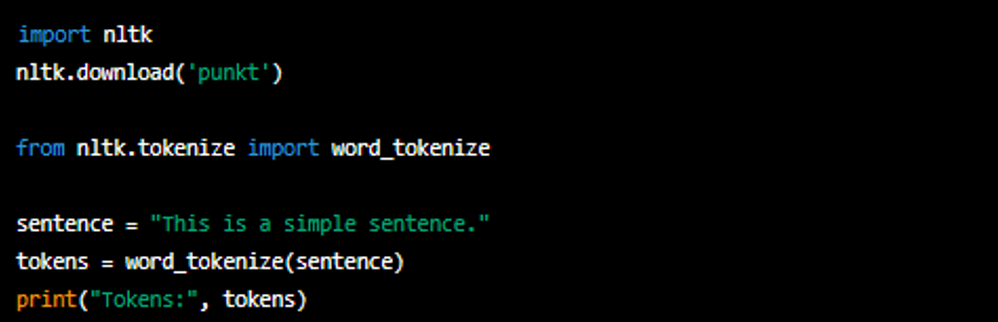

下面给出一个示例,演示如何使用NLTK进行分词和词性标注:

```python

from nltk.tokenize import word_tokenize

from nltk import pos_tag

text = "NLTK is a leading platform for building Python programs to work with human language data."

# 分词

tokens = word_tokenize(text)

print(tokens)

# 词性标注

tagged_tokens = pos_tag(tokens)

print(tagged_tokens)

```

NLTK的模块和功能非常丰富,涵盖了NLP处理的各个方面。对于初学者而言,可以从基础的文本分析开始,逐步深入到更复杂的处理流程中。

### NLTK的社区资源和学习资料

NLTK拥有一个活跃的社区,提供了丰富的学习资源和文档。官网提供了许多教程和示例代码,可以帮助用户快速上手NLTK的各种功能。同时,社区论坛和问答网站上也有许多关于NLTK使用和开发的问题解答,这些都为NLTK的学习者和使用者提供了宝贵的资源。

此外,NLTK还提供了大量的参考书目和文献,其中包括《Natural Language Processing with Python》一书,此书不仅详述了NLTK的使用方法,还深入探讨了NLP的理论和实践,是学习NLP和NLTK的重要资料。

### 总结

NLTK是自然语言处理领域中一个不可或缺的工具,它提供了一套完整的NLP解决方案,从基础的文本处理到高级的语义分析和机器学习集成,应有尽有。在后续章节中,我们将继续深入了解NLTK的更多功能,并与其他流行的NLP库进行比较分析,探索NLTK在不同应用场景中的优势和局限性。

# 3. NLTK与其他NLP库的比较分析

## 3.1 Python生态中的NLP库概览

### 3.1.1 核心NLP库介绍

Python作为一门广泛应用于数据科学的语言,拥有强大的自然语言处理库生态系统。核心NLP库包括但不限于NLTK(Natural Language Toolkit)、Spacy、TextBlob等。NLTK作为老牌的NLP库,它提供了丰富的语言处理功能,是初学者和研究者的首选工具之一。Spacy则以性能见长,适合用于大规模文本处理,特别是在商业项目中,提供了许多高级特性如深度学习集成。TextBlob以简洁明了的API和易于上手而受到许多开发者的欢迎,适合快速实现常见的NLP任务。

```mermaid

graph TD

A[Python NLP库] -->|NLTK| B[NLTK]

A -->|Spacy| C[Spacy]

A -->|TextBlob| D[TextBlob]

```

### 3.1.2 各库在NLP任务中的应用案例

- **NLTK**:广泛应用于文本分类、语义分析、机器翻译原型开发等领域。

- **Spacy**:在文档主题建模、命名实体识别、依存解析中表现出色。

- **TextBlob**:适合于情感分析、语法检查、翻译等任务。

```markdown

| 库 | 应用案例 |

|---------|--------------------------------------------------|

| NLTK | 文本分类、情感分析、语言生成 |

| Spacy | 命名实体识别、依存解析、深度学习集成 |

| TextBlob| 快速情感分析、语法纠错、简单翻译任务 |

```

## 3.2 NLTK与Spacy的对比

### 3.2.1 语法和词汇分析

NLTK提供了丰富的语法分析工具,如句法树构建、词性标注等。而Spacy则着重于高效的依存解析和实体识别,其解析速度快且精度高,适合用于需要快速处理大量文本的场景。

```python

import nltk

from nltk import pos_tag, word_tokenize

nltk.download('punkt')

nltk.download('averaged_perceptron_tagger')

text = "NLTK is a leading platform for building Python programs to work with human language data."

tokens = word_tokenize(text)

tagged = pos_tag(tokens)

print(tagged)

```

### 3.2.2 实体识别与依存解析

Spacy在实体识别方面集成了先进的机器学习模型,能够在文本中快速识别出人名、地名、组织名等实体。NLTK则提供了基于规则的实体识别工具,适用于特定语言数据集的定制化处理。

```python

import spacy

nlp = spacy.load("en_core_web_sm")

doc = nlp(text)

for ent in doc.ents:

print(ent.text, ent.label_)

```

### 3.2.3 性能和资源消耗比较

NLTK依赖于广泛的插件和模块,这意味着在功能上非常灵活,但同时也意味着更高的资源消耗。Spacy优化了性能,特别是其在内存使用和执行速度上通常优于NLTK。

```markdown

| 性能指标 | NLTK | Spacy |

|----------------|---------------|---------------|

| 资源消耗 | 较高 | 低 |

| 加载时间 | 较长 | 较短 |

| 处理速度 | 中等 | 快速 |

```

## 3.3 NLTK与TextBlob的对比

### 3.3.1 简化文本处理的特点

TextBlob的API设计简单直观,使得即使是没有任何NLP背景的开发者也能快速上手,处理常见的NLP任务如情感分析、词性标注等。NLTK虽然功能全面,但需要用户有一定的学习曲线。

```python

from textblob import TextBlob

text = "NLTK is incredibly easy to use for simple tasks."

blob = TextBlob(text)

print(blob.sentiment) # 输出情感分析结果

```

### 3.3.2 情感分析和语言翻译

TextBlob内置了情感分析功能,可以简单快速地对文本的情感倾向进行判断。而NLTK提供了更复杂的语言处理功能,比如可以通过集成外部模型实现更精确的情感分析。

```python

# TextBlob情感分析示例

blob = TextBlob(text)

sentiment = blob.sentiment

print(sentiment)

```

### 3.3.3 易用性对比

NLTK的学习曲线相对陡峭,但其提供的文档和示例数量庞大,适合深入学习和研究。TextBlob则更注重于快速实现和易用性,适合快速开发和对NLP需求不是很复杂的场景。

```markdown

| 特性 | NLTK | TextBlob |

|---------

```

0

0