NLTK与网络安全:文本分析在欺诈检测中的应用

发布时间: 2024-10-04 18:38:48 阅读量: 61 订阅数: 42

探索Python中的NLTK:自然语言处理的应用与实践

# 1. 文本分析与网络安全基础

在当今数字化世界中,文本分析和网络安全是两个不可分割的领域。文本分析,特别是自然语言处理(NLP),已成为理解和处理大量文本数据的关键技术,它在网络安全中扮演着至关重要的角色。通过深入分析和处理网络日志、邮件内容、论坛讨论等文本信息,安全专家可以识别和防范潜在的威胁,如欺诈、垃圾邮件和网络钓鱼攻击。

文本分析不仅提高了网络安全的智能化水平,也促进了对网络安全态势的实时监控和预测。在此基础上,了解文本分析与网络安全之间的联系,掌握基本的文本分析技术,以及如何在网络安全框架中应用这些技术,对于任何希望保持其数据和系统安全的组织都是至关重要的。本章将从基础概念入手,逐步深入探讨文本分析的原理和在网络安全中的应用。

# 2. NLTK库的理论与实践

## 2.1 NLTK库的基本概念和组件

### 2.1.1 NLTK库的安装和导入

NLTK,即Natural Language Toolkit,是一个强大的Python库,用于处理人类语言数据。它提供了丰富的文本处理工具集,让研究者和开发者能够轻松地进行文本分析、自然语言处理和机器学习等任务。

安装NLTK库相对简单,可通过以下命令在Python环境中进行安装:

```bash

pip install nltk

```

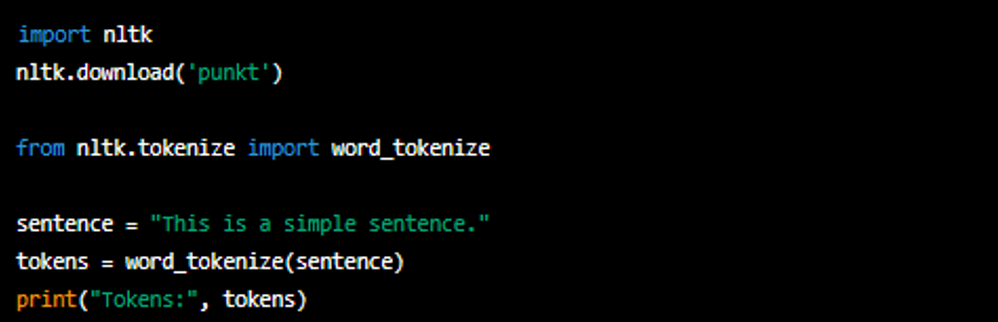

安装完成后,您可以通过Python解释器导入NLTK库,以下是一个简单的示例:

```python

import nltk

```

导入后,可以使用NLTK提供的大量文本处理工具和数据集。为了使用一些特定的资源,如分词器、语料库等,可能需要使用nltk.download()函数下载这些额外的数据。

```python

nltk.download('punkt')

```

以上命令会下载NLTK的分词器预训练模型。'punkt'是NLTK中的一个分词器模型,能够将文本分割成可管理的句子和单词。

### 2.1.2 NLTK中的文本预处理工具

文本预处理是自然语言处理的一个关键步骤,它涉及到将原始文本数据转换为适合分析的格式。NLTK提供了多种用于文本预处理的工具。

以下是NLTK中几个常用的文本预处理工具:

1. **分词器**:将一段文本分割成单独的单词或句子。常用的分词器包括`word_tokenize`用于单词级别的分词,`sent_tokenize`用于句子级别的分词。

2. **停用词去除**:停用词指的是文本中频繁出现,但通常不携带实际意义的词,如"the"、"is"、"in"等。`nltk.corpus.stopwords`提供了一些常见语言的停用词列表。

3. **词形还原(Lemmatization)和词干提取(Stemming)**:这两种技术用于将单词还原为词根形式。词形还原则更加复杂和精确,它考虑了单词的词性和上下文;而词干提取则是一种更快速但粗糙的近似方法。

使用这些工具,我们可以将一段文本处理为更适合进行文本分析的形式。

```python

from nltk.tokenize import word_tokenize, sent_tokenize

from nltk.corpus import stopwords

from nltk.stem import WordNetLemmatizer, PorterStemmer

# 示例文本

text = "NLTK is a leading platform for building Python programs to work with human language data."

# 分词

tokens = word_tokenize(text)

# 去除停用词

filtered_tokens = [word for word in tokens if word not in stopwords.words('english')]

# 词形还原

lemmatizer = WordNetLemmatizer()

lemmatized_tokens = [lemmatizer.lemmatize(token) for token in filtered_tokens]

# 词干提取

stemmer = PorterStemmer()

stemmed_tokens = [stemmer.stem(token) for token in lemmatized_tokens]

print("分词结果:", tokens)

print("去除停用词结果:", filtered_tokens)

print("词形还原结果:", lemmatized_tokens)

print("词干提取结果:", stemmed_tokens)

```

此代码段展示了如何使用NLTK进行基础文本预处理,包括分词、去除停用词、词形还原和词干提取。每个步骤都有其特定的应用场景,并且是构建复杂文本分析模型前的必要准备。

接下来,我们将深入了解如何使用NLTK进行词法分析,这一步骤是构建更高级自然语言处理应用的重要基石。

# 3. 欺诈检测的文本分析技术

随着互联网金融的迅猛发展,欺诈行为愈发隐蔽和复杂,传统的基于规则的欺诈检测方法已难以满足行业需求。文本分析技术作为一种有效的信息提取手段,能够从大量的文本数据中识别出潜在的欺诈行为。在本章节中,我们将深入探讨如何利用文本分析技术提取欺诈文本的特征,并构建高效的欺诈检测模型,以及如何评估这些模型的有效性。

## 3.1 欺诈文本的特征提取

### 3.1.1 常见欺诈特征的识别

在进行欺诈检测前,首先需要识别出欺诈文本的常见特征。这些特征可能包括异常的交易模式、不寻常的用户行为、以及特定的关键词或短语。例如,涉及到信用卡欺诈的文本中,可能会出现如"交易被拒绝"、"账户资金不足"等短语。

使用文本分析技术可以提取出这些异常特征。例如,通过关键词提取技术,可以找到与欺诈行为紧密相关的词汇。这些词汇构成了欺诈检测的基础特征集。文本分析的另一个重要方面是提取文本中表达情感的词汇,因为欺诈文本中经常包含负面情感的表达。

### 3.1.2 特征向量的构建方法

特征提取之后,需要将这些特征转化为模型可以处理的数值形式,即特征向量。这通常涉及自然语言处理技术中的向量化过程,如词袋模型(Bag of Words,BoW)、TF-IDF(Term Frequency-Inverse Document Frequency)等。

词袋模型是一种将文本数据转换为数值型特征向量的方法,它忽略了词语之间的顺序,仅关注词汇的出现频率。TF-IDF 是一种考虑了词语重要性的方法,可以减少常见词(如"的"、"是"、"在"等)的影响,并提升罕见但有信息量的词语的权重。

```python

from sklearn.feature_extraction.text import TfidfVectorizer

# 示例:使用TF-IDF转换文本数据为特征向量

documents = ['欺诈行为通常包含特定的关键词', '异常交易模式可能是欺诈的标志']

tfidf_vectorizer = TfidfVectorizer()

tfidf_matrix = tfidf_vectorizer.fit_transform(documents)

print(tfidf_matrix.toarray())

```

代码说明:上述代码展示了如何使用 `TfidfVectorizer` 对文本数据集进行转换。`fit_transform` 方法首先拟合数据,然后将其转换为TF-IDF特征矩阵。输出为每个文档的特征向量。

## 3.2 欺诈检测模型的构建

### 3.2.1 机器学习算法在欺诈检测中的应用

构建欺诈检测模型时,机器学习算法是一个核心工具。常见的算法包括逻辑回归、支持向量机(SVM)、随机森林等。选择合适的算法对于模型的性能至关重要。

以逻辑回归为例,它是二分类问题的一个常用算法。逻辑回归模型通过学习特征和输出之间关联的逻辑关系,预测新样本是否属于欺诈类别。其简单性和效率使其成为欺诈检测的首选算法之一。

### 3.2.2 模型训练与参数调优

模型训练是一个迭代优化的过程。在训练过程中,需要对模型的参数进行调整以达到最佳的性能。这一过程称为超参数调优。常用的调优方法包括网格搜索(Grid Search)和随机搜索(Random Search)。

网格搜索通过构建一个参数网格,尝试所有参数组合来找到最优的参数集。随机搜索则是随机选择一定数量的参数组合进行评估。相对而言,随机搜索在大参数空间中更高效。

```python

from

```

0

0