【监控与管理】:Kafka集群在Go中的高效运用策略

发布时间: 2024-10-22 14:00:29 阅读量: 1 订阅数: 3

# 1. Kafka集群基础与Go语言概述

## Kafka集群基础

Apache Kafka是一个分布式流处理平台,广泛用于构建实时数据管道和流应用程序。它拥有高性能、可扩展性以及容错性等特点,特别适用于大规模数据处理场景。Kafka集群的核心组件包括主题(Topics)、分区(Partitions)、副本(Replicas)、生产者(Producers)和消费者(Consumers)。理解这些组件的职责和相互作用是掌握Kafka集群操作和优化的关键。

生产者将数据发送到主题,而消费者则订阅主题来接收数据。分区是将主题数据进行逻辑分组,而副本则是分区数据的备份,用于提供容错能力。这些组件共同构成了Kafka集群强大的数据处理能力。

## Go语言概述

Go语言(又称Golang)是一种静态类型、编译型语言,由Google开发,设计目标是使编程更加简洁、快速且高效。Go语言的特点包括垃圾回收、并发编程的简化以及丰富的标准库,这些特性使得Go成为构建高性能分布式系统和微服务架构的理想选择。

与Kafka的紧密结合为Go语言开发者提供了强大的消息处理能力。借助Go的并发特性,可以轻松实现与Kafka集群的高效交互,无论是消息的生产还是消费。由于其简洁的语法和高效执行,Go语言成为了处理大规模数据流的理想编程语言。

# 2. Kafka集群核心原理详解

## 2.1 Kafka集群架构与组件功能

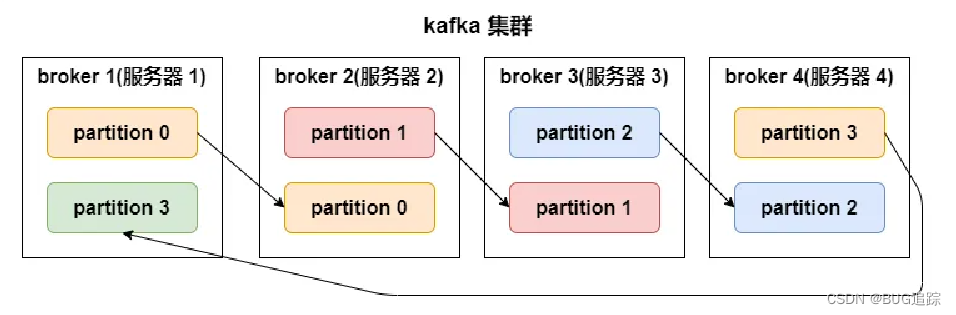

### 2.1.1 Broker节点与主题分区

Kafka集群的核心组件之一是Broker节点。每个Broker节点实质上是一个运行着的Kafka服务器,负责存储消息数据。消息数据被组织成主题(Topics),而主题数据进一步被分割成多个分区(Partitions)。每个分区可以被分布在集群的不同Broker上,以实现负载均衡和水平扩展。

分区的存在是Kafka处理高吞吐量和高可用性的关键。分区允许并行处理消息,提高整体性能。当消息写入到Kafka时,会被放入一个特定的分区,而消费者(Consumer)可以并行地从不同的分区读取消息。

```mermaid

graph TB

producer --> broker1

producer --> broker2

producer --> broker3

broker1 -->|Messages| partition1

broker2 -->|Messages| partition2

broker3 -->|Messages| partition3

partition1 --> consumer

partition2 --> consumer

partition3 --> consumer

```

在这个mermaid流程图中,生产者(Producer)向三个不同的Broker节点发送消息,每个Broker节点管理着一个分区。消费者(Consumer)则从各个分区中并行消费消息。

### 2.1.2 ZooKeeper在Kafka中的角色

Kafka集群使用ZooKeeper来维护集群状态信息,例如主题列表、分区信息、Broker注册信息等。虽然从Kafka 2.8版本开始,社区正在努力将Kafka与ZooKeeper解耦,但目前ZooKeeper依然是Kafka不可或缺的一部分。

ZooKeeper提供了分布式协调功能,它可以处理多种复杂的任务,如领导者选举(Leader Election)、元数据同步和分布式锁等。这些功能对Kafka集群的高可用性至关重要。

```mermaid

graph LR

client -->|查询| zookeeper

zookeeper -->|元数据| kafka集群

kafka集群 -->|处理| consumer

kafka集群 -->|存储| message

```

上述mermaid流程图简单描述了客户端、ZooKeeper以及Kafka集群之间的交互。客户端通过查询ZooKeeper来获取集群信息,之后与Kafka集群交互处理消息。

## 2.2 Kafka消息传递机制

### 2.2.1 消息的生产与消费模型

Kafka消息生产者(Producer)负责将消息发送到指定的Kafka主题。生产者可以选择消息的分区策略,例如轮询(Round-Robin)、按消息键(Key)哈希分区等。消息一旦写入分区,就会被顺序存储。

消费者通常组织成消费者组(Consumer Group)来消费消息。每个消费者组订阅一组主题,并通过特定的分区分配策略来消费这些主题的消息。消费者组中的每个消费者实例读取一部分分区的数据,实现负载均衡。

### 2.2.2 消息的持久化与可靠性保障

为了保证消息的持久化存储,Kafka将消息写入磁盘,并通过复制机制(Replication)保证数据的可靠性。每个分区都有一个领导者(Leader),它可以处理所有对分区的读写请求。一个或多个跟随者(Followers)复制分区的数据。

当领导者宕机时,ZooKeeper会发起领导者选举,跟随者中的一个会成为新的领导者。这个机制确保了即使在部分硬件故障的情况下,消息也不会丢失,提高了系统的容错能力。

```markdown

| 分区 | 领导者 | 跟随者 | 备注 |

| ---- | ------ | ------ | ---- |

| Part1| Broker1| Broker2| 备份 |

| Part2| Broker2| Broker3| 主要 |

| Part3| Broker3| Broker1| 主要 |

```

上表显示了分区的领导者和跟随者配置情况,其中“主要”和“备份”标记说明了每个副本的角色。

## 2.3 Kafka集群的性能优化

### 2.3.1 配置参数与性能调节

Kafka集群的性能优化可以从多个方面进行,而调整合适的配置参数是基础工作。例如,可以调整生产者和消费者的批处理大小(batch size)、缓冲区大小(buffer size)和请求超时时间(request timeout)等参数。

另外,可以考虑合理设置分区数量,因为过多的分区会导致元数据管理开销增加,而过少则可能无法充分利用集群的吞吐能力。合理地设置副本因子(replication factor)也对于保持数据的高可用性至关重要。

```mermaid

graph LR

config --> performance

performance --> throughput[Throughput]

performance --> latency[Latency]

throughput -.->|优化| config

latency -.->|优化| config

```

该mermaid图表显示了配置参数如何影响性能,并通过优化循环来实现更高的吞吐量和更低的延迟。

### 2.3.2 消费者组的优化策略

针对消费者组的优化,需要关注分区和消费者的平衡分配。通过合理配置消费者的`max.poll.records`参数可以控制每次调用轮询返回的消息数量,而`session.timeout.ms`参数可以控制消费者在多长时间内未发送心跳被认为是失效的。

同时,可以使用Kafka自带的工具来监控消费者偏移量,及时发现并解决消费者组中的问题。消费者组的合理优化可以避免数据消费出现延迟或重复的问题,保证数据处理的准确性和实时性。

```markdown

| 消费者组 | 订阅主题 | 偏移量 | 状态 |

| --------- | --------- | ------- | ---- |

| group1 | topicA | 100 | Normal |

| group2 | topicA | 200 | Lagging |

```

上表为消费者组的状态监控示例,显示了消费者组的名称、订阅的主题、当前偏移量和消费者组的状态。表格中的“Normal”表示正常消费,“Lagging”表示消费者组存在延迟消费问题。

# 3. Go语言与Kafka集群的交互实践

## 3.1 Go语言操作Kafka的基本方法

### 3.1.1 Go语言中Kafka客户端库的使用

在Go语言中操作Kafka集群,我们可以借助第三方库,例如`***/Shopify/sarama`,这是最流行的Kafka客户端库之一,它提供了生产者和消费者的API,使得开发者能够方便地进行消息的生产和消费。首先,你需要通过Go的包管理工具安装这个库。

```**

***/Shopify/sarama

```

安装完成后,在你的Go程序中,你可以这样导入并使用它:

```go

import (

"***/Shopify/sarama"

)

```

### 3.1.2 生产者和消费者的代码实现

创建一个Kafka生产者:

```go

package main

import (

"log"

"***/Shopify/sarama"

)

func main() {

config := sarama.NewConfig()

config.Producer.RequiredAcks = sarama.WaitForAll // 发送完数据需要leader和follow都确认

config.Producer.Return.Successes = true

// 如果版本低于0.10.0,则需要设置Partitioner

// config.Producer.Partitioner = sarama.NewRandomPartitioner

// 创建一个sarama生产者实例

producer, err := sarama.NewAsyncProducer([]string{"localhost:9092"}, config)

if err != nil {

panic(err)

}

// 异步发送数据

for i := 0; i < 10; i++ {

msg := &sarama.ProducerMessage{

Topic: "test",

Value: sarama.StringEncoder("This is message " + string(i)),

}

producer.Input() <- msg

}

// 关闭生产者

go func() {

defer func() {

if err := producer.Close(); err != nil {

panic(err)

}

}()

select {}

}()

for range producer.Successes() {

log.Println("消息发送成功")

}

}

```

创建一个Kafka消费者:

```go

package main

import (

"log"

"***/Shopify/sarama"

"time"

)

func main() {

config := sarama.NewConfig()

config.Consumer.Return.Errors = true

consumer, err := sarama.NewConsumer([]string{"localhost:9092"}, config)

if err != nil {

panic(err)

}

topic := "test"

partitionList, err := consumer.Partitions(topic)

if err != nil {

panic(err)

}

for partition := range partitionList {

partitionConsumer, err := consumer.ConsumePartition(topic, int32(partition), sarama.OffsetNewest)

if err != nil {

panic(err)

}

go func(pc sarama.PartitionConsumer) {

for message := range pc.Messages() {

log.Printf("Received message: key: %s, value: %s, topic: %s, partition: %d, offset: %d\n",

message.Key, message.Value, ***ic, message.Partition, message.Offset)

}

}(partitionConsumer)

}

time.Sleep(10 * time.Second) // 模拟持续消费10秒

consumer.Close()

}

```

0

0