【ConcurrentHashMap vs HashMap】:在并发场景下,选对集合赢在起跑线

发布时间: 2024-10-22 04:56:15 阅读量: 3 订阅数: 5

# 1. Java集合框架概述

Java集合框架是一组数据结构,用于存储和操作对象的集合。它是Java编程中不可或缺的一部分,提供了丰富的接口和类来处理各种数据集合的需求。集合框架包括List、Set、Queue和Map等主要接口,每个接口又有多个实现类。例如,List接口有ArrayList和LinkedList等实现,它们分别适用于不同的使用场景。集合框架还通过迭代器模式提供了统一的遍历机制。本章将对Java集合框架进行概述,为深入理解后续章节中的HashMap和ConcurrentHashMap打下基础。

# 2. 深入理解HashMap的工作原理

### 2.1 HashMap的内部结构

#### 2.1.1 数组与链表的结合——哈希表的实现

在Java中,HashMap是一种基于哈希表的Map接口实现。它通过哈希函数来计算键的存储位置,以此来实现键值对的快速访问。一个HashMap实例由一个Node数组构成,Node是HashMap内部静态类,用来存储键值对。

对于数组而言,每个位置可以看作是一个桶(bucket),当两个不同的键通过哈希函数计算得到同一个索引时,它们在同一个桶中,这种情况称为哈希冲突。为了处理这种冲突,HashMap使用链表来维护冲突的节点。当多个键值对在同一个桶中时,它们会形成一条链表,按插入顺序链接在一起。

这种数组与链表的结合方式是HashMap高效的关键,它既利用了数组的快速随机访问特性,又通过链表解决了哈希冲突问题。具体而言,HashMap在插入、删除和访问键值对时的时间复杂度接近O(1),前提是哈希函数能均匀地分布键值对到不同的桶中,从而保持链表的短小。

#### 2.1.2 哈希函数的计算与冲突解决

哈希函数对于HashMap而言至关重要,它的性能直接影响到整个HashMap的操作效率。理想的哈希函数应该能将键均匀地分布到数组的所有位置上,以减少哈希冲突。

在Java中,HashMap通过计算键的`hashCode()`值,并通过一系列位运算(例如位移和异或操作)来计算数组索引。计算公式通常如下:

```java

index = hash(key) & (table.length - 1)

```

其中,`table.length`是HashMap底层数组的长度。由于数组长度必须是2的幂,使用`table.length - 1`可以确保所有的位都能参与到索引的计算中,从而减少哈希冲突。

当发生哈希冲突时,HashMap会将新的键值对节点添加到链表的头部。这是因为链表头部添加节点的时间复杂度为O(1),而尾部添加则需要遍历整个链表,所以头部添加更为高效。这种头插法的设计使得链表的访问顺序与插入顺序相反,但对性能影响较小。

### 2.2 HashMap的操作过程分析

#### 2.2.1 put()和get()方法的工作机制

`put(K key, V value)`方法是HashMap中用于添加键值对的方法。在执行`put()`方法时,首先会调用键的`hashCode()`方法获取哈希码,然后通过哈希函数计算出数组的索引位置。如果该位置上没有元素,直接创建一个新节点放入桶中;如果有元素存在,即发生了哈希冲突,进一步比较键是否相同,若相同则更新键对应的值,若不同则以链表形式插入到头部。

`get(Object key)`方法用于根据键获取值。首先也是通过哈希函数得到索引位置,然后比较该位置上的链表中的元素。如果找到匹配的键,就返回与之对应的值;如果链表中没有匹配的键,则返回`null`。

在`put()`和`get()`方法中,哈希函数的效率和哈希冲突处理机制非常关键。良好的哈希函数可以减少冲突,使得操作的效率接近O(1)。

#### 2.2.2 扩容机制详解

当HashMap中的元素数量超过阈值(加载因子乘以数组长度)时,HashMap需要扩容以维持性能。扩容主要是创建一个新的更大的数组,并将旧数组中的所有节点重新哈希到新数组中。

在Java中,扩容操作的步骤如下:

1. 创建一个新的Entry数组,长度是原数组的两倍。

2. 遍历原数组,对于每个桶中的链表,将链表中的节点重新计算哈希值,分配到新的数组中。

3. 更新***p的内部变量,包括底层数组、容量、负载因子和阈值。

扩容是一个耗时的操作,尤其是当HashMap中存储了大量的键值对时。因此,合理地设置初始容量和负载因子对于减少扩容次数,提升HashMap性能至关重要。

#### 2.2.3 多线程环境下HashMap的问题

在多线程环境下操作HashMap可能会出现一些问题。由于HashMap的实现并不是线程安全的,因此在多个线程同时调用`put()`或`get()`方法时,可能会导致数据状态不一致、数据丢失或死循环等问题。

具体而言,当两个线程同时对同一个桶中的链表进行修改操作时,如一个线程在进行头插法插入新节点,另一个线程在遍历链表,就有可能产生不可预见的后果。此外,扩容操作在并发环境下同样会导致问题,如果多个线程同时触发扩容,可能会导致部分数据丢失或重复计算哈希值。

为了安全地在多线程环境下使用HashMap,通常需要使用`Collections.synchronizedMap`或者引入`ConcurrentHashMap`来代替。

### 2.3 本章小结

通过对HashMap的工作原理深入分析,本章节揭示了其内部结构的关键组成,包括数组、链表以及哈希函数和冲突解决策略。详细探讨了`put()`和`get()`这两个核心方法的实现,以及它们在操作键值对时的内部工作机制。此外,还解析了HashMap在扩容机制中如何处理数据迁移和性能优化,并特别指出了多线程环境下HashMap所面临的潜在问题,为后续章节探索线程安全的HashMap变体提供了理论基础。

# 3. 深入探索ConcurrentHashMap的并发优势

在现代多线程应用开发中,线程安全的集合使用尤为重要。Java并发集合框架提供了多个线程安全的实现,其中最为核心和复杂的是`ConcurrentHashMap`。作为`HashMap`的一个并发版本,`ConcurrentHashMap`不仅保证了线程安全,还通过一系列优化策略大幅提升了并发读写性能。本章将深入剖析`ConcurrentHashMap`的内部结构与实现原理,以及并发操作的细节和性能表现。

## 3.1 ConcurrentHashMap的结构和实现

### 3.1.1 分段锁技术及其作用

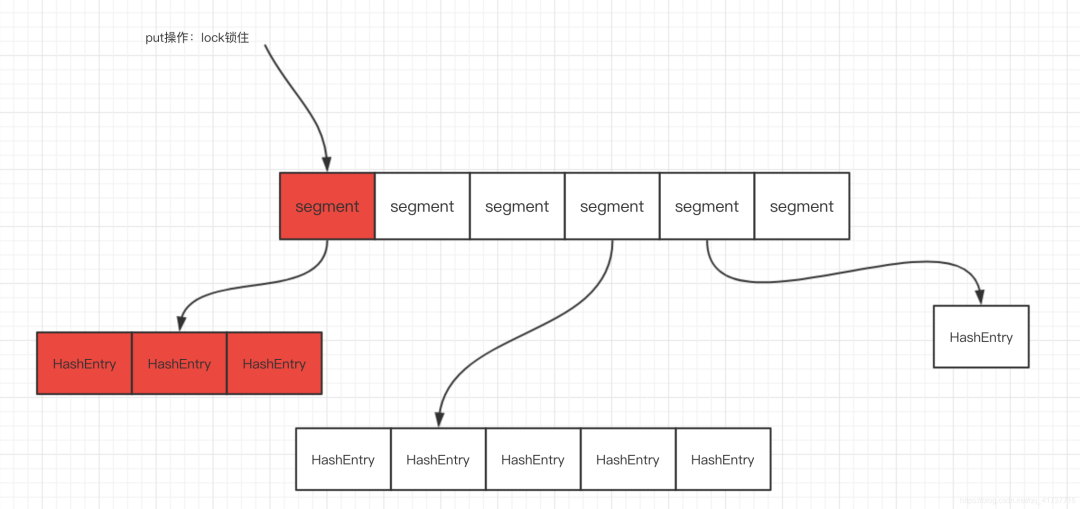

为了实现高并发访问,`ConcurrentHashMap`采用了一种称为分段锁(Segmentation)的技术。通过将数据分段,每个分段独立加锁,只有涉及特定段的操作才会锁定对应的分段,这样大大减少了锁的粒度,从而提升了并发访问的能力。

一个`ConcurrentHashMap`实例包含多个`Segment`对象,每个`Segment`都是一个独立的哈希表,内部拥有自己的数组结构。默认情况下,`ConcurrentHashMap`创建16个`Segment`,即并发级别为16,这意味着可以同时支持16个线程并发写入,而不会出现线程阻塞。

### 3.1.2 并发访问控制的细节

每个`Segment`内部使用了一种称为“分段计数器”(Segment Counters)的机制来控制对数组的并发访

0

0