【锁粒度的选择】:ConcurrentHashMap与多种锁策略的精彩较量

发布时间: 2024-10-22 05:17:34 阅读量: 2 订阅数: 5

# 1. 多线程并发基础与锁的概念

在现代软件开发中,多线程并发是提升应用程序性能的关键技术之一。它允许程序同时执行多个任务,从而更好地利用计算资源。在多线程环境下,线程安全问题成为一个核心关注点。而锁是解决线程安全问题的重要机制,它能保证多个线程在访问共享资源时保持数据的一致性和完整性。

## 1.1 并发编程的挑战

在并发环境中,我们面临的主要挑战是竞态条件和线程同步问题。竞态条件发生在多个线程同时读写同一数据时,结果依赖于各个线程的执行时序。为了防止这种情况,程序设计者必须确保关键代码段在执行时能够互斥访问共享资源。线程同步是通过锁等机制实现的,保证了特定资源在给定时刻只被一个线程访问。

## 1.2 锁的基本概念

锁是一种并发控制机制,它允许多个线程按顺序访问共享资源。锁可以简单地分为互斥锁和读写锁。互斥锁保证了同一时间只有一个线程可以持有锁,适用于更新操作。读写锁允许多个读操作同时进行,但是写操作时会阻止新的读操作,适用于读多写少的场景。通过锁,我们可以构建正确的并发程序,避免数据竞争和条件竞争,确保数据的一致性。

# 2. ConcurrentHashMap的工作原理与锁粒度

## 2.1 线程安全的散列映射

### 2.1.1 HashMap与线程安全问题

在多线程环境中,使用`HashMap`这类非线程安全的散列映射会带来诸多问题。当多个线程尝试对同一个`HashMap`实例进行写操作时,容易出现数据不一致的情况。这是因为`HashMap`内部使用数组存储键值对,而数组本身不具备同步机制,无法保证多线程间的数据一致性。

为了理解这一点,我们考虑一个简单的场景,两个线程同时执行以下操作:

```java

HashMap<String, Integer> map = new HashMap<>();

map.put("key", 1);

```

如果两个线程几乎同时执行`put`操作,那么可能会覆盖彼此的值,因为内部数组的更新没有同步控制。更严重的是,`HashMap`在扩容时,由于涉及到元素的重新哈希和数组复制,这个过程并不是原子操作,线程安全问题会更加突出。

### 2.1.2 ConcurrentHashMap的结构与特性

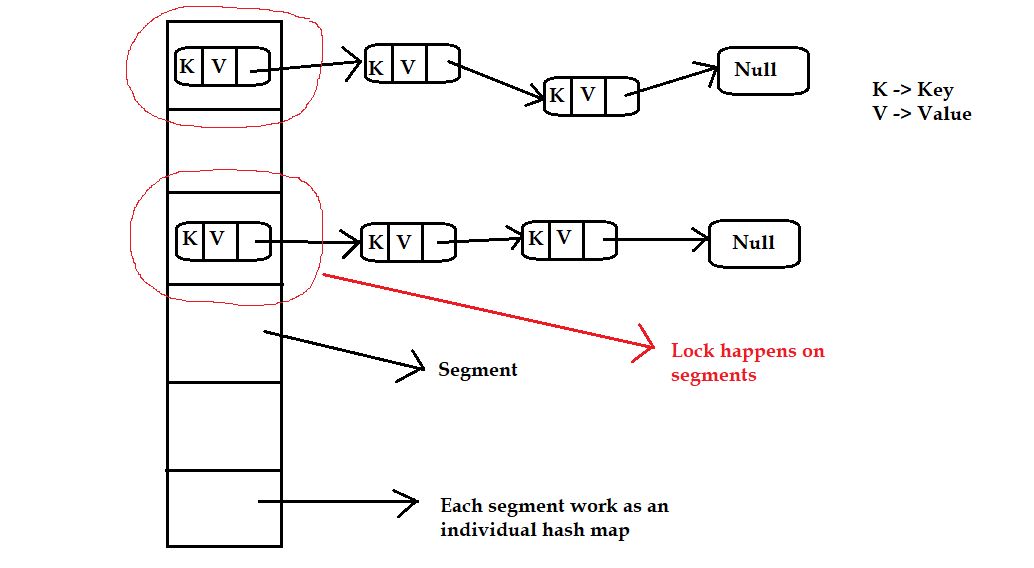

为了应对这些问题,Java并发包提供了`ConcurrentHashMap`,它专为并发环境设计。`ConcurrentHashMap`在高并发的环境下,能够保证更高的操作性能和线程安全性。其内部使用了分段锁(Segmentation)技术,将数据分为多个段(Segment),每个段相当于一个小的`HashMap`,它们之间相互独立。这种设计极大地减少了锁的竞争,从而提高了并发访问效率。

`ConcurrentHashMap`的核心特性如下:

- **线程安全**:内部通过使用多个锁来保护数据,使得多个线程可以同时读写不同的段。

- **高效**:相比于`Hashtable`,它在没有牺牲太多并发性的情况下,提供了一个更为快速的数据访问策略。

- **可伸缩性**:通过增加段的数量(`concurrencyLevel`参数),可以适应更多的并发写操作。

## 2.2 锁的粒度分析

### 2.2.1 细粒度锁的优势与挑战

细粒度锁的优势在于它能够将锁定的范围缩小到单个操作或数据项上,这样可以显著减少锁的竞争,并提高并发性能。然而,实现细粒度锁并不是没有挑战的:

- **复杂性**:设计细粒度锁机制需要细致地分析数据访问模式,确保不会过度锁定或者引入死锁。

- **维护成本**:随着系统的发展,维护细粒度锁的代码可能变得复杂且容易出错。

### 2.2.2 粗粒度锁的设计与影响

与细粒度锁相对的是粗粒度锁,它通常会锁定较大的数据结构或代码段,尽管这种方法简化了锁定策略,但带来了锁竞争的增加,特别是在多线程环境下,可能导致性能瓶颈。

### 2.2.3 无锁技术与原子操作的应用

在某些情况下,可以使用无锁技术(如原子操作)来代替传统的锁。无锁技术通常依赖于硬件支持的原子指令来保证操作的原子性,从而避免锁的使用。在Java中,`AtomicInteger`和`AtomicReference`等原子类就提供了无锁操作的能力,但它们只能保证操作的原子性,不能解决复杂状态管理的问题。

## 2.3 ConcurrentHashMap中的锁机制

### 2.3.1 分段锁的设计原理

`ConcurrentHashMap`中的分段锁技术是通过将数据分段,然后对每一段数据施加独立的锁。每个段是一个子`HashMap`,代表了`ConcurrentHashMap`的一个子集。锁只在特定的段上实现,这使得在访问不同的段时,线程可以并发地进行而无需等待其他线程释放锁。

### 2.3.2 锁分离技术的实现

锁分离是指将读写操作的锁分离,`ConcurrentHashMap`使用了读写锁分离的策略。读操作可以并发进行,无需加锁;而写操作,则需要获取对应段的独占锁。这种机制极大地提高了读操作的并发性能。

### 2.3.3 锁升级策略与性能优化

在`ConcurrentHashMap`的早期实现中,锁的升级是从无锁到有锁,再到更高级别的锁。这种策略允许在读多写少的场景下,绝大多数读操作可以无需加锁完成。在Java 8及以后的版本中,`ConcurrentHashMap`进一步优化了结构和锁策略,使得即使在高并发写的情况下,也能保持较好的性能。

```java

// 示例代码段

ConcurrentHashMap<String, Integer> map = new ConcurrentHashMap<>();

map.putIfAbsent("key", 1); // 使用无锁操作

```

在上述代码中,`putIfAbsent`是一个无锁的操作,它能够在不加锁的情况下,检查并添加键值对,这正是通过原子操作实现的。

```java

// 示例代码段

ConcurrentHashMap<String, Integer> map = new ConcurrentHashMap<>();

map.get("key"); // 读操作不需要加锁

```

在读取数据时,由于读操作之间不会相互干扰,`ConcurrentHashMap`允许它们并发进行,无需进行任何形式的加锁。这就大大提高了读操作的性能。

在本章节中,深入剖析了`ConcurrentHashMap`是如何通过锁粒度控制和锁分离技术来实现线程安全的高效并发访问的。这一系列技术的应用不仅提升了性能,也使得并发编程更加高效和简单。通过这些案例,我们可以更好地理解在构建并发应用程序时,如何选择和应用适当的锁机制。

# 3. 多种锁策略的理论与实践

## 3.1 互斥锁与读写锁

### 3.1.1 互斥锁的基本使用与性能特点

互斥锁(Mutex)是最简单也是最常用的同步机制之一,它用于保证在任何时刻,只有一个线程能够访问共享资源。在多线程环境下,互斥锁能够防止多个线程同时执行临界区代码,从而避免数据不一致的问题。

**基本使用**

互斥锁的使用通常包括以下步骤:

1. 初始化锁:在使用互斥锁前,需要对其进行初始化。

2. 上锁(Locking):线程调用互斥锁的lock方法,试图进入临界区。如果锁已被其他线程占用,当前线程将被阻塞,直到锁被释放。

3. 执行临界区代码:线程获得锁后,可以安全地执行临界区内的代码。

4. 解锁(Unlocking):线程完成对共享资源的操作后,必须调用解锁方法释放锁,以供其他线程使用。

**性能特点**

互斥锁的一个关键性能特点是它的“饥饿”特性。如果一个线程长时间得不到锁,可能会导致其它线程饿死,即长时间无法执行临界区代码。因此,需要合理控制锁的占用时间,尽量减少线程在锁内的操作。

互斥锁还有一个特点是它会阻塞线程。当一个线程尝试获取一个被其他线程持有的锁时,它将被挂起,直到锁被释放。这可能会导致上下文切换的开销增加,特别是在高并发情况下。

### 3.1.2 读写锁的优势与场景适应性

读写锁(ReadWriteLock)是一种优化读操作的同步机制。其核心思想是

0

0