张量分解技术最新进展:算法创新与应用拓展全解析

发布时间: 2024-12-25 10:09:45 阅读量: 4 订阅数: 11

基于张量分解的高维图像处理建模与算法研究 简单笔记

# 摘要

张量分解技术作为一种高效处理多维数据的数学工具,在信号处理、机器学习、图像视频处理、大数据分析以及推荐系统等领域展现了广泛的应用潜力。本文系统地回顾了张量分解技术的基本概念、理论基础以及主要分解方法,包括CP分解、Tucker分解和TT分解等,并深入探讨了其理论优化,如收敛性、稳定性和算法效率的提升。同时,本文分析了张量分解在多维数据分析、图像视频处理和大数据推荐系统中的应用实践,并总结了创新算法的融合、非负张量分解以及低秩张量恢复等前沿研究。最后,本文展望了张量分解技术在跨学科应用中的巨大潜力,讨论了技术发展所面临的挑战与未来的研究方向。

# 关键字

张量分解;多维数据分析;信号处理;机器学习;图像视频处理;大数据分析

参考资源链接:[张量分解入门:CP与Tucker分解解析](https://wenku.csdn.net/doc/7qvu9i9ibd?spm=1055.2635.3001.10343)

# 1. 张量分解技术概述

## 1.1 张量分解技术简介

张量分解技术作为多维数据处理的重要工具,已被广泛应用于信号处理、图像分析和推荐系统等领域。它涉及将高维张量分解为若干个低维张量的乘积形式,以此简化复杂性并提炼数据的内在结构。

## 1.2 技术重要性与发展

这种技术之所以受到重视,是因为其在降低数据存储需求、提高处理效率的同时,也增强了对高维数据结构的理解。随着计算能力的提升和新算法的不断涌现,张量分解技术正在向更高的效率和更广泛的应用领域发展。

## 1.3 本章结构安排

本章节将从概述张量分解技术的基本概念出发,逐步深入到其理论基础、应用实践和创新算法。目的是为读者提供从理论到实践的全面知识体系,为深入研究和应用张量分解技术打下坚实基础。

# 2. 张量分解的理论基础

## 2.1 张量分解的数学原理

### 2.1.1 张量的基本概念

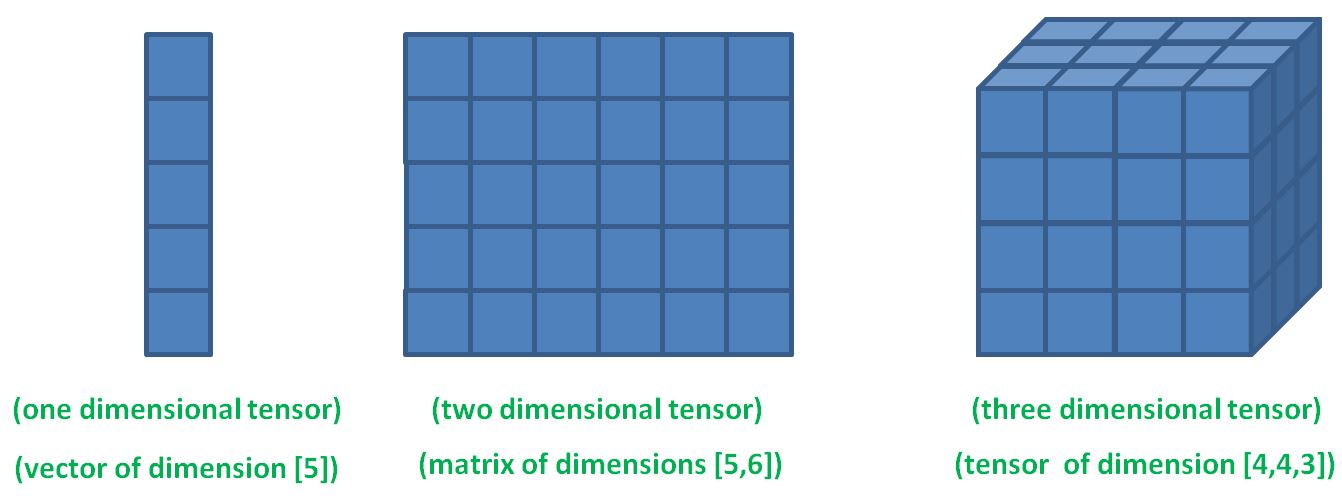

张量是多线性代数中的核心概念之一,在物理学、工程学以及计算机科学等多个领域都有广泛的应用。简单来说,张量可以看作是一个多维数组,它通过扩展了标量、向量和矩阵的概念来描述具有多维数据结构的物理量。在不同的应用背景下,张量的阶(即张量的维度)可能会有所不同。

张量的阶通常是指张量中包含的维数。例如,零阶张量就是一个标量,一阶张量是一个向量,二阶张量则是一个矩阵。高阶张量如三阶或更高阶的张量则需要多维度来描述。张量分解就是将高阶张量拆分为几个低阶张量的乘积,这个过程在数学上称为张量分解。

张量分解在处理高维数据时显示出独特的优越性,它不仅可以保留数据的多维特性,还可以减少数据的存储空间,提高数据处理的效率。

### 2.1.2 分解算法的数学模型

张量分解算法的数学模型涉及到线性代数中的向量空间和多线性映射。在最基本的层面上,张量分解的目标是找到几个低阶张量,它们的乘积接近原始的高阶张量。数学上,如果我们有一个R阶张量 \( \mathcal{X} \in \mathbb{R}^{I_1 \times I_2 \times \cdots \times I_R} \),我们希望找到 \( \mathcal{G}_1, \mathcal{G}_2, \ldots, \mathcal{G}_R \) 这R个张量,使得:

\[ \mathcal{X} \approx \mathcal{G}_1 \times_1 \mathcal{G}_2 \times_2 \cdots \times_R \mathcal{G}_R \]

这里的 \( \times_r \) 表示r模乘积,它结合了来自不同张量在第r维度上的元素。r模乘积的一个关键特点是它保持了张量的结构,同时简化了数据表达。

不同的分解模型会有不同的约束条件和优化目标。例如,最常用的矩阵分解模型SVD(奇异值分解)可以看作是二阶张量分解,而张量分解模型扩展了这个概念到更高阶。模型选择需要根据实际应用场景和数据特性来定。

## 2.2 主要张量分解方法

### 2.2.1 CANDECOMP/PARAFAC (CP) 分解

CP分解是张量分解中一种常见的方法。其名称来源于最初的两个独立的提出者Candecomp和Parafac,它是建立在因子分解的基础上,将张量表示为一组基向量和权重系数的线性组合。数学表达为:

\[ \mathcal{X} \approx \sum_{r=1}^{R} a_r \circ b_r \circ \cdots \circ c_r \]

这里 \( a_r, b_r, \ldots, c_r \) 是分解出的向量,分别对应张量的每个维度。符号 \( \circ \) 表示外积,它将向量张成更高维度的空间。CP分解在很多情况下能够有效地表示多维数据的本质结构,尤其在因式分析和多元统计分析领域中应用广泛。

CP分解在实践中如何执行呢?通常会利用交替最小二乘法(Alternating Least Squares, ALS)迭代地计算这些基向量。每次迭代固定 \( R-1 \) 个向量,只更新第 \( r \) 个向量,直到收敛。

代码示例:

```python

from tensorly.decomposition import parafac

# 假设 tensor 是一个三维张量

# factors 为分解得到的因子矩阵

factors = parafac(tensor, rank=R)

# factors[0]、factors[1]、factors[2] 分别为张量X的三个维度的因子矩阵

```

### 2.2.2 Tucker 分解

Tucker分解是另一种强有力的张量分解技术。与CP分解不同,Tucker分解是基于核函数的概念,它将原始张量分解为一个核心张量和一组正交矩阵的乘积。在数学上可以表示为:

\[ \mathcal{X} \approx \mathcal{G} \times_1 U_1 \times_2 U_2 \cdots \times_R U_R \]

其中 \( \mathcal{G} \) 是核心张量,而 \( U_1, U_2, \ldots, U_R \) 是正交矩阵,通常通过奇异值分解(SVD)计算得到。Tucker分解提供了比CP分解更灵活的张量表示方式,因为核心张量 \( \mathcal{G} \) 可以拥有不同的维度。

Tucker分解的执行通常使用高阶SVD(HOSVD)算法。在Python中可以使用如下的代码进行分解:

```python

from tensorly.decomposition import tucker

# 假设 tensor 是一个三维张量

# core 是核心张量,factors 是分解出的因式矩阵

core, factors = tucker(tensor, ranks=[R1, R2, ..., Rn])

```

### 2.2.3 Tensor Train (TT) 分解

TT分解是一种近年来受到关注的张量分解方法,尤其在处理大规模张量时显示出其独特的优越性。TT分解将高阶张量分解为一系列的三维核张量,每个核张量都包含一定的内在结构信息,这使得它在描述张量之间的内在联系时更为有效。

TT分解的基本模型可以表示为一系列的核张量 \( G^{(i)} \) 串联而成:

\[ \mathcal{X} \approx G^{(1)} \times_1 G^{(2)} \times_2 \cdots \times_{n-1} G^{(n)} \]

每一个核张量 \( G^{(i)} \) 是一个三维张量,其维度由相邻张量的维度决定。TT分解特别适用于处理大型张量,如在机器学习模型压缩和量子力学模拟中具有潜在的应用价值。

以下为TT分解的Python代码示例:

```python

from tensorly.decomposition import tt_decomposition

# 假设 tensor 是一个三维张量

# factors 是核张量的列表

factors = tt_decomposition(tensor)

```

## 2.3 张量分解的理论优化

### 2.3.1 收敛性和稳定性分析

张量分解算法的收敛性和稳定性对于实际应用至关重要。收敛性分析主要研究在迭代优化过程中,分解的目标函数是否能够稳定地收敛到全局最小值或局部最小值。稳定性分析则是研究算法对于输入数据的微小变化是否具有鲁棒性。

在实际应用中,确保算法的收敛性与稳定性需要仔细地选择合适的初始化策略、正则化参数以及迭代终止条件。例如,在CP分解的交替最小二乘法中,初始值的选择往往会影响算法的收敛速度和稳定性,因此需要通过试验确定最佳的初始化方法。

### 2.3.2 算法效率提升策略

随着数据集规模的日益增大,提高张量分解的算法效率成为一个挑战。优化策略包括并行化计算、矩阵操作的优化以及利用现代硬件加速。针对不同分解方法的特点,研究人员已经开发出各种优化算法来提高计算效率。

例如,可以利用CPU的多核心特性或者GPU的并行计算能力进行算法加速。在使用基于SVD的分解方法时,可以通过特殊的矩阵存储格式如稀疏矩阵来减少不必要的计算资源浪费。

此外,针对特定的问题,定制化的张量分解算法可以进一步提高性能。例如,针对特定的张量结构,可以设计专门的分解算法来减少计算复杂度或改善收敛速度。在实践中,应用这些策略可以显著提升大规模数据张量分解的性能和可行性。

以上章节内容展示了张量分解技术深厚的理论基础,并对主要的分解方法进行了介绍。后续章节中,我们将继续深入探讨张量分解技术在不同领域的应用实践。

# 3. 张量分解技术的应用实践

张量分解作为一种强大的数据分析工具,在多维数据处理、图像视频处理和大数据推荐系统等多个领域都展现出了其独特的优势和巨大的潜力。本章节将深入探讨张量分解技术的应用实践,通过具体案例和详细分析,揭示张量分解如何帮助解决实际问题,并提供技术优化和操作策略。

## 3.1 多维数据分析

在多维数据分析领域,张量分解技术以其在数据降维、特征提取以及模式识别方面的显著优势,被广泛应用在信号处理和机器学习中。以下详细介绍张量分解技术在这些场景中的具体应用。

### 3.1.1 信号处理中的应用

信号处理中的多维数据可以是多通道传感器收集到的复杂信号,或者在生物医学成像中获取的多模态数据。这些数据常常具有高维性和复杂性,直接分析往往难

0

0