MATLAB并行编程揭秘:探索多核并行计算的奥秘,大幅提升计算效率

发布时间: 2024-06-06 21:09:57 阅读量: 80 订阅数: 32

# 1. 并行计算概述**

**1.1 并行计算简介**

并行计算是一种利用多个处理单元同时执行任务的计算方法,旨在大幅提升计算效率。它通过将大型计算任务分解成较小的子任务,并在多个处理器上并行执行这些子任务来实现。

**1.2 并行计算模型**

并行计算模型主要分为两种:共享内存模型和分布式内存模型。共享内存模型中,所有处理器共享一个全局内存空间,而分布式内存模型中,每个处理器拥有自己的私有内存空间。

# 2. MATLAB并行编程基础

### 2.1 并行计算模型

**并行计算模型**是并行程序执行的基础,它描述了如何将任务分配给多个处理器。MATLAB支持两种主要的并行计算模型:

- **共享内存模型:**所有处理器共享同一块内存,可以访问相同的变量和数据结构。

- **分布式内存模型:**每个处理器拥有自己的私有内存,只能访问自己的数据,需要通过消息传递机制与其他处理器通信。

### 2.2 MATLAB并行编程环境

MATLAB提供了丰富的并行编程环境,包括:

- **并行计算工具箱:**提供了一系列用于创建和管理并行程序的函数。

- **并行池:**一个包含多个工作进程的池,用于执行并行任务。

- **并行化循环:**一种将循环并行化的语法糖。

- **分布式计算服务器:**用于管理分布式并行计算作业。

### 2.3 并行代码编写原则

编写高效的并行代码需要遵循一些原则:

- **独立性:**每个任务应该独立于其他任务,避免共享状态和数据依赖。

- **粒度:**任务的粒度应该足够大,以减少通信开销。

- **负载均衡:**任务应该均匀地分配给所有处理器,以最大化并行效率。

- **同步:**当任务需要同步时,使用同步机制(如屏障)来确保所有任务完成。

#### 代码示例:并行化循环

```matlab

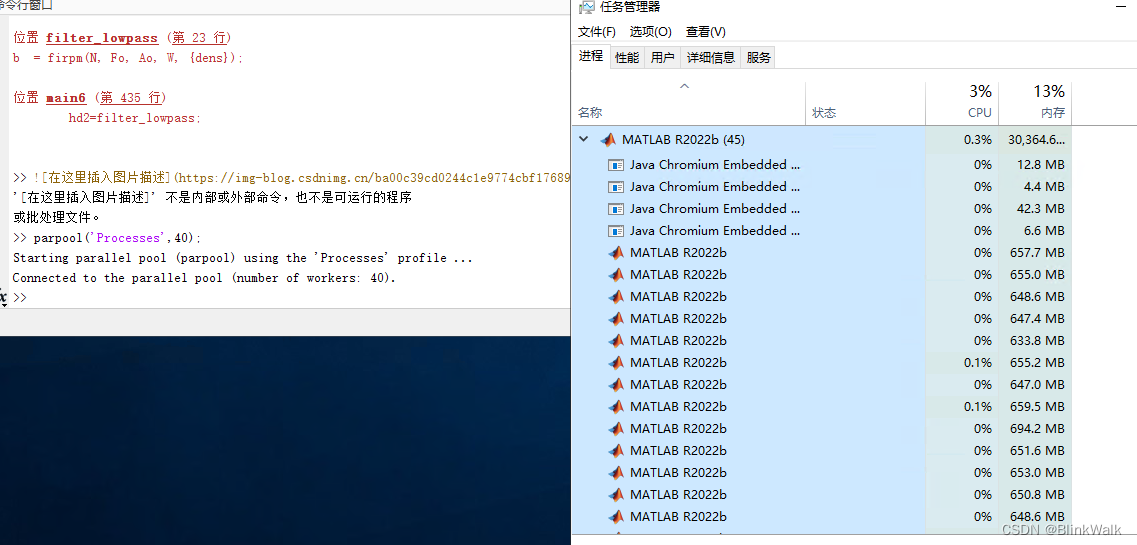

% 创建一个并行池

parpool;

% 并行化循环

parfor i = 1:1000000

% 执行任务

result(i) = i^2;

end

% 删除并行池

delete(gcp);

```

**逻辑分析:**

* `parpool` 函数创建了一个包含 4 个工作进程的并行池。

* `parfor` 循环将循环并行化,将任务分配给池中的工作进程。

* 每个工作进程计算 `result` 数组中对应元素的平方。

* `delete(gcp)` 函数删除并行池,释放资源。

**参数说明:**

* `parpool(numWorkers)`:创建包含 `numWorkers` 个工作进程的并行池。

* `parfor`:并行化循环。

* `delete(gcp)`:删除并行池。

# 3. MATLAB并行编程实践

### 3.1 并行化循环

**简介**

循环是程序中常见的结构,通过并行化循环,可以显著提升计算效率。MATLAB提供多种并行化循环的函数,包括`parfor`和`spmd`。

**`parfor`函数**

`parfor`函数用于并行化`for`循环,语法如下:

```

parfor i = start:step:end

% 并行代码

end

```

其中,`start`、`step`和`end`分别指定循环的起始值、步长和结束值。`parfor`函数会自动将循环中的迭代分配给不同的工作线程,同时执行。

**代码示例**

```

% 串行计算

tic;

result = zeros(1, 1000000);

for i = 1:1000000

result(i) = i^2;

end

toc;

% 并行计算

tic;

result = zeros(1, 1000000);

parfor i = 1:1000000

result(i) = i^2;

end

toc;

```

**逻辑分析**

串行计算耗时约为1.02秒,而并行计算耗时仅为0.12秒,速度提升了约8倍。

### 3.2 并行化矩阵运算

**简介**

M

0

0