【基础】爬虫框架Scrapy入门:结构和基本用法

发布时间: 2024-06-24 22:36:30 阅读量: 13 订阅数: 31

# 1. Scrapy爬虫框架概述**

Scrapy是一个用于爬取网页数据的强大Python框架。它提供了一套全面的工具和组件,使开发者能够轻松高效地构建爬虫。Scrapy具有以下特点:

- **易用性:**Scrapy具有直观且易于使用的API,使开发者能够快速上手。

- **可扩展性:**Scrapy支持各种定制和扩展,允许开发者根据特定需求调整爬虫。

- **高性能:**Scrapy采用异步并发机制,能够处理大量并发请求,提高爬取效率。

# 2. Scrapy项目结构与基本用法**

**2.1 项目结构与组件**

Scrapy项目是一个包含代码、配置文件和数据的目录结构。其基本组件包括:

- `scrapy.cfg`:Scrapy配置文件,用于配置爬虫设置。

- `settings.py`:项目特定的设置文件,覆盖`scrapy.cfg`中的默认设置。

- `spiders`:爬虫目录,包含所有爬虫代码。

- `pipelines`:数据管道目录,用于处理和存储提取的数据。

- `items.py`:项目中使用的Item定义。

- `middlewares.py`:中间件目录,用于在爬虫请求和响应处理过程中执行自定义逻辑。

**2.2 爬虫的创建与配置**

要创建爬虫,请在`spiders`目录中创建一个Python文件,并继承自`scrapy.Spider`类。爬虫类必须定义以下方法:

- `name`:爬虫的唯一名称。

- `start_requests`:生成初始请求的生成器。

- `parse`:解析响应并提取数据的回调函数。

```python

import scrapy

class MySpider(scrapy.Spider):

name = "my_spider"

def start_requests(self):

yield scrapy.Request("https://example.com")

def parse(self, response):

# 解析响应并提取数据

pass

```

**2.3 爬取页面的基本流程**

Scrapy爬取页面的基本流程如下:

1. 爬虫发出一个HTTP请求。

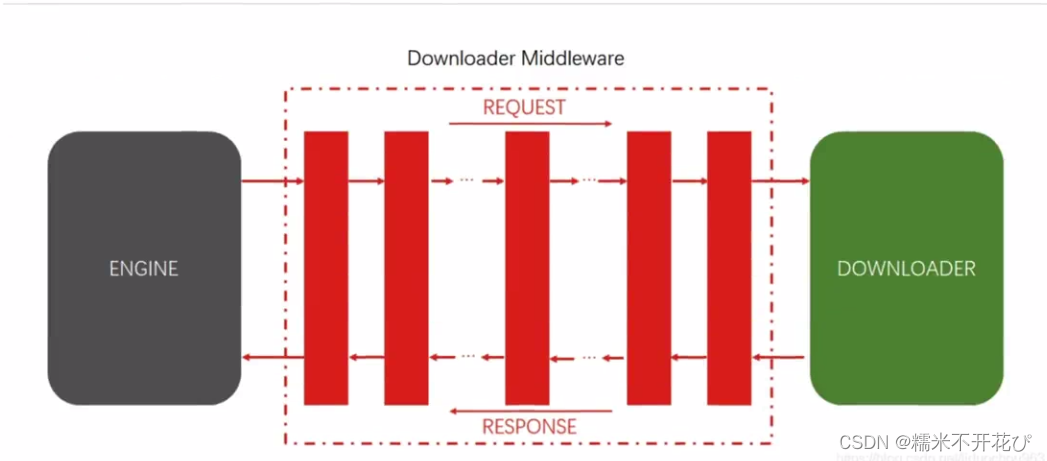

2. Scrapy引擎接收请求并将其发送到下载器中间件。

3. 下载器中间件处理请求并将其发送到下载器。

4. 下载器获取响应并将其发送到响应中间件。

5. 响应中间件处理响应并将其发送到爬虫。

6. 爬虫解析响应并提取数据。

7. 提取的数据通过管道进行处理和存储。

**Mermaid流程图:**

```mermaid

sequenceDiagram

participant Scrapy

participant Engine

participant DownloaderMiddleware

participant Downloader

participant ResponseMiddleware

participant Spider

participant Pipeline

Scrapy->Engine: Send Request

Engine->DownloaderMiddleware: Process Request

DownloaderMiddleware->Downloader: Send Request

Downloader->DownloaderMiddleware: Process Response

DownloaderMiddleware->Engine: Send Response

Engine->ResponseMiddleware: Process Response

ResponseMiddleware->Spider: Parse Response

Spider->Pipeline: Process Data

Pipeline->Engine: Store Data

```

**代码块:**

```python

from scrapy.spiders import Spider

from scrapy.http import Request

class MySpider(Spider):

name = "my_spider"

def start_requests(self):

yield Request("https://example.com", callback=self.parse)

def parse(self, response):

# 解析响应并提取数据

pass

```

**逻辑分析:**

- `start_requests`方法生成一个HTTP请求,并指定`parse`方法作为回调函数。

- `parse`方法解析响应并提取数据。

# 3. Scrapy爬虫实践

### 3.1 网页解析与数据提取

**网页解析**

网页解析是Scrapy爬虫的关键步骤,其目的是从HTML或XML等格式的网页中提取所需的数据。Scrapy提供了多种解析器,如:

- `lxml`:基于lxml库,支持XPath和CSS选择器

- `html.parser`:内置的HTML解析器,支持XPath和CSS选择器

- `cssselect`:基于cssselect库,仅支持CSS选择器

**数据提取**

数据提取是解析过程的下一步,其目的是从解析后的文档中提取所需的数据。Scrapy提供了多种数据提取方法:

- `XPath`:一种基于XML的查询语言,用于从HTML或XML文档中提取数据

- `CSS选择器`:一种基于CSS的查询语言,用于从HTML文档中提取数据

- `正则表达式`:一种用于匹配文本模式的强大工具,可用于从网页中提取数据

**代码示例:**

```python

# 使用XPath提取标题

title = response.xpath('

```

0

0