打造PyTorch高效数据流水线:加载与预处理技巧

发布时间: 2024-09-30 11:33:45 阅读量: 62 订阅数: 21

pytorch学习资料

# 1. 数据流水线在深度学习中的重要性

## 1.1 深度学习与数据流水线的关系

深度学习模型的性能高度依赖于训练数据的质量和数量。一个高效的数据流水线不仅确保了数据以正确的格式输入模型,还解决了数据过载和存储挑战,从而在不断迭代的训练过程中持续提供稳定的数据流。

## 1.2 数据流水线的组成要素

数据流水线是一个从原始数据到可用于训练数据的转换过程,包括数据采集、清洗、处理、增强、批处理等步骤。一个良好的数据流水线能够自动化地处理数据,并进行必要的转换,以适应模型的输入要求。

## 1.3 数据流水线对深度学习效率的影响

在深度学习项目中,数据准备阶段往往占据了大部分时间。一个优化良好的数据流水线可以显著减少模型的训练时间,提高模型迭代效率,并允许工程师专注于模型开发而非数据处理细节。

# 2. PyTorch基础与数据加载机制

### 2.1 PyTorch框架概述

#### 2.1.1 PyTorch的核心组件

PyTorch是一个开源的机器学习库,它为深度学习提供了一个广泛的支持平台。PyTorch的核心组件包括了张量计算、动态神经网络以及强大的GPU加速能力。这些组件共同作用,为数据科学提供了一套完整的开发工具,使得研究人员可以更加专注于模型的设计与实验,而不必过于担心底层细节。

在进行深度学习模型的开发时,我们可以使用PyTorch的张量库来构建并操作数据;利用自动求导机制来计算梯度;并通过动态神经网络结构来构建模型。在每个神经网络模块中,开发者可以灵活地定义前向传播、反向传播以及参数更新的过程。

#### 2.1.2 张量操作基础

张量在PyTorch中是基础的数据结构,可以理解为一个多维数组。在深度学习中,张量操作尤为重要,因为神经网络处理的数据,无论是输入、输出还是中间数据,都是以张量的形式存在的。

张量的操作包括了创建、索引、切片、堆叠以及形状变换等。例如,使用`torch.tensor()`可以创建一个张量,而`torch.view()`可以用来改变张量的形状。了解并掌握这些基础操作对于构建复杂的深度学习模型来说,是一个非常关键的环节。

```python

import torch

# 创建张量

a = torch.tensor([1, 2, 3])

# 张量形状变换

b = a.view(3, 1)

print(b)

```

上述代码块展示了一个创建一维张量并进行形状变换的简单例子。通过`.view()`方法,我们可以将一维张量转换成一个形状为`(3, 1)`的二维张量。在深度学习中,这样的操作经常被用于调整数据的维度,以适应不同网络层的输入要求。

### 2.2 PyTorch数据加载器

#### 2.2.1 DataLoader类的使用方法

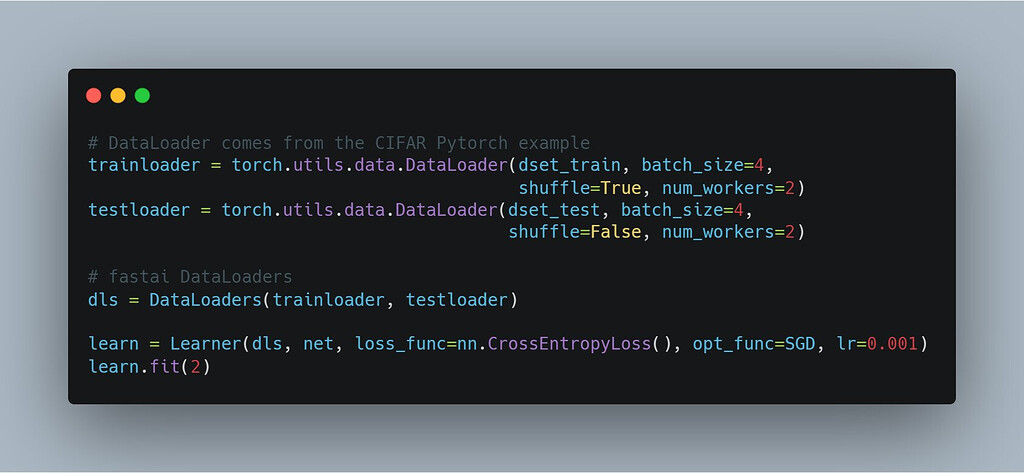

在深度学习训练过程中,数据的加载和批处理是一个重要环节。PyTorch通过`DataLoader`类提供了一种灵活的方式来批量加载数据,并可选地进行多进程加载,以提高数据加载的效率。

`DataLoader`可以封装任何可迭代的`Dataset`对象,并支持以下功能:批量、打乱、多线程加载数据。在使用时,我们可以通过`DataLoader`的构造函数来指定诸如批次大小(`batch_size`)、是否打乱数据(`shuffle`)以及并行加载数据(`num_workers`)等参数。

```python

from torch.utils.data import DataLoader

from torchvision import datasets

from torchvision.transforms import ToTensor

# 下载训练数据并应用转换操作

train_data = datasets.FashionMNIST(

root="data",

train=True,

download=True,

transform=ToTensor(),

)

# 使用DataLoader进行批量加载

data_loader = DataLoader(

dataset=train_data,

batch_size=64,

shuffle=True,

)

# 遍历DataLoader对象

for X, y in data_loader:

# 进行训练操作

...

```

在此代码块中,我们首先从`torchvision`库中下载了`FashionMNIST`数据集,并应用了转换操作以将数据转换为PyTorch张量。然后,我们创建了一个`DataLoader`实例,并通过迭代器的方式在训练过程中批量加载并处理数据。

#### 2.2.2 自定义数据集的创建与应用

为了适应复杂的数据需求,PyTorch允许开发者创建自己的自定义数据集类,继承自`Dataset`。自定义数据集需要至少实现三个方法:`__init__`、`__len__`和`__getitem__`。其中,`__init__`方法用于初始化数据集,`__len__`返回数据集的大小,而`__getitem__`根据索引返回数据集中的元素。

```python

from torch.utils.data import Dataset

import os

import pandas as pd

class CustomDataset(Dataset):

def __init__(self, csv_file, transform=None):

"""

Args:

csv_file (string): CSV 文件路径。

transform (callable, optional): 用于数据点的可选转换操作。

"""

self.data_frame = pd.read_csv(csv_file)

self.transform = transform

def __len__(self):

return len(self.data_frame)

def __getitem__(self, idx):

if torch.is_tensor(idx):

idx = idx.tolist()

img_name = os.path.join(self.data_frame.iloc[idx, 0])

image = Image.open(img_name).convert('RGB')

label = self.data_frame.iloc[idx, 1]

if self.transform:

image = self.transform(image)

return image, label

# 实例化自定义数据集

dataset = CustomDataset(csv_file='path/to/your/file.csv')

# 使用DataLoader加载数据集

data_loader = DataLoader(dataset, batch_size=4, shuffle=True)

```

在上述自定义数据集的实现中,我们定义了一个`CustomDataset`类,它从一个CSV文件读取图像路径和标签。通过`__getitem__`方法,我们可以加载单个图像,并根据需要应用转换。然后,我们可以像处理其他数据集一样使用`DataLoader`来批量加载这个自定义的数据集。

### 2.3 PyTorch数据转换器

#### 2.3.1 transforms模块介绍

在数据预处理的过程中,常常需要对数据进行一系列的转换操作,如缩放、裁剪、翻转、归一化等。PyTorch中的`transforms`模块为此提供了一系列简单易用的预定义转换操作。

`transforms`模块定义了一系列的转换操作,可被链式组合起来,以构建复杂的数据预处理流程。这些操作不仅方便易用,还可以在数据加载阶段并行处理,极大地提升了数据处理的效率。

```python

from torchvision import transforms

# 定义一系列数据转换操作

transform = ***pose([

transforms.Resize(256),

transforms.CenterCrop(224),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]),

])

# 应用转换操作

transformed_image = transform(image)

```

在此代码块中,我们首先导入了`transforms`模块,并使用`Compose`函数组合了几个常见的转换操作。通过调用这个组合操作,我们可以将一个图像进行缩放、中心裁剪、转换为张量以及进行归一化处理。

#### 2.3.2 常见的数据增强技术

数据增强是一种在不改变标签的情况下,通过对训练数据进行一系列随机变换来增加数据多样性的技术。在深度学习中,数据增强是一个重要的正则化手段,能够帮助提高模型的泛化能力。

PyTorch通过`transforms`模块提供了丰富的数据增强技术,常见的包括:随机裁剪、水平翻转、旋转、调整亮度/对比度/饱和度/色调等。通过适当的数据增强,可以在一定程度上模拟真实世界的多样性,减少过拟合的风险。

```python

# 定义数据增强操作

transform = ***pose([

transforms.RandomResizedCrop(224),

transforms.RandomHorizontalFlip(),

transforms.RandomRotation(10),

transforms.ColorJitter(brightness=0.2, contrast=0.2, saturation=0.2, hue=0.2),

])

# 应用数据增强操作

augmented_image = transform(image)

```

在上述代码块中,我们定义了一组数据增强操作,包括随机裁剪、水平翻转、旋转以及调整亮度、对比度、饱和度和色调。这些操作被组合在一起,以增强图像数据集,提供更多的训练样本变化,使模型能够学习到更加鲁棒的特征表示。

# 3. PyTorch中的数据预处理实战

在深度学习中,模型的表现很大程度上取决于数据的质量和预处理的方式。优秀的数据预处理技术能够显著提升模型训练的效率和准确性。在本章节中,我们将深入探讨如何在PyTorch框架中进行数据预处理,并通过实战案例展示具体的技巧和步骤。

## 3.1 图像数据的预处理技巧

图像数据在机器视觉任务中十分常见。为了确保模型能够正确学习,必须对图像数据进行合理的预处理。这一部分将主要关注图像归一化、标准化以及图像增强技术。

### 3.1.1 图像归一化与标准化

图像归一化和标准化是数据预处理的基础步骤,它们能帮助减少模型训练过程中的数值范围和梯度问题。

```python

import torch

import torchvision.transforms as transforms

# 定义归一化转换

normalize = transforms.Normalize(mean=[0.485, 0.456, 0.406],

std=[0.229, 0.224, 0.225])

# 将图像转换为张量并应用归一化

image_tensor = transforms.ToTensor()(image)

normalized_image = normalize(image_tensor)

```

在上述代码中,`transforms.Normalize` 用于指定每个颜色通道的均值(mean)和标准差(std),这些值是预先计算好的常用值,通常从数据集如ImageNet中得到。`transform

0

0