【性能调优必备】:MapReduce任务启动的7个最佳实践

发布时间: 2024-10-31 17:24:24 阅读量: 42 订阅数: 20

# 1. MapReduce简介与性能影响因素

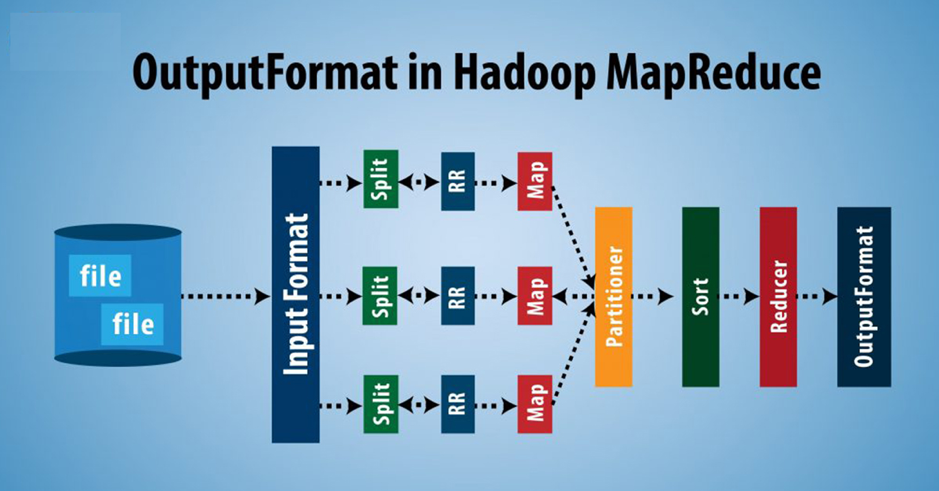

MapReduce是一种编程模型,用于处理和生成大数据集。它的核心思想是将复杂的任务分解为Map(映射)和Reduce(归约)两个处理阶段,从而简化并行处理的过程。理解MapReduce的工作原理,对于提升大数据处理性能至关重要。

## 1.1 MapReduce的基本原理

在MapReduce模型中,Map阶段负责处理输入数据,将数据转换成一系列键值对(Key-Value Pairs)。接着,这些键值对会根据键进行排序和分组,然后传递到Reduce阶段。在Reduce阶段,相同的键值对被合并在一起进行归约操作,最终得到结果。

## 1.2 性能影响因素

MapReduce的性能受到多种因素的影响,例如数据的输入输出大小、网络带宽、节点之间的通信效率以及硬件资源的配置等。为了优化MapReduce任务,需要考虑数据的划分(Partitioning)、排序(Sorting)和合并(Merging)等多个层面,确保系统资源得到最合理的利用。

MapReduce的性能调优涉及到算法优化、系统配置调整以及代码级别的改进。接下来的章节会详细介绍如何从这些方面入手,针对性地进行任务调优。

# 2. MapReduce任务调优的理论基础

## 2.1 理解MapReduce的处理模型

### 2.1.1 Map阶段的工作原理

MapReduce框架的核心在于其处理模型,这个模型主要分为Map阶段和Reduce阶段。在Map阶段,框架将输入数据拆分成独立的块,并并行处理。每个Map任务的输入通常是一个HDFS文件块。Map函数处理输入的数据,并输出一系列的中间键值对。

```java

// 示例:自定义Map函数

public static class MyMapClass extends Mapper<LongWritable, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

String[] words = value.toString().split("\\s+");

for (String str : words) {

word.set(str);

context.write(word, one);

}

}

}

```

在这段代码中,Mapper类继承自`Mapper`,它的输入键值对类型为`LongWritable`和`Text`,输出键值对类型为`Text`和`IntWritable`。Map函数接收原始文本数据,以空格分割字符串,对每个单词输出一个计数为1的键值对。

### 2.1.2 Reduce阶段的工作原理

Map阶段之后,MapReduce框架进行Shuffle和排序,将所有相同键的数据传递给同一个Reduce任务。Reduce函数随后对这些键值对进行合并处理。

```java

// 示例:自定义Reduce函数

public static class MyReduceClass extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

```

在这段代码中,Reducer类继承自`Reducer`,它的输入键值对类型与Map函数的输出类型相匹配。Reduce函数遍历具有相同键的值的列表,对它们进行累加求和,并输出最终结果。

### 2.1.3 Shuffle过程的优化

Shuffle过程是MapReduce性能的关键。通过合理设置分区(partition)和排序(sort),可以减少网络传输的数据量。此外,如果Map阶段产生的中间数据过大,可以通过增加Reducer数量来减少Shuffle的负载。

```java

// 示例:自定义分区器

public static class MyPartitioner extends Partitioner<Text, IntWritable> {

@Override

public int getPartition(Text key, IntWritable value, int numPartitions) {

// 自定义分区逻辑

return key.hashCode() % numPartitions;

}

}

```

自定义分区器可以保证相同的键总是被发送到同一个Reducer,有助于优化Shuffle过程中的数据传输效率。

## 2.2 影响MapReduce性能的关键因素

### 2.2.1 数据倾斜的识别与解决

数据倾斜是导致MapReduce任务性能下降的常见问题之一。当大量数据集中在某一个或几个Reduce任务中处理时,就会出现数据倾斜。

解决数据倾斜的策略包括:

- 增加Map和Reduce的数量,以分散处理负载。

- 在Map函数中预先进行数据聚合。

- 重新设计键值对,避免数据倾斜。

### 2.2.2 资源调度对性能的影响

资源调度器(如YARN)负责分配集群资源给MapReduce作业。如果资源调度不合理,会导致某些作业运行缓慢或延迟。

YARN通过资源请求(如内存和CPU)来调度作业。合理配置资源请求,使得每个任务都能获得最佳的执行环境,从而提高整体性能。

### 2.2.3 Map和Reduce任务的合理配置

Map和Reduce任务的配置对性能有直接的影响。例如,Map和Reduce的数量需要根据输入数据量和集群资源进行合理设置。

```xml

<!-- 配置文件示例:mapred-site.xml -->

<configuration>

<property>

<name>mapreduce.job.maps</name>

<value>10</value>

</property>

<property>

<name>mapreduce.job.reduces</name>

<value>5</value>

</property>

</configuration>

```

在该配置文件中,可以设置Map和Reduce任务的数量。根据任务的实际需求,这些参数需要适当调整。

以上内容详细介绍了MapReduce处理模型的核心部分,并且阐述了影响MapReduce性能的关键因素,为后续章节关于优化和实践技巧提供了理论基础。在下一章节中,我们将进一步探索MapReduce任务的优化技巧,以及如何在实践中提升性能。

# 3. 优化MapReduce任务的实践技巧

随着大数据处理需求的不断增长,优化MapReduce任务以提升性能已成为数据工程师和开发者的一项重要技能。本章将深入探讨MapReduce任务设计、代码层面的性能调优以及如何利用Hadoop生态系统中的高级特性和工具来提升整体性能。

## 3.1 任务设计的最佳实践

### 3.1.1 键值对设计优化

键值对是MapReduce处理的基础,因此,优化键值对设计对于提升性能至关重要。有效的键值对设计可以减少数据倾斜,平衡Map和Reduce任务的工作负载。

**代码块示例:**

```java

// 优化前的键值对设计

public static class MyMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

// 处理文本数据,提取单词作为key

String[] words = value.toString().split("\\s+");

for (String str : words) {

word.set(str);

context.write(word, one);

}

}

}

// 优化后的键值对设计

public static class MyMapper extends Mapper<LongWritable, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException {

// 使用更优的分词策略,减少不必要的数据传输

List<String> optimizedWords = optimizeWordSplit(value.toString());

for (String str : optimizedWords) {

word.set(str);

context.write(word, one);

}

}

private List<String> optimizeWordSplit(String text) {

// 实现分词优化逻辑

return null;

}

}

```

**逻辑分析与参数说明:**

在优化前的代码中,简单的空格分词可能会导致数据倾斜,因为某些单词可能频繁出现,导致Map任务的负载不均。优化后的设计中,通过实现一个更优的分词策略,比如根据实际数据分布情况,对高频词进行预处理,将它们分散到不同的Reduce任务中。这种方法有助于平衡负载,提高整体MapReduce作业的并行效率。

### 3.1.2 分区函数的优化策略

分区函数决定了Map输出的键值对如何分配给不同的Reduce任务。合理设计分区函数是确保负载均衡和任务高效执行的关键。

**表格展示:**

| 分区函数类型 | 描述 | 适用场景 |

|--------------|------|----------|

| 默认分区函数 | 根据key的哈希值进行分区 | 数据均匀分布时 |

| 自定义分区函数 | 根据特定逻辑(如前缀、范围等)进行分区 | 数据不均匀分布时 |

| 多级分区函数 | 组合多个分区逻辑,提升灵活性 | 复杂数据处理场景 |

自定义分区函数能够在数据倾斜时发挥作用,例如,如果一个特定范围的key特别大,可以通过修改分区函数,将这个范围的key分散到多个Reduce任务中,从而提高整体处理速度。

## 3.2 代码层面的性能调优

### 3.2.1 Map和Reduce函数的编写技巧

Map和Reduce函数的编写直接影响到作业的性能。合理利用Map和Reduce函数中的技巧,可以显著减少资源消耗和提升效率。

**mermaid格式流程图展示:**

```mermaid

graph LR

A[开始Map任务] --> B[读取输入]

B --> C[Map函数处理]

C --> D[输出中间键值对]

D --> E[Shuffle过程]

E --> F[Reduce函数处理]

F --> G[输出最终结果]

```

在Map函数中,减少不必要的数据处理可以减少资源消耗。比如,只对需要的数据进行迭代,避免读取和处理无关数据。在Reduce函数中,合理排序和合并键值对可以减少不必要的内存使用和I/O操作。

### 3.2.2 自定义输入输出格式

Hadoop框架提供了一套标准的输入输出格式,但自定义格式可以根据特定需求大幅提升性能。

**代码块示例:**

```java

public class MyInputFormat extends FileInputFormat<LongWritable, Text> {

@Override

public RecordReader<LongWritable, Text> createRecordReader(InputSplit split, TaskAttemptContext context) throws IOException, InterruptedException {

return new MyRecordReader();

}

}

public class MyRecordReader extends RecordReader<LongWritable, Text> {

// 实现自定义读取逻辑

}

```

自定义输入格式可以优化数据的读取效率,比如对于特定格式的压缩文件,可以编写高效的解压缩逻辑,减少内存消耗。自定义输出格式可以优化数据的写入效率,例如,通过合并多个记录为一个输出块,减少文件的I/O次数。

### 3.2.3 合理使用Combiner

Combiner是在Map和Reduce之间执行的一个可选操作,它可以减少数据在网络中的传输量,提升MapReduce作业的性能。

**逻辑分析:**

Combiner的使用需要谨慎,因为它实际上是一个局部的Reduce操作。它适用于那些对数据合并操作具有交换律和结合律的场景。例如,在进行词频统计时,可以使用Combiner对每个Map任务的输出进行局部合并,然后才将合并后的数据发送给Reduce任务。

## 3.3 高级特性与工具的应用

### 3.3.1 计数器的使用

在MapReduce编程中,Hadoop提供了一个计数器功能,用于追踪处理过程中的各种统计信息。这些信息对于定位问题和优化性能非常有帮助。

**代码块示例:**

```java

Configuration conf = getConf();

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.getCounters().group("application").findCounter(Counter1).increment(1);

```

在上述代码中,通过获取计数器组并增加特定计数器的值,可以帮助跟踪和统计MapReduce作业中各个阶段的性能情况。

### 3.3.2 MapReduce与Hadoop生态工具结合

除了基础的MapReduce编程模型外,与Hadoop生态系统中的其他工具相结合,可以进一步提升数据处理的效率和能力。

**列表展示:**

- **Hive**:可以将复杂的MapReduce任务转换成类SQL查询。

- **Pig**:提供了一种高级数据流语言(Pig Latin),用于处理复杂的数据转换。

- **Oozie**:工作流调度器,用于管理多个Hadoop作业的执行。

- **Zookeeper**:协调分布式应用。

通过这些工具的集成应用,可以简化数据处理流程,并且提高资源的利用率和任务的执行效率。

在下一章节中,我们将深入探讨如何监控和分析MapReduce作业的性能,并通过实际案例来展示性能调优的应用。

# 4. MapReduce性能监控与分析

## 4.1 性能监控工具的介绍与使用

### 4.1.1 Hadoop自带监控工具

Hadoop生态系统自带了一些用于监控性能的工具,这些工具对于诊断和优化MapReduce作业至关重要。主要的监控工具有以下几个:

- **JMX(Java Management Extensions)**:JMX是一种为Java应用程序提供管理监控的标准方式。在Hadoop集群中,每个节点上的JVM(Java虚拟机)都可以通过JMX暴露性能指标。可以通过JMX客户端(如JConsole、VisualVM)连接到集群中不同的节点,来监控内存使用情况、线程状态、GC情况等。

- **Ganglia**:Ganglia是一个分布式监控系统,用于高性能计算系统,如集群和网格。它能够收集、监控和显示集群中每个节点的CPU、内存、磁盘使用情况及网络流量等性能数据。

- **Ambari**:Ambari是一个基于Web界面的集群管理工具,可用于安装、配置和监控Hadoop集群。它简化了集群运维的任务,并且可以通过图形化界面查看实时的性能指标和历史数据。

- **Web UI**:Hadoop各个组件如JobTracker、NameNode、ResourceManager等都提供了Web UI,它们能够以图形化的方式展示集群的资源使用情况、作业进度、队列状态等信息。

在使用这些工具时,建议根据需要查看的指标和具体的使用场景来选择合适的工具进行监控。

### 4.1.2 第三方性能监控平台

除了Hadoop自带的监控工具外,还有一些第三方平台能够提供更加全面的监控解决方案。例如:

- **Datadog**:Datadog是一个云监控平台,它提供了对Hadoop集群的全面监控,可以集成日志管理、APM(应用性能管理)、基础设施监控等。

- **New Relic**:New Relic的APM产品线提供实时的应用性能监控,可以监控运行在Hadoop集群上的应用程序性能。

- **Prometheus + Grafana**:Prometheus是一个开源的监控解决方案,Grafana则是一个开源的分析和可视化平台。通过这两个工具组合,可以搭建一套强大的监控体系,对Hadoop集群进行性能分析。

使用第三方监控平台时,可以将平台进行定制化配置,从而更好地适应自己的业务需求,并且获得比原生工具更深入的见解。

## 4.2 性能分析的实践操作

### 4.2.1 日志分析技巧

日志分析是性能分析中不可或缺的一环。在MapReduce中,可以通过分析JobHistoryServer中存储的作业历史记录来获得性能数据。以下是一些日志分析的技巧:

- **日志级别配置**:根据需要调试的详细程度,适当地调整MapReduce任务的日志级别。过低的日志级别可能无法提供足够的信息,而过高的日志级别又可能导致日志文件迅速膨胀。

- **日志关键字搜索**:利用grep、awk等命令工具,通过关键字快速定位到感兴趣的日志条目。例如,查找"SlowRecordReader"可以找到记录读取缓慢的问题。

- **日志时间戳对比**:将作业的各个阶段的时间戳进行对比,识别出潜在的瓶颈。例如,如果Map阶段耗时非常长,可能意味着输入数据分割不合理或者节点资源不足。

### 4.2.2 识别性能瓶颈

识别性能瓶颈是性能分析的核心任务。识别瓶颈可以从以下几个方面进行:

- **CPU密集型作业**:如果CPU使用率长时间处于高负载状态,可能表明作业是CPU密集型。可以通过分析CPU时间与实际执行时间的关系来确定。

- **I/O密集型作业**:频繁的磁盘读写操作可能导致I/O成为瓶颈。监控磁盘I/O指标,并结合读写量的大小,可以找到I/O密集型作业。

- **网络密集型作业**:数据在节点间传输的作业可能受到网络带宽的限制。网络监控工具可以帮助发现网络瓶颈。

### 4.2.3 常见性能问题案例分析

案例分析有助于理解性能问题的产生和解决过程。以下是一个简化的案例:

假设在MapReduce作业监控时发现整个作业的完成时间远超预期。通过以下步骤进行问题定位:

1. **日志审查**:查看作业的历史记录和详细日志,确认是否有错误信息或警告。

2. **性能指标检查**:使用监控工具,比如Ambari的Hadoop服务仪表盘,查看集群的资源使用情况,注意是否有资源异常。

3. **阶段耗时分析**:对比Map和Reduce阶段的耗时,如果其中一个阶段远超另一个,则可能是该阶段的性能瓶颈。

4. **数据倾斜诊断**:如果发现某个Reduce任务处理的数据远多于其他任务,可能是数据倾斜问题。

5. **资源利用率分析**:通过Ganglia等监控工具的资源利用率分析,确认瓶颈是CPU、内存、磁盘还是网络。

6. **解决方案实施**:针对诊断出的问题,制定相应的优化策略,如合理配置Map和Reduce任务的个数、优化Map和Reduce函数代码、调整数据的分布策略等。

通过这一系列的操作,可以有效地对性能问题进行诊断和优化。

# 5. MapReduce故障诊断与调试

MapReduce作为一种成熟的分布式处理框架,其运行过程可能受到多种因素的影响,从而导致任务执行失败。本章节将对MapReduce常见的故障类型、原因进行分析,并提供故障诊断的方法与技巧。

## 5.1 常见故障类型与原因分析

### 5.1.1 作业失败的常见原因

MapReduce作业可能因为各种原因失败,最常见的包括数据问题、程序错误、资源分配不当等。

#### 数据问题

- 输入数据格式错误或不一致导致解析失败。

- 某些Map任务处理的数据量过大,导致内存溢出。

- 配置不当,例如记录分隔符(`dfs走入式配置`)未正确设置。

代码块示例:

```java

// 示例代码:检查输入数据格式是否符合预期

public class DataChecker {

public boolean validateFormat(String data) {

// 这里应该包含实际的数据格式验证逻辑

return true;

}

}

```

#### 程序错误

- 用户编写的Map或Reduce函数中存在逻辑错误。

- 自定义的Partitioner或Comparator函数执行出错。

- 外部服务依赖的问题,如HBase、Hive等。

代码块示例:

```java

// 示例代码:Map函数的实现

public static class TokenizerMapper extends Mapper<Object, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context) throws IOException, InterruptedException {

// 处理逻辑出错会导致作业失败

}

}

```

#### 资源分配不当

- 配置的Map和Reduce任务数过多或过少,导致资源浪费或任务拥堵。

- 系统资源分配不足,如CPU、内存、磁盘等资源不足。

### 5.1.2 网络和硬件故障的影响

- 网络不稳定导致节点间通信失败。

- 硬件故障,如磁盘损坏,导致数据丢失。

- 不均匀的数据分布导致某些节点负载过高。

## 5.2 故障诊断的方法与技巧

### 5.2.1 调试工具的使用

Hadoop提供了一系列工具用于故障诊断,其中`jstack`、`jmap`和`jvisualvm`是常用的Java诊断工具。

#### 示例使用

```sh

# 使用jstack获取Java进程的堆栈信息

jstack <pid>

```

执行逻辑说明:`jstack`命令能够展示Java进程的线程堆栈信息,帮助定位线程阻塞、死锁等问题。

#### 参数说明

- `<pid>`: Java进程的标识符,可以通过`jps`命令查看。

### 5.2.2 日志跟踪与分析方法

MapReduce的日志文件记录了大量的运行时信息,合理分析日志是故障诊断的关键。

#### 日志内容示例

```log

INFO [main] org.apache.hadoop.mapred.JobClient: Running job: job_***_0001

INFO [main] org.apache.hadoop.mapred.JobClient: map 0% reduce 0%

INFO [main] org.apache.hadoop.mapred.JobClient: map 100% reduce 0%

ERROR [main] org.apache.hadoop.mapred.JobClient: Task Id : attempt_***_0001_m_000000_0, Status : FAILED

ERROR [main] org.apache.hadoop.mapred.JobClient: Error during job, obtaining diagnostics...

```

### 表格展示:日志文件中常见的错误信息

| 错误代码 | 错误描述 | 解决方案 |

| --- | --- | --- |

| ERROR | Task Id : attempt_xxx_m_xxxx_x_0, Status : FAILED | 检查任务日志,了解失败原因 |

| WARN | Too many fetch-failures | 增加Map任务尝试次数或检查网络设置 |

| INFO | Running job | 正常运行信息,表示作业正在执行 |

通过分析日志中的错误代码和描述,配合上述表格中的解决方案,可以有效地诊断和解决问题。日志文件中的ERROR和WARN级别的信息尤其值得注意,因为它们通常会指向问题的根源。

故障诊断是一个复杂的过程,涉及到对系统运行环境的深入了解。通过本章节的介绍,我们希望为读者提供一个MapReduce故障诊断的参考框架,使得在遇到具体问题时可以快速定位并找到解决方案。

# 6. MapReduce案例分析与应用扩展

## 6.1 典型案例的性能调优分析

### 6.1.1 大数据集处理的性能优化

在处理大数据集时,MapReduce的性能调优至关重要。以下是一个实际案例,展示了如何对大数据集处理进行性能优化。

假设有一个大数据集分析任务,数据量达到TB级别。初始运行时,MapReduce作业耗时极长,且集群资源利用率低下。为了解决这个问题,我们首先通过Hadoop自带的监控工具,对作业运行时的资源使用情况进行详细监控。

```bash

hadoop job -counter <job-id>

```

通过监控结果,我们发现大量时间被Map任务消耗,同时存在明显的数据倾斜问题。以下是采取的优化步骤:

1. **预处理数据**:对输入数据进行分区处理,确保数据均衡分配。

2. **调整Map和Reduce任务数量**:增加Map和Reduce任务的数量,减少每个任务处理的数据量,避免单个任务耗时过长。

3. **优化Shuffle过程**:通过自定义分区函数,优化Shuffle过程中的数据传输效率。

```java

// 自定义分区函数示例

public class CustomPartitioner extends Partitioner<Text, IntWritable> {

@Override

public int getPartition(Text key, IntWritable value, int numPartitions) {

// 自定义分区逻辑

}

}

```

4. **使用Combiner**:在Map阶段使用Combiner局部合并,减少数据传输量。

### 6.1.2 实时数据处理的MapReduce应用

MapReduce虽以批处理见长,但其实时数据处理场景下也有应用潜力。在流式处理中,MapReduce可以应用在对实时数据的周期性统计分析上。

考虑一个实时数据监控系统,需要对来自多个传感器的实时数据进行汇总分析。为了实现这一需求,可以使用如Apache Storm或Apache Flink这样的流处理框架,但通过优化MapReduce的执行计划,同样可以实现近实时处理。

```java

// MapReduce实时处理优化关键点

- 增加内存缓存的使用,减少磁盘I/O操作。

- 通过调整任务调度策略,优先处理紧急任务。

- 使用更频繁的合并操作,以减少Map和Reduce阶段之间的数据传输。

```

## 6.2 MapReduce应用的未来趋势

### 6.2.1 与其他大数据技术的集成

随着大数据技术的不断发展,MapReduce也在与其他技术进行集成,以便于提供更丰富的大数据处理能力。

例如,Apache Hive为MapReduce提供了一个数据仓库基础架构,允许用户使用类似SQL的查询语言(HiveQL)来执行数据查询和分析,同时在后台通过MapReduce进行计算。

### 6.2.2 新兴技术在MapReduce中的应用展望

新兴技术如Apache Spark提供了更为先进的数据处理框架,但MapReduce作为一种成熟的技术,其在大数据处理中的应用仍然十分广泛。

未来,随着对资源效率和处理速度需求的增长,MapReduce可能会集成更多的内存计算技术,以提高处理速度。例如,结合使用Hadoop YARN与Apache Tez,能够更好地优化MapReduce任务的执行计划和资源分配。

```xml

<!-- Tez的配置示例 -->

<configuration>

<property>

<name>tez.lib.uris</name>

<value>hdfs://namenode:8020/user/tez/lib</value>

</property>

<property>

<name>tez.useoefficient Shuffle</name>

<value>true</value>

</property>

</configuration>

```

通过这些技术的融合应用,MapReduce可以在保留其稳定性的同时,进一步提升其性能和效率,以应对日益增长的大数据处理需求。

0

0