【DataNode高可用揭秘】:Hadoop 3.x的故障转移机制详解

发布时间: 2024-10-27 21:40:12 阅读量: 108 订阅数: 48

大数据学习笔记:Hadoop 2.x的版本架构模型介绍

# 1. Hadoop 3.x中的DataNode角色概述

## 1.1 DataNode在Hadoop中的作用

DataNode是Hadoop分布式文件系统(HDFS)的关键组件,负责存储实际的数据块。每一个Hadoop集群都会拥有一个或多个NameNode来管理文件系统的命名空间,而DataNode则分布在集群中的各个节点上,用于存储和检索用户数据。Hadoop的容错性和高可用性在很大程度上依赖于DataNode的设计和实现。

## 1.2 DataNode的基本工作原理

DataNode的工作原理是基于其对数据块的操作。数据被分成块存储在DataNode上,每个块默认大小是128MB,存储在本地文件系统中。DataNode负责处理来自客户端的数据读写请求,保证数据的持久化存储,并且定期向NameNode发送心跳信号,表明自己状态正常。如果DataNode失败或无法发送心跳,其数据块将不再被集群使用,直至故障恢复或数据块被重新复制到其他DataNode。

## 1.3 DataNode的优化策略

随着大数据量和实时处理需求的增加,DataNode的优化变得尤为重要。优化策略包括但不限于调整数据块大小、使用RAID和SSD等硬件技术提升性能、优化DataNode的内存使用和垃圾收集策略,以及调整网络和磁盘I/O的配置。这些优化手段旨在提升数据处理的速度、可靠性和容错能力,从而为用户提供更加高效和稳定的服务。

```mermaid

flowchart LR

A[客户端] -->|读/写请求| B[DataNode]

B -->|数据块| C[磁盘]

B -->|心跳信号| D[NameNode]

D -->|指令/反馈| B

```

在上述流程中,DataNode通过心跳信号与NameNode通信,告知自己的健康状况,同时响应客户端的读写请求。优化DataNode的性能,可以进一步提升整个Hadoop集群的数据处理能力和稳定性。

# 2. 故障转移机制理论基础

### 2.1 Hadoop高可用性的核心组件

在大数据的生态系统中,Hadoop是处理海量数据的关键技术之一,其核心组件的高可用性对保障数据服务的稳定性和可靠性至关重要。要理解故障转移机制,首先需要熟悉Hadoop高可用性的关键组件。

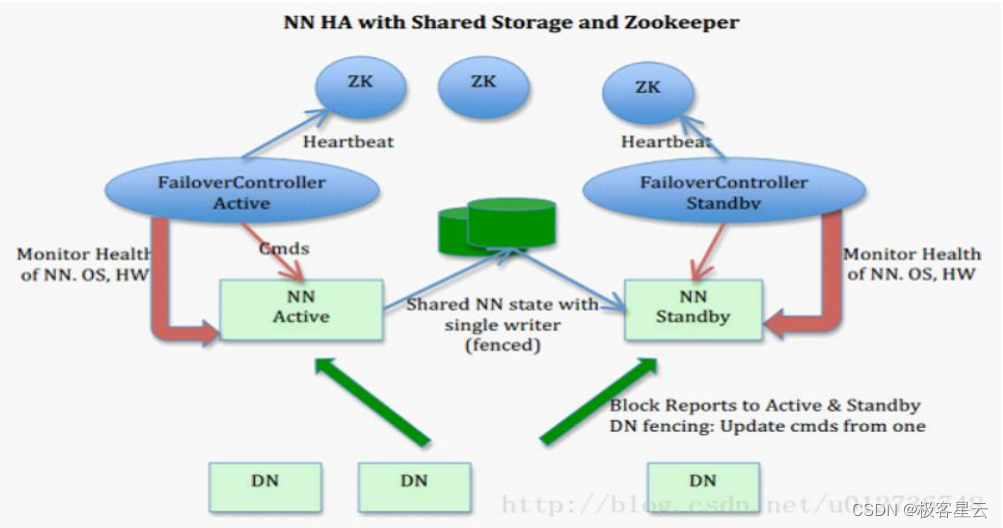

#### 2.1.1 NameNode的高可用配置

NameNode在Hadoop分布式文件系统(HDFS)中承担着管理命名空间和客户端访问权限的主要职责。它还负责存储文件系统元数据,并对数据块进行调度。NameNode的高可用配置是通过启用第二个NameNode,通常被称为Standby NameNode,来实现的。当Active NameNode发生故障时,Standby NameNode能够无缝接管工作,保证数据服务的连续性。

在配置高可用的NameNode时,需要设置一个共享存储系统(如QJM - Quorum Journal Manager)来同步两个NameNode的状态,确保数据的一致性。另外,还需要配置ZooKeeper来处理故障转移期间的协同工作和状态管理。

#### 2.1.2 ZooKeeper的角色与工作原理

ZooKeeper是一个分布式协调服务,它提供了一个简单的接口来维护配置信息、命名、提供分布式同步和提供组服务。在Hadoop中,ZooKeeper主要用于维护集群的状态信息和协调NameNode之间的故障转移。

ZooKeeper通过一种称为Zab协议的协议来实现一致性,确保集群中的节点能够对系统状态达成一致。在故障转移的场景中,ZooKeeper负责选举活动NameNode的领导权,并确保所有的更改能够反映到Standby NameNode上。

### 2.2 DataNode故障转移机制的原理

DataNode是HDFS的另一个核心组件,负责存储实际的数据块并执行数据读写操作。DataNode的故障转移机制相对简单,但是对系统的稳定运行同样重要。

#### 2.2.1 故障检测机制

DataNode的故障检测机制通常依赖于Hadoop内部的心跳信号。每个DataNode会定期向NameNode发送心跳信号,表明它仍然在线和可用。如果在预设的超时时间内没有收到心跳信号,NameNode就会认为DataNode已经失效。

#### 2.2.2 数据副本与一致性保障

为了保障数据的高可用性,HDFS采用了数据副本策略。默认情况下,每个数据块会有三个副本分别存储在不同的DataNode上。故障转移发生时,系统会自动启动副本复制操作,将失效DataNode上的数据块复制到其他健康的节点上。

#### 2.2.3 故障恢复流程详解

故障恢复流程开始于故障检测之后。NameNode识别出失效的DataNode后,会将该节点上的数据块标记为不可用,并启动恢复过程。系统会从其他副本中选择合适的DataNode,开始数据块的复制工作,直到所有数据块都恢复到应有的副本数为止。

### 2.3 高可用集群的网络通信

高可用集群的网络通信是实现故障转移的基础设施,包括数据传输协议和网络心跳机制。

#### 2.3.1 数据传输协议

Hadoop使用RPC(Remote Procedure Call)作为内部通信协议。通过RPC,DataNode与NameNode之间、以及NameNode之间可以进行高效的交互和数据传输。

#### 2.3.2 网络心跳机制与超时处理

心跳机制是Hadoop集群中节点状态检测的重要组成部分。节点间会定期发送心跳信号来证明它们的在线状态。如果某个节点未能在指定时间内发送心跳,集群会认为该节点已经宕机,并启动相应的故障转移流程。

```mermaid

graph LR

A[NameNode] -->|心跳信号| B[DataNode]

B -->|心跳信号| A

A -->|故障检测| C[故障节点]

C -->|数据复制| D[健康DataNode]

```

上图展示了NameNode和DataNode之间的网络心跳机制以及故障节点的处理流程。

在下一章中,我们将探讨故障转移机制的实践操作,包括如何配置环境、进行监控与日志分析以及手动干预故障转移的详细步骤。

# 3. 故障转移机制的实践操作

故障转移机制的实践操作是确保Hadoop集群高可用性的核心环节。在本章节中,我们将详细探讨如何配置DataNode故障转移环境,监控集群状态,并在必要时进行手动干预以保证数据安全和系统的稳定运行。故障转移的实践操作涉及到多个层面,包括配置文件的解析、启动故障转移测试、监控指标的分析、日志的定位、以及故障模拟与手动触发操作。

## 3.1 配置DataNode故障转移环境

### 3.1.1 环境准备与配置文件解析

在开始故障转移环境配置之前,需要确保有一个运行中的Hadoop集群,并且HDFS已经处于正常工作状态。我们将重点讲解DataNode故障转移的相关配置,这些配置通常位于Hadoop的配置文件`hdfs-site.xml`中。

```xml

<configuration>

<property>

<name>dfs.ha.fencing.methods</name>

<value>sshfence</value>

</property>

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>/path/to/ssh-private-key</value>

</property>

...

</configuration>

```

在上述配置中,`dfs.ha.fencing.methods`属性定义了故障转移时使用的隔离方法。`sshfence`是一种常用的隔离方法,它通过SSH来停止故障节点上的DataNode服务。`dfs.ha.fencing.ssh.private-key-files`属性指定了用于SSH连接的私钥文件路径,确保了无密码SSH访问的实现。

### 3.1.2 启动故障转移测试

配置完成后,接下来是启动故障转移测试的步骤。首先需要确保集群的NameNode处于高可用模式。其次,可以通过关闭一个DataNode服务来模拟故障,观察集群如何进行故障检测和转移操作。

```bash

# 停止故障DataNode服务

hdfs --daemon stop datanode

# 查看集群状态

hdfs haadmin -getServiceState <DataNodeName>

```

在执行停止操作后,集群管理工具会自动检测到DataNode的异常状态,并启动故障转移流程

0

0