【模型优化专家指南】:深入揭秘过拟合陷阱及其解决方案

发布时间: 2024-09-02 16:46:49 阅读量: 50 订阅数: 33

过拟合欠拟合及其解决方案

# 1. 机器学习中的过拟合现象

在机器学习的世界里,模型学习数据的过程就像是一场精心编排的舞蹈。然而,当舞者对舞台过于熟悉,以至于每个步伐都与舞台的某一处特定细节相匹配时,他们便失去了跳出新舞步的能力。这种现象在机器学习领域被称为“过拟合”。过拟合是模型在训练数据上表现优异,却无法有效泛化到未见数据上的现象。它是一种隐性的错误,源于模型对训练集的噪声和异常值过度敏感,从而影响了模型的泛化能力。

在接下来的章节中,我们将深入探讨过拟合的理论基础、识别方法,以及一系列预防和缓解过拟合的技术,最终聚焦于如何在实际应用中解决过拟合问题。通过对过拟合现象的深入理解与防治,我们可以提升机器学习模型的预测性能,使其在面对未知数据时能够保持稳定的表现。

# 2. 过拟合的理论基础与识别

### 2.1 过拟合的定义与产生原因

#### 2.1.1 过拟合的概念和特征

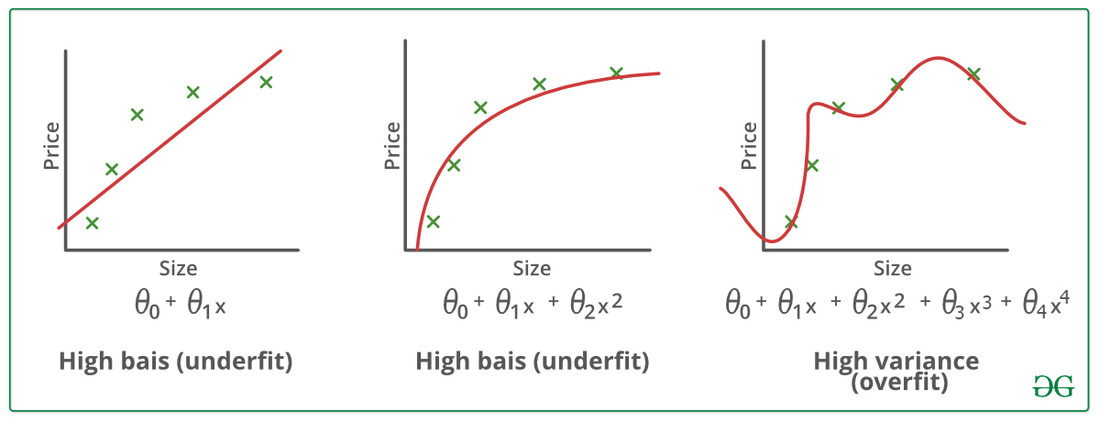

过拟合(Overfitting)是机器学习中的一个常见问题,特别是在监督学习中。在模型训练过程中,如果模型过于复杂,或者训练数据不足以代表整个数据分布,模型可能会学习到训练数据中的噪声和异常,而不仅仅是潜在的数据分布。这导致模型在训练集上表现很好,但在未见过的新数据上表现很差。

特征上,过拟合的模型可能有以下几个特点:

- 在训练集上具有极高的准确度,而对验证集或测试集的准确度显著下降。

- 学习的规则过于复杂,包含大量的参数或者特征,以至于难以理解。

- 模型对训练数据中的小波动或者随机误差也进行了学习。

#### 2.1.2 过拟合产生的数学基础

过拟合的产生可以从数学角度解释为模型对于目标函数的学习超过了真实函数的复杂度。假设有一个数据集由输入\(X\)和输出\(Y\)组成,我们希望找到一个函数\(f\)来拟合输入输出之间的关系。理想情况下,我们希望找到的是真实的数据生成分布\(P(X,Y)\)的近似。

若令\(L(f;X,Y)\)为损失函数,代表了模型\(f\)在训练集上的表现,则在没有正则化的情况下,模型倾向于最小化损失函数,可能会学习到每一个训练样本的特殊性,而不仅仅是一个泛化的模式。从数学上讲,如果模型的容量(capacity)足够大,它可以做到在训练集上的损失趋近于零,但这通常是以牺牲模型在新数据上的泛化能力为代价的。

### 2.2 过拟合的识别方法

#### 2.2.1 训练数据与验证数据的评估

识别过拟合最直接的方法是通过比较模型在训练集和验证集上的性能。这里涉及到模型的性能评估指标,比如准确度、精确度、召回率、F1分数和ROC曲线下面积(AUC)等。通常情况下,如果一个模型在训练集上的性能与在验证集上的性能差异较大(特别是训练集性能显著优于验证集性能),那么过拟合的可能性就很大。

为了使评估结果更具有一致性,我们通常会对训练集进行多次划分,采用如交叉验证(cross-validation)的方式对模型进行综合评估。

#### 2.2.2 过拟合的可视化诊断

可视化是另一种识别过拟合的有效方法。在机器学习中,绘制学习曲线(learning curve)是最常见的可视化诊断方式之一。学习曲线是将训练损失和验证损失作为训练样本数量的函数进行绘制,通过观察损失的变化趋势来判断模型是否过拟合。

如果学习曲线显示出模型在验证集上的损失一直很高,而训练集上的损失则迅速下降,这可能表明模型正在过拟合。为了得到更明确的结论,我们还需要观察学习曲线是否趋于平稳,如果趋于平稳,则表示模型已经充分学习了训练数据,再进一步的训练不会带来额外的改进。

### 代码块示例

下面的代码块演示了如何用Python中的matplotlib库来绘制一个学习曲线。

```python

import numpy as np

import matplotlib.pyplot as plt

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_squared_error

from sklearn.linear_model import LinearRegression

from sklearn.preprocessing import PolynomialFeatures

from sklearn.pipeline import Pipeline

# 创建一个生成数据的函数

def generate_data(n_samples=100):

X = np.sort(np.random.rand(n_samples))

y = np.sin((17.0 * X * (1.0 - X)) + np.random.randn(n_samples) * 0.1)

return X, y

# 拟合模型并绘制学习曲线

def plot_learning_curve(estimator, title, X, y, ylim=None, cv=None, n_jobs=1, train_sizes=np.linspace(.1, 1.0, 5)):

plt.figure()

plt.title(title)

if ylim is not None:

plt.ylim(*ylim)

plt.xlabel("Training examples")

plt.ylabel("Score")

train_sizes, train_scores, test_scores = learning_curve(estimator, X, y, cv=cv, n_jobs=n_jobs, train_sizes=train_sizes)

train_scores_mean = np.mean(train_scores, axis=1)

test_scores_mean = np.mean(test_scores, axis=1)

plt.grid()

plt.plot(train_sizes, train_scores_mean, 'o-', color="r", label="Training score")

plt.plot(train_sizes, test_scores_mean, 'o-', color="g", label="Cross-validation score")

plt.legend(loc="best")

return plt

X, y = generate_data()

estimator = Pipeline([('poly', PolynomialFeatures(degree=10)), ('linear', LinearRegression())])

plot_learning_curve(estimator, "Learning Curve", X, y, cv=5)

plt.show()

```

在上述代码中,我们首先生成了一些带有噪声的正弦数据,并使用多项式回归模型进行拟合。接着,我们使用`plot_learning_curve`函数绘制了模型的学习曲线,其中包括训练集和验证集上的分数变化。

### 表格示例

表格可以用来总结模型在不同训练集大小下的性能表现。以下是一个示例表格:

| 训练集大小 | 训练集准确度 | 验证集准确度 |

|-----------|-------------|-------------|

| 10% | 85% | 80% |

| 30% | 92% | 83% |

| 50% | 95% | 85% |

| 70% | 96% | 86% |

| 90% | 98% | 87% |

在表格中,我们可以看到随着训练集大小的增加,训练集上的准确度越来越高,但验证集上的准确度增长较为平缓。当训练集准确度明显高于验证集准确度时,这可能是过拟合的一个信号。

### 结论

识别过拟合是机器学习中优化模型性能的一个关键步骤。通过对模型性能的定量评估和定性分析(如学习曲线的绘制),我们可以对过拟合有一个清晰的认识。在后续章节中,我们将介绍如何预防和缓解过拟合,并通过实际案例来展示这些技术的应用。

# 3. 预防和缓解过拟合的技术

过拟合是机器学习领域中一个常见的问题,它发生在模型在训练数据上表现得很好,但在未见过的数据上性能较差的情况。过拟合不仅会影响模型的泛化能力,还可能导致决策过程出现误导性结论。为了应对这一挑战,研究人员和工程师们开发了多种技术和策略。本章将深入探讨预防和缓解过拟合的技术,包括数据增强和正则化策略、模型选择与架构调整以及早停法与交叉验证等方法。

## 3.1 数据增强和正则化策略

数据增强和正则化策略是解决过拟合问题的两个重要方向。通过这两种技术,研究人员可以在不减少模型性能的前提下,提高模型的泛化能力。

### 3.1.1 数据增强的技巧和方法

数据增强是通过人工手段扩充训练集,从而改善模型泛化性能的一种技术。这种方法对于数据较少的场景尤其重要。

#### *.*.*.* 图像数据的增强方法

在图像数据中,常见的增强方法包括:

- **旋转**:对图像进行旋转操作,可以增加模型对于不同角度的图像的识别能力。

- **缩放**:对图像进行缩放,模拟不同距离拍摄的效果。

- **裁剪和翻转**:随机裁剪图像的一部分,或者对图像进行水平或垂直翻转。

- **颜色变换**:改变图像的亮度、对比度、饱和度等。

#### *.*.*.* 文本数据的增强方法

对于文本数据,数据增强通常涉及同义词替换、句子重排序、随机插入无关词汇等技术。

#### *.*.*.* 代码块:Python示例 - 图像数据增强

```python

from keras.preprocessing.image import ImageDataGenerator

# 实例化数据增强器,设置旋转、缩放、裁剪和水平翻转等参数

datagen = ImageDataGenerator(

rotation_range=20,

width_shift_range=0.2,

height_shift_range=0.2,

horizontal_flip=True,

fill_mode='nearest'

)

# 使用该数据增强器处理图像

image_iter = datagen.flow_from_directory(

'path_to_training_data',

target_size=(150, 150),

batch_size=32,

class_mode='binary'

)

```

在上述代码块中,`ImageDataGenerator`类用于创建一个图像增强器,它可以按照指定的参数对图像进行一系列随机变换。`flow_from_directory`方法用于读取图像并应用增强。

### 3.1.2 正则化技术的原理与应用

正则化是一种通过给模型性能指标添加惩罚项来限制模型复杂度的技术,以此来防止过拟合。常用的正则化技术包括L1和L2正则化、Dropout、Batch Normalization等。

#### *.*.*.* L1和L2正则化

L1和L2正则化通过在损失函数中添加正则化项来抑制权重值的大小,具体来说:

- **L1正则化**:对权重的绝对值进行惩罚,倾向于产生稀疏的权重矩阵。

- **L2正则化**:对权重的平方进行惩罚,倾向于使权重值均匀地较小。

#### *.*.*.* Dropout技术

Dropout通过在训练过程中随机丢弃神经网络中的一些节点来减少模型对特定节点的依赖性,迫使网络学习更加鲁棒的特征表示。

#### *.*.*.* Batch Normalization技术

Batch Normalization技术通过对每一层的输入进行归一化处理,使得网络对数据分布的变化更加鲁棒,从而有助于缓解过拟合问题。

### 3.1.3 表格:各种正则化技术对比

| 正则化技术 | 适用范围 | 优点 | 缺点 |

|------------|----------|------|------|

| L1正则化 | 线性回归、逻辑回归 | 有助于特征选择,产生稀疏模型 | 模型性能可能不稳定 |

| L2正则化 | 多类问题 | 广泛应用,提高模型泛化能力 | 可能对大权重过于敏感 |

| Dropout | 神经网络 | 减少过拟合,提高模型鲁棒性 | 减少了模型的训练速度 |

| Batch Normalization | 神经网络 | 稳定训练过程,加速收敛 | 增加计算复杂度 |

通过上述分析,可以看到各种正则化技术都有其特定的使用场景和优缺点。在实际应用中,应根据具体问题选择合适的正则化策略。

## 3.2 模型选择与架构调整

模型选择与架构调整是缓解过拟合的另一条途径。通过精心设计模型结构和选择合适的模型,可以有效减少过拟合的风险。

### 3.2.1 简化模型复杂度

简化模型复杂度是预防过拟合的一种基本方法。模型越复杂,其拟合训练数据的能力越强,因此需要在模型容量和训练数据量之间找到平衡。

#### *.*.*.* 特征选择和维度缩减

特征选择和维度缩减技术可以减少模型的输入特征数量,从而降低模型复杂度。常见的技术包括主成分分析(PCA)和线性判别分析(LDA)。

#### *.*.*.* 模型复杂度的衡量

模型复杂度可以通过多种方式衡量,例如:

- **模型参数的数量**:参数越多,模型复杂度越高。

- **模型层数和节点数**:层数和节点数越多,模型复杂度越高。

### 3.2.2 模型集成与集成学习

模型集成和集成学习是通过结合多个模型的预测结果来改善泛化能力的方法。

#### *.*.*.* Bagging和Boosting

Bagging和Boosting是集成学习的两种主要技术:

- **Bagging**:通过并行训练多个弱学习器并结合它们的预测结果,降低方差,减少过拟合。

- **Boosting**:通过顺序训练多个弱学习器,每一个学习器都尝试纠正前一个学习器的错误,从而提高整体性能。

#### *.*.*.* 代码块:Python示例 - 集成学习

```python

from sklearn.ensemble import RandomForestClassifier

from sklearn.ensemble import VotingClassifier

# 创建随机森林分类器

rf_clf = RandomForestClassifier(n_estimators=100, random_state=42)

# 创建另一个分类器,例如SVM

svm_clf = SVC(probability=True, random_state=42)

# 创建一个集成分类器

voting_clf = VotingClassifier(estimators=[('rf', rf_clf), ('svm', svm_clf)], voting='soft')

# 训练集成分类器

voting_clf.fit(X_train, y_train)

# 预测

voting_clf.predict(X_test)

```

在上面的代码块中,我们使用了`RandomForestClassifier`和`SVC`两个分类器,并通过`VotingClassifier`将它们集成起来。集成模型可以提供比单一模型更好的预测性能。

### 3.2.3 表格:模型集成方法对比

| 集成方法 | 工作原理 | 优点 | 缺点 |

|----------|-----------|------|------|

| Bagging | 并行训练多个模型并平均结果 | 减少过拟合,提高模型稳定性和准确性 | 训练成本高,可能对异常值敏感 |

| Boosting | 顺序训练模型并关注前一模型的错误 | 更高的准确性,对异常值鲁棒 | 训练过程复杂,可能导致过拟合 |

## 3.3 早停法与交叉验证

早停法与交叉验证是模型训练过程中用来减轻过拟合的两种常用技术。

### 3.3.1 早停法原理与实现

早停法是一种在训练过程中监控模型性能,并在验证集性能开始下降时停止训练的方法。

#### *.*.*.* 实现早停法的步骤

- **分割数据**:将数据分为训练集、验证集和测试集。

- **监控验证误差**:在训练过程中,持续监控模型在验证集上的性能。

- **停止条件**:一旦验证误差开始增大,停止训练。

#### *.*.*.* 代码块:Python示例 - 早停法

```python

from keras.callbacks import EarlyStopping

# 实例化早停回调函数

early_stopping = EarlyStopping(monitor='val_loss', patience=5, restore_best_weights=True)

# 编译并训练模型

***pile(optimizer='adam', loss='categorical_crossentropy')

model.fit(X_train, y_train, epochs=100, validation_data=(X_val, y_val), callbacks=[early_stopping])

```

在上述代码块中,使用了Keras的`EarlyStopping`回调函数来实现早停法。`patience`参数定义了在停止之前允许多少个epoch的性能不提升。

### 3.3.2 交叉验证的方法与技巧

交叉验证是一种评估模型泛化能力的方法,它可以更充分地利用有限的数据。

#### *.*.*.* K折交叉验证

K折交叉验证将数据分为K个大小相等的子集,然后用其中K-1个子集作为训练集,剩下的一个子集作为验证集。重复这个过程K次,每次用不同的子集作为验证集,最后计算K次的平均性能。

#### *.*.*.* 代码块:Python示例 - K折交叉验证

```python

from sklearn.model_selection import cross_val_score

from sklearn.ensemble import RandomForestClassifier

# 创建随机森林分类器

rf_clf = RandomForestClassifier(n_estimators=100, random_state=42)

# 使用5折交叉验证评估模型

scores = cross_val_score(rf_clf, X, y, cv=5)

# 输出分数

print("Accuracy: %0.2f (+/- %0.2f)" % (scores.mean(), scores.std() * 2))

```

在上述代码块中,我们使用了`cross_val_score`函数对随机森林模型进行5折交叉验证,并输出模型的平均准确率和标准差。

通过早停法和交叉验证的应用,我们可以在模型训练的过程中更有效地防止过拟合,确保模型在不同数据子集上的表现稳定,从而提高模型的泛化能力。

# 4. 过拟合问题的实践解决方案

### 4.1 实际案例分析:过拟合的表现

在深度学习和机器学习的实践中,观察过拟合现象是一个重要的步骤。通过不同的模型进行实验,并对其性能进行比较,我们可以发现过拟合的显著特征。例如,利用一个具有大量参数的深度神经网络模型,它在训练数据集上可能会达到非常高的准确率,但如果在独立的验证数据集上准确率显著下降,则很可能是过拟合的情况。

#### 4.1.1 不同模型的过拟合现象观察

为了深入理解过拟合,我们通常会设计一个实验,其中包含多个模型,它们具有不同的复杂度。通过以下步骤可以完成实验:

1. 选择基础模型(例如线性回归、决策树)以及复杂模型(如深度神经网络)。

2. 对所有模型进行训练和交叉验证。

3. 在训练集和测试集上记录准确率和其他性能指标。

4. 比较不同模型的性能差异,查看哪个模型更容易过拟合。

通过观察模型在验证集上的性能,我们可以判断模型是否过拟合。例如,如果一个复杂模型在训练集上的表现极好,但在测试集上的表现却不尽人意,则表明该模型很可能已经过拟合。

#### 4.1.2 过拟合对模型性能的影响评估

过拟合不仅会导致模型在新的数据上表现不佳,还可能带来其他问题。一个过拟合的模型可能在预测时变得过于敏感,对噪声和异常值反应过度。这不仅增加了模型的方差,还可能导致预测结果的不可靠性增加。

为了评估过拟合对模型性能的影响,我们可以采用以下方法:

1. 比较模型在训练集和测试集上的误差。

2. 使用不同的性能指标(如准确率、召回率、F1分数等)来衡量模型在不同类型数据上的表现。

3. 分析模型预测结果的稳定性,例如通过计算在多轮训练后的平均性能。

### 4.2 应用不同技术减轻过拟合

为了应对过拟合问题,我们可以采用不同的技术来优化模型。这些技术的目的是在保持模型的泛化能力的同时,降低过拟合的风险。

#### 4.2.1 实际案例中的正则化应用

正则化是减少过拟合的有效方法之一,它通过对模型的权重施加惩罚来工作。L1和L2正则化是最常用的两种形式,其中L2正则化(又称权重衰减)能够限制权重的大小,而L1正则化可以导致模型权重稀疏。

一个实际案例中应用L2正则化的步骤可能包括:

1. 在损失函数中加入L2正则化项,这通常涉及到选择一个正则化参数λ,用以平衡原始损失和正则化项。

2. 使用梯度下降方法进行优化时,计算损失函数对权重的导数,将其与正则化项结合。

3. 根据计算出的梯度更新模型的权重。

4. 重复以上步骤直到模型收敛。

以下是一个L2正则化的Python伪代码示例:

```python

from sklearn.linear_model import RidgeClassifier

# 假设 X_train, y_train 是训练数据和标签

# alpha 是L2正则化的强度系数

model = RidgeClassifier(alpha=1.0)

model.fit(X_train, y_train)

# 在此模型上进行预测或评估

```

在上述代码中,`RidgeClassifier` 是一个应用了L2正则化的分类器,`alpha` 参数控制了正则化的强度。我们通过调整这个参数,可以控制模型的复杂度,并尝试减轻过拟合。

#### 4.2.2 数据增强在实际中的运用

数据增强是一种通过变换训练数据来增加数据集多样性的技术。这可以通过旋转、缩放、剪裁、颜色变化等方法来实现。在图像识别任务中,数据增强特别有用,因为它可以模拟实际世界中的变化,提高模型的泛化能力。

以下是数据增强的一个简单应用示例:

```python

from keras.preprocessing.image import ImageDataGenerator

# 创建一个数据增强生成器

datagen = ImageDataGenerator(

rotation_range=20,

width_shift_range=0.2,

height_shift_range=0.2,

horizontal_flip=True)

# 训练模型时,使用datagen.flow()作为数据生成器

```

在上述代码中,`ImageDataGenerator` 允许我们定义一系列的变换,这些变换会被随机应用于输入数据以生成更多的训练样本。通过这种方式,模型可以接触到更广泛的数据变化,从而提高其泛化能力并减轻过拟合。

通过这些方法,我们可以有效地识别和解决过拟合问题,从而提高模型在未见数据上的表现,确保模型具有良好的泛化能力。

# 5. 未来趋势与挑战

随着机器学习和深度学习技术的不断发展,过拟合问题的研究也在持续深入。在这一章节中,我们将讨论深度学习中的过拟合问题新动向,大数据与过拟合之间的关系,以及未来研究的方向和可能的技术创新点。

## 深度学习中的过拟合问题

深度学习由于其强大的表达能力和模型复杂度,特别容易在数据上产生过拟合。随着网络深度的增加,过拟合问题变得更加突出,因此对过拟合的识别与预防也提出了更高的要求。

### 深度学习过拟合的新动向

随着深度学习框架和算法的不断进步,研究人员和工程师们已经开始探索如何在深层网络中有效地解决过拟合问题。以下是几个关键的研究动向:

- **深度残差网络(ResNet)和其它正则化策略**:通过引入跳跃连接(skip connections),ResNet 可以训练极深的网络而不易过拟合。这种设计不仅提高了模型的训练效率,而且对过拟合有很好的抑制作用。

- **Dropout 和 Batch Normalization**:Dropout 随机关闭网络中的一些神经元,迫使网络学习到更加鲁棒的特征表示。Batch Normalization 在每个批次上规范化输入层的激活值,有助于减少过拟合。

- **学习率衰减和权重衰减策略**:通过动态调整学习率以及增加权重的L2正则项,可以有效控制网络复杂度,从而避免过拟合。

### 大数据与过拟合的关系

大数据时代,数据集的规模往往成倍增长,但是数据质量、标注的一致性和准确性并非总是同步提升。大数据与过拟合之间的关系,可以从以下几个方面理解:

- **数据丰富性与多样性**:大数据库通常包含更多的样本和更丰富的特征,这有助于模型学习到更加一般化的规律,减少了过拟合的风险。

- **数据噪声与质量控制**:大规模数据也往往伴随着更大的噪声和不确定性,数据预处理、清洗和质量控制成为避免过拟合的重要环节。

- **自监督学习与无监督预训练**:使用未标注的大量数据进行预训练,可以捕捉到数据中的重要特征和分布信息,减少对标注数据的依赖,降低过拟合风险。

## 过拟合研究的新思路与展望

未来对过拟合的研究可能会朝向以下几个方向发展:

### 研究方向与挑战

- **自动化机器学习(AutoML)**:如何让机器自动选择最优的模型、参数、正则化技术以及数据预处理方法,是过拟合研究的一个重要方向。

- **多任务学习与迁移学习**:在多任务学习和迁移学习中,如何有效地利用相关任务的知识,以减少过拟合并提升泛化能力,是当前研究的热点。

### 潜在的技术创新点

- **元学习与超参数优化**:元学习或“学会学习”的算法能够根据历史经验调整模型的超参数设置,这一领域有望为过拟合的预防和解决提供新的视角。

- **对抗性训练和鲁棒性提升**:通过引入对抗性训练,使模型不仅对训练数据鲁棒,同时对对抗性扰动也具有一定的抵抗能力,可能会成为未来的一个研究趋势。

随着机器学习技术的不断进步,过拟合的问题仍然是研究人员和工程师们面临的重大挑战。本章的探讨表明,未来在过拟合的研究与实践中,仍有许多未被充分挖掘的领域和技术,这将有助于推动机器学习技术向更高的准确性和更强的泛化能力迈进。

0

0