深入浅出算法:性能优化的7大秘诀

发布时间: 2024-09-10 15:20:51 阅读量: 413 订阅数: 62

# 1. 算法性能优化概述

在现代IT行业中,算法性能优化是提升软件效率和质量的关键环节。从用户体验到资源消耗,再到系统的可扩展性,良好的算法性能能够直接提升产品的竞争力。本章首先简要介绍性能优化的必要性,随后阐述性能优化的基本概念、目标以及一些初步的优化方法。我们将探讨为什么在算法设计和编码实践中需要关注性能问题,并为接下来更深入的讨论打下基础。

性能优化的必要性体现在以下几个方面:

- **时间效率**:提高算法的执行速度,减少用户的等待时间。

- **空间效率**:减少内存占用,提升系统的稳定性。

- **成本效益**:优化算法资源消耗,降低运行成本。

- **可扩展性**:构建能够应对大数据量和高并发请求的算法。

本章旨在为读者提供一个全面且系统的概览,帮助理解算法性能优化的整体框架,为进一步的学习和实践奠定基础。我们将从算法复杂度的基础知识开始,逐步深入到代码层面的优化技巧,直至探讨并行计算与分布式算法等高级主题。通过实例分析和实际应用,本章不仅为初学者提供入门指引,也为资深开发者提供了性能调优的深层次见解。

# 2. 算法复杂度基础

在现代软件开发中,算法复杂度是衡量一个算法性能的基石,它不仅涉及代码执行的时间,还包括占用存储空间的大小。掌握复杂度分析对于设计和优化算法至关重要,它能够帮助开发者预测算法在面对大数据量时的运行效率,以及如何选取合适的数据结构和算法来优化性能。

## 2.1 时间复杂度分析

时间复杂度是描述算法执行时间随输入数据规模增长的增长率。它不依赖于具体的机器执行时间,而是从理论上分析算法执行所需要的运算次数。理解时间复杂度,对于确定算法的效率至关重要。

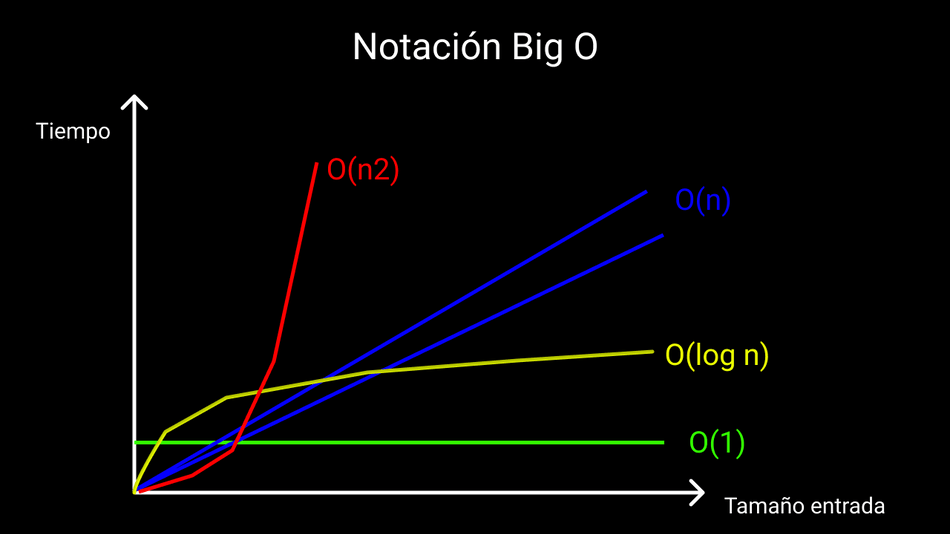

### 2.1.1 大O表示法

大O表示法用于描述上界,通过省略低阶项和常数系数,提供了算法运行时间增长趋势的简洁表示。例如,一个算法如果其执行时间与输入数据的大小n的平方成正比,则可以表示为O(n²)。

- **线性时间**:O(n)表示算法的执行时间与输入数据量成线性关系。

- **对数时间**:O(log n)表示算法的执行时间随着输入数据量的增加而增加,但速度较慢,例如二分查找算法。

- **线性对数时间**:O(n log n)常见于像归并排序这类高效的排序算法。

- **多项式时间**:O(n^k),k为正整数,适用于复杂度较高的算法。

- **指数时间**:O(2^n)或者更糟糕的复杂度,通常不适用于大数据量。

在实际应用中,我们通常关注最坏情况下的时间复杂度,即在最不利输入下算法的运行时间。这是为了确保算法的性能有一个保证,即使在最坏情况下,也能满足时间要求。

### 2.1.2 常见算法的时间复杂度

下面举例一些常见算法和它们对应的时间复杂度:

| 算法 | 时间复杂度 |

| --- | --- |

| 线性查找 | O(n) |

| 二分查找 | O(log n) |

| 归并排序 | O(n log n) |

| 快速排序 | O(n log n),最坏情况O(n²) |

| 堆排序 | O(n log n) |

| 汉诺塔问题 | O(2^n) |

快速排序在平均情况下的时间复杂度是O(n log n),但最坏情况会退化到O(n²),这通常发生在每次选择的pivot(轴点)都是当前序列中的最大或最小元素。为了避免这种情况,实际应用中通常采用随机化选择pivot的方法。

## 2.2 空间复杂度分析

空间复杂度表示算法运行所需存储空间与输入数据规模的关系。它反映了算法对内存资源的占用情况。

### 2.2.1 空间复杂度的基本概念

空间复杂度的计算方式类似于时间复杂度,主要关注以下几点:

- 固定额外空间:算法执行过程中不随输入数据量变化的额外空间需求。

- 变量空间:算法中声明的变量所需的存储空间。

- 数据结构空间:存储输入数据所需的额外空间。

- 动态分配空间:例如使用递归函数时堆栈中分配的空间。

例如,一个简单的交换算法,用于交换两个数的值,其空间复杂度为O(1):

```c

void swap(int *a, int *b) {

int temp = *a;

*a = *b;

*b = temp;

}

```

而一个递归实现的斐波那契数列算法,空间复杂度将与递归深度相关,最坏情况下可达到O(n)。

### 2.2.2 空间优化的策略和方法

在实际开发中,空间复杂度是一个需要权衡的因素。以下是一些优化策略:

- **空间换时间**:通过额外的空间缓存信息来减少重复计算,例如使用哈希表存储已计算的值。

- **就地算法**:尽量使用原地算法,减少不必要的空间分配。

- **内存复用**:设计算法时,考虑能否通过重用内存来减少空间需求。

## 2.3 数据结构对性能的影响

算法与数据结构密不可分,数据结构的选择会直接影响算法的性能。理解不同数据结构的特点及在不同场景下的适用性是提高算法性能的关键。

### 2.3.1 不同数据结构的时间和空间效率

| 数据结构 | 插入 | 查找 | 删除 | 空间复杂度 |

| --- | --- | --- | --- | --- |

| 数组 | O(n) | O(1) | O(n) | O(n) |

| 链表 | O(1) | O(n) | O(n) | O(n) |

| 哈希表 | O(1) | O(1) | O(1) | O(n) |

| 二叉搜索树 | O(log n) | O(log n) | O(log n) | O(n) |

在上述数据结构中,数组和链表都是线性结构,但它们的插入和查找操作效率截然不同。数组具有常数时间复杂度的查找效率,但插入和删除元素通常需要O(n)时间复杂度,因为它需要移动元素来维护连续的内存空间。链表在插入和删除时仅需操作指针,效率较高,但在查找元素时效率较低,因为它需要从头节点开始逐个遍历。

### 2.3.2 选择合适的数据结构

选择合适的数据结构通常依赖于算法的需求。例如:

- **频繁查找**:如果算法需要频繁查找元素,则应优先考虑哈希表或平衡二叉搜索树(如AVL树或红黑树),它们提供接近O(1)的时间复杂度。

- **顺序访问**:如果需要按顺序访问所有元素,且插入和删除操作不频繁,那么数组或链表可能是更好的选择。

- **内存限制**:如果内存空间有限,可能需要考虑使用更节省空间的数据结构,例如位图或Trie树。

通过对比不同数据结构的优缺点,结合应用场景的具体需求,可以更好地优化算法的性能。

通过本章节的介绍,我们可以看到算法复杂度对于设计高效算法的重要性。下一章我们将深入探讨代码层面的优化技巧,进一步提高算法的实际性能。

# 3. 代码层面的优化技巧

## 3.1 循环优化

循环是编程中最常见的结构之一,特别是在处理大数据集时。循环的效率直接影响程序的性能,因此理解循环优化的技巧至关重要。

### 3.1.1 循环展开与合并

循环展开是一种提高循环执行效率的技术,它通过减少循环的迭代次数来减少循环开销。基本思想是将循环内的计算分散到循环外,减少每次循环的计算量,从而减少循环的迭代次数。

```c

for (int i = 0; i < n; i += 4) {

// 循环体

}

```

在上面的伪代码中,我们通过每次迭代增加4来减少循环的次数。需要注意的是,循环展开可能会增加代码的复杂性,而且不是所有的编译器都会自动进行这种优化。因此,在手动展开循环时,需要权衡代码的可读性和性能提升。

### 3.1.2 减少循环内部计算

在循环内部进行不必要的计算会降低程序的性能,特别是当这些计算在每次迭代中都是重复的。减少循环内部的计算可以通过将重复的计算移出循环来实现。

```c

int precomputed_value = expensive_function();

for (int i = 0; i < n; i++) {

use(precomputed_value);

}

```

在上述示例中,`expensive_function()` 只被调用了一次,并将结果保存在 `precomputed_value` 中供循环中的每次迭代使用。这种方式减少了循环内部的计算负担。

## 3.2 函数与递归优化

函数调用在程序执行中是相对昂贵的操作,特别是在涉及到递归时。优化函数和递归可以显著提升程序性能。

### 3.2.1 函数内联

函数内联是一种优化技术,它将函数调用替换为函数体本身。这可以减少函数调用的开销,尤其是在频繁调用小型函数时非常有效。

```c

inline void my_inline_function(int x) {

// 函数体

}

```

在支持内联的编译器中,可以使用 `inline` 关键字来提示编译器将这个函数视为内联。需要注意的是,过度使用内联可能会增加编译时间和代码大小。

### 3.2.2 递归到迭代的转换

递归函数虽然代码简洁,但效率通常不如迭代版本。这是因为递归需要多次函数调用和维护堆栈信息,而迭代则使用简单的循环结构。

```c

int recursive_function(int n) {

if (n <= 1) {

return n;

}

return recursive_function(n - 1) + recursive_function(n - 2);

}

int iterative_function(int n) {

int a = 0, b = 1, c;

for (int i = 0; i < n; i++) {

c = a + b;

a = b;

b = c;

}

return a;

}

```

在上面的示例中,递归版本的计算斐波那契数列效率较低,而迭代版本则高效得多。递归到迭代的转换往往需要理解算法的逻辑,并重新编写代码以避免递归的开销。

## 3.3 表达式与条件优化

表达式和条件判断的优化可以减少不必要的计算和提高代码的执行效率。

### 3.3.1 常量折叠与常量传播

常量折叠是一种编译时优化,编译器在编译时就已经计算了常量表达式的结果。

```c

#define PI 3.14159

double circumference = 2 * PI * radius;

```

在这个例子中,`2 * PI` 在编译时就被计算,因此在程序运行时不需要额外的计算。常量传播是指编译器将程序中的变量用它们的常量值替换,从而减少运行时的计算。

### 3.3.2 条件判断的简化

复杂和嵌套的条件判断会增加程序的执行路径,从而降低性能。简化条件判断可以使代码更加清晰,减少分支预测失败的可能性。

```c

if (a < b) {

// 执行操作

} else if (a == b) {

// 执行操作

} else {

// 执行操作

}

```

上面的代码可以使用 `min` 函数或者逻辑运算符来简化。

```c

int result = a < b ? a : b;

```

通过简化条件判断,可以减少逻辑判断的复杂度,从而提升性能。对于多个条件的情况,使用查表等技术可以进一步提升性能。

代码层面的优化技巧是提升软件性能的一个重要方面,它涉及到对程序中具体语句和表达式的理解。在实现这些优化时,需要仔细分析代码,测试优化前后的性能差异,确保优化不会破坏程序的正确性。在进行任何优化之前,最好先使用性能分析工具来确定程序的瓶颈,然后有针对性地进行优化。

# 4. 算法设计的性能考量

## 4.1 分治法与递归优化

### 4.1.1 分治算法的性能分析

分治算法是一种通过将大问题分解为小问题来解决问题的策略。这种方法的基本思想是将一个难以直接解决的大问题分割成一些规模较小的相同问题,递归地解决这些子问题,然后再合并其结果以得到原问题的解。分治算法的性能取决于如何分割问题、解决子问题和合并结果。

在性能分析方面,分治算法的总体时间复杂度通常由以下因素决定:

- 分割问题所需的时间;

- 解决所有子问题所需的时间;

- 合并结果所需的时间。

对于许多标准问题,如归并排序和快速排序,分治算法的时间复杂度为O(n log n)。这比其他一些非分治算法,如冒泡排序的O(n^2)要好得多。然而,分治算法的空间复杂度可能相对较高,因为它需要存储所有的子问题解,尤其是在递归实现中。

#### 示例代码:归并排序

```python

def merge_sort(arr):

if len(arr) > 1:

mid = len(arr) // 2

L = arr[:mid]

R = arr[mid:]

merge_sort(L)

merge_sort(R)

i = j = k = 0

while i < len(L) and j < len(R):

if L[i] < R[j]:

arr[k] = L[i]

i += 1

else:

arr[k] = R[j]

j += 1

k += 1

while i < len(L):

arr[k] = L[i]

i += 1

k += 1

while j < len(R):

arr[k] = R[j]

j += 1

k += 1

```

### 4.1.2 递归的尾调用优化

递归是一种调用自身的算法实现方法。递归方法简洁易懂,但在某些情况下可能会导致效率低下,尤其是当递归层次过深时,可能会导致栈溢出。为了优化递归的性能,一种重要的技术是尾调用优化(Tail Call Optimization,TCO)。

尾调用是指一个函数的最后一个动作是调用另一个函数。当一个函数执行的是其最后一个动作是尾调用另一个函数时,当前函数的调用帧可以被重用,无需添加新的调用帧到调用栈中。这样,即使递归层次较深,也不会导致栈溢出。

#### 示例代码:尾调用优化

```python

def factorial(n, accumulator=1):

if n == 0:

return accumulator

else:

return factorial(n-1, accumulator * n) # 尾调用

```

在上面的阶乘函数实现中,`factorial`函数的最后一个动作是调用自身,这是一个尾调用的例子。许多现代的编译器或解释器在编译或解释执行时,会自动将尾递归优化为迭代,从而减少内存消耗。

## 4.2 动态规划与记忆化搜索

### 4.2.1 动态规划的优化策略

动态规划(Dynamic Programming, DP)是一种算法设计技巧,它将一个复杂的问题分解为更小的子问题,并使用这些子问题的解来构建原问题的解。动态规划的关键在于构建一个表(通常是一个二维数组),用以存储子问题的解,避免重复计算。

优化动态规划算法的策略通常包括:

- 减少空间复杂度:当存储所有的子问题解不是必须的时候,可以只存储部分中间结果,这种方法被称为"空间优化"。

- 提高时间效率:避免不必要的计算,利用已知的子问题解来推导其他解。

#### 示例代码:斐波那契数列

```python

def fibonacci(n, memo={}):

if n in memo:

return memo[n]

if n <= 2:

return 1

memo[n] = fibonacci(n-1, memo) + fibonacci(n-2, memo)

return memo[n]

```

在这个例子中,使用字典`memo`来存储已经计算过的斐波那契数列的值,避免了重复计算,提高了算法效率。

### 4.2.2 记忆化搜索的实现与应用

记忆化搜索是一种特殊的动态规划实现方式,它通常在图和树的搜索过程中使用。它通过存储已经搜索过的节点的状态来避免重复搜索,从而优化算法的执行效率。记忆化搜索在解决诸如最短路径、硬币找零等问题时尤其有效。

实现记忆化搜索时,需要准备一个数据结构(如字典或数组)来存储已解决状态的解。每次遇到新状态时,首先检查是否已经计算过该状态,如果已计算,直接使用存储的解;否则,执行计算并将结果存储下来供将来使用。

#### 示例代码:记忆化搜索解决硬币找零问题

```python

def coin_change(coins, amount, memo={}):

if amount in memo:

return memo[amount]

if amount == 0:

return 0

if amount < 0:

return float('inf')

min_coins = float('inf')

for coin in coins:

result = coin_change(coins, amount - coin, memo)

if result != float('inf'):

min_coins = min(min_coins, 1 + result)

memo[amount] = min_coins if min_coins != float('inf') else -1

return memo[amount]

```

在这个例子中,`memo`字典用于存储每个金额所需的最少硬币数。当需要计算某个金额的最少硬币数时,会首先查询`memo`,如果该金额的解已经存在,则直接返回该解。

## 4.3 贪心算法与启发式算法

### 4.3.1 贪心算法的适用场景

贪心算法是一种在每一步选择中都采取在当前状态下最好或最优(即最有利)的选择,从而希望导致结果是全局最好或最优的算法。

贪心算法的适用性取决于问题的结构。它适用于具有"贪心选择属性"的问题,即局部最优解能决定全局最优解。这类问题通常具有最优子结构,这意味着问题的最优解包含其子问题的最优解。

贪心算法不保证会得到最优解,但在某些问题中,它能提供一个近似最优解。在实现贪心算法时,关键在于找到合适的贪心策略。

#### 示例代码:找零钱问题的贪心算法

```python

def greedy_coin_change(coins, amount):

coins.sort(reverse=True)

result = []

for coin in coins:

while amount >= coin:

result.append(coin)

amount -= coin

return result

```

在这个找零问题中,我们先将硬币按照面额从大到小排序,然后尽可能多地使用面额大的硬币。

### 4.3.2 启发式算法的效率提升

启发式算法是基于经验或者直觉的算法,它不是精确的算法,不能保证得到最优解。但是,启发式算法通常能够快速找到问题的近似解,并且在很多情况下这个近似解已经足够好。

在实际应用中,启发式算法的效率提升往往来自于对问题空间的巧妙搜索策略,以及对搜索方向的智能引导。常见的启发式算法包括遗传算法、模拟退火算法和蚁群算法等。

#### 示例代码:遗传算法优化旅行商问题

```python

import numpy as np

# 假设有一个距离矩阵表示城市间的距离

distance_matrix = np.array([

[0, 2, 9, 10],

[1, 0, 6, 4],

[15, 7, 0, 8],

[6, 3, 12, 0]

])

# 适应度函数计算路径的总距离

def fitness(path):

return sum([distance_matrix[path[i], path[i+1]] for i in range(len(path)-1)]) + distance_matrix[path[-1], path[0]]

# 选择

def select(population, fitnesses):

# 轮盘赌选择

total_fitness = sum(fitnesses)

rel_fitness = [f/total_fitness for f in fitnesses]

probs = [sum(rel_fitness[:i+1]) for i in range(len(rel_fitness))]

rand = np.random.rand()

for (i, individual) in enumerate(population):

if rand <= probs[i]:

return individual

# 遗传算法主循环

def genetic_algorithm():

population = [np.random.permutation(len(distance_matrix)) for _ in range(10)]

best_path = None

best_fitness = 0

for _ in range(1000):

new_population = []

fitnesses = [fitness(ind) for ind in population]

for _ in range(10):

parent1 = select(population, fitnesses)

parent2 = select(population, fitnesses)

child = np.concatenate((parent1[:len(parent1)//2], parent2[len(parent2)//2:]))

new_population.append(child)

population = new_population

fitnesses = [fitness(ind) for ind in new_population]

best_path = population[np.argmin(fitnesses)]

best_fitness = min(fitnesses)

return best_path, best_fitness

```

在上述代码中,遗传算法被用来解决旅行商问题(TSP),它是一种经典的组合优化问题。通过使用轮盘赌选择、交叉和变异等操作,算法迭代地改进种群,寻找最优解。尽管遗传算法不保证找到全局最优解,但它通常能够找到一个好的近似解,并且相对其他优化算法而言,它在处理大规模问题时具有较高的效率。

# 5. 并行计算与分布式算法

在信息技术飞速发展的今天,数据量的增长速度远远超出了单机处理能力的提升。并行计算与分布式算法作为提高计算能力和处理大数据的重要手段,对于IT专业人员来说,掌握它们的原理和优化技巧是至关重要的。本章节将深入探讨并行计算与分布式算法的设计、应用以及在云计算和大数据处理中的性能优化。

## 5.1 多线程与并发编程

多线程编程和并发是并行计算的基础,它们使得程序可以同时执行多个任务,大幅度提升了计算效率。在本小节中,我们将探讨线程同步的机制以及并行算法设计模式。

### 5.1.1 锁机制与线程同步

锁机制是保证共享资源在多线程环境下安全访问的核心技术。它确保了在任何时候只有一个线程可以执行某段代码。在多线程编程中,主要有以下几种锁类型:

- **互斥锁(Mutex)**:确保当一个线程在访问一段代码时,其他的线程必须等待。

- **自旋锁(Spinlock)**:与互斥锁类似,但不阻塞线程,而是让线程在等待锁释放期间不断循环检查锁是否可用,这适用于短时间内的锁等待。

- **读写锁(Read-Write Lock)**:允许多个线程同时读取共享资源,但写入时必须独占访问。

- **条件锁(Condition Lock)**:允许线程在某个条件未满足时挂起,并在条件满足时被唤醒。

线程同步时可能遇到的一个问题是“死锁”,即两个或多个线程无限期等待对方释放资源。死锁发生时,系统无法继续向前执行,这要求我们在设计算法时需要特别注意资源的分配顺序和锁定策略。

下面是一个简单的互斥锁使用示例:

```c

#include <pthread.h>

pthread_mutex_t lock;

void* thread_function(void* arg) {

pthread_mutex_lock(&lock);

// 临界区代码

printf("Thread %ld is holding the lock!\n", (long)arg);

// 模拟一些处理过程

sleep(1);

pthread_mutex_unlock(&lock);

return NULL;

}

int main() {

pthread_t threads[5];

pthread_mutex_init(&lock, NULL);

for (int i = 0; i < 5; i++) {

pthread_create(&threads[i], NULL, thread_function, (void*)(long)i);

}

for (int i = 0; i < 5; i++) {

pthread_join(threads[i], NULL);

}

pthread_mutex_destroy(&lock);

return 0;

}

```

上述代码演示了如何使用互斥锁同步五个线程,确保在打印信息时只有一个线程可以持有锁。每次只有一个线程可以进入临界区,并执行其中的代码。

### 5.1.2 并行算法的设计模式

并行算法设计模式是提高多线程程序性能的关键。设计模式包括但不限于以下几种:

- **流水线模式**:将计算过程分成几个独立的步骤,每个线程处理一个步骤。数据在步骤间流动,类似于工厂的装配线。

- **分治模式**:将大的问题分解为小的问题,每个线程解决一个小问题,然后将结果合并。

- **任务并行模式**:任务被分解成多个子任务,每个子任务由一个线程独立完成。

下面的表格比较了几种并行算法设计模式的适用情况:

| 设计模式 | 适用场景 | 优点 | 缺点 |

| --- | --- | --- | --- |

| 流水线模式 | 计算步骤之间依赖性低的任务 | 高吞吐量,易于平衡负载 | 初始启动开销大,对缓存不友好 |

| 分治模式 | 可被分解为独立子问题的问题 | 扩展性好,易于实现 | 需要适当的负载平衡策略 |

| 任务并行模式 | 子任务之间无序或顺序不重要的任务 | 灵活性高,可以有效利用资源 | 需要额外的任务调度开销 |

优化并行算法时需要考虑的问题还包括任务分配的均衡性、线程间通信的效率和同步的开销。

## 5.2 分布式算法原理

分布式算法允许在多个计算机节点之间分配任务和数据,有效利用集群资源处理大规模问题。

### 5.2.1 分布式系统的通信机制

在分布式系统中,节点间的通信对于任务的协调至关重要。主要通信机制包括:

- **点对点通信**:两个节点间直接交换消息。

- **广播通信**:一个节点向所有其他节点发送消息。

- **组播通信**:一个节点向一组节点发送消息。

以下是使用Apache Kafka实现的点对点通信模型的一个简单示例:

```java

Properties properties = new Properties();

properties.put("bootstrap.servers", "localhost:9092");

properties.put("key.serializer", "***mon.serialization.StringSerializer");

properties.put("value.serializer", "***mon.serialization.StringSerializer");

Producer<String, String> producer = new KafkaProducer<>(properties);

producer.send(new ProducerRecord<String, String>("test-topic", "key", "value"));

producer.close();

```

上述代码创建了一个生产者对象,并向Kafka的"test-topic"主题发送了一条消息。

### 5.2.2 MapReduce等模型的优化策略

MapReduce模型是分布式计算中的一种常见模式,它包含Map(映射)和Reduce(归约)两个步骤。优化MapReduce模型通常包括:

- **数据局部性优化**:尽可能在数据所在的节点上执行Map任务,以减少数据传输。

- **任务调度优化**:合理分配任务,避免数据倾斜和负载不均。

- **资源管理优化**:有效利用集群资源,例如CPU、内存和网络。

针对MapReduce的优化策略,可以根据具体应用的需求和数据特征来制定。例如,针对大数据排序问题,可以采取如下措施:

```python

# Hadoop MapReduce Python示例代码

import sys

from itertools import groupby

from operator import itemgetter

# input.txt内容: (key1, value1)\n(key2, value2)\n...

for line in sys.stdin:

line = line.strip()

key, value = line.split('\t', 1)

print '%s\t%s' % (key, value)

for line in sys.stdin:

line = line.strip()

key, value = line.split('\t', 1)

values = value.split(',')

for word in values:

word = word.strip()

print '%s\t%s' % (key, word)

```

此代码段展示了在MapReduce中如何处理键值对数据。在实际应用中,开发者需要结合具体的数据处理需求来编写Map和Reduce函数。

## 5.3 云计算与大数据优化

云计算和大数据处理领域对算法的性能提出了更高要求,本小节将探讨这两个领域的性能挑战与优化策略。

### 5.3.1 云平台的性能调优

云平台提供的是可弹性伸缩的计算资源,性能调优主要包括:

- **自动扩展**:根据工作负载自动调整虚拟机的数量,以达到资源的最大化利用。

- **负载均衡**:合理分配流量和请求,避免单个节点过载。

- **资源监控**:实时监控系统性能指标,如CPU使用率、内存使用率等。

### 5.3.2 大数据处理的性能挑战与优化

大数据处理面临着数据规模大、处理速度快和实时性要求高的挑战。优化方法包括:

- **批处理优化**:对大规模数据进行分批处理,利用MapReduce等模型进行并行处理。

- **内存计算**:使用如Spark这样的内存计算框架,提升数据处理速度。

- **实时流处理**:利用如Apache Storm或Apache Flink这样的流处理系统,实现数据的实时分析和处理。

本章节详细介绍了并行计算与分布式算法的基本原理、设计模式和优化策略,以及在云计算和大数据处理中的应用。掌握这些知识点能够帮助IT行业从业者提升系统设计和优化的能力。

# 6. 案例分析与实际应用

在本章中,我们将深入探讨一些经典的算法性能优化案例,并将这些理念应用到现代的实际场景中。此外,我们还将展望未来算法性能优化的发展趋势,以及新兴技术如硬件加速和量子计算可能带来的变革。

## 6.1 经典算法的性能优化实例

### 6.1.1 排序算法的优化

排序是计算机科学中最基本的操作之一。通过优化排序算法,我们可以显著提升数据处理的效率。考虑快速排序算法,其平均时间复杂度为O(n log n),但在最坏情况下可以退化到O(n^2)。下面是如何优化快速排序算法的步骤:

1. **选择合适的基准值(Pivot)**:基准值的选择对算法性能有巨大影响。可以使用“median-of-three”规则选择基准值,即选择首、中、末三个数的中位数作为基准值,以减少最坏情况发生的概率。

2. **尾递归优化**:在递归的最后一次调用中,递归调用自身并交换基准值,可以避免栈的额外使用。

3. **三数取中法**:为了防止在已经有序或接近有序的数据集上性能下降,可以在分区之前检查数据,如果数据已经有序或接近有序,则使用插入排序代替快速排序。

### 6.1.2 搜索算法的优化

搜索算法中,二分查找是一种高效的搜索方法,但当数据集非常大时,递归实现可能会导致栈溢出。可以使用迭代的方式进行二分查找,优化其性能。以下是迭代二分查找算法的示例代码:

```python

def binary_search(arr, target):

left, right = 0, len(arr) - 1

while left <= right:

mid = (left + right) // 2

if arr[mid] == target:

return mid

elif arr[mid] < target:

left = mid + 1

else:

right = mid - 1

return -1

```

### 表格展示

| 搜索算法 | 时间复杂度 | 适用场景 |

| --- | --- | --- |

| 顺序查找 | O(n) | 无序数据集 |

| 二分查找 | O(log n) | 排序后的数据集 |

| 哈希查找 | O(1) | 需要快速存取且数据量较大的场景 |

## 6.2 现代应用场景下的算法优化

### 6.2.1 实时数据处理算法优化

在实时数据处理场景中,如金融交易系统、实时推荐系统等,算法性能直接影响到用户体验和业务效果。为了优化实时数据处理,可以采取以下措施:

1. **使用高效数据结构**:如使用堆(heap)来快速访问和更新数据。

2. **并行化处理**:利用多核CPU或者分布式系统,将数据流分片进行并行处理。

### 6.2.2 机器学习中的算法优化

在机器学习领域,算法性能的优化主要通过以下手段实现:

1. **特征选择和维度压缩**:减少不必要的特征,通过PCA等技术压缩数据维度。

2. **高效的矩阵运算**:使用BLAS、LAPACK等库优化矩阵运算的性能。

3. **GPU加速**:利用GPU进行大规模并行计算,加速机器学习模型的训练。

### 流程图展示

```mermaid

graph LR

A[实时数据处理] --> B[使用高效数据结构]

A --> C[并行化处理]

D[机器学习算法] --> E[特征选择与维度压缩]

D --> F[高效的矩阵运算]

D --> G[GPU加速]

```

## 6.3 未来算法性能优化趋势

### 6.3.1 硬件加速技术的影响

随着硬件技术的发展,如专用的AI芯片、FPGA等,可以大幅提升特定类型算法的性能。这些硬件加速技术通过优化硬件架构来实现并行处理和更高效的计算。

### 6.3.2 量子计算与算法优化前景

量子计算为算法性能优化开辟了新的前景。量子位(qubits)和量子纠缠的特性可以极大地加速某些计算问题,如大数质因数分解。未来算法优化可能会涉及到量子算法的设计,如量子版本的排序和搜索算法。

在本章中,我们看到了经典算法优化的实例和现代应用场景下的算法优化策略,并讨论了未来算法优化的可能方向。通过这些案例和分析,我们不仅能对当前的优化方法有深入的理解,也能够对未来的算法优化趋势有所预期。

0

0