Python日志数据分析:业务洞察与问题诊断的利器

发布时间: 2024-10-06 21:48:49 阅读量: 28 订阅数: 39

# 1. Python日志数据分析基础

## 1.1 日志数据分析的重要性

日志数据是系统运行状态的忠实记录者。它包含了系统运行中的关键信息,从用户的操作行为到程序的错误信息。对于IT从业者来说,对日志数据进行分析,不仅可以帮助我们发现潜在的问题,及时进行预警和修复,还可以通过数据挖掘来优化系统性能和用户体验。

## 1.2 Python在日志数据分析中的优势

Python作为一门多功能编程语言,因其简洁易学、社区资源丰富以及大量的数据分析库支持,成为了进行日志数据分析的首选工具。通过Python,我们可以轻松处理大规模日志数据,进行复杂的数据分析操作,并将分析结果以直观的方式呈现出来。

## 1.3 日志数据分析的基本流程

进行日志数据分析通常包括以下几个步骤:数据的收集、存储、清洗、处理、分析和可视化。首先,我们需要从各种渠道收集日志数据;然后选择合适的方式将数据存储起来;接下来,进行必要的数据清洗和预处理,以便后续分析;之后,进行深入的数据探索和分析,最后,将分析结果通过可视化的方式展现出来,帮助决策者作出基于数据的决策。

```

# 示例代码块:基本的日志文件读取和打印

with open('log_file.log', 'r') as ***

***

***

```

在上述代码中,我们以Python的文件操作为基础,展示了一个简单读取和逐行打印日志文件内容的过程。这是日志数据分析流程中的第一步,为接下来的深入分析打下了基础。

# 2. 日志数据的收集与存储

日志数据作为信息系统运行状态的直接反映,收集和存储是日志分析的第一步。这一过程需要对数据来源和格式有清晰的认识,并选择合适的工具进行高效采集。此外,存储方案的选择也至关重要,它将决定后续分析的效率和可扩展性。

### 2.1 日志数据的采集技术

#### 2.1.1 日志数据的来源与格式

日志数据来源于服务器、网络设备、应用程序等多种IT资源。这些数据记录了资源的运行情况、用户行为及系统性能指标等信息。在收集日志之前,需要理解其来源和格式,这对于后续处理至关重要。

格式化日志如ELF(Extended Log Format)或JSON格式,提供了一种结构化且易于机器解析的日志数据格式。而传统的非结构化文本日志则需要更多的处理才能进行有效分析。

#### 2.1.2 日志采集工具的选择与配置

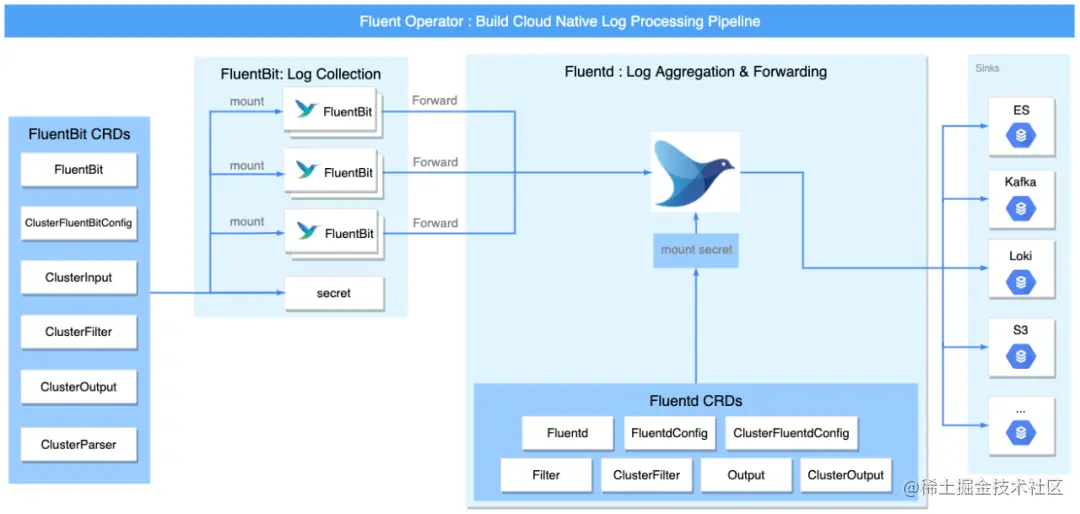

选择合适的日志采集工具是决定日志收集效率和质量的关键。常见的日志采集工具有Filebeat、Fluentd、Logstash等。这些工具各有所长,例如Filebeat小巧轻量,适用于大规模文件日志采集;Fluentd则具有良好的扩展性与插件支持。

在配置采集工具时,需要注意性能优化,例如合理设置批处理大小和发送间隔,以避免对系统造成额外的负担。同时,考虑到安全性和可靠性,通常会通过加密和压缩来传输数据,并使用可靠的传输协议如TLS。

### 2.2 日志数据的存储方案

#### 2.2.1 文件存储与数据库存储的对比

传统的日志数据通常存储在文件系统中,如直接存储为.log文件。这种方法简单直观,但在数据量增大时,查询和检索效率会显著降低。此外,文件存储在数据备份和恢复上也存在不足。

数据库存储提供了结构化的数据存储解决方案。使用数据库可以大大提升数据的查询效率,方便进行复杂的业务逻辑分析。但是,数据库存储也会带来额外的系统开销,并可能需要更复杂的配置和维护。

#### 2.2.2 大数据存储技术在日志数据中的应用

随着数据量的指数级增长,大数据存储技术如Hadoop、NoSQL数据库(如Cassandra、HBase)逐渐成为处理海量日志数据的首选方案。这些技术具有水平扩展、高容错性的特点,非常适合处理大规模、高并发的日志数据。

这些技术通常会使用分布式文件系统(如HDFS)来存储数据,这样即使数据量再大,也可以保证读写性能。同时,结合MapReduce等数据处理框架,可以高效完成日志数据的统计分析任务。

### 2.3 实践操作:使用Filebeat采集日志

接下来,通过Filebeat的一个具体配置案例,来说明如何采集日志数据。Filebeat通过读取指定目录下的文件,并将其内容发送到指定的服务器,这里我们配置Filebeat来采集本地的web服务器日志,并发送到Elasticsearch进行存储。

首先,需要安装Filebeat:

```sh

curl -L -O ***

```

然后,编辑Filebeat配置文件`/etc/filebeat/filebeat.yml`:

```yaml

filebeat.inputs:

- type: log

enabled: true

paths:

- /var/log/nginx/access.log

output.elasticsearch:

hosts: ["localhost:9200"]

```

最后,启动Filebeat服务:

```sh

sudo systemctl start filebeat

```

通过上述步骤,Filebeat开始从`/var/log/nginx/access.log`采集Nginx服务器的日志,并将数据发送到本地的Elasticsearch实例中。

通过配置文件的`filebeat.inputs`部分,可以设置Filebeat读取哪些日志文件。`output.elasticsearch`部分则定义了日志数据输出的目标地址,本例中配置为本地的Elasticsearch服务。

以上操作展示了如何通过配置Filebeat来实现日志数据的采集。类似的,可以对其他日志源进行配置,以满足复杂的日志管理需求。

在下一章节中,我们将深入探讨如何使用Python处理和分析这些采集到的日志数据。

# 3. Python在日志数据分析中的应用

## 3.1 Python数据处理库的介绍

### 3.1.1 Pandas库的基础使用

在进行日志数据分析时,Pandas库是不可或缺的工具,它为数据处理和分析提供了一套高级的数据结构和操作工具。Pandas中最重要的数据结构是`DataFrame`,它是一个二维的、大小可变的、潜在异质型的表格数据结构,带有标签的轴(行和列)。标签可以是数字、字符串、时间戳、甚至可以为空。

Pandas库的安装非常简单,通常通过`pip`进行安装:

```

pip install pandas

```

安装完成后,我们来演示一下如何使用Pandas进行基本操作。

首先导入库:

```python

import pandas as pd

```

接着,我们可以从一个CSV文件中读取数据,并将其加载到DataFrame中:

```python

df = pd.read_csv('path_to_log_file.csv')

```

之后,我们便可以使用`df`这个变量来操作这些数据。例如,查看前5条数据可以使用:

```python

print(df.head())

```

我们还可以执行条件筛选来找出特定的数据子集。比如,找出状态码为404的日志条目:

```python

error_404_logs = df[df['status'] == 404]

```

在进行分析之前,清理和预处理数据是很有必要的。使用Pandas,可以很容易地处理缺失值,例如删除含有缺失值的行:

```python

df_cleaned = df.dropna()

```

或者填充缺失值:

```python

df_filled = df.fillna(method='ffill')

```

Pandas提供了强大的数据合并与分组功能。我们可以基于某些条件将数据分组,并对每个分组应用函数进行聚合操作:

```python

grouped = df.groupby('source

```

0

0