Python日志可视化:将日志数据转换为视觉信息的艺术

发布时间: 2024-10-06 22:05:25 阅读量: 4 订阅数: 8

# 1. 日志可视化的概念和意义

在IT行业,日志文件是记录系统运行状态和用户行为的重要数据源。随着信息技术的不断进步,日志数据量呈指数级增长,传统的文本读取和逐行分析的方式已无法满足快速准确处理的需求。因此,日志可视化作为一种先进的数据分析技术应运而生,它通过图形化的方式展示日志信息,帮助开发人员、运维人员和数据分析师快速理解系统行为,优化系统性能,及时发现和定位问题。

## 1.1 日志数据的特点和挑战

日志数据具有高并发、多维度、实时性强等特点。它不仅仅包含文本信息,还可能涉及到时间戳、IP地址、用户行为等多种数据类型。这些数据的高维度和大规模为日志的处理和分析带来了挑战。

## 1.2 日志可视化的重要性

日志可视化能够将杂乱无章的日志信息转化为直观的图表和图形,使得数据的分析和解释变得更加容易。例如,通过可视化技术,运维人员可以一眼识别出系统中出现的异常模式,而开发人员可以通过日志图谱快速定位代码中的错误。

# 2. Python中的日志数据处理基础

## 2.1 Python日志数据的读取和解析

### 2.1.1 常见的日志格式和解析方法

日志数据通常包含关键的业务信息和系统运行状态,它们以文本文件的形式存储,其中包含了时间戳、日志级别、消息、异常堆栈跟踪等信息。常见的日志格式包括Apache的Common Log Format(CLF),Web服务器日志的Extended Log Format(ELF),以及各种自定义格式。

解析这些日志文件通常需要编写自定义的解析器,或者使用现有的日志分析工具。例如,使用Python的字符串分割方法、正则表达式或者专门的日志解析库,如`logutils`,可以简化解析过程。

一个常见的解析方法是逐行读取文件,使用正则表达式匹配和提取需要的信息。下面是一个简单的Python代码示例,展示了如何解析具有自定义格式的日志行:

```python

import re

log_format = ***pile(r'^(?P<timestamp>\d{4}-\d{2}-\d{2}T\d{2}:\d{2}:\d{2}.\d+Z) ' +

r'(?P<level>\w+) (?P<logger>\w+) - (?P<msg>.*)$')

log_line = '2023-03-20T12:34:56.789Z INFO logger - System started.'

match = log_format.match(log_line)

if match:

log_dict = match.groupdict()

print(log_dict)

```

以上代码定义了一个正则表达式来匹配日志行,并解析出时间戳、日志级别、日志器和消息。输出的`log_dict`字典会包含这些信息,可以进一步用于数据分析。

### 2.1.2 使用Python标准库处理日志

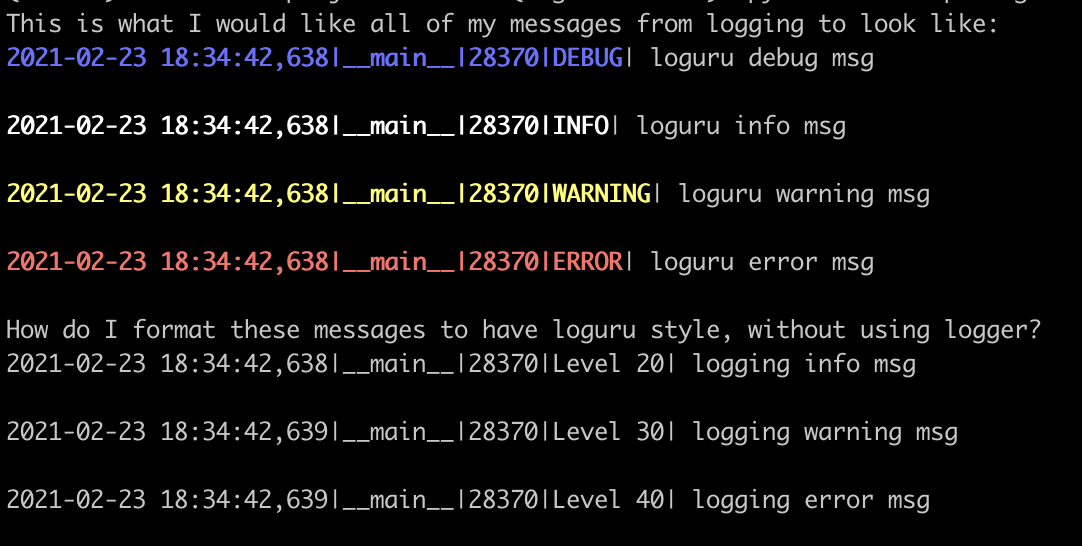

Python的`logging`模块是处理日志的标准库。它允许开发者定义多个日志处理器(handlers),每个处理器负责将日志消息输出到不同的目的地,例如文件、控制台或其他流处理器。

以下是如何使用`logging`模块将日志信息记录到文件中的示例:

```python

import logging

# 配置日志

logging.basicConfig(

level=***, # 设置日志级别

format='%(asctime)s - %(name)s - %(levelname)s - %(message)s', # 设置日志格式

handlers=[

logging.FileHandler('example.log'), # 将日志写入文件

logging.StreamHandler() # 同时在控制台输出日志

]

)

# 记录信息

***('日志信息记录。')

```

此代码配置了基础的日志记录器,指定了日志级别为INFO,并定义了日志消息的格式。通过`logging.FileHandler`将日志写入文件`example.log`,而`logging.StreamHandler`则将日志输出到控制台。

## 2.2 日志数据的清洗和预处理

### 2.2.1 清洗日志数据的方法

日志数据清洗是确保日志分析准确性的重要步骤。日志数据清洗包含去除无用字段、格式化字段、归一化字段、错误纠正和异常值处理等操作。

下面是一个简单的清洗步骤示例,使用Python处理日志数据,以去除日志中的无用字段:

```python

import pandas as pd

# 假设df是包含日志数据的DataFrame,其中包含了无用的字段'unnecessary_column'

df = pd.read_csv('log_data.csv')

# 删除无用列

df_cleaned = df.drop(columns=['unnecessary_column'])

# 假设日志消息中包含冗余的空白字符

df_cleaned['log_message'] = df_cleaned['log_message'].str.strip()

# 查看清洗后的数据

print(df_cleaned.head())

```

此代码中,我们首先使用Pandas的`read_csv`函数读取CSV文件中的日志数据,然后删除了无用的列,并使用`strip`方法处理了日志消息字段中的空白字符。

### 2.2.2 数据类型转换和格式统一

为了进行有效的数据分析和统计,需要将日志数据统一到相同的数据类型和格式。例如,时间戳字段应转换为统一的时间格式,数值字段应转换为数值类型等。

下面是一个将日志中的时间戳转换为Python标准`datetime`对象的示例:

```python

from datetime import datetime

# 将日志中的时间戳字符串转换为datetime对象

df_cleaned['timestamp'] = pd.to_datetime(df_cleaned['timestamp'])

# 验证转换

print(df_cleaned['timestamp'].head())

```

在这个例子中,我们使用了Pandas的`to_datetime`函数,该函数能够识别多种时间格式,并将其转换为统一的`datetime`对象,方便后续的时间序列分析。

## 2.3 日志数据的存储和检索

### 2.3.1 将日志存储到数据库

将日志存储到数据库是实现日志检索和分析的重要前提。可以选择多种类型的数据库,如关系型数据库MySQL、PostgreSQL或非关系型数据库MongoDB等。

下面是一个使用SQLite数据库的例子,演示如何将清洗后的日志数据存储到数据库中:

```python

import sqlite3

# 连接到SQLite数据库,如果文件不存在,会自动在当前目录创建:

conn = sqlite3.connect('log.db')

cursor = conn.cursor()

# 创建表格,假定日志有时间戳、级别和消息三个字段

cursor.execute('''

CREATE TABLE IF NOT EXISTS logs (

timestamp TEXT,

level TEXT,

message TEXT

)

''')

# 插入数据

cursor.executemany("INSERT INTO logs VALUES (?, ?, ?)",

[(row['timestamp'], row['level'], row['message']) for index, row in df_cleaned.iterrows()])

# 提交事务:

***mit()

# 关闭Cursor和Connection:

cursor.close()

conn.close()

```

在这段代码中,我们首先导入`sqlite3`模块,然后建立连接到SQLite数据库。我们创建了一个表格用于存储日志数据,并将清洗后的DataFrame数据插入到这个表中。

### 2.3.2 日志数据的快速检索技术

日志数据量通常很大,为了快速检索和查询,可以使用索引、分区和查询优化技术。

以PostgreSQL为例,下面是一个创建索引以加速日志数据查询的示例:

```sql

-- 假设日志数据存储在logs表中,我们对timestamp和level字段建立索引

CREATE INDEX IF NOT EXISTS idx_logs_timestamp_level ON logs (timestamp, level);

```

通过建立索引,可以大大加快基于时间戳和日志级别的查询操作。对于频繁进行的查询,可以针对查询条件建立复合索引,以提高查询性能。

此外,根据业务需求,还可以应用数据库的分区技术,将日志数据按照时间、类型或其他规则划分到不同的分区中,以此来提升查询和维护的效率。

# 3. 日志数据的统计分析技术

## 3.1 日志数据的统计分析基础

### 3.1.1 描述性统计分析的运用

描述性统计分析是日志分析中最基础的工具之一,它通过对日志数据集的基本特征进行描述和总结,为我们提供了一种快速理解数据集特性的方法。这些统计量包括但不限于均值、中位数、标准差、偏度和峰度等。在Python中,我们可以使用NumPy或Pandas库来进行描述性统计分析。

```python

import numpy as np

import pandas as pd

# 假设我们有一个包含日志数据的CSV文件

log_data = pd.read_csv('logs.csv')

# 基本的描述性统计

description = log_data.describe()

print(description)

```

在上述代码中,`describe` 方法会返回数据集的统计摘要,包括计数、平均值、标准差、最小值、四分位数和最大值。这些描述性的统计量有助于我们快速了解数据集的分布情况。

### 3.1.2 基于时间序列的分析方法

时间序列分析是处理和分析日志数据时非常有用的技术,尤其是当我们要对事件发生的时间模式进行分析时。Python中的`statsmodels`库提供了一系列时间序列分析的工具,例如ARIMA模型用于预测时间序列数据。

```python

import statsmodels.api as sm

from statsmodels.tsa.stattools import adfuller

# 使用ADF检验来测试时间序列的稳定性

adf_test_result = adfuller(log_data['timestamp'])

print('ADF Statistic: %f' % adf_test_result[0])

print('p-value: %f' % adf_test_result[1])

# 对时间序列数据进行差分以使其平稳

diff_log_data = log_data['timestamp'].diff().dropna()

# 可能的模型拟合过程

# model = sm.tsa.ARIMA(diff_log_data, order=(1,1,1))

# model_fit = model.fit()

```

0

0