SQLAlchemy并发控制实战:处理并发请求与数据库锁定的技巧

发布时间: 2024-10-17 17:16:27 阅读量: 28 订阅数: 38

# 1. SQLAlchemy并发控制概述

## 并发控制的必要性

在现代的IT应用中,尤其是在高并发的Web应用中,数据的一致性和完整性是至关重要的。SQLAlchemy作为Python中最强大的数据库工具之一,它提供了丰富的ORM特性,支持复杂的数据库操作。然而,随着并发访问的增加,数据库操作的并发控制成为了保证数据一致性的关键。并发控制不仅仅是数据库层面的问题,也涉及到应用层的合理设计和实现。

## SQL标准的并发控制

SQL标准定义了几种隔离级别,以平衡并发性和数据一致性。理解这些隔离级别对于实现有效的并发控制至关重要。例如,读未提交(Read Uncommitted)和可重复读(Repeatable Read)是两个极端,前者允许脏读,而后者则尝试避免。在实际应用中,开发者需要根据业务需求选择合适的隔离级别,以实现最佳的性能和数据一致性之间的平衡。

## SQLAlchemy的并发工具

SQLAlchemy提供了多种工具和API,以支持不同级别的并发控制。从底层的SQLAlchemy Core,到高级的ORM功能,开发者都可以找到合适的工具来管理数据库的并发访问。例如,通过事务管理,可以控制事务的边界,确保操作的原子性。通过会话(Session)管理,可以有效地管理并发访问的数据状态。本章将深入探讨SQLAlchemy中的并发控制机制,为后续章节的实践应用打下坚实的基础。

# 2. 理解SQLAlchemy中的并发问题

在本章节中,我们将深入探讨SQLAlchemy中的并发问题,这是任何使用SQLAlchemy进行数据库操作的开发者都必须面对的问题。我们将从数据库锁定机制开始,探讨锁的类型和级别,以及它们如何影响并发性能。然后,我们将分析事务的隔离级别,以及它们如何与并发控制相联系。最后,我们将回顾并发控制的理论基础,包括事务的ACID属性和并发控制的必要性。

## 2.1 数据库锁定机制

数据库锁定机制是确保数据一致性和防止竞争条件的关键技术。在这一部分,我们将介绍锁的类型和级别,以及它们对并发性能的影响。

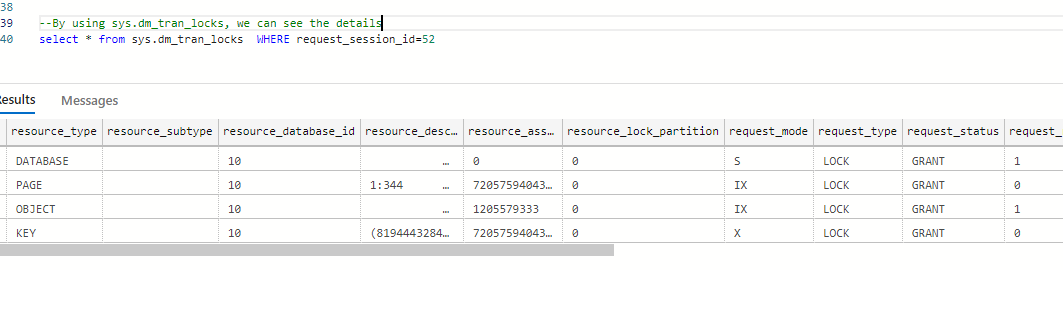

### 2.1.1 锁的类型和级别

在数据库系统中,锁可以分为共享锁(Shared Lock)和排他锁(Exclusive Lock)。

- **共享锁(Shared Lock)**:允许多个事务同时读取同一资源,但不允许修改。

- **排他锁(Exclusive Lock)**:防止其他事务读取或修改被锁定的资源。

锁的级别可以分为行级锁(Row-Level Lock)、页级锁(Page-Level Lock)和表级锁(Table-Level Lock)。

- **行级锁**:只锁定被操作的数据行,适用于高并发场景,因为影响的范围小。

- **页级锁**:锁定数据所在的页,适用于中等并发。

- **表级锁**:锁定整个表,适用于并发操作较少的情况。

### 2.1.2 锁定对并发性能的影响

锁机制对并发性能的影响主要体现在以下几个方面:

- **锁等待**:当一个事务尝试访问已被其他事务锁定的资源时,它必须等待,这会导致事务延迟。

- **锁争用**:如果多个事务频繁竞争同一资源,会导致锁争用,增加系统开销。

- **死锁**:当两个或多个事务相互等待对方释放锁时,可能会发生死锁,导致事务无法完成。

## 2.2 并发事务的隔离级别

事务的隔离级别定义了一个事务内操作的独立程度,以及它们如何与系统中的其他事务交互。

### 2.2.1 SQL标准隔离级别

SQL标准定义了四个隔离级别:

- **读未提交(Read Uncommitted)**:最低的隔离级别,允许读取未提交的数据变更,可能导致脏读。

- **读已提交(Read Committed)**:保证一个事务只能读取其他事务已提交的数据变更,避免了脏读,但可能导致不可重复读。

- **可重复读(Repeatable Read)**:保证在事务执行期间多次读取同一数据结果一致,避免了不可重复读,但可能导致幻读。

- **串行化(Serializable)**:最高的隔离级别,通过锁定读取的数据防止其他事务进行修改,可以避免脏读、不可重复读和幻读,但并发性能最低。

### 2.2.2 隔离级别与并发控制的关系

不同的隔离级别对并发控制的影响如下:

- **读未提交**:提供最高的并发性能,但牺牲了一致性。

- **读已提交**:在并发性能和数据一致性之间取得平衡。

- **可重复读**:进一步提高数据一致性,但牺牲了部分并发性能。

- **串行化**:提供了最强的数据一致性,但以牺牲并发性能为代价。

## 2.3 并发控制的理论基础

在深入并发控制的实践之前,我们需要了解其理论基础,特别是事务的ACID属性和并发控制的必要性。

### 2.3.1 事务的ACID属性

事务是数据库管理系统执行过程中的一个逻辑单位,必须满足ACID属性:

- **原子性(Atomicity)**:事务中的操作要么全部完成,要么全部不完成,不会留下中间状态。

- **一致性(Consistency)**:事务必须使数据库从一个一致性状态转换到另一个一致性状态。

- **隔离性(Isolation)**:事务的执行不能被其他事务干扰。

- **持久性(Durability)**:一旦事务提交,其所做的更改就会永久保存在数据库中。

### 2.3.2 并发控制的必要性

并发控制是确保数据库系统正确执行的关键技术,它解决以下问题:

- **数据一致性**:防止多个事务同时修改相同的数据导致的数据不一致问题。

- **系统性能**:通过合理的锁机制和隔离级别,平衡并发性能和数据一致性。

- **死锁预防**:检测和解决死锁,保证事务能够顺利完成。

在本章节中,我们介绍了SQLAlchemy中的并发问题,包括数据库锁定机制、并发事务的隔离级别以及并发控制的理论基础。这些知识对于理解如何在实践中实现高效的并发控制至关重要。在下一章节中,我们将深入探讨SQLAlchemy并发控制的实践应用,包括会话与事务管理、并发控制的编程实践以及高级应用。

# 3. SQLAlchemy并发控制实践

在本章节中,我们将深入探讨SQLAlchemy在实际应用中的并发控制实践。首先,我们会介绍SQLAlchemy会话与事务管理的基本概念,然后探讨如何通过编程实践来提高并发性。最后,我们将讨论并发控制的高级应用,包括事务回滚与重试逻辑以及分布式锁的应用。

## 3.1 SQLAlchemy会话与事务管理

在SQLAlchemy中,会话(Session)是ORM的核心,它代表了应用程序与数据库之间的交互。会话的生命周期涉及到创建、持久化、提交和关闭等状态。事务则是数据库操作的原子单元,它保证了一系列的操作要么全部成功,要么全部回滚。

### 3.1.1 会话的生命周期

会话的生命周期从创建开始,到提交或回滚事务,最后关闭会话结束。在SQLAlchemy中,可以通过以下方式创建一个会话实例:

```python

from sqlalchemy.orm import sessionmaker

from sqlalchemy import create_engine

# 创建数据库引擎

engine = create_engine('sqlite:///example.db')

# 创建会话工厂

Session = sessionmaker(bind=engine)

# 创建会话实例

session = Session()

```

会话的生命周期管理通常会在Web应用的请求/响应周期内进行,确保每个请求都有一个独立的会话和事务。

### 3.1.2 事务的创建和提交

事务的创建和提交是通过会话对象来管理的。默认情况下,会话的每次数据库操作都是在自动提交模式下进行的。但是,我们也可以手动创建一个事务,进行更细粒度的控制:

```python

# 手动创建事务

with session.begin():

# 执行一些数据库操作

session.add(new_object)

***mit() # 提交事务

```

如果发生异常,事务将会回滚,确保数据的一致性。

#

0

0