SQLAlchemy性能优化秘籍:提升数据库交互效率的6大技巧

发布时间: 2024-10-17 16:30:45 阅读量: 17 订阅数: 18

# 1. SQLAlchemy简介和安装

## 简介

SQLAlchemy是一个流行的Python SQL工具包和对象关系映射(ORM)库。它提供了强大的数据库操作接口,支持多种数据库后端,包括MySQL、PostgreSQL、SQLite等。SQLAlchemy的核心优势在于其灵活性和强大的数据模型定义能力,它允许开发者以声明式的方式定义数据模型,并将其映射到数据库表结构上。

## 安装

安装SQLAlchemy非常简单,可以通过Python的包管理工具pip进行安装。打开命令行工具,输入以下指令:

```bash

pip install SQLAlchemy

```

这条命令会安装SQLAlchemy及其依赖的库,安装完成后即可在Python项目中使用。

安装完成后,我们可以创建一个简单的例子来验证安装是否成功。在Python交互式环境中,输入以下代码:

```python

from sqlalchemy import create_engine

engine = create_engine('sqlite:///:memory:')

print(engine)

```

如果输出了Engine对象的信息,说明SQLAlchemy已经成功安装并可以使用。

# 2. SQLAlchemy基础操作

## 2.1 SQLAlchemy的数据模型

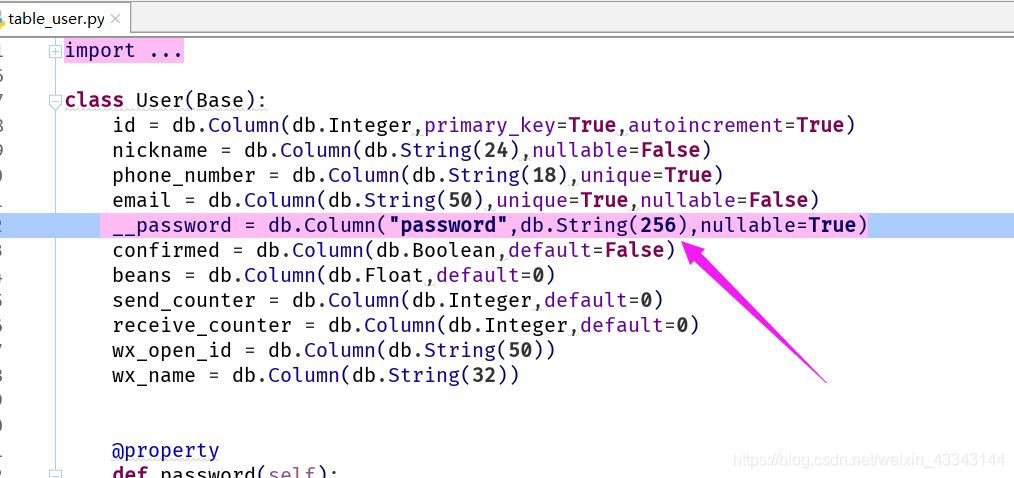

### 2.1.1 数据模型的定义和映射

在本章节中,我们将深入探讨SQLAlchemy的数据模型定义和映射。SQLAlchemy作为ORM(Object Relational Mapping)工具,其核心功能之一就是提供强大的数据模型映射能力。数据模型映射是指将Python中的类(Class)与数据库中的表(Table)进行关联的过程。

首先,我们需要定义一个数据模型类,这个类将继承自`declarative_base()`创建的基类。然后,通过为这个类添加属性来定义表中的列。每个属性都对应于数据库表中的一列,并且通过`Column`构造函数进行定义。

```python

from sqlalchemy import Column, Integer, String, create_engine

from sqlalchemy.ext.declarative import declarative_base

from sqlalchemy.orm import sessionmaker

Base = declarative_base()

class User(Base):

__tablename__ = 'users'

id = Column(Integer, primary_key=True)

name = Column(String)

fullname = Column(String)

nickname = Column(String)

def __init__(self, name, fullname, nickname):

self.name = name

self.fullname = fullname

self.nickname = nickname

engine = create_engine('sqlite:///example.db')

Base.metadata.create_all(engine)

Session = sessionmaker(bind=engine)

session = Session()

```

在上述代码中,我们定义了一个`User`类,它代表了数据库中的`users`表。每个实例化的`User`对象将映射到表中的一行数据。`__tablename__`属性定义了表的名称。`Column`对象定义了表的列,其中`primary_key=True`表示该列是主键。

映射过程的关键在于理解SQLAlchemy如何将Python对象和数据库表关联起来。当我们创建一个`User`类的实例并将其添加到会话中时,SQLAlchemy会自动将这个实例的属性转换为SQL语句,并执行数据库操作。

### 2.1.2 数据模型的查询和更新

数据模型的查询和更新是ORM工具的另一个重要功能。SQLAlchemy提供了一套丰富的方法来进行数据的查询和更新。

#### 查询

查询操作通常使用`session.query()`方法开始。这个方法返回一个`Query`对象,可以进行进一步的过滤、排序等操作。

```python

from sqlalchemy import select

# 创建一个查询,选择所有用户

users = session.query(User).all()

for user in users:

print(user.id, user.name, user.fullname, user.nickname)

```

在这个例子中,`session.query(User).all()`查询所有用户的信息。`all()`方法执行查询并返回一个列表,其中包含`User`类的实例。

#### 更新

更新操作则通过`filter()`方法来定位特定的对象,然后调用`update()`方法来进行数据的更新。

```python

# 更新用户信息

session.query(User).filter(User.id == 2).update({'name': 'newname'})

***mit()

```

在这个例子中,我们更新了ID为2的用户的`name`字段。`filter()`方法用于定位符合条件的记录,`update()`方法则更新了这些记录的值。最后,`***mit()`提交了这次变更。

总结来说,SQLAlchemy的数据模型定义和映射提供了将Python对象与数据库表关联的强大能力。通过定义类和属性,我们可以轻松地进行数据的查询和更新操作。下一节我们将继续探讨SQLAlchemy的会话管理,这是操作数据库不可或缺的一部分。

# 3. SQLAlchemy的高级特性

## 3.1 SQLAlchemy的关系映射

### 3.1.1 一对多和多对一的关系映射

在数据库设计中,关系映射是ORM的核心功能之一,它能够将数据库中的表关联起来,形成对象间的联系。在SQLAlchemy中,一对多和多对一的关系映射可以通过`relationship()`函数来实现。

#### *.*.*.* 一对多关系映射

一对多关系通常表示一个对象拥有多个子对象。例如,在博客系统中,一个用户可以发表多篇文章。

```python

from sqlalchemy import create_engine, Column, Integer, String, ForeignKey

from sqlalchemy.orm import sessionmaker, relationship

from sqlalchemy.ext.declarative import declarative_base

Base = declarative_base()

class User(Base):

__tablename__ = 'user'

id = Column(Integer, primary_key=True)

name = Column(String)

posts = relationship('Post', back_populates='author')

class Post(Base):

__tablename__ = 'post'

id = Column(Integer, primary_key=True)

title = Column(String)

content = Column(String)

user_id = Column(Integer, ForeignKey('user.id'))

author = relationship('User', back_populates='posts')

# 创建引擎和会话

engine = create_engine('sqlite:///example.db')

Session = sessionmaker(bind=engine)

session = Session()

# 创建表结构

Base.metadata.create_all(engine)

# 创建用户和文章的实例

new_user = User(name='John Doe')

new_post = Post(title='My First Post', content='This is the content of my first post.')

new_user.posts.append(new_post)

# 添加到数据库

session.add(new_user)

***mit()

```

在上述代码中,`User`类和`Post`类通过`relationship()`函数建立了`user.posts`和`post.author`的一对多关系。`ForeignKey`用于指定外键关系,即每个`Post`对象的`user_id`字段关联到`User`表的`id`字段。

#### *.*.*.* 多对一关系映射

多对一关系表示多个对象关联到一个对象。继续使用博客系统的例子,多篇文章可以关联到同一个用户。

```python

class Post(Base):

__tablename__ = 'post'

id = Column(Integer, primary_key=True)

title = Column(String)

content = Column(String)

user_id = Column(Integer, ForeignKey('user.id'))

author = relationship('User', back_populates='posts')

# 其他代码不变

```

在这个例子中,`Post`类的`user_id`字段通过`ForeignKey`指向`User`表的`id`字段,实现了多篇文章关联到一个用户的关系。

### 3.1.2 多对多的关系映射

多对多关系意味着多个对象可以关联到多个其他对象。在ORM中,通常需要一个关联表来存储这种关系。SQLAlchemy通过`Table`对象和`relationship()`函数的`secondary`参数来实现多对多映射。

#### *.*.*.* 多对多关系映射的定义

```python

from sqlalchemy import Table, Column, Integer, String, ForeignKey

from sqlalchemy.orm import relationship

tags = Table('tags', Base.metadata,

Column('tag_id', Integer, primary_key=True),

Column('post_id', Integer, ForeignKey('post.id'))

)

class Post(Base):

__tablename__ = 'post'

id = Column(Integer

```

0

0