ELLE:提升终身预训练效率与性能的新方法

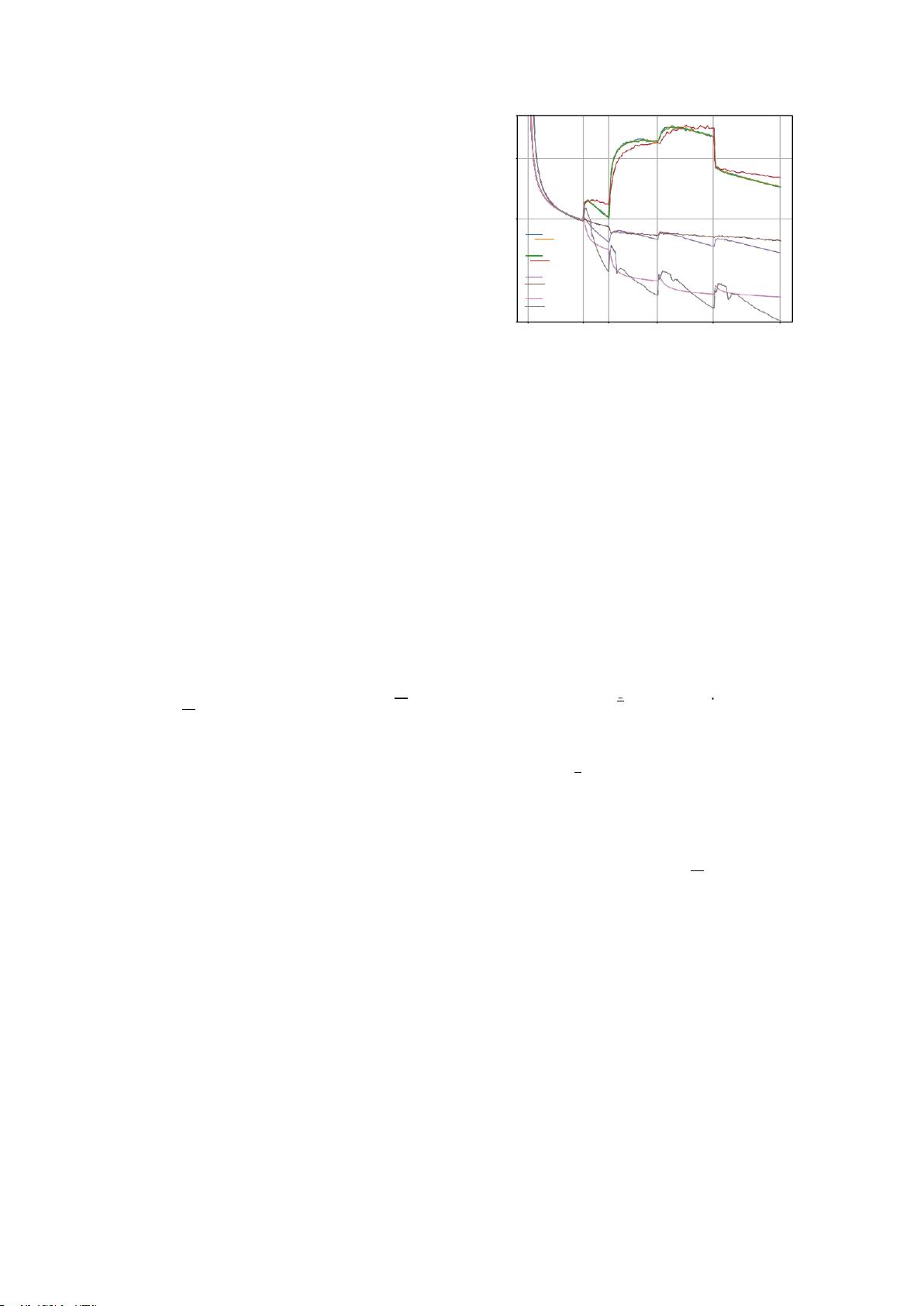

"ELLE:新兴数据的有效终身预训练" ELLE是一种新兴的数据终身预训练方法,旨在解决预训练语言模型(PLM)在面对不断增长的流数据时的效率和性能问题。传统的PLM通常使用静态数据集进行训练,但现实世界中的数据是动态更新的,比如文学作品、新闻报道和科学论文等。ELLE的目标是让PLM能够持续整合来自不同来源的新信息,以适应数据分布的变化,并保持模型的高效性和泛化能力。 为了实现这一目标,ELLE提出了“功能保留模型扩展”策略。这一策略允许模型在不损害已有知识的情况下,灵活地扩展其结构以适应新数据。通过这个方法,ELLE能够在现有PLM如BERT和GPT的基础上,有效地整合不同领域的流数据,而不必对所有数据进行全面的重新预训练,从而减少了计算成本。 实验在五个不同领域的流数据上对ELLE进行了测试,结果表明,ELLE在预训练效率和下游任务性能上均优于其他终身学习基线。这意味着,即使在资源有限的情况下,ELLE也能让模型保持学习新知识的能力,同时保持对旧知识的回忆,提升了模型的整体性能。 ELLE的实现代码已经开源,可从https://github.com/thunlp/ELLE获取。这一研究对预训练模型的发展具有重要意义,因为它提供了一种更加实用和经济的方法,使PLM能够适应不断变化的数据环境,对于自然语言处理领域的进步有着积极的推动作用。 引入终身学习的概念到PLM中,使得模型能够持续学习和适应新的信息,这对于应对现实世界中的NLP任务尤其重要。例如,随着新事件的发生,新闻数据会持续更新,ELLE可以使模型及时理解和处理这些新出现的话题。此外,科学文献的增加也需要模型能够迅速吸收新的专业术语和概念。通过ELLE,这些挑战可以得到有效的解决,模型的性能和实用性得到显著提升。 ELLE是一种创新的终身预训练框架,它解决了静态预训练模型面临的挑战,提高了对新兴数据的处理效率,并且保持了模型的性能。这一研究为未来NLP领域的发展提供了新的方向,即如何设计更高效、更适应数据变化的智能系统。

剩余25页未读,继续阅读

- 粉丝: 5

- 资源: 2万+

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- AirKiss技术详解:无线传递信息与智能家居连接

- Hibernate主键生成策略详解

- 操作系统实验:位示图法管理磁盘空闲空间

- JSON详解:数据交换的主流格式

- Win7安装Ubuntu双系统详细指南

- FPGA内部结构与工作原理探索

- 信用评分模型解析:WOE、IV与ROC

- 使用LVS+Keepalived构建高可用负载均衡集群

- 微信小程序驱动餐饮与服装业创新转型:便捷管理与低成本优势

- 机器学习入门指南:从基础到进阶

- 解决Win7 IIS配置错误500.22与0x80070032

- SQL-DFS:优化HDFS小文件存储的解决方案

- Hadoop、Hbase、Spark环境部署与主机配置详解

- Kisso:加密会话Cookie实现的单点登录SSO

- OpenCV读取与拼接多幅图像教程

- QT实战:轻松生成与解析JSON数据

信息提交成功

信息提交成功