AI之卷积神经网络基础之卷积神经网络基础

AI之卷积神经网络基础之卷积神经网络基础二维卷积层二维互相关运算二维卷积层互相关运算与卷积运算特征图与感受野填充和步幅填充步幅多输

入通道和多输出通道多输入通道多输出通道1×1卷积层卷积层与全连接层的对比卷积层的简洁实现池化二维池化层池化层的简

洁实现代码讲解例题

本文主要介绍卷积神经网络的基础概念,主要是卷积层卷积层和池化层池化层,并解释填充填充、步幅步幅、输入通道输入通道和输出通道输出通道的含义。

二维卷积层二维卷积层

本文介绍的是最常见的二维卷积层,常用于处理图像数据。

二维互相关运算二维互相关运算

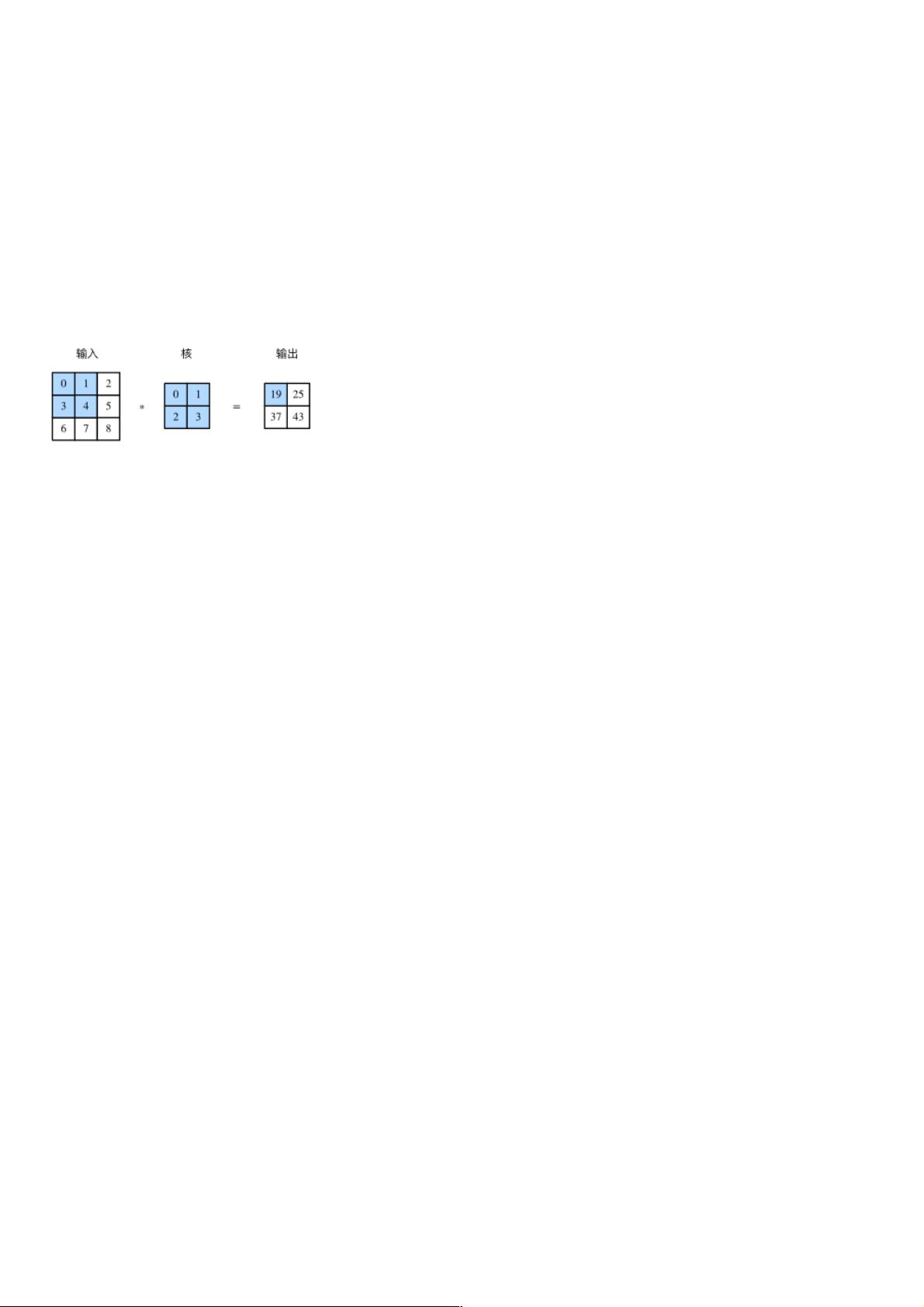

二维互相关(cross-correlation)运算的输入是一个二维输入数组和一个二维核(kernel)数组,输出也是一个二维数

组,其中核数组通常称为卷积核或过滤器(filter)。卷积核的尺寸通常小于输入数组,卷积核在输入数组上滑动,在每个位置

上,卷积核与该位置处的输入子数组按元素相乘并求和,得到输出数组中相应位置的元素。下图展示了一个互相关运算的例

子,阴影部分分别是输入的第一个计算区域、核数组以及对应的输出。

下面我们用corr2d函数实现二维互相关运算,它接受输入数组X与核数组K,并输出数组Y。

import torch

import torch.nn as nn

def corr2d(X, K):

H, W = X.shape

h, w = K.shape

Y = torch.zeros(H - h + 1, W - w + 1)

for i in range(Y.shape[0]):

for j in range(Y.shape[1]):

Y[i, j] = (X[i: i + h, j: j + w] * K).sum()

return Y

构造上图中的输入数组X、核数组K来验证二维互相关运算的输出。

X = torch.tensor([[0, 1, 2], [3, 4, 5], [6, 7, 8]])

K = torch.tensor([[0, 1], [2, 3]])

Y = corr2d(X, K)

print(Y)

二维卷积层二维卷积层

二维卷积层将输入和卷积核做互相关运算,并加上一个标量偏置来得到输出。卷积层的模型参数包括卷积核和标量偏置。

class Conv2D(nn.Module):

def __init__(self, kernel_size):

super(Conv2D, self).__init__()

self.weight = nn.Parameter(torch.randn(kernel_size))

self.bias = nn.Parameter(torch.randn(1))

def forward(self, x):

return corr2d(x, self.weight) + self.bias

下面我们看一个例子,我们构造一张6×8的图像,中间4列为黑(0),其余为白(1),希望检测到颜色边缘。我们的标

签是一个6×7的二维数组,第2列是1(从1到0的边缘),第6列是-1(从0到1的边缘)。

X = torch.ones(6, 8)

Y = torch.zeros(6, 7)

X[:, 2: 6] = 0

Y[:, 1] = 1

Y[:, 5] = -1

print(X)

print(Y)

希望学习一个1×2卷积层,通过卷积层来检测颜色边缘。

conv2d = Conv2D(kernel_size=(1, 2))

step = 30

lr = 0.01

for i in range(step):