Sparklyr更新与应用案例解析 - Javier Luraschi分享

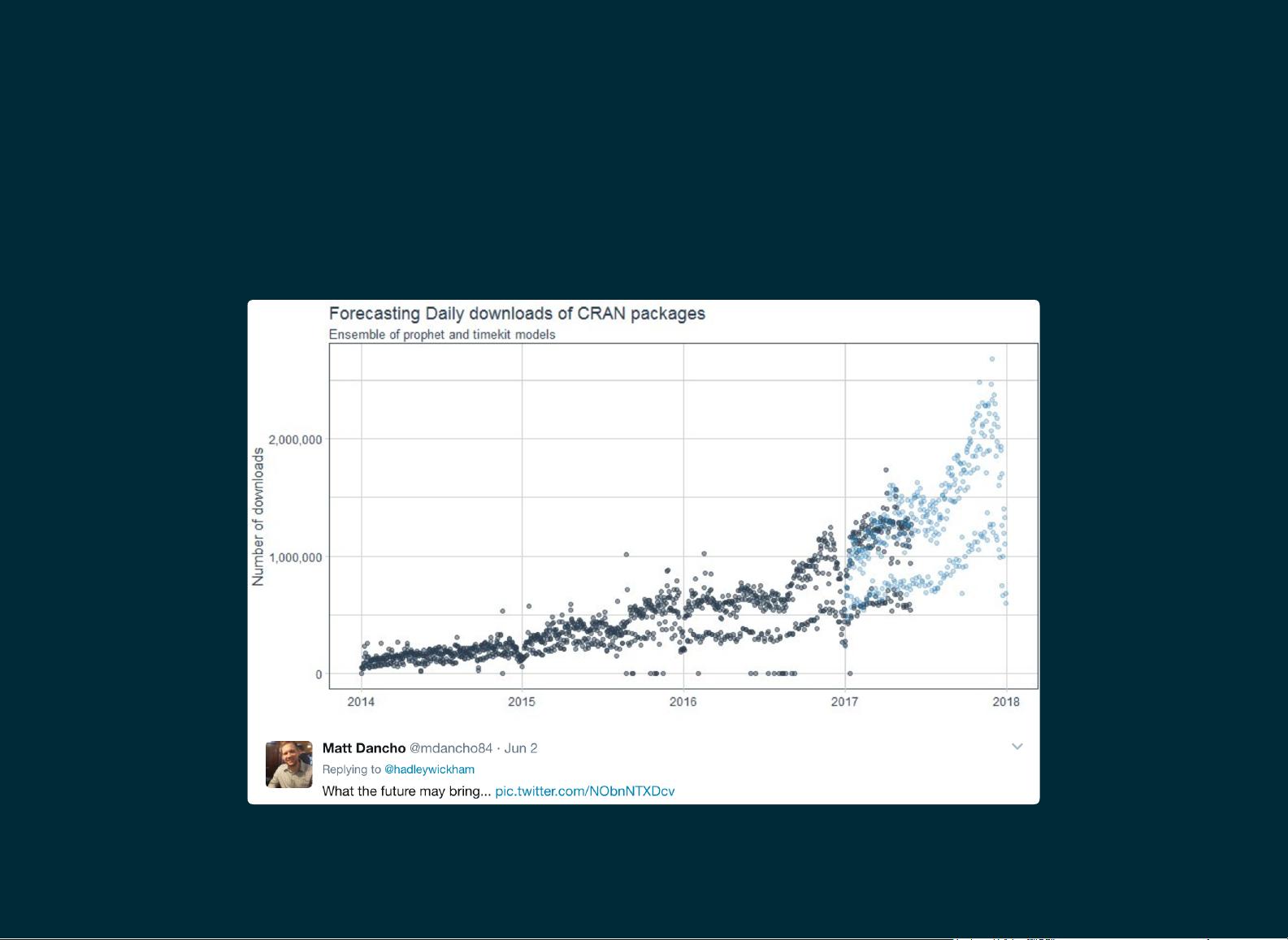

"本次分享是关于Sparklyr的回顾、更新和使用案例,由Javier Luraschi在2017年Spark Summit上呈现。Sparklyr是R语言与Apache Spark之间的接口,允许用户利用R的语法进行大规模数据处理和分析。" 在深入探讨Sparklyr之前,我们先了解一下背景知识。S语言是用于统计计算的设计,最初在贝尔实验室由John Chambers创建,当时主要通过调用Fortran子程序进行计算。然而,尽管有人认为严肃的数据分析会永远在Fortran中进行,但随着时间的推移,R语言作为S的现代版本,以其活跃的包贡献社区和CRAN(R的包管理器,拥有大约10,000个包)而闻名。R的设计原则强调一切皆对象、一切皆函数,以及R是许多(包括非R)算法的接口。 Sparklyr是R语言对Apache Spark的重要扩展,它允许R用户无缝地与Spark大数据处理框架交互。通过使用`spark_install()`函数安装Spark,然后使用`spark_connect()`建立连接,用户可以轻松地在本地或集群上启动Spark实例。接着,可以使用dplyr等数据操作库将数据导入Spark(如`copy_to(sc, mtcars)`),并对数据进行处理(如`count(mtcars_tbl)`)。 Sparklyr的一个关键特性是它提供了R风格的API,使得R用户能够以熟悉的方式进行分布式计算。例如,`ml_linear_regression()`函数用于在Spark上执行线性回归,其中`response`参数定义响应变量,`features`参数指定自变量。这使得R用户无需学习全新的Spark API,就能利用Spark的强大功能进行机器学习。 此外,Sparklyr不仅支持基本的数据操作和建模,还提供了高级功能,如跨Spark数据集的分布式统计测试、模型评估和调优。这些功能极大地拓宽了R用户的分析能力,使他们能够在处理大规模数据时保持高效率和灵活性。 使用案例方面,Sparklyr适用于各种场景,包括但不限于: 1. 大规模数据预处理:通过Sparklyr,用户可以方便地清洗、转换和整合大规模数据集,这在传统R环境中可能因内存限制而难以完成。 2. 数据挖掘和机器学习:利用Spark的并行计算能力,可以在大量数据上快速训练模型,如分类、回归和聚类。 3. 实时分析:与Spark Streaming结合,Sparklyr可用于实时数据分析,处理来自传感器、网络日志等的数据流。 4. 多节点集群部署:Sparklyr让R用户能够利用多节点集群,提高数据处理性能和可扩展性。 Sparklyr是连接R和Spark的重要桥梁,为R用户提供了处理大数据集的高效工具,同时保留了R语言的便利性和易用性。随着Spark和R社区的不断发展,Sparklyr的功能和应用场景也将持续扩展。

剩余25页未读,继续阅读

- 粉丝: 78

- 资源: 1万+

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- Hadoop生态系统与MapReduce详解

- MDS系列三相整流桥模块技术规格与特性

- MFC编程:指针与句柄获取全面解析

- LM06:多模4G高速数据模块,支持GSM至TD-LTE

- 使用Gradle与Nexus构建私有仓库

- JAVA编程规范指南:命名规则与文件样式

- EMC VNX5500 存储系统日常维护指南

- 大数据驱动的互联网用户体验深度管理策略

- 改进型Booth算法:32位浮点阵列乘法器的高速设计与算法比较

- H3CNE网络认证重点知识整理

- Linux环境下MongoDB的详细安装教程

- 压缩文法的等价变换与多余规则删除

- BRMS入门指南:JBOSS安装与基础操作详解

- Win7环境下Android开发环境配置全攻略

- SHT10 C语言程序与LCD1602显示实例及精度校准

- 反垃圾邮件技术:现状与前景

信息提交成功

信息提交成功