没有合适的资源?快使用搜索试试~ 我知道了~

首页关于Relu文章的理解翻译Deep Sparse Rectifier Neural Networks

资源详情

资源评论

资源推荐

http://proceedings.mlr.press/v15/glorot11a/glorot11a.pdf

This is a transcription of some ideas in Recifier Network Paper.

2 Background

2.1 Neuroscience Observations

对于生物学的神经元模型,激活函数是我们期望的发射率,因为它是一个当前

突触的输入信号产生的总输入(Dayan and Abott, 2001)。一个激活函数被称为反

对称或者对称的,当它对一个“非强刺激输入”的响应是强烈的抑制或者激

活,当对非强烈刺激输入的响应是 0 的时候它就是单边的。我们期望在计算神

经元模型和机器学习模型间的主要的差距包括以下:

关于脑力消耗的研究表明神经元在编码信息时是稀疏和分布式的(Attwell and

Laughlin, 2001),估计出同一时刻神经元被激活的比例介于 1~4%之间(Lennie,

2003)。这对应了表达的丰富度和小动作电位的能量消耗的折衷。在没有额外的

规则话,例如 L1 惩罚因子,一般的前向神经元并不带这项属性。例如,

sigmoid 激活在 0.5 附近有一个稳定的状态区间,因而在初始化了很小的权重

之后,所有的神经元在它们饱和范围的一半处被激活。这在生物学上是不合理

的并且不利于基于梯度的优化(LeCun et al., 1998; Bengio and Glorot, 2010)。

生物学和机器学习模型的重要分歧与非线性激活函数有关。一个常用的生物学

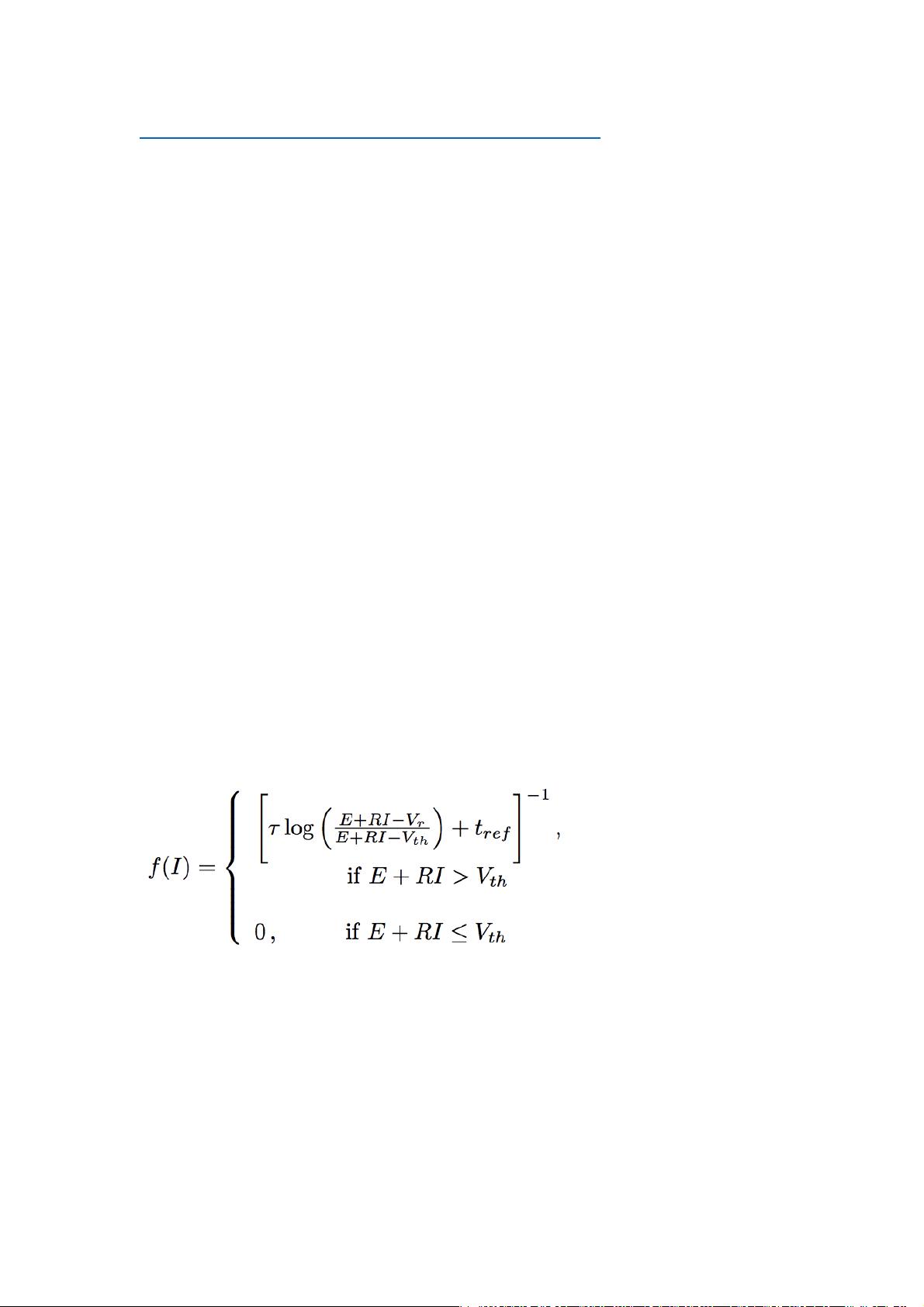

神经元模型,leakyintegrate-and-fire (LIF)(Dayan and Abott, 2001), 给出下

面关于激活率和输入流的关系

这里 t

ref

是不应期(refractoryperiod,在两次激活动作间的最小时间),I

是输入流,Vr是静息电位,Vth 是临界电位(满足 Vth>Vr),R,E,t 是膜电

阻,势电位和时间常量。深度学习和神经网络最常用的激活函数是标准的罗杰

斯第 sigmoid 和双曲正切(tanh),它们相当于一个线性变换。双曲正切在 0

处又一个稳定状态,故在优化的角度更可取(LeCun et al., 1998; Bengio and

Glorot, 2010),但是它在 0 附近强制制造出反对称,这在生物神经元里是反常

的。

popoala

- 粉丝: 22

- 资源: 12

上传资源 快速赚钱

我的内容管理

收起

我的内容管理

收起

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

会员权益专享

最新资源

- RTL8188FU-Linux-v5.7.4.2-36687.20200602.tar(20765).gz

- c++校园超市商品信息管理系统课程设计说明书(含源代码) (2).pdf

- 建筑供配电系统相关课件.pptx

- 企业管理规章制度及管理模式.doc

- vb打开摄像头.doc

- 云计算-可信计算中认证协议改进方案.pdf

- [详细完整版]单片机编程4.ppt

- c语言常用算法.pdf

- c++经典程序代码大全.pdf

- 单片机数字时钟资料.doc

- 11项目管理前沿1.0.pptx

- 基于ssm的“魅力”繁峙宣传网站的设计与实现论文.doc

- 智慧交通综合解决方案.pptx

- 建筑防潮设计-PowerPointPresentati.pptx

- SPC统计过程控制程序.pptx

- SPC统计方法基础知识.pptx

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功

评论1