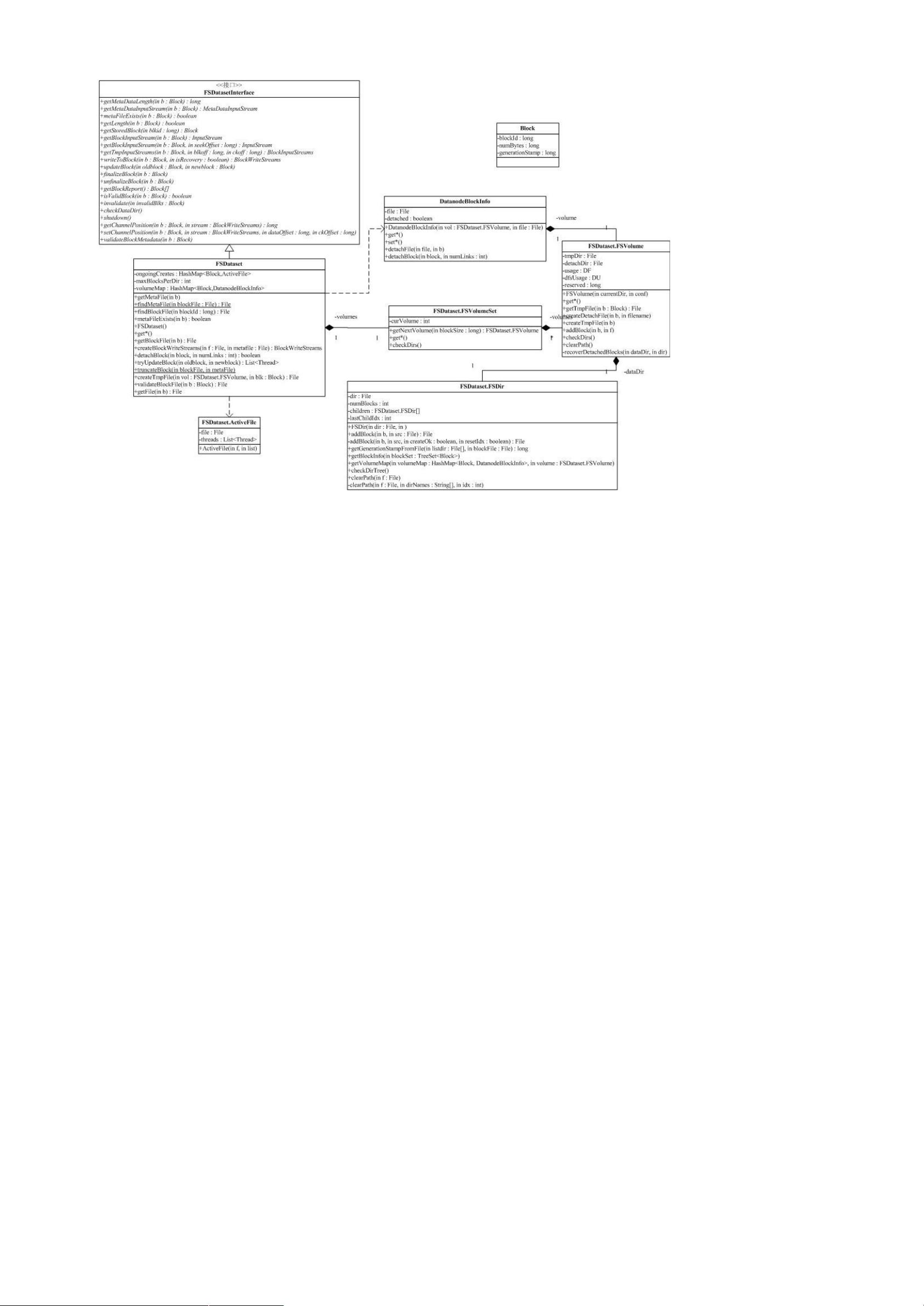

"Hadoop源代码分析" Hadoop是开源的分布式计算框架,它借鉴了Google的五大核心技术,包括Chubby、GFS、BigTable和MapReduce,并在Apache社区发展成为了一个广泛使用的项目。Hadoop主要由两个核心组件构成:HDFS(Hadoop Distributed File System)和MapReduce,它们共同构建了一个能够处理和存储大量数据的分布式环境。 HDFS是一个分布式文件系统,它是Hadoop项目的基础,允许数据在多台服务器之间进行分布式存储和访问。HDFS的设计目标是高容错性和高吞吐量,适合大数据处理场景。通过HDFS,应用程序可以透明地访问分布在不同节点上的数据,而无需关心底层的分布式细节。 MapReduce是Hadoop中的并行计算模型,它将复杂的计算任务分解为两个阶段:Map和Reduce。Map阶段将输入数据拆分为键值对,然后对每个键执行一个函数。Reduce阶段聚合Map阶段的结果,通常用于汇总或聚合数据。这种设计使得Hadoop能够处理大规模的数据集,同时保持良好的可扩展性。 在Hadoop源代码中,`fs`包提供了文件系统接口,它抽象了不同类型的文件系统,包括本地文件系统和分布式文件系统如HDFS。`ipc`包则负责远程过程调用(RPC),是Hadoop中节点间通信的重要组成部分。`mapreduce`包包含了MapReduce的实现,包括作业提交、任务调度和数据分发等功能。 在Hadoop的包结构中,依赖关系复杂,例如`conf`包依赖于`fs`来读取配置文件,因为配置文件可能存储在文件系统中。这种蜘蛛网型的依赖关系增加了理解源代码的难度,但同时也体现了Hadoop的高度模块化和灵活性。 Hadoop的关键组件包括`hdfs`、`mapred`、`common`等,这些都是分析Hadoop源代码的重点。`hdfs`包涉及HDFS的实现,`mapred`包包含了MapReduce的具体实现,`common`包则是一些通用工具和类,如网络通信、配置管理等。 通过对Hadoop源代码的深入分析,开发者可以更好地理解其内部工作机制,从而优化性能、修复问题或者开发新的功能。对于想要学习分布式计算和大数据处理的人员来说,Hadoop源代码分析是一个有价值的参考资料。此外,Hadoop的生态系统还包括许多其他组件,如HBase(分布式数据库)、ZooKeeper(分布式协调服务)和Hive(数据仓库工具),它们都是构建大规模数据处理系统的重要部分。

剩余63页未读,继续阅读

- 粉丝: 3

- 资源: 1

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- AirKiss技术详解:无线传递信息与智能家居连接

- Hibernate主键生成策略详解

- 操作系统实验:位示图法管理磁盘空闲空间

- JSON详解:数据交换的主流格式

- Win7安装Ubuntu双系统详细指南

- FPGA内部结构与工作原理探索

- 信用评分模型解析:WOE、IV与ROC

- 使用LVS+Keepalived构建高可用负载均衡集群

- 微信小程序驱动餐饮与服装业创新转型:便捷管理与低成本优势

- 机器学习入门指南:从基础到进阶

- 解决Win7 IIS配置错误500.22与0x80070032

- SQL-DFS:优化HDFS小文件存储的解决方案

- Hadoop、Hbase、Spark环境部署与主机配置详解

- Kisso:加密会话Cookie实现的单点登录SSO

- OpenCV读取与拼接多幅图像教程

- QT实战:轻松生成与解析JSON数据

信息提交成功

信息提交成功