拟合函数复杂度分析:平衡精度与效率,一文读懂

发布时间: 2024-07-11 08:59:31 阅读量: 60 订阅数: 33

# 1. 拟合函数简介**

**1.1 拟合函数的概念与分类**

拟合函数是一种数学模型,用于描述一组给定数据点之间的关系。其目标是找到一条曲线或曲面,尽可能接近这些数据点。拟合函数可分为两类:参数化拟合和非参数化拟合。参数化拟合假设数据点遵循特定的函数形式,如线性函数或多项式函数。非参数化拟合不假设任何特定的函数形式,而是直接从数据点中学习关系。

**1.2 拟合函数的评价指标**

拟合函数的优劣可以通过多种指标来衡量,包括均方误差 (MSE)、均方根误差 (RMSE)、决定系数 (R²) 和调整后的 R²。MSE 和 RMSE 衡量预测值与实际值之间的差异,而 R² 和调整后的 R² 衡量拟合函数解释数据变异的能力。

# 2. 拟合函数的理论基础

拟合函数作为机器学习中的重要工具,其理论基础为统计学和优化理论。本章节将深入探讨拟合函数的理论基础,包括最小二乘法原理、正则化技术以及模型选择与交叉验证。

### 2.1 最小二乘法原理

最小二乘法是一种常见的拟合函数方法,其目的是找到一条曲线或超平面,使曲线或超平面与给定数据点的平方误差最小。具体来说,给定一组数据点 $(x_1, y_1), (x_2, y_2), ..., (x_n, y_n)$, 最小二乘法将找到一条曲线或超平面 $f(x)$, 使得以下目标函数最小化:

```

J(f) = \sum_{i=1}^n (y_i - f(x_i))^2

```

其中,$y_i$ 为数据点的真实值,$f(x_i)$ 为拟合曲线的预测值。

**代码块:**

```python

import numpy as np

from sklearn.linear_model import LinearRegression

# 数据点

data = np.array([[1, 1], [2, 2], [3, 3]])

# 创建线性回归模型

model = LinearRegression()

# 拟合模型

model.fit(data[:, 0].reshape(-1, 1), data[:, 1])

# 预测值

y_pred = model.predict(data[:, 0].reshape(-1, 1))

# 计算平方误差

mse = np.mean((y_pred - data[:, 1]) ** 2)

print(mse)

```

**逻辑分析:**

这段代码使用最小二乘法原理拟合了一条线性回归曲线。首先,它创建了一个线性回归模型,然后使用给定的数据点拟合模型。最后,它计算了模型预测值与真实值之间的平方误差。

### 2.2 正则化技术

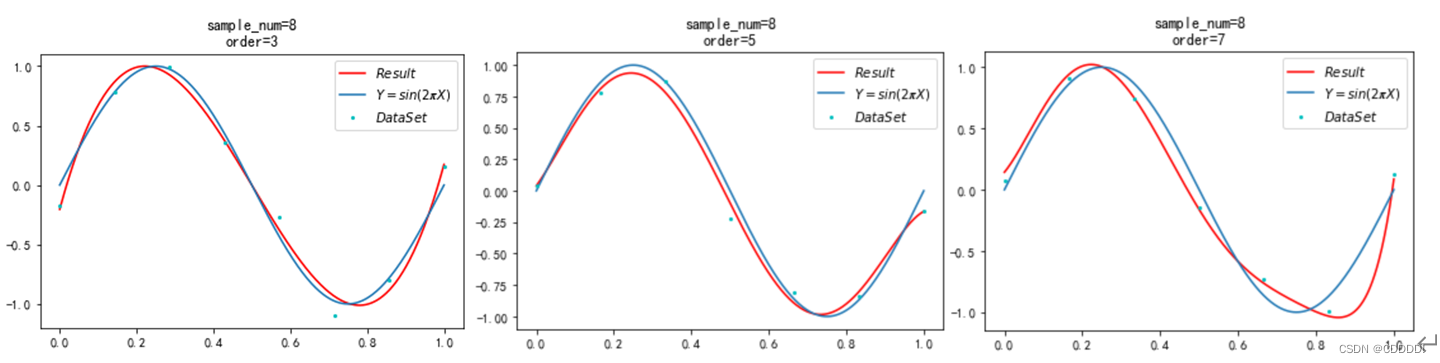

正则化是一种技术,用于防止拟合函数过度拟合数据。过度拟合是指拟合函数过于复杂,以至于它可以完美拟合训练数据,但无法很好地泛化到新数据。正则化通过向目标函数添加一个惩罚项来解决这个问题,该惩罚项与模型的复杂度成正比。

**代码块:**

```python

from sklearn.linear_model import Lasso

# 数据点

data = np.array([[1, 1], [2, 2], [3, 3]])

# 创建 Lasso 回归模型

model = Lasso(alpha=0.1)

# 拟合模型

model.fit(data[:, 0].reshape(-1, 1), data[:, 1])

# 预测值

y_pred = model.predict(data[:, 0].reshape(-1, 1))

# 计算平方误差

mse = np.mean((y_pred - data[:, 1]) ** 2)

print(mse)

```

**逻辑分析:**

这段代码使用 Lasso 正则化技术拟合了一条线性回归曲线。Lasso 正则化通过向目标函数添加一个惩罚项来防止过度拟合,该惩罚项与模型权重的绝对值成正比。

### 2.3 模型选择与交叉验证

模型选择是选择最适合给定数据集的拟合函数模型的过程。交叉验证是一种技术,用于评估模型的泛化能力。交叉验证将数据分成多个子集,然后使用其中一个子集作为测试集,其余子集作为训练集。该过程重复多次,每次使用不同的子集作为测试集。

**代码块:**

```python

from sklearn.model_selection import cross_val_score

# 数据点

data = np.arra

```

0

0