【聚类分析深度探讨】:深度学习与传统方法的优劣对比研究

发布时间: 2024-09-02 07:46:18 阅读量: 193 订阅数: 59

# 1. 聚类分析基础与应用场景

聚类分析是数据挖掘中的一项重要技术,它通过将数据集中的样本划分为多个类别或簇,帮助我们理解数据的内在结构和分布。本章将介绍聚类分析的基础知识,并探讨其在不同领域的应用。

## 1.1 聚类分析简介

聚类分析,也被称作无监督学习的一种形式,其目的是让相似的数据点聚集在一起,而将不相似的数据点分开。这种方法不需要预先标记的训练数据集,完全依赖于数据的自然分布和特征进行分类。

## 1.2 应用场景探索

聚类分析广泛应用于市场细分、社交网络分析、图像分割、搜索引擎优化等多个领域。例如,在市场细分中,聚类帮助识别不同消费者群体,以实现更精准的营销策略。

## 1.3 聚类与分类的区别

值得注意的是,聚类与分类有本质的不同。分类问题是有监督学习问题,它依赖于带有标签的训练数据;而聚类问题则是在无监督的情况下进行的,无需预先标签信息。

聚类技术的进一步应用和深入研究,将在后面章节中详细介绍。通过理解聚类分析的基础和应用,我们能更好地把握数据内在模式,并为各种应用场景提供有效的解决方案。

# 2. 传统聚类方法的理论与实践

在深入探讨聚类分析时,传统方法为我们提供了一套坚实的基础。本章将详细阐述几种传统聚类方法,包括它们的理论基础、优缺点,以及如何在实际问题中应用这些方法。

## 2.1 K-means算法详解

### 2.1.1 K-means算法原理

K-means算法是一种广泛使用的聚类技术,其核心思想是将数据集划分为K个簇,使得每个数据点属于离它最近的均值所代表的簇。该算法的步骤可以概括为:

1. 初始化:随机选择K个数据点作为初始聚类中心。

2. 分配:将每个数据点分配给最近的聚类中心,形成K个簇。

3. 更新:重新计算每个簇的中心点。

4. 迭代:重复步骤2和步骤3,直到聚类中心不再变化或者达到预设的迭代次数。

### 2.1.2 K-means算法的优缺点

K-means算法的优点包括:

- 简单易懂,易于实现。

- 计算效率高,适用于大数据集。

- 结果相对稳定。

然而,K-means也存在一些缺点:

- 聚类数量K需要预先设定,可能需要多次尝试。

- 对噪声和异常值敏感。

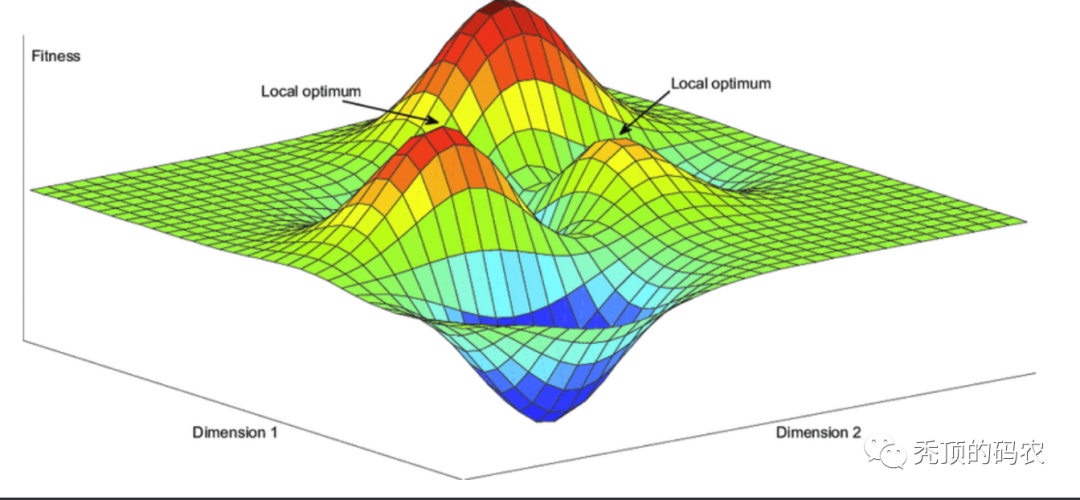

- 可能会陷入局部最优解。

### 2.1.3 K-means算法的实践应用

在实践应用中,K-means算法可以帮助我们解决如下问题:

- 客户细分:通过购买历史、行为模式等对客户进行细分,以实现个性化营销。

- 图像分割:将图像划分为多个区域,每个区域代表不同的物体或场景。

- 文档聚类:将文档集划分为几个主题群组,简化信息检索和管理。

一个典型的Python代码实现如下:

```python

from sklearn.cluster import KMeans

import numpy as np

# 创建一个二维数组作为示例数据

X = np.array([[1, 2], [1, 4], [1, 0],

[10, 2], [10, 4], [10, 0]])

# 初始化KMeans实例,指定聚类数量为2

kmeans = KMeans(n_clusters=2, random_state=0).fit(X)

# 输出聚类中心

print("Cluster centers:")

print(kmeans.cluster_centers_)

```

## 2.2 层次聚类的深入分析

### 2.2.1 层次聚类的工作原理

层次聚类是一种通过构建层次的嵌套簇来分析数据的聚类方法。其工作原理可以分为两种主要类型:

- 聚合(AGNES,自底向上):开始时将每个数据点作为单独的簇,然后逐步合并这些簇。

- 分裂(DIANA,自顶向下):一开始将所有数据点合并成一个簇,然后逐步分裂这些簇。

### 2.2.2 层次聚类的适用场景

层次聚类适合用于:

- 数据量不是特别大的情况,因为它的时间复杂度较高。

- 需要构建数据层次关系,对聚类结果的层次结构有要求的情况。

- 对结果的解释性要求较高。

### 2.2.3 层次聚类在实践中的挑战

尽管层次聚类提供了对数据聚类层次结构的深入理解,它同样存在一些挑战:

- 高时间复杂度:特别是对于大数据集,层次聚类的时间消耗是一个问题。

- 存储开销:所有数据点都需要存储,导致内存消耗大。

- 无法逆转:一旦簇被合并或分裂,这个过程就无法逆转。

## 2.3 密度聚类方法探索

### 2.3.1 DBSCAN算法核心概念

DBSCAN(Density-Based Spatial Clustering of Applications with Noise)是一种基于密度的聚类方法,它的核心思想是将高密度的区域划分为簇,而将低密度区域(即噪声)标记为异常点。

### 2.3.2 DBSCAN算法的优势与局限性

DBSCAN算法的优势包括:

- 不需要预先指定簇的数量。

- 能够识别任意形状的簇。

- 对噪声和异常值不敏感。

局限性则在于:

- 需要精心选择参数ε(邻域半径)和MinPts(形成密集区域所需的最小点数)。

- 对于不同密度的簇效果不佳。

- 计算复杂度较高,对大数据集来说效率较低。

### 2.3.3 DBSCAN算法的实际案例分析

DBSCAN算法可以用于多种场景,例如:

- 客户细分:识别客户群体中的自然聚类。

- 异常检测:识别数据集中的异常值。

- 图像分析:将具有相似颜色和纹理的图像区域分组。

下面是一个DBSCAN聚类算法的示例实现:

```python

from sklearn.cluster import DBSCAN

import numpy as np

# 生成随机数据

X = np.random.rand(100, 2)

# 初始化DBSCAN实例,选择合适的参数

db = DBSCAN(eps=0.3, min_samples=10).fit(X)

# 输出聚类结果

labels = db.labels_

```

在本章节中,我们详细探讨了三种主要的传统聚类方法:K-means、层次聚类和DBSCAN。每种方法都有其独特的原理、优缺点以及适用场景。在实践过程中,选择合适的聚类算法需要根据具体的数据特征和业务需求。接下来的章节中,我们将探讨深度学习如何在聚类领域开辟新的应用前景。

# 3. 深度

0

0