【图解深度学习优势】:如何在图像识别中显著超越传统机器学习

发布时间: 2024-09-02 07:07:43 阅读量: 411 订阅数: 97

# 1. 深度学习在图像识别中的崛起

## 1.1 从概念到突破

深度学习在图像识别领域所取得的突破,可视为人工智能发展历程中的一座里程碑。它代表了一种对信息进行高维非线性处理的强大能力,其中最重要的技术进展之一就是卷积神经网络(CNN)。通过层层数据处理,CNN能够自动从图像中提取特征,并用于识别、分类等多种任务。

## 1.2 应用广度与精度提升

深度学习不仅仅局限于简单的图像识别任务,它在医学图像分析、自动驾驶、无人机视觉等复杂场景中的应用正变得越来越广泛。随着网络结构的创新和计算能力的增强,深度学习模型的识别精度和处理速度都有了显著的提升。

## 1.3 理论到实践的演化

图像识别中的深度学习成功之处在于,它将理论研究与实际应用紧密联系起来。算法的每一次进步都带来了实际应用的飞跃。例如,图像分割、姿态估计、场景理解等领域中,深度学习都展现了其独特的优势和潜力。下一章节,我们将深入探讨深度学习与传统机器学习方法的理论对比。

# 2. 深度学习与传统机器学习的理论对比

### 2.1 机器学习基础回顾

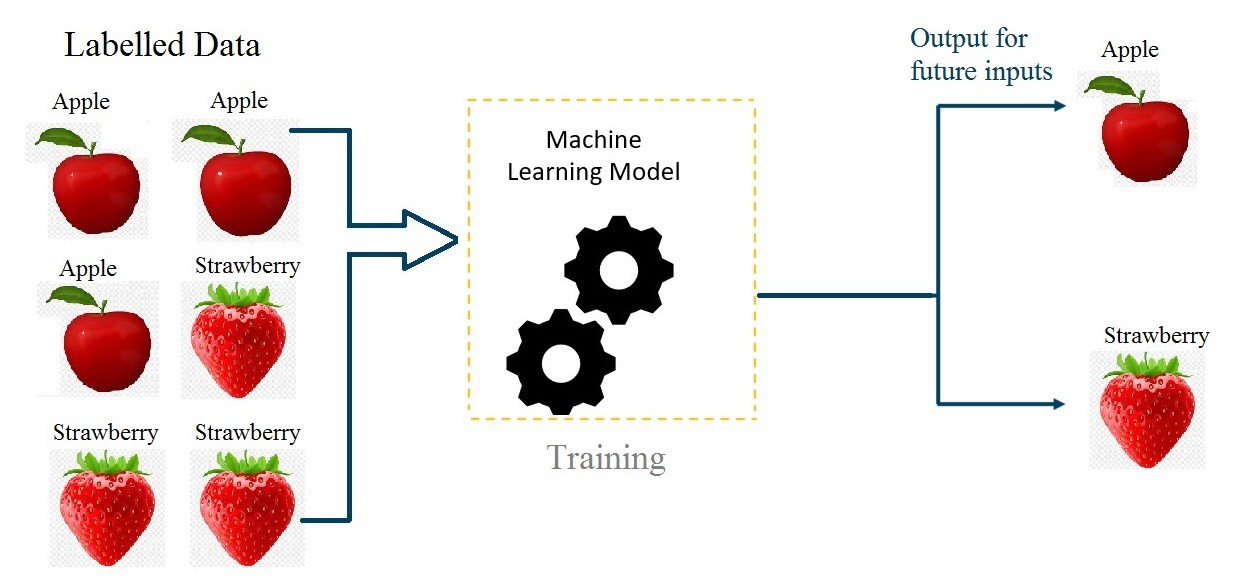

#### 2.1.1 传统机器学习的原理

传统机器学习方法通常依赖于手工设计的特征,通过统计和模式识别算法来实现数据分类或回归任务。这些算法包括支持向量机(SVM)、决策树、随机森林、k-最近邻(k-NN)等。这些方法在处理图像识别问题时,通常需要专家知识来提取特征,如使用SIFT、HOG等技术提取图像中的关键点和描述符。

#### 2.1.2 传统机器学习在图像识别的局限性

传统机器学习在图像识别领域的主要局限性在于其对特征工程的依赖。人工设计的特征可能无法覆盖所有有用的视觉信息,且对于图像的旋转、缩放、平移等变换较为敏感。此外,当面对高维数据和复杂模式时,传统方法往往难以捕捉数据的内在结构,导致模型性能受限。

### 2.2 深度学习的理论基础

#### 2.2.1 神经网络的基本概念

神经网络是一种模仿人脑进行信息处理的算法结构,由大量的神经元(节点)互相连接构成。深度学习是机器学习的一个分支,专注于利用深层的神经网络来解决复杂的模式识别问题。深度神经网络通过多个隐藏层来逐层提取数据的特征,具有更强的特征学习能力。

#### 2.2.2 卷积神经网络(CNN)在图像识别中的应用

卷积神经网络(CNN)是深度学习中用于图像识别的最重要网络结构。CNN通过卷积层来自动学习图像的层级特征,从低级的边缘和纹理到高级的模式和对象部件。CNN特别适合处理具有网格状拓扑结构的数据,例如图像,能够有效处理图像中的局部相关性,并具有平移不变性,这对于图像识别任务至关重要。

### 2.3 理论对比分析

#### 2.3.1 特征提取与学习能力

在特征提取方面,传统机器学习方法依赖于专家手动设计的特征,而深度学习则通过神经网络自动学习数据的复杂特征。这一过程通常需要大量的数据和计算资源,但其优势在于能够发现那些传统方法难以捕捉的深层次特征。

#### 2.3.2 模型复杂度与泛化能力

传统机器学习模型通常较为简单,易于理解和实现,但其泛化能力受限于特征的选取。深度学习模型虽然结构复杂,参数众多,但通过深度结构可以捕获数据的深层表示,从而具备更强的泛化能力。然而,这也使得深度学习模型容易出现过拟合问题,需要通过正则化、Dropout等技术来控制模型的复杂度。

### 代码块示例与分析

```python

import tensorflow as tf

from tensorflow.keras import layers, models

# 构建一个简单的卷积神经网络模型

model = models.Sequential([

layers.Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.Flatten(),

layers.Dense(64, activation='relu'),

layers.Dense(10, activation='softmax')

])

***pile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

```

在这个例子中,我们使用了Keras框架构建了一个简单的CNN模型,其主要包含了3个卷积层和2个池化层,用以提取图像特征,以及两个全连接层来进行分类。在构建深度学习模型时,选择合适的层类型和参数对于模型性能至关重要,例如卷积核大小、步长、激活函数等。

### 表格展示

| 序号 | 层类型 | 核大小 | 步长 | 输出特征图大小 | 激活函数 |

|------|--------------|--------|------|----------------|----------|

| 1 | 卷积层(Conv2D) | (3, 3) | 1 | 26 x 26 x 32 | ReLU |

| 2 | 池化层(MaxPooling2D) | (2, 2) | 2 | 13 x 13 x 32 | 无 |

| 3 | 卷积层(Conv2D) | (3, 3) | 1 | 11 x 11 x 64 | ReLU |

| 4 | 池化层(MaxPooling2D) | (2, 2) | 2 | 5 x 5 x 64 | 无 |

| 5 | 卷积层(Conv2D) | (3, 3) | 1 | 3 x 3 x 64 | ReLU |

| 6 | 全连接层(Dense) | - | - | - | ReLU |

| 7 | 输出层(Dense) | - | - | - | Softmax |

此表格展示了前面代码块中CNN模型的各个层的详细参数,帮助理解模型结构和数据流动。

### mermaid流程图

```mermaid

graph TD

A[输入层] -->|卷积| B[卷积层1]

B -->|池化| C[池化层1]

C -->|卷积| D[卷积层2]

D -->|池化| E[池化层2]

E -->|卷积| F[卷积层3]

F --> G[全连接层]

G --> H[输出层]

```

这个流程图展示了CNN中数据如何从输入层通过卷积和池化层,逐步提取特征,并最终通过全连接层生成分类结果。

# 3. 深度学习在图像识别中的实践应用

在深度学习领域,图像识别是应用最为广泛的分支之一。它的核心是通过构建强大的深度神经网络模型来实现对图像中内容的理解和分类。本章节将详细探讨实现深度学习模型的具体步骤,通过实战案例分析深度学习技术在图像识别中的应用,并讨论在实践过程中遇到的挑战及应对优化策略。

## 3.1 实现深度学习模型的步骤

### 3.1.1 数据预处理和增强

数据是深度学习模型的“食物”,数据的质量和多样性直接影响模型的性能。在图像识别任务中,数据预处理和增强是至关重要的第一步。

图像预处理通常包括调整图像尺寸、归一化像素值、编码图像类型(例如,将彩色图像转换为灰度图像或进行数据类型转换)等。归一化是将输入数据缩放到特定范围,通常是[0, 1]或[-1, 1],这有助于加快训练速度并提高模型的收敛性能。

而图像增强技术包括旋转、缩放、平移、翻转、剪裁、色彩变换等方法,用于人为地增加数据集的多样性和大小,避免模型过拟合,并提高模型的泛化能力。

```python

import numpy as np

from PIL import Image

# 图像预处理函数

def preprocess_image(image_path, target_size):

image = Image.open(image_path).convert('RGB')

image = image.resize(target_size)

image_array = np.array(image) / 255.0 # 归一化到 [0, 1]

return image_array

# 图像增强函数(简单示例)

def augment_image(image_array):

# 假设我们应用一个简单的水平翻转作为增强

return np.fliplr(image_array)

# 使用预处理函数

image_path = 'path_to_your_image.jpg'

processed_image = preprocess_image(image_path, (224, 224))

# 使用增强函数

augmented_image = augment_image(processed_image)

```

### 3.1.2 模型的选择与构建

选择一个合适的深度学习架构对于图像识别任务的成功至关重要。卷积神经网络(CNN)是目前最流行且有效的架构之一。构建CNN模型通常包括定义一系列卷积层、激活函数、池化层和全连接层。

Keras等高级API库为我们提供了快速构建CNN模型的能力。以Keras为例,我们可以简单地使用序列API或函数式API来搭建模型。

```python

from keras.models import Sequential

from keras.layers import Conv2D, MaxPooling2D, Flatten, Dense

# 构建简单的CNN模型

model = Sequential([

Conv2D(32, (3, 3), activation='relu', input_shape=(224, 224, 3)),

MaxPooling2D(2, 2),

Conv2D(64, (3, 3), activation='relu'),

MaxPooling2D(2, 2),

Flatten(),

Dense(128, activation='relu'),

Dense(num_classes, activation='softmax') # num_classes是类别的总数

])

# 编译模型

***pile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])

```

## 3.2 深度学习图像识别实战案例

### 3.2.1 人脸识别

人脸识别技术近年来得到了极大的发展,从简单的面部特征匹配到复杂的表情和年龄识别,深度学习都起到了关键作用。通常,这需要使用预训练的深度神经网络模型,如FaceNet或DeepFace等,它们可以直接用于提取面部特征,并进行高效的匹配。

### 3.2.2 物体检测与分类

物体检测与分类是图像识别的另一重要应用。与图像分类不同,物体检测需要识别出图像中的所有感兴趣物体,并为每个物体标记类别和位置。YOLO(You Only Look Once)和SSD(Single Shot MultiBox Detector)等模型在这一领域中取得了显著成就。

## 3.3 实践中的挑战与优化

### 3.3.1 过拟合与欠拟合问题

在训练深度学习模型时,可能会遇到过拟合和欠拟合的问题。过拟合是指模型在训练数据上表现得很好,但在未见过的数据上表现不佳。欠拟合则相反,模型在训练和测试数据上都表现不好。

为了解决这些问题,通常会采取数据增强、提前停止(early stopping)、正则化(如L1、L2正则化)和dropout技术等方法。

### 3.3.2 模型的训练技巧与优化方法

深度学习模型的训练涉及多个参数设置,如学习率、批次大小(batch size)、优化器选择等。选择合适的学习率对于模型训练至关重要。常用的优化器包括SGD、Adam、RMSprop等。它们各有优劣,选择哪个优化器应根据具体任务来确定。

此外,使用学习率调度器和梯度裁剪等技术也能显著提升模型的训练效果。

```python

from keras.callbacks import LearningRateScheduler

# 学习率调度器

def scheduler(epoch, lr):

if epoch < 10:

return lr

else:

return lr * np.exp(-0.1)

# 实例化调度器

lr_scheduler = LearningRateScheduler(scheduler)

# 训练模型时使用调度器

history = model.fit(

x_train, y_train,

epochs=50,

batch_size=64,

validation_data=(x_val, y_val),

callbacks=[lr_scheduler]

)

```

## 结论

在这一章节中,我们详细探讨了深度学习在图像识别领域的实践应用,并对实现深度学习模型的步骤、实战案例以及在实践中遇到的挑战和优化方法进行了深入分析。通过具体案例和代码实践,我们展示了深度学习如何在图像识别任务中提供优秀的解决方案,同时指出了模型训练过程中可能会遇到的问题及其解决途径。深度学习在图像识别中的应用远不止这些,但本章的介绍应为读者提供了一个坚实的基础,并激励他们在未来的研究和应用中进一步探索。

# 4. 深度学习的优势在图像识别中的展现

## 4.1 深度学习的性能优势分析

### 4.1.1 准确率和效率的提升

深度学习技术在图像识别领域的突破,最直观的体现之一就是准确率的显著提升。深度学习模型,尤其是卷积神经网络(CNN)的引入,使得模型能够自动从原始数据中学习特征,这与传统机器学习方法需要人为设计特征相比,大大减少了预处理的工作量,同时也提高了识别的准确度。

例如,考虑一个卷积神经网络(CNN)处理手写数字识别的例子,一个训练有素的CNN模型在MNIST数据集上的表现,可以轻松达到99%以上的识别准确率。而在过去的机器学习方法中,即便是精心设计的手工特征,往往也难以达到这个水平。

在效率方面,随着硬件技术的进步,尤其是GPU的广泛使用,深度学习模型的训练速度大幅提升。例如,使用NVIDIA的GPU,可以将CNN的训练时间从数天缩短到数小时,甚至更短。在推理(inference)过程中,同样因为硬件加速,使得深度学习模型能够实现实时或接近实时的识别速度。

### 4.1.2 处理大规模数据集的能力

深度学习模型的另一个显著优势是其处理大规模数据集的能力。随着互联网和数字媒体的发展,图像数据量呈指数级增长。深度学习模型能够从大量数据中学习,并且其性能随着训练数据量的增加而提高。这一点是传统机器学习方法所无法比拟的,后者在面对大规模数据时通常会遇到性能瓶颈。

一个典型的例子是用于自动驾驶的图像识别系统。这些系统必须处理来自多个传感器的海量数据,包括摄像头、雷达和激光雷达(LIDAR)。深度学习不仅能够处理这些多样化的数据源,还能够在这些大规模数据集中持续提升识别精度。

### 4.1.1 和 4.1.2 合并讨论

综合准确率和效率的提升以及处理大规模数据集的能力,深度学习技术在图像识别领域展现出了压倒性的优势。这种优势来源于其自动特征提取的能力,强大的模型规模和高度的参数化,使得深度学习模型能够学习到数据中更复杂和抽象的特征。这为图像识别带来了质的飞跃,从基础的物体识别到复杂的场景理解,深度学习都显示出了前所未有的潜力。

## 4.2 深度学习与其他技术的结合

### 4.2.1 数据增强与迁移学习

在实际应用中,深度学习模型需要大量的数据来进行训练以避免过拟合和提升泛化能力。数据增强(Data Augmentation)技术因此变得尤为重要。它通过对现有数据进行各种变换(如旋转、缩放、裁剪等),人为地扩充数据集,从而帮助模型学到更加鲁棒的特征。

迁移学习(Transfer Learning)是另一种常见的技术。它允许我们将在大数据集上训练好的模型应用到数据量较小的任务上。通过迁移学习,我们可以利用预训练模型的权重作为新任务的起点,通过微调(Fine-tuning)来适应新的数据集。这种方法大大减少了对大量标注数据的需求,使得深度学习技术可以在数据受限的情况下仍然有效地工作。

### 4.2.2 深度学习在多模态图像识别中的应用

多模态图像识别指的是结合多种类型的图像数据(如RGB图像、红外图像、深度图像等)来进行识别的过程。深度学习模型可以通过端到端的学习方法,同时处理和整合来自不同传感器的数据。

以自动驾驶为例,深度学习模型可以被训练来融合来自多个摄像头的数据,以及来自雷达和激光雷达的数据,以进行精确的物体检测和分类。这种模型通常使用复杂的网络架构,如CNN与循环神经网络(RNN)的结合,以及注意力机制(Attention Mechanisms),来提高对场景的整体理解能力。

### 4.2.1 和 4.2.2 合并讨论

深度学习与其他技术的结合,如数据增强和迁移学习,多模态图像识别等,大大扩展了深度学习在图像识别领域的应用范围。这些技术不仅提高了模型的性能,也解决了深度学习在实际应用中遇到的一些关键问题,比如过拟合、数据不足和多数据源的整合问题。通过这些技术的结合使用,深度学习模型能够更好地适应各种复杂的现实世界场景。

## 4.3 深度学习的未来趋势与展望

### 4.3.1 模型压缩与加速技术

随着深度学习模型的规模不断扩大,模型压缩和加速技术变得日益重要。模型压缩旨在减小模型大小和计算需求,而不会显著降低性能。这包括权重剪枝(Weight Pruning)、量化(Quantization)和知识蒸馏(Knowledge Distillation)等技术。

加速技术则侧重于提高模型的推理速度。利用专门的硬件(如FPGAs和ASICs)或软件优化(如TensorRT和OpenVINO),可以将模型部署到边缘设备上,满足实时处理的需求。这些技术的发展对于将深度学习模型应用于资源受限的场景(如移动设备和嵌入式系统)至关重要。

### 4.3.2 深度学习框架的发展趋势

深度学习框架的发展也在不断推动图像识别技术的进步。目前流行的深度学习框架包括TensorFlow、PyTorch、Keras等,这些框架通过提供高层次的API和自动微分机制,极大地简化了深度学习模型的开发和部署。

未来,深度学习框架将继续向着更加用户友好、性能高效和可扩展性更强的方向发展。模型的可视化、调试和优化工具将更加完善,以支持研究人员和开发者快速构建和调整模型。同时,为了支持模型压缩和加速,框架将更加注重对硬件的优化和集成。

### 4.3.1 和 4.3.2 合并讨论

深度学习的未来趋势表明,模型压缩和加速技术、深度学习框架的发展是推动图像识别技术进步的两个关键方向。随着算法和硬件技术的不断进步,未来深度学习模型将更加高效、紧凑,同时保持甚至提高其性能。这一趋势预示着深度学习将在更广泛的领域和应用中得到普及和应用,为用户带来更智能、更便捷的生活体验。

# 5. 深度学习框架与工具的演进

## 5.1 深度学习框架概览

### 深度学习框架的重要性

在深度学习的实践中,框架的选择至关重要。一个好的框架能够简化模型的开发流程,提供高效的计算资源使用,以及方便快捷的部署机制。深度学习框架为开发者提供了一套抽象的API,使得算法工程师可以忽略底层的数学运算和硬件优化,更加专注于算法逻辑的实现和模型的调优。

### 常见深度学习框架介绍

目前市场上流行多种深度学习框架,如TensorFlow、PyTorch、Keras等。它们各自有不同的设计理念和使用场景。例如,TensorFlow是由Google开发的,具有良好的生产环境部署能力和灵活的模型定义方式。PyTorch则更受学术界欢迎,因其动态图的特性使得它在研究和原型设计方面非常便捷。

### 框架的演进路径

随着深度学习的发展,框架也在不断地演进。最初,它们只提供了基础的操作和简单的网络定义,随着研究的深入和技术的进步,框架开始集成更多的高级功能,如自动微分、分布式训练、模型部署等。此外,为了支持更复杂的模型和更大的数据集,框架也在不断地优化其性能,特别是在并行计算和内存管理方面。

## 5.2 深度学习工具箱的丰富

### 代码库与工具的必要性

除了框架本身,一系列的工具库和代码库的出现也极大地推动了深度学习的发展。这些工具库提供了一些特定功能,如数据预处理、模型优化、可视化等,大大提高了开发者的效率。

### 数据操作工具

例如,NumPy库提供了强大的科学计算能力,是深度学习数据处理不可或缺的工具。另外,Pandas库支持数据结构与数据分析工具,使得数据探索和清洗变得更加高效。

### 训练加速工具

为了提高模型的训练速度,诸如NVIDIA的cuDNN库、Google的TPU等硬件加速工具被广泛使用。这些工具通过优化底层的计算操作来实现更高的训练效率。

### 模型部署工具

模型训练完成后,如何部署到生产环境中也是一个挑战。TensorRT、ONNX等工具可以帮助开发者优化和转换模型,以便在不同的平台上进行部署。

## 5.3 深度学习开发环境的搭建

### 开发环境的必要组件

为了搭建一个高效的深度学习开发环境,需要安装多种软件和硬件组件。其中包括深度学习框架、计算库、开发IDE,以及支持GPU加速的硬件平台。

### 安装与配置流程

搭建深度学习环境通常需要对系统进行一系列的配置。例如,在Linux系统上,需要安装CUDA和cuDNN以支持NVIDIA GPU的计算能力。然后通过包管理器安装深度学习框架,如通过`pip install tensorflow`安装TensorFlow。

```bash

# 安装CUDA

wget ***

* 安装cuDNN

sudo dpkg -i libcudnn8_*.*.*.**-1+cuda10.0_amd64.deb

sudo dpkg -i libcudnn8-dev_*.*.*.**-1+cuda10.0_amd64.deb

sudo dpkg -i libcudnn8-samples_*.*.*.**-1+cuda10.0_amd64.deb

# 安装TensorFlow GPU版本

pip install tensorflow-gpu

```

### 环境测试与验证

安装完成后,需要进行一系列的测试来验证环境是否搭建成功。一个常见的测试是运行一个基本的深度学习模型,确保计算资源得到正确使用。

```python

import tensorflow as tf

# 创建一个简单的模型来测试环境

model = tf.keras.models.Sequential([

tf.keras.layers.Flatten(input_shape=(28, 28)),

tf.keras.layers.Dense(128, activation='relu'),

tf.keras.layers.Dropout(0.2),

tf.keras.layers.Dense(10, activation='softmax')

])

***pile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

# 打印模型结构

model.summary()

```

以上代码展示了如何构建一个简单的神经网络模型,并输出模型的结构概要。如果代码能够顺利运行,并且GPU资源得到调用,说明深度学习环境搭建成功。

## 5.4 深度学习平台的选择与比较

### 云平台与本地平台的权衡

在搭建深度学习环境时,开发者可以选择使用云平台服务或者本地硬件。云平台如Google Cloud Platform、Amazon Web Services提供了强大的计算资源,方便弹性扩展,适合资源有限的团队或大规模的项目。而本地硬件则提供了更高的数据处理速度和灵活性,对于需要高性能计算或者高度定制化硬件的项目来说更加合适。

### 深度学习平台的选择因素

选择深度学习平台时,需要考虑以下因素:成本预算、数据隐私需求、项目规模、团队技术栈等。大型企业或研究机构可能会自己构建深度学习集群,而初创公司或小型团队更可能依赖于云平台提供的服务。

### 比较不同平台的特点

不同的平台有其独特的特点和优势。例如,NVIDIA DGX平台专门为AI研究设计,提供强大的计算性能和优化的软件环境;而AWS提供了广泛的深度学习服务,如SageMaker,降低了机器学习的门槛。对于开发者来说,选择最适合当前项目需求的平台至关重要。

## 5.5 深度学习开源社区与资源

### 开源社区的重要性

开源社区是推动深度学习发展的重要力量。开发者可以通过开源项目参与到深度学习的前沿研究中,利用社区的力量解决遇到的问题。社区中共享的代码库、模型预训练和数据集极大地加速了研究和应用的进程。

### 常用开源资源

在深度学习领域,GitHub是最重要的开源资源之一。在GitHub上,开发者可以找到大量深度学习相关的项目和代码库。TensorFlow、PyTorch等框架的官方GitHub仓库,以及Keras、scikit-learn等工具库,都拥有大量的star和贡献者。

### 如何利用开源资源

利用开源资源时,开发者应该注意资源的活跃度和质量。积极参与到社区讨论中,不仅可以获得帮助解决问题,还有机会贡献自己的代码和想法。此外,开源许可证也是必须关注的问题,以确保合法合规地使用这些资源。

## 5.6 深度学习资源的管理和共享

### 资源管理的重要性

随着深度学习项目的增多,管理和共享资源变得越来越重要。良好的资源管理可以帮助团队节省时间,提高效率,降低重复工作。例如,通过管理代码版本、模型参数和数据集,开发者能够更好地协作和重复使用资源。

### 资源管理工具

各种工具和平台可以帮助开发者实现资源的管理,如Git用于代码版本控制,Docker用于环境隔离和容器化部署,以及Jupyter Notebook用于交互式数据科学开发。此外,一些专门针对深度学习资源管理的工具也在不断地被开发和完善。

### 共享资源的最佳实践

共享资源的最佳实践是使用公共代码库和数据集。公共代码库如TensorFlow Model Garden、PyTorch Examples提供了大量高质量的模型实现和使用示例。数据集的共享则可以通过数据科学竞赛、公开的数据集发布等形式进行,这些资源对于初学者和研究者来说都是非常宝贵的。

## 5.7 深度学习教育与培训资源

### 教育资源的重要性

深度学习是一个快速发展的领域,新技术和新方法层出不穷。因此,教育和培训资源对于持续学习和保持技术竞争力非常重要。无论是在线课程、学术论文还是技术书籍,都是学习深度学习不可或缺的资源。

### 在线学习平台

近年来,许多在线平台提供了深度学习相关的课程,如Coursera、edX和Udacity。这些课程通常由知名大学或公司提供,内容覆盖从基础理论到实践应用的各个方面。

### 技术书籍与论文

深度学习的许多核心理念和技术都来自于学术论文。阅读和理解这些论文是深入学习的重要途径。此外,技术书籍如《深度学习》(Ian Goodfellow et al.) 和《动手学深度学习》(Aston Zhang et al.)等,为初学者提供了系统性的学习材料。

### 实践与社区互动

除了理论学习之外,实际操作和社区互动也非常重要。参与开源项目,参加深度学习相关的研讨会和技术交流活动,可以帮助开发者加深对理论的理解,并了解最新的行业动态。

## 5.8 深度学习行业应用案例分析

### 行业应用概述

深度学习已经广泛应用于多个行业,包括医疗健康、金融科技、自动驾驶、智能制造等。在这些领域中,深度学习解决了许多传统方法难以解决的问题,大大提高了生产效率和产品质量。

### 具体应用案例

以医疗健康为例,深度学习在影像诊断、病理分析等领域展现出了巨大的潜力。例如,Google的DeepMind团队开发的AI系统在视网膜疾病的诊断上达到了甚至超过了专业医生的水平。

### 行业应用的挑战与机遇

尽管深度学习在许多行业都取得了成功,但在实际应用中也面临不少挑战。例如,模型的泛化能力、数据隐私保护、解释性问题等。同时,这些挑战也为深度学习的发展提供了新的机遇,推动了技术的进一步创新和成熟。

## 5.9 深度学习未来展望与思考

### 技术发展的影响

未来,深度学习技术的发展将继续影响人工智能领域乃至整个科技产业。从算法的优化、模型的压缩,到硬件的创新,这些进步将使得深度学习模型更加高效、易于部署。

### 社会影响的考量

深度学习技术的进步也带来了社会影响的考量。例如,自动化和智能化可能会导致某些职位的消失,同时也将创造新的职业机会。社会需要对这种变化做出适应,确保技术发展的成果能够惠及更多人。

### 持续学习与适应性

最后,对于个人和组织而言,深度学习是一个需要持续学习和适应的领域。随着技术的快速发展,只有不断学习和尝试新方法,才能在竞争中保持领先。

```mermaid

graph LR

A[开始深度学习之旅] --> B[选择合适的深度学习框架]

B --> C[搭建开发环境]

C --> D[利用深度学习工具箱]

D --> E[开发与测试模型]

E --> F[共享与管理资源]

F --> G[利用开源社区]

G --> H[参与行业应用案例分析]

H --> I[展望深度学习的未来]

```

以上mermaid流程图展示了从开始深度学习学习到参与行业应用再到未来展望的全过程,强调了持续学习和实践的重要性。

```markdown

| 框架 | 优势 | 挑战 |

| --- | --- | --- |

| TensorFlow | 强大的社区支持和生产部署能力 | 学习曲线较陡 |

| PyTorch | 动态图特性,研究友好 | GPU资源消耗较大 |

| Keras | 易于上手,快速原型开发 | 对底层控制不足 |

```

通过以上表格,我们可以对目前主流的深度学习框架进行快速的优劣势对比,帮助开发者做出选择。

综上所述,深度学习框架与工具的演进是深度学习领域不断进步的重要标志。随着技术的发展,我们有理由相信深度学习将在未来的科技发展中扮演更为关键的角色。

# 6. 深度学习在图像识别中的实践应用详解

在深度学习的诸多应用领域中,图像识别无疑是近年来进步最为显著的领域之一。这一章节将深入探讨如何实现深度学习模型,并结合具体案例来展示深度学习在图像识别中的实际应用,以及在实践过程中遇到的挑战和优化方法。

## 6.1 实现深度学习模型的步骤

实现深度学习模型主要分为数据预处理和增强以及模型的选择与构建两个步骤。这两者相辅相成,共同确保模型能够从大量数据中有效地学习并进行准确的图像识别。

### 6.1.1 数据预处理和增强

数据预处理和增强是图像识别任务中的重要步骤,对提升模型的泛化能力有着至关重要的作用。以下是常用的一些数据预处理和增强技术:

- **归一化处理:** 通过对图像像素值进行归一化,将它们缩放到统一的范围内,通常是[0,1]或[-1,1],这有助于加快模型的收敛速度。

- **大小调整:** 统一输入图像的尺寸,以满足网络结构的要求。

- **颜色调整:** 包括亮度、对比度、饱和度调整,以增加模型对光照变化的适应性。

- **数据增强:** 通过旋转、缩放、裁剪、水平翻转等方法生成新的训练样本,减少过拟合,提高模型的泛化能力。

```python

from tensorflow.keras.preprocessing.image import ImageDataGenerator

# 定义图像生成器,包含数据增强技术

datagen = ImageDataGenerator(

rescale=1./255, # 归一化处理

rotation_range=20, # 随机旋转图像范围

width_shift_range=0.2, # 随机水平位移范围

height_shift_range=0.2, # 随机垂直位移范围

shear_range=0.2, # 随机错切变换角度

zoom_range=0.2, # 随机缩放图像范围

horizontal_flip=True, # 随机水平翻转

fill_mode='nearest' # 填充新创建像素的方法

)

# 使用图像生成器进行数据增强

# 假设train_data_dir是包含训练图像的文件夹路径

train_generator = datagen.flow_from_directory(

train_data_dir,

target_size=(150, 150),

batch_size=32,

class_mode='binary' # 二分类问题

)

```

### 6.1.2 模型的选择与构建

构建一个深度学习模型涉及到选择合适的网络架构、激活函数、损失函数和优化器。在图像识别任务中,常用的网络架构有卷积神经网络(CNN),例如经典的AlexNet、VGGNet、ResNet等。以下是构建CNN模型的基本步骤:

- **初始化网络结构:** 定义CNN的层数、每层的类型(卷积层、池化层、全连接层等)、以及每层的参数。

- **选择激活函数:** 通常在卷积层后面使用ReLU激活函数,最后一层使用softmax或sigmoid函数进行多分类或二分类问题。

- **定义损失函数和优化器:** 对于多分类问题,通常使用交叉熵损失函数;对于二分类问题,则使用二元交叉熵损失函数。优化器可以使用Adam、SGD、RMSprop等。

```python

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Conv2D, MaxPooling2D

from tensorflow.keras.layers import Activation, Dropout, Flatten, Dense

# 定义一个简单的CNN模型结构

model = Sequential([

Conv2D(32, (3, 3), input_shape=(150, 150, 3)),

Activation('relu'),

MaxPooling2D(pool_size=(2, 2)),

Conv2D(32, (3, 3)),

Activation('relu'),

MaxPooling2D(pool_size=(2, 2)),

Flatten(),

Dense(64),

Activation('relu'),

Dropout(0.5),

Dense(1),

Activation('sigmoid')

])

# 编译模型

***pile(loss='binary_crossentropy',

optimizer='adam',

metrics=['accuracy'])

# 训练模型

model.fit(

train_generator,

steps_per_epoch=100, # 每个epoch进行100次梯度更新

epochs=50

)

```

## 6.2 深度学习图像识别实战案例

深度学习在图像识别领域中已经有很多成功的案例,下面我们将通过两个案例来展示深度学习模型如何在实际中进行图像识别。

### 6.2.1 人脸识别

人脸识别技术是深度学习在图像识别领域的一个重要应用。它可以通过深度学习模型识别和验证人脸,广泛应用于安全验证、监控系统等领域。

### 6.2.2 物体检测与分类

深度学习不仅能够识别图像中的物体,还能定位物体在图像中的位置。物体检测与分类技术被应用于自动驾驶车辆、智能监控以及商品识别等场景。

## 6.3 实践中的挑战与优化

在实际应用深度学习模型的过程中,研究者和工程师们需要面对诸如过拟合与欠拟合、模型训练效率低下等挑战。下面将详细讨论这些挑战以及优化方法。

### 6.3.1 过拟合与欠拟合问题

过拟合指的是模型在训练数据上表现良好,但是在未见过的数据上表现不佳。相反,欠拟合指的是模型在训练集和测试集上都表现不好。

- **解决过拟合:** 通过数据增强、添加Dropout层、使用L1/L2正则化等方式。

- **解决欠拟合:** 通过增加模型的深度或宽度、训练更长的时间、优化模型结构或使用预训练模型等手段。

### 6.3.2 模型的训练技巧与优化方法

优化模型训练过程不仅可以提高模型性能,还能加快训练速度。

- **使用预训练模型:** 利用在大规模数据集上预训练好的模型进行迁移学习,能够在有限的数据上快速收敛。

- **调整学习率:** 使用学习率衰减或自适应学习率优化器(如Adam)。

- **使用批量归一化:** 通过批量归一化(Batch Normalization)稳定训练过程,加速收敛。

通过以上所述的理论和实践相结合的方法,深度学习在图像识别上的应用已经取得了巨大的成功,并将继续在未来的科技领域中扮演重要角色。

0

0