YOLOv5帧率优化利器:GPU和TPU加速策略,让你的模型飞起来

发布时间: 2024-08-14 07:03:29 阅读量: 20 订阅数: 22

# 1. YOLOv5模型优化概述**

YOLOv5模型优化旨在通过各种技术手段提升模型的性能和效率,主要包括以下几个方面:

* **硬件加速:**利用GPU和TPU等硬件设备的并行计算能力,大幅提升模型训练和推理速度。

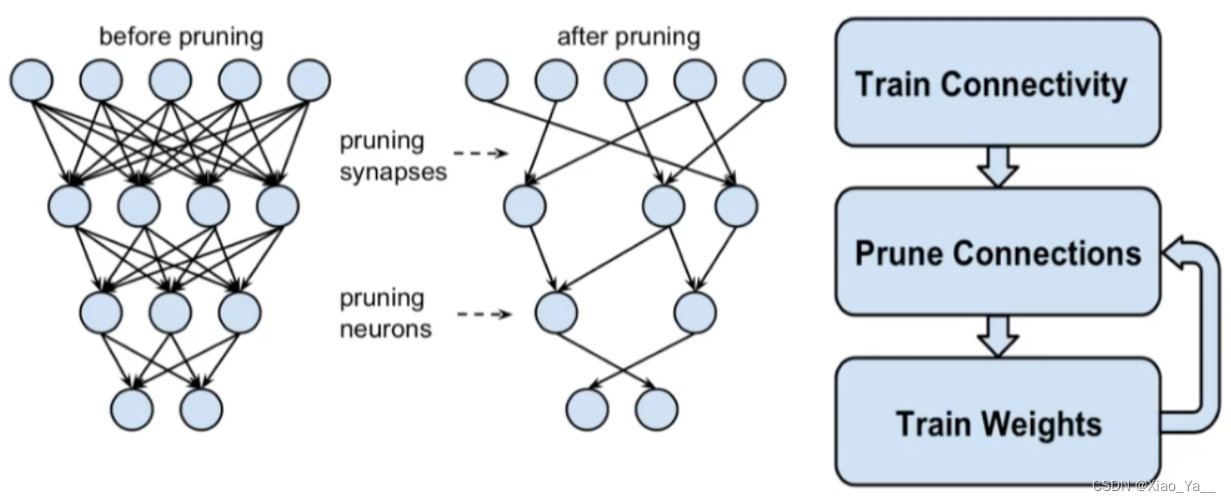

* **模型优化:**通过模型裁剪、量化和知识蒸馏等技术,减少模型大小和计算量,提升推理效率。

* **数据优化:**通过数据增强、预处理和后处理等技术,提高模型对不同数据集的泛化能力和鲁棒性。

通过综合运用这些优化技术,可以显著提升YOLOv5模型的性能,使其能够满足不同应用场景的需求,例如实时目标检测、图像分类和视频分析等。

# 2. GPU加速策略

### 2.1 GPU并行计算原理

**2.1.1 CUDA并行编程模型**

CUDA(Compute Unified Device Architecture)是一种并行编程模型,允许程序员利用 GPU 的强大计算能力。CUDA 通过将代码分解为可并行执行的线程来实现并行性。这些线程在 GPU 的多个流式多处理器(SM)上同时运行。

**2.1.2 GPU内存管理和优化**

GPU 拥有自己的专用内存,称为全局内存。全局内存的访问速度比系统内存(RAM)慢,因此高效管理 GPU 内存至关重要。CUDA 提供了多种技术来优化内存管理,包括:

- **统一内存访问(UMA)**:允许 CPU 和 GPU 共享相同的地址空间,从而消除数据复制的开销。

- **纹理内存**:一种优化的高速内存类型,用于存储图像和纹理数据。

- **共享内存**:一种低延迟的内存类型,用于在同一线程块内的线程之间共享数据。

### 2.2 YOLOv5 GPU优化实践

#### 2.2.1 GPU加速训练

**代码块:**

```python

import torch

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

model = torch.nn.DataParallel(model).to(device)

```

**逻辑分析:**

这段代码使用 PyTorch 的 `DataParallel` 模块将 YOLOv5 模型并行化到所有可用的 GPU 上。`DataParallel` 模块将模型复制到每个 GPU,并自动将数据和梯度在 GPU 之间分发。

**参数说明:**

- `device`:指定训练设备,如果是 CUDA 设备,则使用 GPU,否则使用 CPU。

- `model`:要并行化的 YOLOv5 模型。

#### 2.2.2 GPU加速推理

**代码块:**

```python

import torch

model = torch.jit.trace(model, torch.rand(1, 3, 416, 416))

model = model.to("cuda")

```

**逻辑分析:**

这段代码将 YOLOv5 模型转换为 TorchScript 并将其部署到 GPU 上。TorchScript 是 PyTorch 的一种优化编译器,可以将 Python 模型转换为高效的 C++ 代码。将模型部署到 GPU 可以显著提高推理速度。

**参数说明:**

- `model`:要部署到 GPU 的 YOLOv5 模型。

# 3. TPU加速策略

### 3.1 TPU架构和优势

#### 3.1.1 TPU的计算单元和内存结构

TPU(Tensor Processing Unit)是一种专为机器学习和深度学习任务设计的专用加速器。其架构旨在提供高吞吐量和低延迟的计算,非常适合处理大规模数据和复杂模型。

TPU的核心计算单元称为TPU核,它由一个矩阵乘法单元(MMU)和一个累加器组成。MMU负责执行矩阵乘法运算,而累加器则用于累加结果。TPU核可以并行处理多个矩阵乘法运算,从而实现高吞吐量。

TPU还采用了独特的内存结构,称为片上存储器(HBM)。HBM是一种高速、低延迟的内存技术,可以为TPU核提供快速访问数据。HBM与TP

0

0