Flume可靠性深度探究:故障转移与数据一致性保证机制

发布时间: 2024-10-25 23:19:02 阅读量: 52 订阅数: 32

# 1. Flume基础知识回顾

## 1.1 Flume简介

Apache Flume 是一个分布式、可靠、高可用的海量日志采集、聚合和传输的系统。它支持在系统之间以可靠的方式进行数据传输。Flume 有着简单灵活的架构,主要由三个核心组件构成:Source、Channel 和 Sink。这三个组件通过定义数据流的流向和处理方式,共同作用于数据的采集和传输。

## 1.2 核心组件功能

- **Source**:数据的输入点,负责接收数据并存储到Channel中。

- **Channel**:数据的临时存储点,它在Source和Sink之间起着中转站的作用,保证了数据传输的可靠性。

- **Sink**:数据的出口点,负责从Channel中取出数据并发送到目的地。

## 1.3 Flume的使用场景

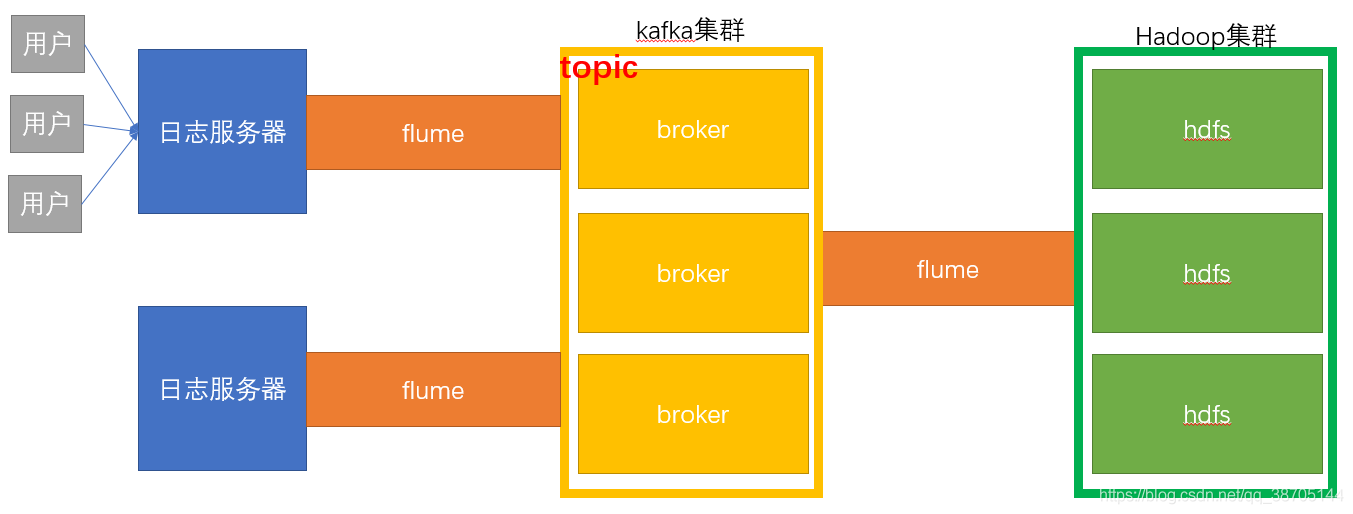

Flume 被广泛用于收集分布在服务器上的日志数据。常见的使用场景包括日志聚合、事件通知、数据导入等。通过合理配置,Flume可以高效地从多种源捕获数据,并确保数据安全传输到后端系统,如HDFS、HBase等。

```mermaid

flowchart LR

A[Source] --> B[Channel]

B --> C[Sink]

C --> D[Destination]

```

在上述流程图中,展示了Flume数据流向的基本过程。每个组件的紧密协作确保了数据从源点流向终点的完整性和可靠性。

# 2. ```

# 第二章:Flume的故障转移机制

## 2.1 故障转移的理论基础

### 2.1.1 容错与故障转移概念

在分布式系统中,容错是系统能够继续运行而不中断服务的能力,即使在个别组件出现故障的情况下。故障转移(Failover)是容错的一种策略,它涉及当一个系统组件(如硬件、软件或网络)失败时,系统自动将工作负载切换到健康的备用组件的过程。故障转移是确保系统稳定性和可用性的关键部分,特别是在实时数据处理和日志聚合的场景中。

### 2.1.2 Flume故障转移的触发条件

在Flume中,故障转移通常在以下条件下被触发:

- 当Source无法读取数据时(例如,由于网络问题或数据源不可达)。

- 当Channel无法将事件传递给Sink时(例如,由于Sink处理速度过慢或Channel容量饱和)。

- 当Sink无法成功写入数据到目标系统时。

在上述任一情况下,Flume的故障转移机制可以确保数据尽可能地被重定向到备用的目标,从而实现数据的持续流动。

## 2.2 Flume故障转移的实现方式

### 2.2.1 Source故障转移策略

Flume提供了多Source配置,可以通过配置Source的多个实例来实现故障转移。如果主Source发生故障,Flume可以自动切换到备用Source。实现这一机制的关键在于正确配置Source的属性,比如`type`、`channels`和故障转移相关的参数。

```properties

agent.sources = r1 r2 r3

agent.sources.r1.type = avro

agent.sources.r1.bind = localhost

agent.sources.r1.port = 10000

agent.sources.r1.channels = c1

agent.sources.r2.type = avro

agent.sources.r2.bind = localhost

agent.sources.r2.port = 10001

agent.sources.r2.channels = c1

agent.sources.r2.failover-delay = 30000

agent.sources.r3.type = avro

agent.sources.r3.bind = localhost

agent.sources.r3.port = 10002

agent.sources.r3.channels = c1

agent.sources.r3.failover-delay = 30000

```

在上述配置中,`failover-delay`参数定义了从一个Source切换到另一个Source的时间间隔。如果`r1` Source发生故障,Flume将会等待30秒后尝试切换到`r2` Source。这种自动化的故障切换策略极大地提高了系统的容错能力。

### 2.2.2 Channel故障转移策略

Channel作为Flume中事件的暂存地,其稳定性对整个数据流至关重要。如果Channel出现问题,Flume可以配置多个Channel实现故障转移。通常这通过配置Source与多个Channel关联,并使用`backup`参数指定备用Channel。

### 2.2.3 Sink故障转移策略

当Sink遇到问题不能正常工作时,Flume可以通过配置多个Sink实例来实现故障转移。在配置文件中,同一Source可以连接到多个Sink,通过设置Sink的`type`属性为`load_balance`,使得Sink可以按照一定的策略分发事件。

## 2.3 Flume故障转移的实践演练

### 2.3.1 故障转移配置案例

为了演示故障转移的配置,我们可以创建一个Flume配置文件,它定义了一个agent,该agent有两个Source实例和两个Sink实例,它们通过一个Channel连接。

```properties

agent.sources = s1 s2

agent.sinks = k1 k2

agent.channels = c1

agent.sources.s1.type = avro

agent.sources.s1.bind = localhost

agent.sources.s1.port = 10000

agent.sources.s1.channels = c1

agent.sources.s2.type = avro

agent.sources.s2.bind = localhost

agent.sources.s2.port = 10001

agent.sources.s2.channels = c1

agent.sinks.k1.type = logger

agent.sinks.k2.type = logger

agent.channels.c1.type = memory

agent.channels.c1.capacity = 1000

agent.channels.c1.transactionCapacity = 100

agent.sources.s1.channels = c1

agent.sources.s2.channels = c1

agent.sinks.k1.channel = c1

agent.sinks.k2.channel = c1

```

在这个配置中,我们设置了两个Avro Source(s1和s2)监听不同的端口,并将它们的数据都发送到一个Channel(c1)。如果有任何Source失败,Flume可以继

```

0

0