MATLAB动态系统状态估计:时间序列预测的深度探索

发布时间: 2024-08-30 17:51:31 阅读量: 101 订阅数: 54

# 1. 动态系统状态估计与时间序列预测基础

## 1.1 状态估计与时间序列预测的概念

在动态系统中,状态估计指的是根据系统的历史和当前观测数据,推断系统当前状态的过程。这一过程是实时决策和控制的基础。时间序列预测则是从历史时间序列数据中提取有用信息,对未来的数据点进行预测。这两个领域在许多实际应用中都有着重要的作用,例如天气预测、股市分析、能源消耗预测等。

## 1.2 状态估计与时间序列预测的关系

状态估计通常涉及到对系统动态的建模和观测过程的理解。时间序列预测则专注于单个变量随时间变化的规律。两者在数据驱动的决策系统中紧密相关。状态估计可以为时间序列预测提供一个动态模型框架,而时间序列预测结果又能反过来优化状态估计过程。

## 1.3 本章学习目标

本章旨在为读者提供动态系统状态估计和时间序列预测的基础知识,为理解后续章节中MATLAB在动态系统建模和时间序列分析中的应用打下坚实的基础。通过本章,读者应该能够掌握关键概念、原理和方法,为进一步的实践应用做好准备。

# 2. MATLAB在动态系统建模中的应用

### 2.1 MATLAB基础知识回顾

动态系统的建模是理解其行为和预测未来状态的关键步骤。MATLAB作为一种高性能的数值计算和可视化软件,提供了一系列工具用于动态系统的建模与分析。在进入动态系统建模的深入探讨之前,让我们先对MATLAB的基础知识进行回顾。

#### 2.1.1 MATLAB的工作环境和编程基础

MATLAB工作环境包括命令窗口、编辑器、工作空间、路径管理等部分,其为数值计算、算法开发和数据可视化提供了集成环境。编程基础涉及MATLAB语法、数据类型、运算符以及函数的创建和调用。对于动态系统建模来说,矩阵和数组的操作尤为重要,因为它们是处理时间序列数据和系统状态的基础。

以下是一个简单的MATLAB代码示例,展示了创建矩阵和进行基本矩阵运算的过程:

```matlab

% 创建两个矩阵

A = [1 2; 3 4];

B = [5 6; 7 8];

% 矩阵加法

C = A + B;

% 矩阵乘法

D = A * B;

% 显示结果

disp('矩阵加法结果:');

disp(C);

disp('矩阵乘法结果:');

disp(D);

```

矩阵`A`和`B`被创建后,我们对它们执行了加法和乘法操作。这些操作是动态系统建模中最基础的数学运算。MATLAB强大的矩阵运算功能使得处理这类问题变得非常直观。

#### 2.1.2 MATLAB在矩阵运算中的优势

MATLAB专为矩阵和数组运算设计,因此在处理动态系统的数学运算时具有独特的优势。MATLAB中的运算符和内置函数能够高效地执行矩阵操作,如求逆、转置、特征值计算等。更重要的是,MATLAB还提供了专门的工具箱,例如Control System Toolbox和System Identification Toolbox,这些工具箱针对控制系统和系统识别提供了专业化的建模与分析功能。

表2.1展示了MATLAB在执行矩阵运算时的一些优势:

| 功能 | 说明 |

|-------------------|-------------------------------------------------------------|

| 矩阵运算符 | 提供直观的语法进行矩阵运算,无需编写复杂的循环和条件语句。 |

| 内置矩阵函数 | 提供了大量预定义函数,如矩阵求逆、特征值计算等。 |

| 高级矩阵操作 | 如矩阵分解、矩阵求导和积分等,可直接通过函数调用实现。 |

| 多维数组支持 | 不仅支持二维矩阵,还可以处理多维数组,适合复杂系统的建模。 |

| 并行计算能力 | 利用MATLAB的并行计算工具箱,可加速大规模矩阵运算的处理速度。 |

| 图形化工具 | 提供可视化的矩阵操作工具,方便用户直观理解矩阵操作结果。 |

### 2.2 动态系统的数学描述

动态系统的数学描述是通过数学模型来表达系统随时间变化的动态行为。这包括系统的输入、输出以及内部状态之间的关系。

#### 2.2.1 线性系统和非线性系统的数学模型

动态系统根据系统的数学表达是否线性,可以分为线性系统和非线性系统。

- **线性系统**:系统的行为可以用线性代数方程描述,其具有叠加原理和齐次性质。线性系统的数学模型通常包括线性微分方程和差分方程。

- **非线性系统**:这类系统的动态行为不能用线性方程准确表达。非线性系统的数学模型包括非线性微分方程、差分方程,以及基于特定情况下的近似线性化模型。

例如,一个简单的线性系统可以用以下的线性微分方程表示:

```matlab

% 定义线性系统的微分方程dx/dt = Ax

A = [-1, 2; -3, -4];

x = [1; 0]; % 初始状态

dx = A * x; % 线性系统状态的导数

```

此处的矩阵`A`定义了系统的动态属性,而向量`x`表示系统的当前状态。

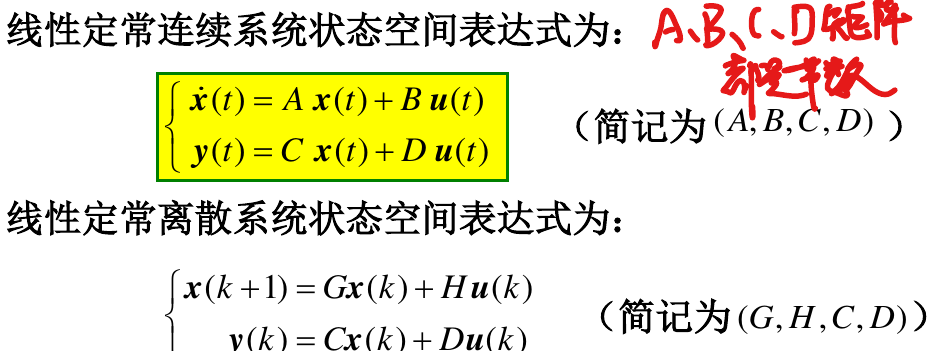

#### 2.2.2 状态空间表示法及其MATLAB实现

状态空间表示法是现代控制理论中描述动态系统的一种常用方法,它可以方便地通过线性代数的方式来处理问题。状态空间模型包括系统矩阵、输入矩阵、输出矩阵和传递函数等,其一般形式如下:

```

dx/dt = Ax + Bu

y = Cx + Du

```

其中,`x`是系统的状态向量,`u`是输入向量,`y`是输出向量,`A`、`B`、`C`、`D`分别是系统矩阵、输入矩阵、输出矩阵和传递函数矩阵。

MATLAB提供了强大的函数来实现状态空间模型的创建、分析和仿真。例如,使用`ss`函数创建状态空间模型,可以这样做:

```matlab

% 定义状态空间模型的矩阵

A = [-1, 2; -3, -4];

B = [1, 0; 0, 1];

C = [0.5, -0.5];

D = [0, 0];

% 创建状态空间模型

sys = ss(A, B, C, D);

% 对模型进行仿真

t = 0:0.01:10; % 定义仿真时间

u = ones(size(t)); % 定义输入信号

% 使用lsim函数进行仿真

[ysim, tsim] = lsim(sys, u, t);

% 绘制结果

plot(tsim, ysim);

xlabel('Time (s)');

ylabel('Output');

title('Response of the dynamic system');

```

该示例中,`sys`是定义好的状态空间模型,随后使用`lsim`函数模拟系统对于单位阶跃输入的反应。

通过以上章节的介绍,我们已经理解了MATLAB的基础知识以及其在动态系统数学描述中的应用。在此基础上,本章节的后续部分将对状态估计理论及其在MATLAB中的实现进行更深入的探讨。

# 3. 时间序列预测技术详解

### 3.1 时间序列分析的基本概念

时间序列分析是动态系统分析的一个重要分支,它涉及到分析和预测按时间顺序排列的数据点集合。在IT领域,时间序列预测被广泛应用在性能监控、网络流量分析、系统健康检测、市场趋势预测等诸多场景。为了深入理解时间序列预测,我们首先需要掌握时间序列数据的类型和特性,以及了解常见的预测模型。

#### 3.1.1 时间序列数据的类型和特性

时间序列数据由一系列按时间顺序排列的数据点组成,通常可按以下类型进行分类:

- **连续时间序列**:这些数据点连续不断地记录下来,例如温度传感器的实时记录。

- **离散时间序列**:数据点是按固定时间间隔记录的,例如每小时记录一次的股票价格。

- **季节性时间序列**:在特定时间间隔内周期性重复的模式,如季度销售额或年度气候数据。

每

0

0