【案例分析:使用Feeds库构建新闻聚合器】:实战指南与技巧

发布时间: 2024-10-13 13:41:05 阅读量: 1 订阅数: 2

# 1. Feeds库概述与安装

## 1.1 Feeds库简介

Feeds库是一个用于处理RSS/Atom订阅源的Python库,它提供了一系列工具来解析、聚合和处理来自不同新闻源的数据。该库允许开发者快速搭建出一个高效的新闻聚合器,实现内容的自动更新和展示。

## 1.2 安装Feeds库

在开始使用Feeds库之前,首先需要进行安装。可以通过Python的包管理工具pip来完成安装过程。打开终端或命令提示符,并输入以下命令:

```bash

pip install feeds

```

这条命令会自动下载并安装Feeds库及其依赖的第三方库。

## 1.3 检查安装

安装完成后,可以通过一个小示例来检查Feeds库是否安装成功。以下是一个简单的Python脚本,用于获取并打印一个RSS源的内容:

```python

import feeds

feed = feeds.parse("***")

print(feed.title)

```

运行上述脚本,如果能够成功打印出RSS源的标题,则说明Feeds库已经正确安装并可以使用了。

# 2. 新闻聚合器的设计思路

## 2.1 需求分析与功能规划

### 2.1.1 新闻聚合器的基本功能

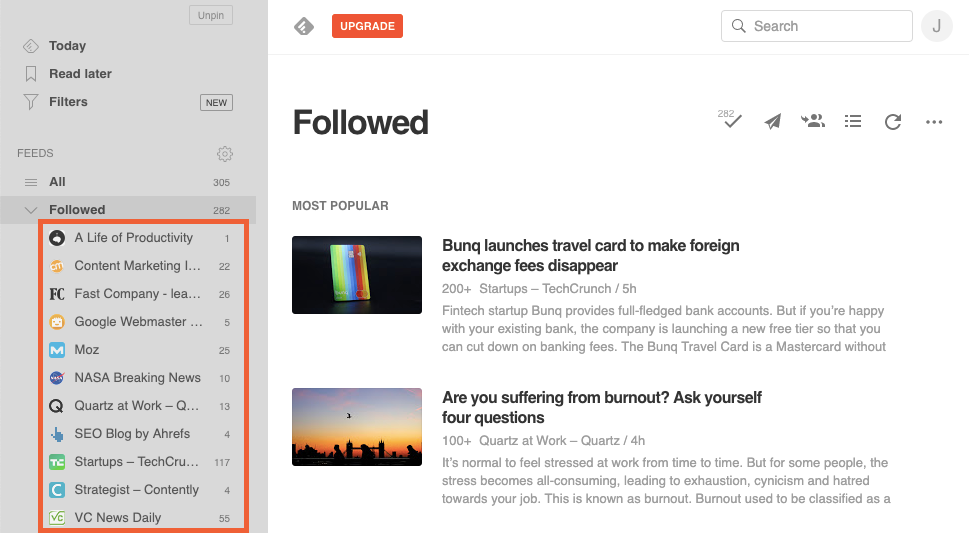

在设计一个新闻聚合器之前,首先需要明确其基本功能。新闻聚合器的核心目的在于为用户提供一个集中的平台,从中可以获取来自不同来源的新闻内容。基本功能应包括:

- **多源聚合**:能够从多个新闻源抓取新闻。

- **实时更新**:实时监控新闻源,一旦有新内容即可更新。

- **内容分类**:根据新闻类型或主题对内容进行分类。

- **个性化推荐**:根据用户偏好推荐相关新闻。

- **搜索功能**:允许用户搜索特定新闻或主题。

- **用户界面**:提供一个直观易用的界面供用户浏览新闻。

### 2.1.2 用户界面与交互设计

用户界面(UI)和用户体验(UX)设计对于新闻聚合器的成功至关重要。一个直观、易用的界面能够吸引用户,并提升用户满意度。交互设计应该考虑以下几个方面:

- **简洁明了**:界面布局要清晰,避免过多的元素导致混乱。

- **响应式设计**:适配多种设备,包括手机、平板和桌面电脑。

- **动态内容**:使用动画和过渡效果来提升用户体验。

- **搜索与筛选**:提供强大的搜索功能和筛选选项,帮助用户快速找到感兴趣的新闻。

- **个性化设置**:允许用户设置偏好,如主题订阅、通知设置等。

## 2.2 架构设计与技术选型

### 2.2.1 系统架构概述

新闻聚合器的系统架构应该设计得既高效又可扩展。一个典型的架构可能包括以下几个部分:

- **数据采集层**:负责从新闻源抓取数据。

- **数据处理层**:对抓取的数据进行清洗、转换和存储。

- **业务逻辑层**:处理业务规则,如内容推荐算法。

- **表现层**:即用户界面,展示内容给用户。

### 2.2.2 技术栈选择与理由

选择合适的技术栈对于项目的成功至关重要。以下是可能的技术选型及其理由:

- **前端**:React或Vue.js,因为它们拥有强大的社区支持和丰富的组件库,能够快速开发出响应式界面。

- **后端**:Node.js,因为它的非阻塞I/O模型适合处理大量并发连接,适合实时数据聚合的场景。

- **数据库**:MongoDB,因为它是一个文档型数据库,适合存储非结构化的数据,如新闻内容。

- **搜索引擎**:Elasticsearch,因为它的全文搜索功能强大,能够快速检索大量数据。

## 2.3 数据模型与存储方案

### 2.3.1 数据模型设计

数据模型是系统设计中的核心部分,它定义了数据的结构和关系。对于新闻聚合器,数据模型通常包括以下几个实体:

- **新闻源**:包含源的名称、URL、分类等信息。

- **新闻项**:包含标题、内容、作者、发布时间等信息。

- **用户**:包含用户的注册信息、偏好设置等。

### 2.3.2 数据存储与管理

选择合适的数据存储方案对于确保系统的性能和可扩展性至关重要。以下是一些考虑因素和可能的方案:

- **关系型数据库**:适合存储结构化的数据,如用户信息。

- **NoSQL数据库**:适合存储非结构化的数据,如新闻内容。

- **缓存系统**:如Redis,用于存储频繁访问的数据,以减少数据库的负载。

- **数据备份与恢复**:定期备份数据,并确保可以快速恢复以防数据丢失。

以上是对新闻聚合器设计思路的概述,接下来我们将详细介绍如何使用Feeds库来实现新闻聚合器的基本功能。

# 3. Feeds库的基本使用

## 3.1 Feeds库核心概念解析

### 3.1.1 Feed解析原理

在本章节中,我们将深入探讨Feeds库的核心概念,首先从Feed解析原理开始。Feed解析是指将不同格式的新闻源数据转换成统一结构的过程。Feeds库通过一系列预定义的解析规则,能够识别并转换RSS、Atom等格式的XML数据。这些规则定义了如何从XML结构中提取出新闻标题、链接、描述等信息,并将其封装成统一的数据模型。

解析原理的核心在于XPath或CSS选择器的使用,这些选择器能够精确地定位XML文档中的元素。例如,一个典型的RSS源可能包含多个`<item>`元素,每个`<item>`元素代表一条新闻。Feeds库会使用XPath规则来定位所有`<title>`和`<link>`元素,从中提取文本内容,并将其与对应的新闻条目关联起来。

### 3.1.2 核心组件介绍

Feeds库的核心组件包括Feed解析器、数据处理器和事件监听器。Feed解析器负责读取原始数据并将其转换为内部数据模型;数据处理器则负责进一步处理这些数据,如过滤、转换格式等;事件监听器用于在解析过程中触发特定的回调函数,以便进行自定义的处理逻辑。

例如,以下是一个简单的代码示例,展示了如何使用Feeds库解析RSS源:

```python

import feeds

def parse_rss(url):

feed = feeds.parse(url)

for entry in feed.entries:

print("Title: %s" % entry.title)

print("Link: %s" % entry.link)

print("Published: %s" % entry.published)

# 使用示例

parse_rss("***")

```

在这个例子中,`feeds.parse`函数负责解析给定URL的RSS源,`feed.entries`包含了所有解析出来的新闻条目。我们通过循环遍历每个条目,并打印出标题、链接和发布日期。

## 3.2 Feeds库的数据处理

### 3.2.1 数据提取与转换

数据提取与转换是Feeds库的重要功能之一。在本章节中,我们将详细讨论如何使用Feeds库进行数据提取和转换。数据提取通常涉及从原始XML文档中提取特定的信息,如新闻标题、链接和描述等。转换则是指将提取出的数据转换为更易于处理或展示的格式。

Feeds库提供了一系列内置的提取器和转换器,可以处理常见的数据格式。例如,`TitleExtractor`用于提取标题,`LinkExtractor`用于提取链接,而`DateExtractor`则用于提取发布时间。这些提取器可以直接应用于`feed.entries`中的每个条目。

转换功能允许开发者将提取出的数据转换为JSON、CSV或其他自定义格式。例如,以下代码展示了如何将RSS源中的数据转换为JSON格式:

```python

import json

import feeds

def parse_and_convert_to_json(url):

feed = feeds.parse(url)

entries = []

for entry in feed.entries:

entry_data = {

"title": entry.title,

"link": entry.link,

"published": entry.published

}

entries.append(entry_data)

return json.dumps(entries, indent=4)

# 使用示例

json_data = parse_and_convert_to_json("***")

print(json_data)

```

在这个例子中,我们首先解析了RSS源,然后创建了一个包含标题、链接和发布时间的字典列表。最后,我们使用`json.dumps`将这个列表转换为JSON格式的字符串。

### 3.2.2 数据过滤与优化

在本章节中,我们将探讨如何在使用Feeds库时进行数据过滤与优化。数据过滤是处理大量数据时的一个重要环节,它可以帮助我们从原始数据集中筛选出有用的信息,并去除不必要的数据。优化则是指通过各种方法提高数据处理的效率和性能。

Feeds库提供了多种内置的过滤器,可以帮助开发者根据不同的条件筛选出所需的新闻条目。例如,`CategoryFilter`可以根据分类筛选条目,`DateFilter`可以根据发布时间筛选条目。以下是一个使用`DateFilter`的示例:

```python

from datetime import datetime, timedelta

import feeds

def filter_recent_entries(url, days=7):

feed = feeds.parse(url)

recent_entries = []

now = datetime.now()

for entry in feed.entries:

entry_published = datetime.strptime(entry.published, "%a, %d %b %Y %H:%M:%S %z")

if now - entry_published < timedelta(days=days):

recent_entries.append(entry)

return recent_entries

# 使用示例

recent_entries = filter_recent_entries("***")

for entry in recent_entries:

print("Recent Entry: %s" % entry.title)

```

在这个例子中,

0

0