【Feeds库数据解析实战】:RSS_Atom源解析技巧与最佳实践

发布时间: 2024-10-13 13:19:03 阅读量: 1 订阅数: 2

# 1. RSS和Atom Feeds标准概述

在信息爆炸的时代,RSS和Atom Feeds成为了内容聚合和分发的重要标准。本章将为您概述这两种标准的基本概念、结构特点以及它们在现代Web应用中的作用。

## 1.1 RSS和Atom的历史与发展

RSS(Really Simple Syndication)和Atom都是XML格式的文档,用于共享网络新闻和Web内容。RSS的起源可以追溯到Netscape对一种“丰富站点摘要”的需求,而Atom则是为了解决RSS在版权和许可上的限制而产生。

## 1.2 RSS和Atom的数据模型

RSS和Atom的数据模型由一系列的标签组成,每个标签代表不同类型的信息。RSS通常包含频道(channel)和项目(item),而Atom则使用条目(entry)来表示内容项。

## 1.3 RSS和Atom在现代Web应用中的角色

在今天的Web应用中,RSS和Atom Feeds用于内容聚合、新闻订阅、博客更新通知等多种场景。它们提供了一种标准化的数据格式,使得信息可以跨平台、跨设备地进行分发和消费。

以上内容仅为第一章的部分概述,接下来将深入探讨如何选择和安装Feeds库,以及如何进行基本的Feeds数据解析。

# 2. Feeds库的选择与安装

在本章节中,我们将深入探讨如何选择和安装适用于RSS和Atom Feeds处理的库。这一步骤对于初学者和资深开发者来说都是至关重要的,因为选择合适的库可以大大提高开发效率,避免不必要的麻烦。我们将从库的选择、安装过程、以及如何验证安装是否成功等方面进行详细介绍。

## 2.1 Feeds库的选择

### 2.1.1 选择标准

选择合适的Feeds库需要考虑以下几个标准:

1. **兼容性**:确保库支持RSS和Atom两种Feeds格式,以及最新的Feeds标准。

2. **性能**:评估库的解析速度和内存消耗,选择性能最优的库。

3. **社区支持**:一个活跃的社区可以提供帮助和更新,确保库的长期可用性。

4. **文档**:详尽的文档和示例代码可以帮助开发者更快地上手和解决问题。

5. **扩展性**:选择易于扩展和维护的库,以便于未来的需求变更。

### 2.1.2 常见的Feeds库

以下是一些常见的Feeds库,分别适用于不同的编程语言:

- **Python**: `feedparser`,`feedflask`

- **JavaScript**: `node-rss`,`rss-parser`

- **Java**: `Rome`,`SimpleRSS`

- **Ruby**: `feedjira`

### 2.1.3 比较分析

在选择库时,可以通过以下维度进行比较:

- **功能对比**:比较各个库提供的功能,如解析、生成、验证等。

- **性能测试**:通过基准测试来评估不同库的性能。

- **社区活跃度**:检查库的最新更新和社区讨论活跃度。

## 2.2 Feeds库的安装

### 2.2.1 安装步骤

以Python的`feedparser`库为例,安装步骤如下:

```bash

pip install feedparser

```

安装完成后,可以通过以下命令验证安装是否成功:

```python

python -m feedparser --help

```

### 2.2.2 安装注意事项

- **环境兼容性**:确保所选库与你的开发环境兼容。

- **依赖关系**:注意库的依赖关系,可能需要安装额外的包。

- **更新频率**:选择更新频率高的库,以确保安全性和新功能的及时性。

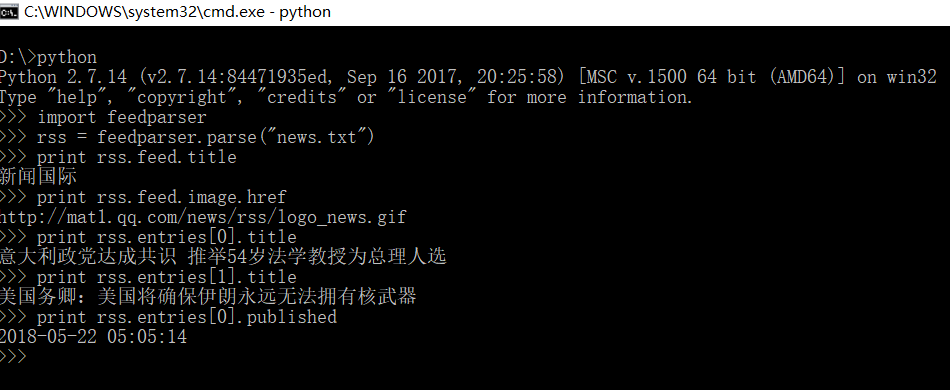

### 2.2.3 验证安装

安装完成后,通过编写简单的代码来验证库是否正常工作:

```python

import feedparser

# 示例RSS链接

feed_url = "***"

feed = feedparser.parse(feed_url)

print(feed.feed.title)

```

如果能够正确输出RSS源的标题,则表示安装成功。

## 2.3 Feeds库的应用示例

### 2.3.1 解析RSS源

以`feedparser`库为例,展示如何解析一个RSS源:

```python

import feedparser

# 示例RSS链接

feed_url = "***"

feed = feedparser.parse(feed_url)

# 输出RSS源的标题和链接

print("Feed Title:", feed.feed.title)

print("Feed Link:", feed.feed.link)

# 遍历条目

for entry in feed.entries:

print("Entry Title:", entry.title)

print("Entry Link:", entry.link)

```

### 2.3.2 解析Atom源

对于Atom源,基本的使用方法类似,只需更换RSS源链接即可。

```python

import feedparser

# 示例Atom链接

feed_url = "***"

feed = feedparser.parse(feed_url)

# 输出Atom源的标题和链接

print("Feed Title:", feed.feed.title)

print("Feed Link:", feed.feed.link)

# 遍历条目

for entry in feed.entries:

print("Entry Title:", entry.title)

print("Entry Link:", entry.link)

```

### 2.3.3 解析结果

通过上述代码,我们可以获取到Feeds源中的标题、链接以及条目信息。这些信息可以用于进一步的数据处理和展示。

### 2.3.4 异常处理

在解析过程中,可能会遇到网络问题或格式错误,因此需要进行异常处理:

```python

import feedparser

try:

feed = feedparser.parse(feed_url)

except Exception as e:

print("Error:", e)

```

## 2.4 小结

在本章节中,我们介绍了如何选择和安装Feeds库,并通过实际的代码示例展示了如何使用这些库来解析RSS和Atom Feeds。此外,我们还讨论了如何验证安装和处理解析过程中可能出现的异常。这些知识对于后续章节中更深入的Feeds数据解析和应用至关重要。

通过本章节的介绍,你应该对如何选择合适的Feeds库、进行安装和基本使用有了清晰的认识。在下一章节中,我们将深入探讨Feeds数据结构的解析,包括RSS和Atom的数据模型、标签和属性的解析,以及条目的解析技巧。

# 3. 基本的Feeds数据解析

在本章节中,我们将深入探讨Feeds数据解析的基本原理和技巧。Feeds数据解析是将RSS或Atom格式的数据转换为可操作的结构化信息的过程。这一过程对于开发个人新闻聚合器、RSS阅读器或其他需要处理Feeds的应用程序至关重要。我们将从Feeds数据结构解析开始,逐步过渡到条目解析技巧,最后讨论错误处理与异常管理的最佳实践。

## 3.1 Feeds数据结构解析

### 3.1.1 RSS和Atom数据模型

RSS和Atom是两种流行的Feeds标准,它们的数据模型虽然类似,但在细节上有所不同。RSS(Really Simple Syndication)最初被设计为一种用于共享网站更新内容的方式,而Atom则是为了提供一种更为开放和灵活的标准。尽管如此,它们的基本数据模型都包含以下几个关键部分:

- **Channel/Feed**: 代表一个数据源,包含有关源的元数据,如标题、链接、描述等。

- **Item/Entry**: 代表单个内容条目,例如博客文章或新闻条目。

- **Date/Updated**: 条目的发布时间或最后更新时间。

RSS和Atom的具体实现可能会有所不同,但上述组件是大多数Feeds中都会找到的共同元素。了解这些基本组件对于后续的数据解析至关重要。

### 3.1.2 解析标签和属性

在解析RSS或Atom Feeds时,我们需要关注数据模型中的标签和属性。这些标签和属性定义了Feeds的结构和内容。以下是一些RSS和Atom中常见的标签和属性:

#### RSS标签和属性

- `<channel>`: 包含整个Feed的信息。

- `<title>`: Feed的标题。

- `<link>`: Feed的URL链接。

- `<description>`: Feed的描述。

- `<item>`: 单个条目的容器。

- `<pubDate>`: 条目的发布日期。

#### Atom标签和属性

- `<feed>`: 包含整个Feed的信息。

- `<title>`: Feed的标题。

- `<link>`: Feed的URL链接,可能有多个。

- `<updated>`: Feed的最后更新时间。

- `<entry>`: 单个条目的容器。

- `<published>`: 条目的发布日期。

在解析Feeds时,我们需要编写代码来识别和提取这些标签和属性中的数据。这通常涉及到遍历XML文档,并使用XPath或类似技术来定位特定的节点和属性。

## 3.2 Feeds条目解析技巧

### 3.2.1 标题和链接的提取

Feeds条目的标题和链接是最重要的信息之一。以下是一个简单的Python代码示例,展示了如何使用BeautifulSoup库来提取RSS Feed中的标题和链接:

```python

from bs4 import BeautifulSoup

import requests

# 获取RSS Feed内容

url = '***'

response = requests.get(url)

feed = response.content

# 解析RSS Feed

soup = BeautifulSoup(feed, 'xml')

items = soup.find_all('item')

for item in items:

title = item.find('title').text

link = item.find('link').text

print(f'Title: {title}')

print(f'Link: {link}')

```

在这个例子中,我们首先使用requests库获取RSS Feed的内容,然后使用BeautifulSoup解析XML文档。`find_all('item')`方法用于找到所有的`<item>`标签,然后我们提取每个条目的`<title>`和`<link>`标签中的文本。

### 3.2.2 内容解析与处理

除了标题和链接之外,条目的内容也是解析的重要部分。RSS条目的内容通常位于`<description>`或`<content:encoded>`标签中,而Atom条目的内容则位于`<content>`标签中。内容可能需要进一步的处理,例如去除HTML标签或转换字符编码。

### 3.2.3 日期和作者信息的获取

条目的发布日期和作者信息也是重要的元数据。在RSS中,发布日期通常存储在`<pubDate>`标签中,而在Atom中,则存储在`<updated>`标签中。作者信息可能包含在`<author>`或`<dc:creator>`标签中。

## 3.3 错误处理与异常管理

### 3.3.1 常见解析错误类型

在解析Feeds时,可能会遇到多种错误类型,包括:

- **格式错误**: Feeds格式不符合规范,例如XML结构错误。

- **编码问题**: 字符编码不正确或不一致。

- **缺失数据**: 必需的标签或属性缺失。

- **网络问题**: 无法访问或检索Feeds内容。

### 3.3.2 异常处理的最佳实践

为了有效地处理这些错误,我们可以采用以下最佳实践:

- **使用健壮的解析库**: 选择像BeautifulSoup这样的库,它们能够优雅地处理格式错误。

- **预处理数据**: 在解析之前,对数据进行预处理,例如检查和清理字符编码。

- **定义错误处理策略**: 为不同类型的错误定义清晰的处理策略,例如记录日志、重试请求或返回默认值。

- **单元测试**: 编写单元测试来验证解析逻辑,并确保其在各种情况下都能正确工作。

在本章节中,我们介绍了Feeds数据解析的基础知识,包括数据模型的理解、标签和属性的提取、内容解析以及错误处理的最佳实践。在下一章中,我们将探讨高级的Feeds数据解析技巧,包括命名空间与扩展解析、解析效率优化以及解析数据的存储与应用。

# 4. 高级Feeds数据解析

## 4.1 命名空间与扩展解析

### 4.1.1 RSS和Atom的命名空间解析

在RSS和Atom Feeds标准中,命名空间(namespace)用于区分不同的数据结构和元素,尤其是在扩展元素出现时。理解命名空间对于正确解析Feeds数据至关重要,因为它帮助程序识别哪些元素是标准定义的,哪些可能是第三方扩展的。

命名空间通常通过XML的`xmlns`属性来声明,例如:

```xml

<rss version="2.0" xmlns:content="***">

...

<item>

<title>Example Title</title>

<link>***</link>

<content:encoded>Article content goes here...</content:encoded>

</item>

...

</rss>

```

在解析RSS或Atom Feeds时,我们需要编写代码来识别并处理这些命名空间。以下是一个使用Python的lxml库解析上述RSS Feeds的示例代码:

```python

from lxml import etree

rss_xml = """<rss version="2.0" xmlns:content="***">

...

<item>

<title>Example Title</title>

<link>***</link>

<content:encoded>Article content goes here...</content:encoded>

</item>

...

</rss>"""

rss_tree = etree.XML(rss_xml)

# 获取命名空间

namespaces = {'rss': '***填写.org/rss/2.0/',

'content': '***'}

# 选择特定命名空间下的元素

encoded_content = rss_tree.xpath("//rss:item/rss:title", namespaces=namespaces)

print(encoded_content)

```

在上述代码中,我们首先导入了`lxml.etree`模块,然后定义了RSS XML字符串。我们使用`etree.XML`函数解析XML,并定义了一个命名空间字典。`xpath`函数用于选择命名空间下的元素。

### 4.1.2 扩展元素和模块的处理

扩展元素在RSS和Atom Feeds中非常常见,它们允许Feeds提供比标准更丰富的信息。例如,`content:encoded`元素在RSS中用于包含完整的文章内容,而不仅仅是简短的摘要。

处理扩展元素需要特别注意,因为它们可能包含与标准元素相同名称的不同数据。解析时,我们需要检查元素是否属于扩展命名空间,并相应地处理它们。

以下是处理RSS中扩展元素的代码示例:

```python

# 处理扩展元素

content_encoded = rss_tree.xpath("//rss:item/content:encoded", namespaces=namespaces)

print(content_encoded)

```

在这个例子中,我们使用`xpath`函数选择了一个属于`content`命名空间的扩展元素`content:encoded`。这样,我们就可以获取到文章的完整内容,而不是标准的摘要。

### 4.1.3 解析标签和属性

RSS和Atom Feeds中的标签和属性定义了Feeds的结构和内容。在高级解析中,我们需要关注这些标签和属性的细节,以便提取有用的数据。

对于RSS Feeds,常见的标签包括`<channel>`、`<item>`、`<title>`、`<link>`等。Atom Feeds则使用`<feed>`、`<entry>`等标签。属性则提供了额外的信息,如更新时间、作者等。

### 4.1.4 解析标签和属性

在本章节中,我们将深入探讨如何解析RSS和Atom Feeds中的标签和属性。这些元素和属性是构成Feeds内容的基本单元,理解它们对于构建高级Feeds解析器至关重要。

#### RSS标签和属性解析

RSS Feeds使用特定的标签和属性来组织内容。例如,`<channel>`标签包含关于整个Feeds的信息,如标题、描述和链接。每个`<item>`标签代表一个独立的条目,包含标题、链接和描述等信息。

```xml

<rss version="2.0">

<channel>

<title>Example Feed</title>

<link>***</link>

<description>Example RSS Feed</description>

</channel>

<item>

<title>Example Title</title>

<link>***</link>

<description>Article description...</description>

</item>

...

</rss>

```

在解析RSS Feeds时,我们需要编写代码来提取这些标签和属性,并将它们映射到适当的数据结构中。以下是一个使用Python的lxml库来解析上述RSS Feeds的示例代码:

```python

from lxml import etree

rss_xml = """<rss version="2.0">

<channel>

<title>Example Feed</title>

<link>***</link>

<description>Example RSS Feed</description>

</channel>

<item>

<title>Example Title</title>

<link>***</link>

<description>Article description...</description>

</item>

...

</rss>"""

rss_tree = etree.XML(rss_xml)

# 获取RSS Feeds的基本信息

feed_info = rss_tree.xpath("//rss:channel/rss:title/text()", namespaces={'rss': '***填写.org/rss/2.0/'})

print("Feed Title:", feed_info[0])

# 获取每个条目的信息

items = rss_tree.xpath("//rss:item", namespaces={'rss': '***填写.org/rss/2.0/'})

for item in items:

title = item.xpath("rss:title/text()", namespaces={'rss': '***填写.org/rss/2.0/'})

link = item.xpath("rss:link/text()", namespaces={'rss': '***填写.org/rss/2.0/'})

description = item.xpath("rss:description/text()", namespaces={'rss': '***填写.org/rss/2.0/'})

print("Item Title:", title[0])

print("Item Link:", link[0])

print("Item Description:", description[0])

print()

```

在上述代码中,我们首先解析了RSS XML,并使用`xpath`函数提取了Feeds的基本信息和每个条目的详细信息。每个条目的标题、链接和描述都被提取出来,并打印出来。

#### Atom标签和属性解析

Atom Feeds使用不同的标签和属性结构。`<feed>`标签代表整个Feeds,而`<entry>`标签代表单个条目。Atom Feeds还可能包含其他元素,如`<author>`、`<updated>`等。

```xml

<feed xmlns="***填写.org/2005/Atom">

<title>Example Feed</title>

<link href="***" rel="alternate"/>

<updated>2023-01-01T00:00:00Z</updated>

<entry>

<title>Example Title</title>

<link href="***"/>

<summary>Article summary...</summary>

<updated>2023-01-01T00:00:00Z</updated>

<author>

<name>Author Name</name>

</author>

</entry>

...

</feed>

```

在解析Atom Feeds时,我们需要编写代码来识别和处理这些标签和属性。以下是一个使用Python的lxml库来解析上述Atom Feeds的示例代码:

```python

from lxml import etree

atom_xml = """<feed xmlns="***填写.org/2005/Atom">

<title>Example Feed</title>

<link href="***" rel="alternate"/>

<updated>2023-01-01T00:00:00Z</updated>

<entry>

<title>Example Title</title>

<link href="***"/>

<summary>Article summary...</summary>

<updated>2023-01-01T00:00:00Z</updated>

<author>

<name>Author Name</name>

</author>

</entry>

...

</feed>"""

atom_tree = etree.XML(atom_xml)

# 获取Atom Feeds的基本信息

feed_info = atom_tree.xpath("/feed/title/text()")

print("Feed Title:", feed_info[0])

# 获取每个条目的信息

entries = atom_tree.xpath("/feed/entry")

for entry in entries:

title = entry.xpath("title/text()")

link = entry.xpath("link/@href")

summary = entry.xpath("summary/text()")

updated = entry.xpath("updated/text()")

author = entry.xpath("author/name/text()")

print("Entry Title:", title[0])

print("Entry Link:", link[0])

print("Entry Summary:", summary[0])

print("Entry Updated:", updated[0])

print("Entry Author:", author[0])

print()

```

在上述代码中,我们解析了Atom XML,并使用`xpath`函数提取了Feeds的基本信息和每个条目的详细信息。每个条目的标题、链接、摘要、更新时间和作者都被提取出来,并打印出来。

### 4.1.5 解析标签和属性的逻辑分析

在解析RSS和Atom Feeds时,我们需要编写代码来处理这些标签和属性。这些元素和属性是构成Feeds内容的基本单元,理解它们对于构建高级Feeds解析器至关重要。

#### RSS解析逻辑

在RSS解析中,我们需要特别注意`<channel>`和`<item>`标签,以及它们的子标签。`<channel>`标签包含了整个Feeds的信息,如标题、描述和链接。`<item>`标签则包含了单个条目的信息,如标题、链接和描述。

以下是一个使用Python的lxml库来解析RSS Feeds的逻辑分析:

```python

from lxml import etree

rss_xml = """<rss version="2.0">

<channel>

<title>Example Feed</title>

<link>***</link>

<description>Example RSS Feed</description>

</channel>

<item>

<title>Example Title</title>

<link>***</link>

<description>Article description...</description>

</item>

...

</rss>"""

rss_tree = etree.XML(rss_xml)

# 获取RSS Feeds的基本信息

feed_info = rss_tree.xpath("//rss:channel/rss:title/text()", namespaces={'rss': '***填写.org/rss/2.0/'})

print("Feed Title:", feed_info[0])

# 获取每个条目的信息

items = rss_tree.xpath("//rss:item", namespaces={'rss': '***填写.org/rss/2.0/'})

for item in items:

title = item.xpath("rss:title/text()", namespaces={'rss': '***填写.org/rss/2.0/'})

link = item.xpath("rss:link/text()", namespaces={'rss': '***填写.org/rss/2.0/'})

description = item.xpath("rss:description/text()", namespaces={'rss': '***填写.org/rss/2.0/'})

print("Item Title:", title[0])

print("Item Link:", link[0])

print("Item Description:", description[0])

print()

```

在上述代码中,我们首先解析了RSS XML,并使用`xpath`函数提取了Feeds的基本信息和每个条目的详细信息。每个条目的标题、链接和描述都被提取出来,并打印出来。

#### Atom解析逻辑

在Atom解析中,我们需要特别注意`<feed>`和`<entry>`标签,以及它们的子标签。`<feed>`标签包含了整个Feeds的信息,如标题、描述和链接。`<entry>`标签则包含了单个条目的信息,如标题、链接和描述。

以下是一个使用Python的lxml库来解析Atom Feeds的逻辑分析:

```python

from lxml import etree

atom_xml = """<feed xmlns="***填写.org/2005/Atom">

<title>Example Feed</title>

<link href="***" rel="alternate"/>

<updated>2023-01-01T00:00:00Z</updated>

<entry>

<title>Example Title</title>

<link href="***"/>

<summary>Article summary...</summary>

<updated>2023-01-01T00:00:00Z</updated>

<author>

<name>Author Name</name>

</author>

</entry>

...

</feed>"""

atom_tree = etree.XML(atom_xml)

# 获取Atom Feeds的基本信息

feed_info = atom_tree.xpath("/feed/title/text()")

print("Feed Title:", feed_info[0])

# 获取每个条目的信息

entries = atom_tree.xpath("/feed/entry")

for entry in entries:

title = entry.xpath("title/text()")

link = entry.xpath("link/@href")

summary = entry.xpath("summary/text()")

updated = entry.xpath("updated/text()")

author = entry.xpath("author/name/text()")

print("Entry Title:", title[0])

print("Entry Link:", link[0])

print("Entry Summary:", summary[0])

print("Entry Updated:", updated[0])

print("Entry Author:", author[0])

print()

```

在上述代码中,我们解析了Atom XML,并使用`xpath`函数提取了Feeds的基本信息和每个条目的详细信息。每个条目的标题、链接、摘要、更新时间和作者都被提取出来,并打印出来。

# 5. Feeds库的实际应用案例

## 5.1 实战:构建个人新闻聚合器

### 5.1.1 需求分析与设计

在构建个人新闻聚合器的过程中,首先需要进行需求分析。这包括确定聚合器的功能范围,例如是否支持RSS和Atom格式的Feeds,用户是否可以自定义订阅源,以及是否需要支持不同设备和平台等。设计阶段则涉及到确定软件的架构,选择合适的技术栈,以及定义用户界面(UI)和用户体验(UX)的流程。

**需求分析:**

- 支持RSS和Atom格式的Feeds。

- 用户可以自定义添加和管理订阅源。

- 提供基本的Feeds更新机制,例如定时更新。

- 支持多种设备和平台,例如Web、移动应用等。

**设计考虑:**

- **架构设计**:采用微服务架构,以便于未来的扩展和维护。

- **技术选型**:前端使用React或Vue.js,后端使用Node.js和Express框架。

- **数据库选择**:使用MongoDB或MySQL存储用户订阅信息和Feeds内容。

- **缓存机制**:采用Redis等内存数据库提高数据访问速度和减少数据库压力。

### 5.1.2 Feeds源的订阅与更新机制

在实现Feeds源的订阅与更新机制时,需要考虑以下几个关键点:

1. **订阅管理**:用户可以通过输入URL或者选择预定义的Feeds源来订阅。

2. **更新机制**:定时任务或后台服务来定期检查Feeds源是否有更新。

3. **数据解析**:对获取的Feeds数据进行解析,并存储到数据库中。

4. **通知机制**:当新内容可用时,通过邮件或应用内通知等方式提醒用户。

**代码示例:**

```javascript

// 假设使用Node.js和Express框架

const express = require('express');

const fetch = require('node-fetch');

const cheerio = require('cheerio');

const app = express();

const feedUpdateInterval = 60 * 1000; // 每分钟更新一次

// 定义Feeds源

const feeds = [

{ id: 1, name: 'TechCrunch', url: '***' },

// 更多Feeds源...

];

// 更新Feeds源

function updateFeeds() {

feeds.forEach(feed => {

fetch(feed.url)

.then(response => response.text())

.then(html => {

const $ = cheerio.load(html);

$('item').each((index, element) => {

const title = $(element).find('title').text().trim();

const link = $(element).find('link').text().trim();

// 解析更多内容...

});

})

.catch(error => console.error(`Error fetching ${feed.url}:`, error));

});

}

// 定时任务

setInterval(updateFeeds, feedUpdateInterval);

app.listen(3000, () => {

console.log('News aggregator app listening on port 3000!');

});

```

在上述代码中,我们定义了一个Express应用,它使用`node-fetch`库来获取Feeds源的内容,并使用`cheerio`库来解析HTML格式的Feeds内容。我们设置了一个定时任务,每分钟执行一次更新函数`updateFeeds`。

**逻辑分析:**

- **请求Feeds源**:使用`fetch`函数请求每个Feeds源的URL。

- **解析Feeds内容**:使用`cheerio`加载获取的HTML内容,并通过CSS选择器解析所需的Feeds条目信息。

- **存储到数据库**:解析出的条目信息需要存储到数据库中,以便后续的查询和显示。

**参数说明:**

- `feedUpdateInterval`:定义了Feeds源更新的时间间隔。

- `feeds`数组:包含了Feeds源的ID、名称和URL。

### 5.2 实战:RSS阅读器开发

#### 5.2.1 用户界面设计与交互逻辑

在开发RSS阅读器时,用户界面设计和交互逻辑是关键的组成部分。用户界面应该简洁直观,使用户能够轻松地添加、管理和阅读订阅的RSS源。以下是一些基本的设计原则:

1. **简洁性**:界面不应过于复杂,避免用户感到困惑。

2. **功能性**:提供必要的功能,如添加/删除订阅源、标记阅读、搜索等。

3. **响应性**:适配不同的设备和屏幕尺寸。

**交互逻辑:**

- **添加订阅源**:用户通过输入URL或者选择内置的RSS源来添加新的订阅。

- **阅读文章**:用户可以在列表中查看订阅源的文章,并点击阅读详细内容。

- **标记阅读状态**:用户可以标记文章为已读或未读,方便下次阅读时快速定位。

**用户界面设计:**

- **主界面**:显示订阅源的列表和最新文章。

- **文章详情页**:展示文章的详细内容,并提供阅读标记功能。

- **设置界面**:用户可以管理订阅源,包括添加、删除和编辑。

#### 5.2.2 功能实现与性能优化

在功能实现方面,需要关注以下几个主要功能的实现:

1. **Feeds解析**:解析RSS源以获取文章信息。

2. **数据库交互**:存储用户订阅信息和阅读状态。

3. **网络请求**:定期从订阅源获取最新内容。

**代码示例:**

```javascript

// 假设使用React和Redux架构

import React, { useState, useEffect } from 'react';

import { useSelector, useDispatch } from 'react-redux';

import { fetchFeeds, addFeed } from './actions';

const FeedList = () => {

const [url, setUrl] = useState('');

const dispatch = useDispatch();

const feeds = useSelector(state => state.feeds);

useEffect(() => {

dispatch(fetchFeeds());

}, [dispatch]);

const handleAddFeed = () => {

dispatch(addFeed(url));

setUrl('');

};

return (

<div>

<input type="text" value={url} onChange={e => setUrl(e.target.value)} />

<button onClick={handleAddFeed}>添加订阅</button>

<ul>

{feeds.map(feed => (

<li key={feed.id}>{feed.title}</li>

))}

</ul>

</div>

);

};

export default FeedList;

```

在上述代码中,我们创建了一个React组件`FeedList`,它使用Redux进行状态管理。组件包含一个输入框用于输入订阅源的URL,一个按钮用于添加订阅源,以及一个列表显示当前的所有订阅源。

**逻辑分析:**

- **状态管理**:使用Redux管理应用状态,包括订阅源列表和用户操作。

- **订阅源添加**:用户输入URL后点击按钮,触发`addFeed`动作,将新的订阅源添加到数据库。

- **订阅源更新**:使用`fetchFeeds`动作定期获取和更新订阅源的内容。

**性能优化:**

- **数据缓存**:使用Redux的中间件如`redux-thunk`或`redux-saga`实现数据缓存,减少不必要的网络请求。

- **懒加载**:对于文章列表和详情,采用懒加载技术,只加载用户可见的内容。

**参数说明:**

- `url`:用户输入的订阅源URL。

- `feeds`:从Redux状态中获取的订阅源列表。

通过以上内容,我们可以看到在实际应用案例中,如何将Feeds库集成到个人新闻聚合器和RSS阅读器的开发中。从需求分析到设计,再到功能实现和性能优化,每个步骤都需要细致的考虑和精心的设计。通过具体的代码示例和逻辑分析,我们可以更好地理解如何将理论应用到实践中,以及如何处理实际开发中遇到的各种问题。

# 6. Feeds库的未来展望与进阶技巧

## 6.1 Feeds标准的新趋势与挑战

随着互联网技术的快速发展,Feeds标准也在不断进化,以适应新的需求和挑战。新兴的Feeds格式和标准不断涌现,为信息的传播和获取提供了更多可能,同时也带来了兼容性和安全性的挑战。

### 6.1.1 新兴的Feeds格式和标准

在现有的RSS和Atom标准之外,一些新兴的Feeds格式开始受到关注。例如JSON Feed,它以其简洁的格式和易读性受到开发者和API服务的青睐。JSON Feed的结构清晰,易于解析,而且可以直接用于Web应用程序的前端展示。

```json

{

"version": "***",

"title": "Example Site",

"home_page_url": "***",

"feed_url": "***",

"description": "Example Site feed description",

"icon": "***",

"author": {

"name": "John Doe",

"url": "***"

},

"items": [

{

"id": "***",

"url": "***",

"title": "Article Title 1",

"content_text": "This is the content of the first article...",

"summary": "This is a summary of the first article...",

"date_published": "2020-10-14T15:21:36Z",

"image": "***"

}

// 更多的items...

]

}

```

### 6.1.2 Feeds数据的安全性问题

随着Feeds数据的广泛应用,其安全性问题也逐渐凸显。Feeds数据往往包含了大量外部链接,这些链接可能被用于钓鱼攻击或传播恶意软件。因此,Feeds解析库需要具备链接验证功能,确保解析的数据安全可靠。

```python

def validate_url(url):

try:

response = requests.head(url, allow_redirects=True, timeout=5)

return response.status_code == 200

except requests.RequestException:

return False

```

## 6.2 进阶技巧与最佳实践

为了更好地应对复杂的应用场景,Feeds解析库需要具备一些高级功能,同时也需要开发者掌握一些进阶技巧,以实现高效和可维护的代码。

### 6.2.1 高级解析技术的应用

高级解析技术包括但不限于DOM树解析、XPath查询和正则表达式匹配。这些技术可以帮助开发者在复杂的Feeds数据中快速定位和提取所需信息。

```python

from lxml import etree

def parse_feed_with_xpath(feed_xml, xpath_expression):

tree = etree.fromstring(feed_xml)

return tree.xpath(xpath_expression)

feed_xml = '<feed><title>Example Feed</title><entry><title>Article Title</title></entry></feed>'

xpath_expression = '//title/text()'

titles = parse_feed_with_xpath(feed_xml, xpath_expression)

```

### 6.2.2 代码重构与模块化实践

随着项目的发展,代码的可维护性变得越来越重要。代码重构和模块化实践可以帮助开发者保持代码的清晰和高效。

```python

# 原始代码示例

def parse_feed(feed_xml):

# 解析RSS或Atom的复杂逻辑

pass

# 重构后的模块化代码

class FeedParser:

def parse(self, feed_xml):

# 解析RSS或Atom的逻辑

pass

class FeedValidator:

def validate(self, feed_url):

# 验证RSS或Atom的逻辑

pass

```

## 6.3 社区贡献与开源项目

开源社区是推动Feeds库持续发展的重要力量。参与开源Feeds库的贡献不仅可以提升个人技能,还可以帮助维护和改进这些重要的工具。

### 6.3.1 参与开源Feeds库的贡献

参与开源项目的贡献可以采取多种形式,如提交bug修复、添加新功能、编写文档或提供代码审查等。这些贡献可以帮助开源项目保持活力和适应性。

### 6.3.2 开源项目管理与维护经验分享

开源项目管理需要一系列的工具和策略,如版本控制系统、持续集成和部署流程等。分享这些管理经验可以帮助新项目避免常见的陷阱,加速成熟。

```mermaid

graph LR

A[开始贡献] --> B[选择合适的项目]

B --> C[了解项目文档]

C --> D[设置开发环境]

D --> E[编写代码]

E --> F[提交Pull Request]

F --> G[等待代码审查]

G --> H{审查通过?}

H -->|是| I[合并代码]

H -->|否| J[修改代码]

J --> F

I --> K[项目发布]

```

通过上述内容,我们可以看到,Feeds库的未来展望是充满机遇和挑战的。无论是技术的创新、安全性的提升,还是社区的贡献,都需要我们不断学习和探索。希望本章节的内容能为你提供一些启发和指导。

0

0