BERT文本分类在问答系统中的应用:提升回答准确率

发布时间: 2024-08-20 02:35:06 阅读量: 64 订阅数: 24

python基于Bert的智能问答系统

# 1. BERT文本分类简介

BERT(双向编码器表示模型)是一种预训练的语言模型,它通过双向处理文本序列来学习单词的上下文表示。BERT文本分类利用BERT强大的文本表示能力,对文本进行分类,从而实现文本的语义理解。

BERT文本分类的优势在于其准确性和泛化能力。通过在大量无标签文本数据集上进行预训练,BERT模型能够捕捉到文本的丰富语义信息。这使得BERT文本分类器能够对不同领域和风格的文本进行有效分类,并具有较强的泛化能力。

# 2. BERT文本分类在问答系统中的应用

### 2.1 BERT模型的理论基础

#### 2.1.1 BERT模型的架构和原理

BERT(Bidirectional Encoder Representations from Transformers)是一种由Google AI开发的预训练语言模型。它采用Transformer编码器结构,能够双向处理文本序列,捕获文本中单词之间的上下文关系。

BERT模型的架构主要包括:

- **输入层:**将文本序列转换为嵌入向量,表示单词的语义信息。

- **Transformer编码器:**由多个自注意力层和前馈层组成,用于捕获文本中的上下文关系。

- **输出层:**根据特定任务(如文本分类)输出预测结果。

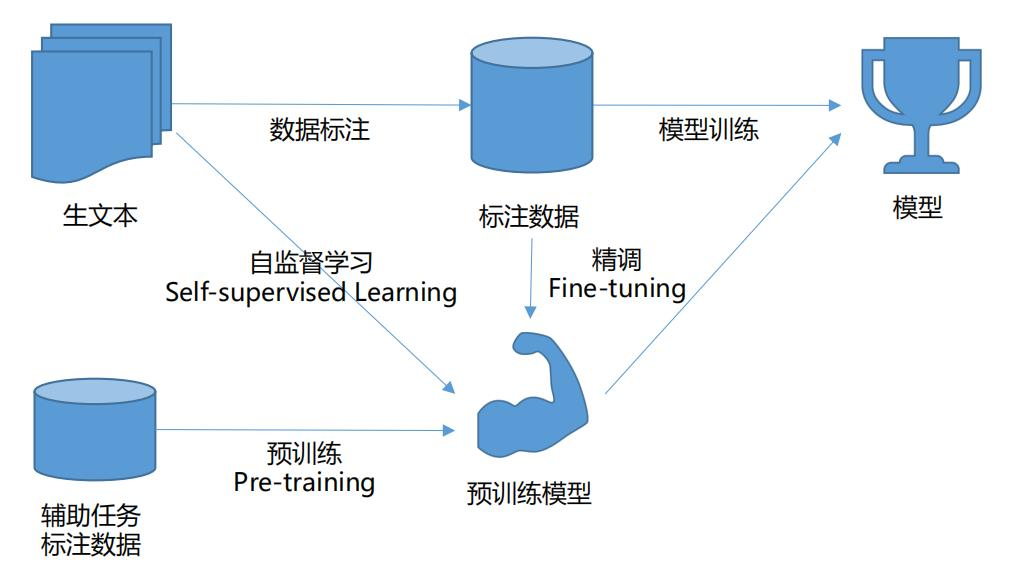

#### 2.1.2 BERT模型的训练和微调

BERT模型的训练分为两个阶段:

1. **预训练:**在海量的文本语料库上进行无监督学习,学习文本中单词的语义表示。

2. **微调:**针对特定任务进行有监督学习,调整模型参数以适应任务需求。

### 2.2 BERT文本分类在问答系统中的实践

#### 2.2.1 BERT模型的集成方式

将BERT模型集成到问答系统中,主要有以下两种方式:

1. **特征提取:**将BERT模型作为特征提取器,提取文本的语义特征,然后将特征输入到分类器中进行预测。

2. **端到端训练:**直接将BERT模型作为分类器,对文本进行分类,无需提取特征。

#### 2.2.2 BERT模型的训练和评估

BERT模型在问答系统中的训练和评估过程与其他文本分类任务类似:

1. **数据准备:**收集和预处理问答数据集,包括问题、答案和标签。

2. **模型训练:**选择合适的BERT模型,并针对问答数据集进行微调。

3. **模型评估:**使用验证集或测试集评估模型的性能,包括准确率、召回率和F1值等指标。

**代码示例:**

```python

import transformers

# 加载预训练的BERT模型

model = transformers.AutoModelForSequenceClassification.from_pretrained("bert-base-uncased")

# 训练数据集

train_dataset = transformers.Dataset.from_pandas(pd.DataFrame({"question": questions, "answer": answers, "label": labels}))

# 微调模型

trainer = transformers.Trainer(

model=model,

train_dataset=train_dataset,

args=transformers.TrainingArguments(num_train_epochs=3)

)

trainer.train

```

0

0