SVM分类算法的优缺点大比拼:全面解析其优势与不足

发布时间: 2024-08-20 04:30:52 阅读量: 232 订阅数: 28

4.SVM分类算法_分类算法_SVM_

# 1. SVM分类算法概述

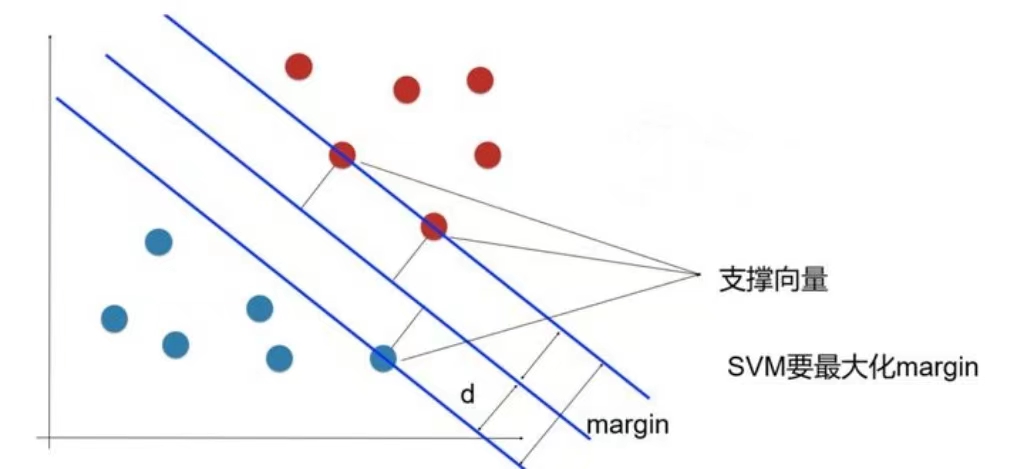

支持向量机(SVM)是一种强大的分类算法,以其在高维空间中处理非线性问题的出色性能而闻名。SVM通过找到将不同类别的样本分开的最佳超平面来工作,最大化超平面的间隔,从而提高分类精度。

SVM算法的基本原理是将数据映射到高维特征空间,然后在该空间中找到一个最佳超平面。通过使用核函数,SVM可以有效地处理非线性问题,即使在原始输入空间中数据是线性不可分的。

# 2. SVM分类算法的优点

SVM分类算法因其在高维空间中表现出色、泛化能力强和鲁棒性好等优点而备受推崇。

### 2.1 高维空间中的良好性能

#### 2.1.1 核函数的应用

SVM算法的一个关键优势在于它可以利用核函数将低维数据映射到高维特征空间。这使得SVM能够处理线性不可分的非线性问题。通过选择合适的核函数,SVM可以将数据点投影到一个更高维度的空间,使其在该空间中线性可分。

#### 2.1.2 非线性问题的处理

核函数的应用使SVM能够有效地处理非线性问题。例如,考虑一个数据集,其中数据点不能通过一条直线线性分开。通过使用高斯核函数,SVM可以将数据点映射到一个高维空间,使其在该空间中线性可分。

### 2.2 泛化能力强

#### 2.2.1 最大间隔原理

SVM算法的另一个优点是其泛化能力强。SVM通过最大化支持向量(与决策边界最近的数据点)之间的间隔来实现这一目标。通过最大化间隔,SVM能够找到一条决策边界,该边界对训练数据和未见数据都有良好的泛化能力。

#### 2.2.2 正则化项的作用

SVM算法还使用正则化项来控制模型的复杂性。正则化项惩罚模型中权重的过大值,从而防止过拟合。通过使用正则化项,SVM可以找到一个既能拟合训练数据又能泛化到新数据的模型。

### 2.3 鲁棒性好

#### 2.3.1 对噪声和异常值的处理

SVM算法对噪声和异常值具有鲁棒性。SVM通过使用软间隔来处理噪声和异常值。软间隔允许一些数据点违反决策边界,从而使模型能够容忍一定程度的噪声。

#### 2.3.2 稀疏数据的处理

SVM算法还能够有效地处理稀疏数据。稀疏数据是指大多数特征值为零的数据。SVM通过使用稀疏核函数来处理稀疏数据。稀疏核函数只计算非零特征之间的相似度,从而提高了计算效率。

# 3.1 训练时间长

SVM分类算法的

0

0