深入剖析SVM分类算法:揭秘其内部运作机制

发布时间: 2024-08-20 04:41:32 阅读量: 16 订阅数: 27

4.SVM分类算法_分类算法_SVM_

# 1. SVM分类算法概述

支持向量机(SVM)是一种监督式机器学习算法,用于解决分类问题。它通过在高维特征空间中寻找最大间隔超平面来将数据点分隔到不同的类别中。SVM算法具有以下优点:

- **良好的泛化能力:**SVM算法通过最大化超平面的间隔,提高了模型的泛化能力,可以有效避免过拟合。

- **非线性映射:**通过使用核函数,SVM算法可以将低维数据映射到高维特征空间,从而处理非线性可分的数据。

- **鲁棒性强:**SVM算法对异常值和噪声数据具有较强的鲁棒性,可以有效避免模型对异常数据的敏感性。

# 2. SVM分类算法理论基础

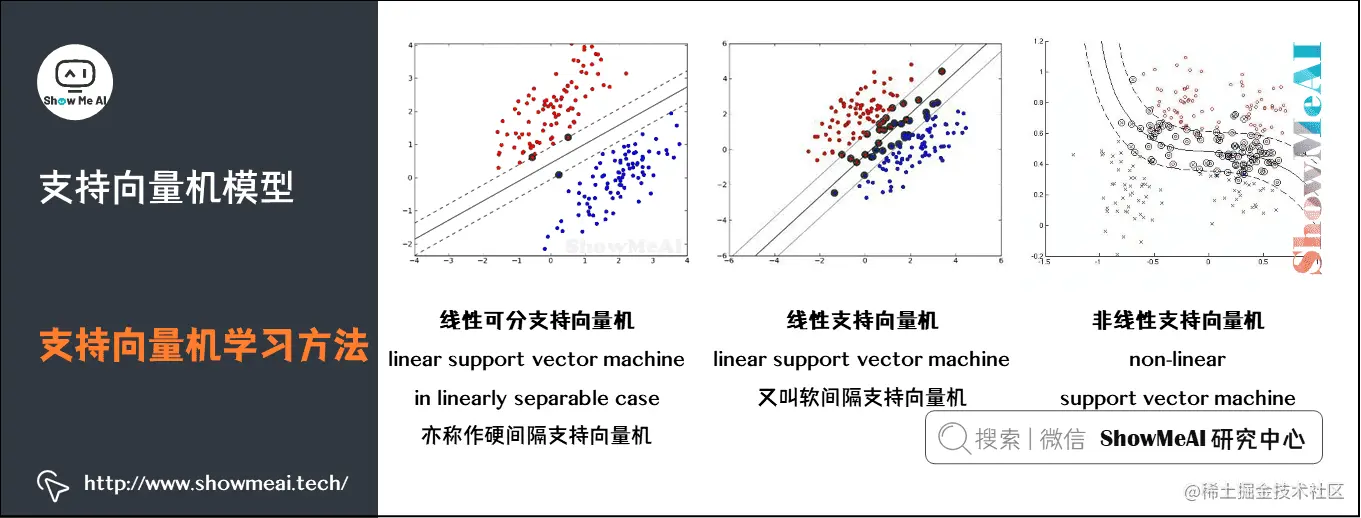

### 2.1 支持向量机模型

支持向量机(SVM)是一种监督学习算法,用于解决分类和回归问题。其核心思想是将输入数据映射到一个高维特征空间,在这个空间中,数据点可以被线性分离。

#### 2.1.1 线性可分支持向量机

对于线性可分的数据集,SVM的目标是找到一个超平面,将数据点正确分类到两侧。超平面由以下方程定义:

```

w^T x + b = 0

```

其中:

* w 是超平面的权重向量

* x 是输入数据点

* b 是超平面的偏置项

SVM通过最大化超平面和数据点的间隔来找到最佳超平面。间隔定义为超平面到最近数据点的距离。

#### 2.1.2 非线性可分支持向量机

对于非线性可分的数据集,SVM使用核函数将数据映射到一个高维特征空间,在这个空间中,数据点可以被线性分离。

### 2.2 核函数

核函数是一种数学函数,它将输入数据点映射到一个高维特征空间。SVM中常用的核函数有:

#### 2.2.1 核函数的类型

* **线性核函数:**将数据点直接映射到高维特征空间。

* **多项式核函数:**将数据点映射到多项式特征空间。

* **径向基函数(RBF)核函数:**将数据点映射到高斯分布特征空间。

#### 2.2.2 核函数的选择

核函数的选择取决于数据集的性质和分类任务的复杂性。一般来说,对于线性可分的数据集,线性核函数就足够了。对于非线性可分的数据集,需要使用多项式或RBF核函数。

核函数的参数也需要进行调参,以优化分类性能。

# 3. SVM分类算法实践应用

### 3.1 数据预处理

#### 3.1.1 数据标准化

数据标准化是将数据中的特征值缩放到一个特定的范围,以消除不同特征量纲的影响,提高模型的训练效率和泛化能力。常用的数据标准化方法有:

- **最大-最小标准化:**将数据中的每个特征值缩放到[0, 1]区间内。

```python

from sklearn.preprocessing import MinMaxScaler

scaler = MinMaxScaler()

X_scaled = scaler.fit_transform(X)

```

- **均值-标准差标准化:**将数据中的每个特征值减去其均值,再除以其标准差。

```python

from sklearn.preprocessing import StandardScaler

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

```

#### 3.1.2 特征选择

特征选择是选择对分类任务最有影响力的特征,以减少模型的复杂度和提高其性能。常用的特征选择方法有:

- **过滤式特征选择:**根据特征的统计信息(如方差、互信息)来选择特征。

```python

from sklearn.feature_selection import VarianceThreshold

selector = VarianceThreshold(threshold=0.01

```

0

0