结构化数据处理中BP神经网络的性能分析

发布时间: 2024-04-14 18:55:30 阅读量: 81 订阅数: 50

BP神经网络的数据分析

# 1. 引言

现代社会大数据量的快速增长使得数据处理变得尤为重要,而神经网络作为一种强大的机器学习模型,在各个领域展现出了巨大的应用潜力。BP神经网络作为最经典、应用最广泛的神经网络之一,其在分类、回归、聚类等领域都有着广泛的应用。本文旨在探讨BP神经网络在结构化数据处理中的应用,着重分析如何通过数据预处理和模型优化提升BP神经网络的性能,为相关领域的研究者和从业者提供实用指导。研究的目标是通过实验验证,在结构化数据预处理和神经网络参数调优方面找到最佳实践方案,以提高BP神经网络的性能和应用效果。

# 2. BP神经网络基础

#### 2.1 神经网络简介

神经网络是一种模仿人脑神经元网络结构和功能的数学模型。在神经网络中,神经元通过连接进行信息传递,每个连接都有一个权重,神经元会对输入信号施加权重并经过激活函数输出结果。其中,激活函数决定神经元是否激活并传递信息,常见的激活函数有 Sigmoid、ReLU 等。反向传播算法通过计算损失函数梯度来更新网络参数,使得网络输出结果与真实值更接近。

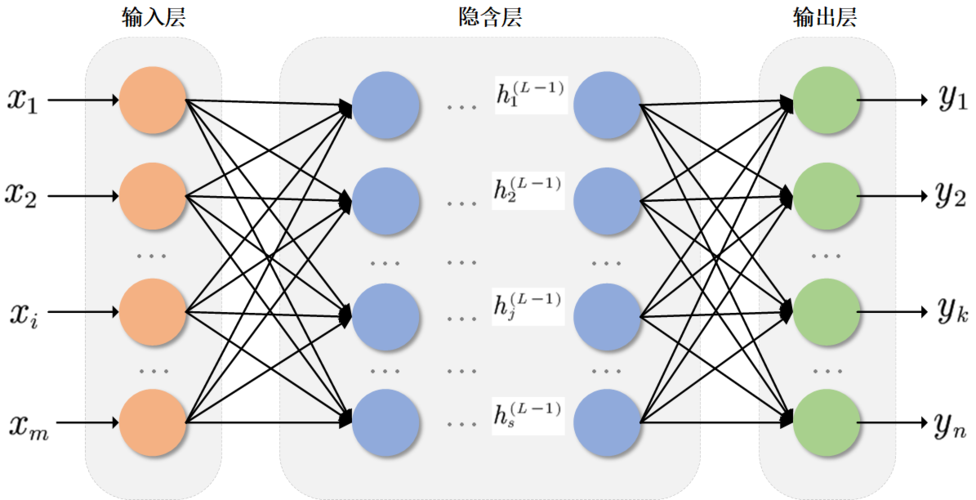

#### 2.2 BP神经网络结构

BP神经网络通常由输入层、隐藏层和输出层构成。输入层接收数据特征作为输入信号,隐藏层通过一系列加权和激活函数计算得到输出,最终由输出层给出网络的预测结果。网络训练过程中,通过反向传播算法不断更新权重参数,降低损失函数的值。常见的损失函数是均方误差损失函数,优化方法包括随机梯度下降和Adam等。

```python

# 实现神经网络的反向传播算法示例

class NeuralNetwork:

def __init__(self, input_dim, hidden_dim, output_dim):

self.input_dim = input_dim

self.hidden_dim = hidden_dim

self.output_dim = output_dim

self.weights_input_hidden = np.random.randn(input_dim, hidden_dim)

self.weights_hidden_output = np.random.randn(hidden_dim, output_dim)

def forward(self, input_data):

hidden_state = np.dot(input_data, self.weights_input_hidden)

output = np.dot(hidden_state, self.weights_hidden_output)

return output

def backward(self, input_data, target, learning_rate):

# 反向传播更新权重参数

pass

```

#### 2.3 BP神经网络训练

BP神经网络的训练过程包括前向传播和反向传播两个阶段。在前向传播中,输入信号通过多层神经元计算得到预测值,再通过计算损失函数评估网络输出与真实值的差距。在反向传播阶段,利用损失函数的梯度信息更新网络参数,使得预测值逼近真实值。这一过程不断迭代直到损失函数收敛,网络训练完成。

```mermaid

gr

```

0

0