BP神经网络的训练过程解析

发布时间: 2024-04-14 18:40:52 阅读量: 135 订阅数: 51

# 1. 神经网络基础知识

神经网络是模仿人脑神经元之间的连接方式和工作原理而设计的一种计算模型。在神经网络中,感知机是最基础的模型,由输入层、输出层和激活函数组成。然而,单层感知机存在线性不可分的限制,导致其应用受到限制。此后,多层神经网络被提出,通过引入隐藏层解决了单层感知机的局限性,进而催生了深度学习的兴起。深度学习通过多层次的特征提取和抽象,使神经网络能够处理更加复杂的任务,如图像识别、语音处理等。神经网络的发展历程充分展现了其强大的学习能力和广泛的应用前景。

# 2. 反向传播算法

#### 2.1 反向传播算法原理

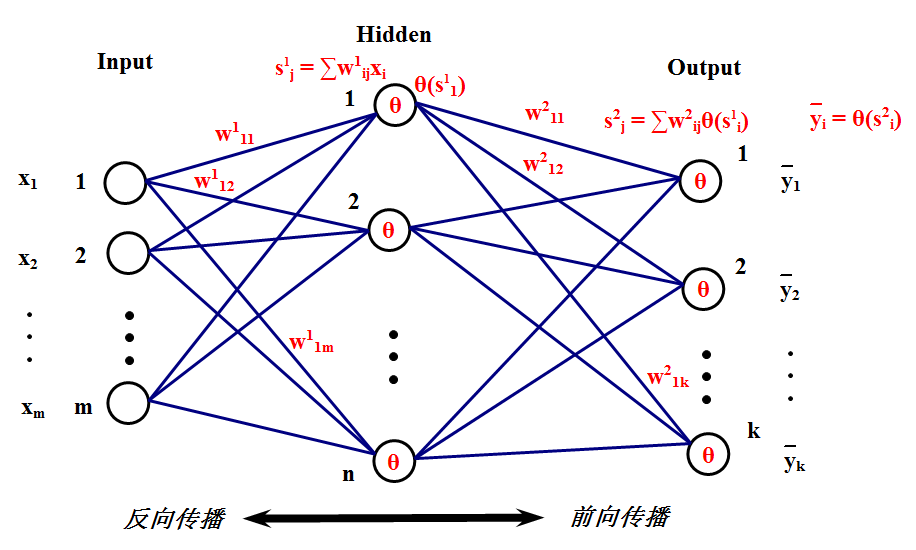

反向传播算法是神经网络中应用广泛的优化算法,通过计算输出与期望输出之间的误差,并通过梯度下降来更新神经网络的权重,以减小误差。它主要包含前向传播和反向传播两个过程。

##### 2.1.1 前向传播和反向传播的过程

前向传播是指输入数据从输入层经过隐藏层传递到输出层的过程,在每一层中,通过激活函数计算输出。反向传播则是根据前向传播得到的输出与真实标签之间的误差,从输出层向输入层逐层反向更新权重,以减小误差,优化神经网络模型。

##### 2.1.2 反向传播算法的求导和更新

在反向传播算法中,通过链式法则计算每层的梯度,然后根据梯度下降算法更新权重,使得损失函数最小化。这一过程是通过计算梯度来调整网络参数,以使得神经网络的输出更接近实际标签。

##### 2.1.3 正向传播与误差反向传播的关系

正向传播和误差反向传播是神经网络训练过程中密切相关的两个步骤。正向传播是将输入数据沿着神经网络的连接传递,得到模型的输出;而误差反向传播则是根据输出误差,反向计算梯度并更新各层的参数,以不断优化模型。

#### 2.2 反向传播算法的改进

反向传播算法虽然在优化神经网络方面取得了显著成就,但在一些方面仍存在局限性,因此出现了一些改进的算法,以提高收敛速度和精度。

##### 2.2.1 随机梯度下降法

随机梯度下降是一种优化梯度下降算法,它不是在每一轮训练中计算所有样本的梯度,而是随机选取部分样本来计算梯度更新参数,从而加快训练速度。

##### 2.2.2 动量法

动量法是一种在梯度下降中用于加速收敛的方法。它引入了动量项,使得参数更新时不仅考虑当前的梯度,还考虑历史梯度的加权和,可以减少更新方向的波动,加速优化过程。

##### 2.2.3 Adam算法

Adam算法结合了动量法和RMSProp算法的优点,在计算梯度的一阶矩估计和二阶矩估计的基础上,综合考虑动量修正和自适应学习率,能够更有效地优化神经网络参数。

##### 2.2.4 批量标准化技术

批量标准化技术通过在网络的中间层对输出值进行标准化处理,有助于加速收敛,提高模型的稳定性和泛化能力,对于训练深层神经网络具有重要意义。

# 3. 神经网络训练的优化技巧

在神经网络训练过程中,优化技巧起着至关重要的作用。通过合理的数据预处理、网络结构设计以及正则化方法,可以有效提高神经网络的性能和泛化能力。

#### 3.1 数据预处理

数据预处理是神经网络训练的第一步,旨在为模型提供干净、可靠的输入数据。常见的数据预处理技巧包括数据归一化、数据标准化和数据增强技术。

1. 数据归一化

数据归一化是将数据缩放到特定的范围,通常是[0, 1]或者[-1, 1]。这个操作有助于加速模型收敛,避免某些特征值对模型训练产生过大影响。

2. 数据标准化

数据标准化是指将数据转换成均值为0,方差为1的分布。标准化可以使不同特征之间具有可比性,有助于提高模型的稳定性和收敛速度。

3. 数据增强技术

数据增强技术通过对原始数据进行旋转、平移、缩放等操作

0

0