【云服务中的HAR文件应用】:提升云端应用性能的策略

发布时间: 2024-10-27 20:48:23 订阅数: 7

# 1. HAR文件基础及其在云服务中的作用

HAR(HTTP Archive)文件作为一种记录Web浏览器会话的档案格式,它在云服务的性能监控中扮演了至关重要的角色。通过详细记录每个HTTP事务,HAR文件帮助开发者和运维人员追踪应用程序的性能问题,优化用户体验,并实现自动化监控策略。

## 1.1 HAR文件的核心功能

在云服务领域,HAR文件的使用不仅限于简单的网络请求记录。它可用于:

- 性能数据的收集,以识别和诊断应用性能瓶颈。

- 自动化监控工具的输入,提供实时分析和警报。

- 测试和优化流程中,复现用户会话和测试网络性能。

## 1.2 使用HAR文件的优势

相比其他网络跟踪方法,HAR文件具有以下优势:

- 提供了一个标准化的数据格式,便于工具和平台之间的数据交换。

- 允许跨平台使用,且可在多种浏览器和工具中生成和解析。

- 支持复杂的网络交互的详细记录,包括重定向、缓存等信息。

通过这些基础性的了解,我们将深入探讨HAR文件的技术细节以及如何将其应用于云服务的各个层面。在接下来的章节中,我们会详细了解HAR文件的结构、性能监控应用,以及如何优化和管理这些文件以提升云端应用性能。

# 2. HAR文件技术剖析

## 2.1 HAR文件的结构和组成

### 2.1.1 HAR文件头信息解析

HAR(HTTP Archive)文件是一种记录网络浏览器会话的标准格式,它允许开发者以JSON格式保存与网站交互的详细信息。了解HAR文件的结构是利用其进行性能分析和优化的第一步。

HAR文件的头部信息(`log`对象中的`version`和`creator`属性)是解析的第一站。它包含了HAR文件的版本号和创建该HAR文件的软件信息。例如:

```json

{

"log": {

"version": "1.2",

"creator": {

"name": "Chrome",

"version": "74.0.3729.169"

},

...

}

}

```

这些头部信息对于理解如何解读HAR文件至关重要,因为不同的HAR版本可能遵循不同的结构标准。此处的`version`表明HAR文件遵循的格式版本,而`creator`提供了生成HAR文件的软件信息。例如,如果`creator`是"Chrome",则表示这是Chrome浏览器产生的HAR文件。

### 2.1.2 HAR文件主体部分详解

HAR文件的主体部分通常是最关键的部分,因为它包含了网络请求和响应的详细记录。主体由`pages`和`entries`两部分组成,每个`page`代表一个页面的加载,`entries`则是页面加载过程中发生的所有网络交互记录。

```json

{

"log": {

...

"pages": [

{

"startedDateTime": "2023-03-09T08:48:25.553Z",

"id": "page_1",

"title": "Home Page",

"pageTimings": {

"onContentLoad": 2345,

"onLoad": 3456

}

}

],

"entries": [

{

"pageref": "page_1",

"startedDateTime": "2023-03-09T08:48:25.553Z",

"time": 1234,

"request": {

"method": "GET",

"url": "***",

"httpVersion": "HTTP/1.1",

...

},

"response": {

"status": 200,

"statusText": "OK",

...

},

"cache": {},

"timings": {

"blocked": 0,

"dns": 0,

"connect": 20,

"send": 10,

"wait": 120,

"receive": 30,

...

},

"serverIPAddress": "***.*.*.*",

"connection": "keep-alive",

"timing": {}

},

...

]

}

}

```

每个`entry`代表一个网络请求,其中`request`对象包含了请求方法、URL和HTTP版本等信息。而`response`对象则提供了响应状态码、响应文本等数据。`timings`对象描述了请求的各个阶段所消耗的时间,这对于我们理解性能瓶颈至关重要。

## 2.2 HAR文件在性能监控中的应用

### 2.2.1 网络请求的记录和分析

网络请求的记录是性能分析的基础。HAR文件提供了一个详细的时间线,从发出请求开始,到最终获取到响应结束。这其中包括了DNS解析时间、建立连接的时间、等待服务器响应的时间以及数据传输时间等。

例如,通过分析`entries`中的`timings`对象,我们可以清楚地看到服务器处理请求的各个阶段。每个时间值对应一个时间区间,它们的和即为总时间:

```json

"timings": {

"blocked": 0,

"dns": 0,

"connect": 20,

"send": 10,

"wait": 120,

"receive": 30,

...

}

```

这些详细的时间记录对于开发者和运维人员来说,能够帮助识别出响应时间长的环节,从而进行针对性的优化。

### 2.2.2 性能瓶颈的识别和诊断

性能瓶颈的识别和诊断是通过分析多个请求的HAR文件完成的。在这个过程中,比较不同请求的相似性和差异性是关键。比如,为什么某些请求比其他请求慢?这可能是由服务器处理能力、网络带宽、资源大小或浏览器缓存等问题造成的。

通过使用HAR分析工具,比如`HAR Analyzer`或者浏览器的开发者工具,可以可视化地展示出请求瀑布图。瀑布图中的每一个条形图代表一个请求,其长度表示响应时间。通过观察哪些条形图异常长,可以快速识别出潜在的性能问题。

### 2.2.3 与云服务监控工具的整合

云服务监控工具能够帮助我们对应用的性能进行实时监控和预警。整合HAR文件到云监控工具中,可以利用HAR文件提供的时间戳和性能数据,对应用进行更详尽的性能评估。

例如,可以编写一个脚本来自动化收集HAR文件,并将其发送到云监控平台上。云监控平台可以利用这些数据进行深入分析,比如通过机器学习模型来预测未来的性能问题,或者在检测到性能下降时自动进行调整。

## 2.3 HAR文件的生成和管理

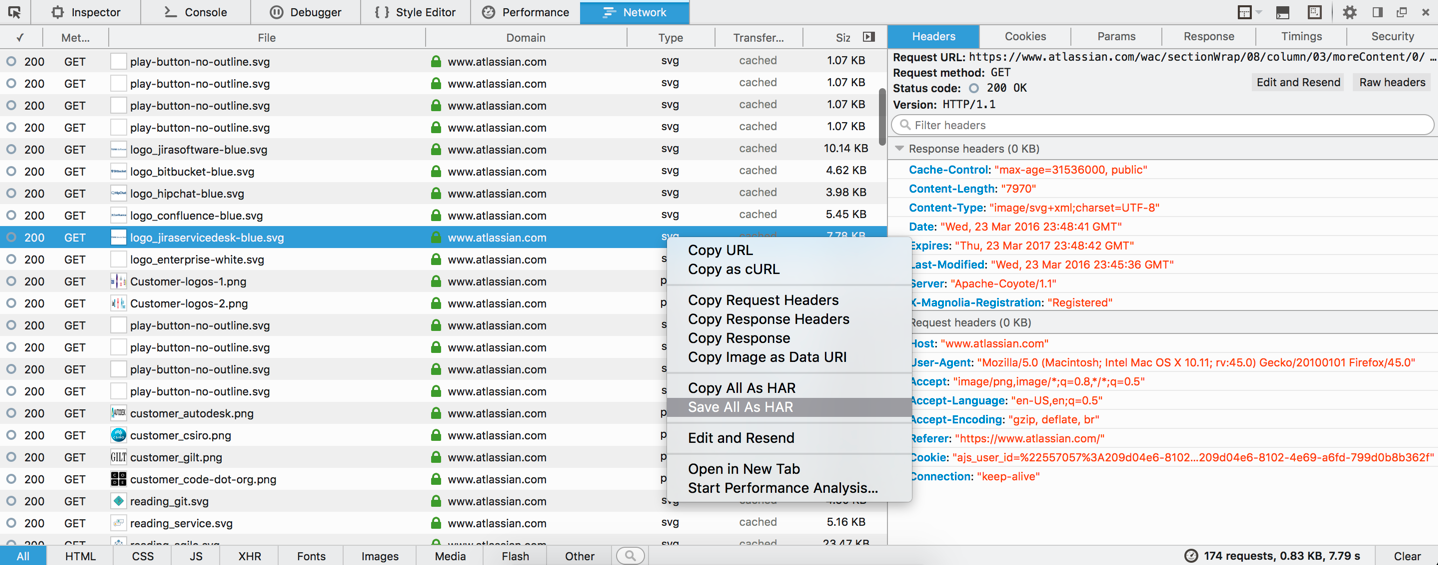

### 2.3.1 使用浏览器开发者工具导出HAR

几乎所有的现代浏览器都配备了内置的开发者工具,这些工具可以帮助开发者捕获和导出HAR文件。以Chrome浏览器为例,可以按照以下步骤导出HAR文件:

1. 打开开发者工具(通常通过按F12或右键点击页面选择“检查”)。

2. 点击“Network”标签页,开始录制网络请求。

3. 在录制过程中,执行所需的操作(如刷新页面、点击链接等)。

4. 完成操作后,在“Network”标签页中右键点击空白处,选择“Save as HAR with content”保存请求记录。

```javascript

// 示例代码:使用Chrome开发者工具的控制台命令导出HAR文件

copy network.requestWillBeSent((e)

```

0

0