atan函数在虚拟现实中的作用:头部跟踪与空间定位,让你的虚拟现实体验更加真实

发布时间: 2024-07-09 02:29:24 阅读量: 30 订阅数: 50

# 1. 虚拟现实技术概述

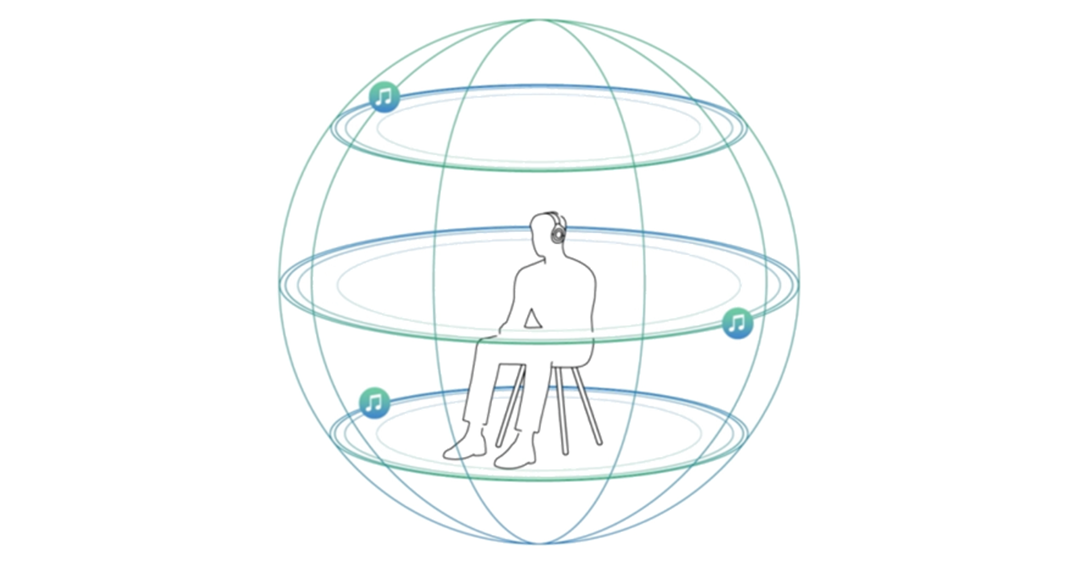

虚拟现实(VR)是一种沉浸式技术,它创造了一个虚拟环境,用户可以在其中与计算机生成的场景互动。VR 技术广泛应用于游戏、教育、培训和医疗保健等领域。

VR 系统通常包括以下主要组件:

- **头戴式显示器(HMD):**HMD 覆盖用户的眼睛,提供虚拟环境的视觉效果。

- **头部跟踪系统:**头部跟踪系统检测用户的头部运动,并相应地调整虚拟环境。

- **空间定位系统:**空间定位系统确定用户的物理位置和方向,使虚拟环境与用户的真实动作相匹配。

# 2. 头部跟踪与空间定位

头部跟踪和空间定位是虚拟现实体验的关键技术,它们使用户能够在虚拟环境中自然地移动和互动。本章节将深入探讨头部跟踪和空间定位的技术原理,以及它们在虚拟现实中的应用。

### 2.1 头部跟踪技术原理

头部跟踪技术用于确定用户头部的位置和方向。有两种主要类型的头部跟踪技术:惯性测量单元(IMU)和光学跟踪系统。

#### 2.1.1 惯性测量单元(IMU)

IMU是一个小型电子设备,它包含加速计和陀螺仪。加速计测量线性加速度,而陀螺仪测量角速度。通过结合这些测量,IMU可以估计头部的位置和方向。

```python

import numpy as np

import math

class IMU:

def __init__(self, acc_x, acc_y, acc_z, gyro_x, gyro_y, gyro_z):

self.acc_x = acc_x

self.acc_y = acc_y

self.acc_z = acc_z

self.gyro_x = gyro_x

self.gyro_y = gyro_y

self.gyro_z = gyro_z

def update(self, dt):

# 更新位置

self.pos_x += self.acc_x * dt

self.pos_y += self.acc_y * dt

self.pos_z += self.acc_z * dt

# 更新方向

self.yaw += self.gyro_z * dt

self.pitch += self.gyro_y * dt

self.roll += self.gyro_x * dt

# 参数说明:

# acc_x, acc_y, acc_z: 加速度计测量值

# gyro_x, gyro_y, gyro_z: 陀螺仪测量值

# dt: 时间间隔

# 逻辑分析:

# 该代码使用IMU数据更新头部的位置和方向。它首先更新位置,然后更新方向。更新方向时,它使用陀螺仪数据来更新偏航角、俯仰角和滚转角。

```

#### 2.1.2 光学跟踪系统

光学跟踪系统使用摄像头来跟踪头部上的标记。这些标记通常是贴在头部上的红外线反射器。摄像头会检测这些反射器的位置,并使用三角测量法计算头部的位置和方向。

```python

import cv2

class OpticalTrackingSystem:

def __init__(self, camera_matrix, distortion_coefficients):

self.camera_matrix = camera_matrix

self.distortion_coefficients = distortion_coefficients

def track(self, image):

# 检测标记

markers = cv2.findCirclesGrid(image, cv2.CALIB_CB_ASYMMETRIC_GRID, (4, 3))

# 计算头部位置和方向

if markers[0]:

ret, rvec, tvec = cv2.solvePnP(markers[1], markers[2], self.camera_matrix, self.distortion_coefficients)

return ret, rvec, tvec

# 参数说明:

# camera_matrix: 相机矩阵

# distortion_coefficients: 失真系数

# image: 输入图像

# 逻辑分析:

# 该代码使用光学跟踪系统来跟踪头部的位置和方向。它首先检测图像中的标记,然后使用solvePnP函数计算头部的位置和方向。

```

### 2.2 空间定位技术原理

空间定位技术用于确定用户在虚拟环境中的位置。有两种主要类型的空间定位技术:外部定位系统和内部定位系统。

#### 2.2.1 外部定位系统

外部定位系统使用外部传感器来跟踪用户的位置。这些传感器可以是红外线摄像头、超声波传感器或激光雷达。传感器会检测用户身上的标记或设备,并使用三角测量法计算用户的位置。

```python

import numpy as np

class ExternalPositioningSystem:

def __init__(self, sensors):

self.sensors = sensors

def locate(self):

# 接收传感器数据

data = [sensor.get_data() for sensor in self.sensors]

# 计算用户位置

pos_x = np.mean([data[i][0] for i in range(len(data))])

pos_y = np.mean([data[i][1] for i in range(len(data))])

pos_z = np.mean([data[i][2] for i in range(len(data))])

return pos_x, pos_y, pos_z

# 参数说明:

# sensors: 传感器列表

# 逻辑分析:

# 该代码使用外部定位系统来计算用户的位置。它首先接收传感器数据,然后计算用户位置。用户位置是传感器数据中位置值的平均值。

```

#### 2.2.2 内部定位系统

内部定位系统使用用户设备上的传感器来跟踪用户的位置。这些传感器可以是加速度计、陀螺仪或磁力计。通过结合这些测量,内部定位系统可以估计用户的位置。

```python

import numpy as np

class InternalPositioningSystem:

def __init__(self, acc, gyro, mag):

self.acc = acc

self.gyro = gyro

self.mag = mag

def locate(self, dt):

# 更新位置

self.pos_x += self.acc_x * dt

self.pos_y += self.acc_y * dt

self.pos_z += self.acc_z * dt

# 更新方向

self.yaw +=

```

0

0