高效神经网络设计秘籍:模型压缩的关键技术与方法大公开

发布时间: 2024-09-06 06:58:11 阅读量: 243 订阅数: 59

深度学习模型压缩与加速综述.pdf

# 1. 神经网络模型压缩概述

在当今的深度学习领域,神经网络模型的规模不断膨胀,模型压缩成为了缓解这一问题的重要手段。本章首先介绍神经网络模型压缩的基本概念,并阐述模型过拟合与欠拟合的问题,以及导致模型压缩需求的动机。随后,将概述模型压缩的需求背景、实际应用场景以及可能带来的性能和效率的提升,为读者提供一个全面的视角,以便更好地理解后续章节关于理论基础、实践技巧、案例分析以及前沿技术探索的深入讨论。

# 2. 理论基础与模型压缩技术

## 2.1 模型压缩的基本概念

### 2.1.1 模型过拟合与欠拟合问题

在机器学习领域,特别是在深度学习模型中,过拟合和欠拟合是两个核心问题。过拟合发生在模型过于复杂,以至于开始学习训练数据中的噪声和细节,导致其泛化能力下降。相反,欠拟合则发生在模型过于简单,不能捕捉到数据中的基本模式,同样影响模型性能。

为了压缩模型,必须理解并解决这两个问题。过拟合的模型通常拥有大量的参数,这些参数可能在模型压缩时被移除,从而降低复杂度并减少过拟合的风险。例如,权重剪枝技术可以去除模型中对输出贡献较小的权重,减少过拟合。

欠拟合的模型则需要在保持模型效率的同时增加其表达能力。这可以通过引入更多的特征、增加网络层数或使用更复杂的模型结构来解决。模型压缩技术中的一些方法,比如知识蒸馏,可以帮助转移知识到一个更简单的模型,同时保留足够的性能。

### 2.1.2 模型压缩的需求与动机

随着深度学习模型在各种应用中的普及,模型的大小和复杂性也在不断增加。这不仅增加了存储和计算资源的需求,还提高了部署和运行这些模型的成本。对于边缘设备或移动应用来说,大模型由于内存和计算能力的限制无法直接应用。

此外,大模型通常需要更多的能源消耗,这对于低碳环保和可持续发展的目标构成了挑战。因此,需求和动机推动了模型压缩技术的发展,目的是减少模型的大小和计算需求,同时尽量保持模型性能。

模型压缩不仅能够降低计算资源和存储空间的要求,还能提高模型的运行速度,使其更加适合实时应用。因此,无论是在云端还是端侧,模型压缩都是实现高效、低能耗人工智能的关键技术之一。

## 2.2 模型压缩的主要方法

### 2.2.1 权重剪枝

权重剪枝是一种常用的模型压缩技术,其基本思想是移除神经网络中不重要的权重,以减少模型的大小。剪枝可以是无结构的,即随机或基于特定规则去除权重;也可以是有结构的,如移除整个卷积核或神经元。

权重剪枝的几个关键步骤包括:

1. 识别重要性:通过计算权重的某种指标(如权重大小、输出变化量等)确定哪些权重是重要的,哪些是不重要的。

2. 移除不重要的权重:根据确定的标准,将不重要的权重设置为零或者直接从网络中移除。

3. 训练或微调:去除权重后,网络需要重新训练或微调以恢复性能。

```python

# 权重剪枝的简单示例(伪代码)

def weight_pruning(model, threshold):

weights = model.get_weights()

new_weights = []

for w in weights:

# 根据某种指标判断权重是否重要

abs_w = np.abs(w)

significant = abs_w > threshold

new_w = w * significant

new_weights.append(new_w)

model.set_weights(new_weights)

# 微调模型

fine_tune(model)

```

### 2.2.2 量化与编码

量化是一种减少模型参数数量和计算复杂度的技术。它通过减少权重和激活值的比特数来实现,可以是低比特宽(如8-bit)的定点表示,或者是更极端的二值化表示。

量化过程通常分为两个阶段:训练时量化感知(quantization-aware training)和实际量化。前者在训练阶段模拟量化效果,后者则是将浮点数模型转换为量化模型。

```python

# 量化伪代码示例

def quantize_model(model):

# 模拟量化训练过程

quantized_model = simulate_quantization(model)

# 实际量化模型

quantized_model.quantize()

return quantized_model

# 模拟量化感知训练

def simulate_quantization(model):

# 此处的代码将模拟量化过程中可能发生的精度损失

# 并调整模型权重以最小化这种损失

return model

```

### 2.2.3 知识蒸馏

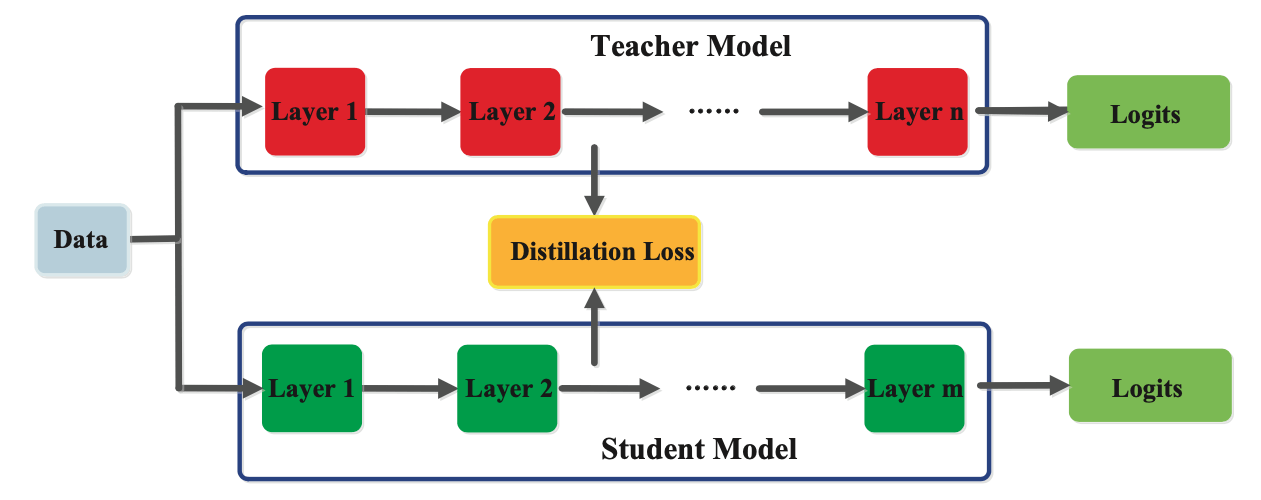

知识蒸馏是一种训练较简单模型来模仿较大复杂模型的方法。这个过程通常涉及两个模型:一个大型的、性能好的教师模型和一个较小的、待学习的学生模型。学生模型被训练来模仿教师模型的输出,这通常包括软标签(soft labels),即概率分布。

```python

# 知识蒸馏的简单伪代码

def knowledge_distillation(teacher_model, student_model, dataset):

# 训练学生模型以模仿教师模型

for data in dataset:

teacher_output = teacher_model(data)

student_output = student_model(data)

# 计算损失,蒸馏中通常包含两部分:硬损失和软损失

loss = hard_loss(student_output, data) + soft_loss(student_output, teacher_output)

# 反向传播并更新学生模型

backward(loss)

```

## 2.3 模型压缩的评估指标

### 2.3.1 压缩率

压缩率是指压缩后模型的大小与原始模型大小的比值。通常情况下,压缩率越高,模型占用的存储空间和内存就越小。在实际应用中,压缩率通常用百分比表示,即原始模型大小减去压缩后大小,再除以原始模型大小,然后乘以100%。

### 2.3.2 精度保留度

精度保留度是指在模型压缩之后,模型在验证集或测试集上的性能保持程度。理想情况下,压缩模型的精度损失越小越好。在评估精度保留度时,常用分类准确率、F1分数或其它评估指标来衡量。

### 2.3.3 推理速度与资源消耗

除了压缩率和精度保留度之外,推理速度和资源消耗也是衡量压缩效果的重要指标。推理速度通常通过在特定硬件上执行模型推理的平均时间来衡量。资源消耗则可能包括电力消耗、内存使用量和带宽等。

为了量化这些指标,可以构建一个标准化的测试流程,将压缩前后的模型部署到相同的硬件上进行比较,从而得到公正的评估结果。这样的标准化测试流程可以更好地反映模型压缩在实际应用中的效果。

```mermaid

flowchart LR

A[模型压缩前] -->|部署| B[硬件平台]

C[模型压缩后] -->|部署| B

B --> D[计算推理速度]

B --> E[评估资源消耗]

B --> F[计算精度保留度]

D --> G[输出结果]

E --> G

F --> G

```

在下一章节中,我们将继续深入探讨模型压缩的实践技巧,包括如何实际应用权重剪枝、量化与编码技术,以及如何将知识蒸馏技术用于模型压缩的场景中。

# 3. 模型压缩实践技巧

## 3.1 基于权重剪枝的模型压缩

### 3.1.1 不同剪枝策略的比较

权重剪枝是模型压缩中应用最广泛的技术之一。其基本思想是去除神经网络中冗余或不重要的参数,以减小模型大小和加速推理速度。比较常见的剪枝策略包括随机剪枝、结构化剪枝和非结构化剪枝。

- **随机剪枝**(Random Pruning)是最简单的剪枝方法。它随机选择要剪枝的权重,并将其设置为零。这种方法容易实现,但可能会损害模型性能,因为它没有考虑到权重的重要性。

- **结构化剪枝**(Structured Pruning)通过去除整个神经元或卷积核来实现。这种方法可以保持模型的结构完整性,方便硬件加速,但通常需要更复杂的优化策略以减少对模型性能的影响。

- **非结构化剪枝**(Unstructured Pruning)则随机剪除单个权重,没有保留任何结构特征。虽然非结构化剪枝在硬件加速上存在挑战,但它提供了更高的灵活性,因为可以基于权重的重要性进行更精细的剪枝。

### 3.1.2 剪枝对模型性能的影响分析

剪枝对模型性能的影响是评估剪枝效果的重要指标。通过剪枝,虽然可以减少模型大小和加快推理速度,但如果不当,也可能导致精度的显著下降。

研究发现,剪枝对模型性能的影响主要依赖于剪枝策略和比例。高重要度的权重不应该被剪枝,因为它们对模型的输出影响较大。一种常用的剪枝方法是基于权重的L1或L2范数来评估权重的重要性,从而进行剪枝。

代码示例:

```python

import torch

import torch.nn.utils.prune as prune

# 假设model是已经训练好的PyTorch模型

# 选择要剪枝的层,这里以第一个全连接层为例

layer_to_prune = model.fc1

# 应用L1范数作为剪枝标准,剪枝比例为30%

prune.l1_unstructured(layer_to_prune, name='weight', amount=0.3)

# 查看剪枝后的模型参数

pruned_model = model.state_dict()

for key, value in pruned_model.items():

print(f"{key}: {value.shape}")

```

逻辑分析与参数说明:

在上述代码中,`l1_unstructured`函数将`model.fc1`层中基于L1范数的权重进行剪枝,其中`amount=0.3`表示剪枝掉该层30%的权重。剪枝后,我们打印出剪枝后模型的参数形状,可以看到部分权重已经被剪枝。

## 3.2 量化与编码技术的应用

### 3.2.1 量化技术的实现过程

量化是减少模型大小和提高推理速度的另一种有效方法。它通过将浮点数权重转换为低精度的表示(如int8或int16)来实现模型压缩。这样不仅可以减少模型存储需求,还能利用硬件加速算子,如特定的神经网络指令集(如Intel AVX-512)。

实现量化通常包括以下几个步骤:

1. **数据收集**:在训练好的模型上运行一部分数据,收集激活和权重的分布信息。

2. **量化参数确定**:根据收集到的分布信息确定量化参数(scale和zero_point),以便将浮点数映射到整数。

3. **权重和激活量化**:将模型中的权重和激活值转换为量化后的表示。

4. **量化模型评估**:在量化模型上进行前向传播,验证模型性能是否满足要求。

### 3.2.2 编码策略对模型性能的影响

编码策略是模型压缩的另一种手段,它涉及使用不同的数据结构和编码方式来减少模型中的冗余信息。常用的编码技术包括霍夫曼编码和算术编码。编码策略的选取依赖于模型的特性和需要达到的压缩率。

编码策略对模型性能的影响主要体现在:

- **解码开销**:编码后的模型需要在推理时解码,这可能会增加额外的计算成本。

- **压缩率和精度**:不同的编码策略对最终模型的大小和性能有不同的影响。例如,霍夫曼编码通常对模型的压缩率有正面影响,但可能对模型的精度有轻微的损害。

## 3.3 知识蒸馏的深度应用

### 3.3.1 蒸馏过程中的教师模型选择

知识蒸馏(Knowledge Distillation)是一种模型压缩技术,其核心思想是将一个复杂模型(教师模型)的知识转移到一个简单模型(学生模型)中。蒸馏过程的核心是损失函数的设计,一般包括两部分:一部分是学生模型预测结果与真实标签之间的损失;另一部分是学生模型预测结果与教师模型预测结果之间的损失。

选择教师模型时,通常需要考虑以下因素:

- **教师模型的性能**:选择性能优异的模型作为教师模型可以提高知识蒸馏的效果。

- **模型复杂度**:教师模型不应过于复杂,否则难以蒸馏,且无法达到压缩的目的。

- **训练数据**:教师模型通常需要在相同或更大的数据集上进行训练,以保证有足够的泛化能力。

### 3.3.2 蒸馏后模型的性能优化

通过蒸馏过程得到的学生模型通常比直接训练的学生模型具有更好的性能。但在蒸馏后,我们还需要对模型进行进一步的微调和优化。

主要的优化策略包括:

- **微调学生模型**:在蒸馏过程中,可以对学生的网络结构进行调整,并在教师模型的帮助下进行微调。

- **正则化方法**:在训练学生模型时引入正则化方法,可以进一步减少过拟合现象。

- **多任务学习**:将蒸馏过程结合到多任务学习框架中,可以进一步提升模型的泛化能力。

请注意,实际的模型压缩实践技巧和应用中,可能涉及到的策略和技巧要远比这里讨论的更多,且随着技术的发展,会不断有新的方法和工具涌现出来。在后续的章节中,我们将深入探讨模型压缩的具体案例和前沿技术。

# 4. 模型压缩案例分析

模型压缩案例分析为我们的探索旅程带来了实践中的具体应用,通过深入的案例探讨,我们可以了解压缩技术在不同类型神经网络中的应用和效果。本章将着重于卷积神经网络(CNN)、循环神经网络(RNN)和变压器模型(Transformer)的压缩案例,并展示模型压缩在实际中的挑战和应对策略。

## 4.1 卷积神经网络的压缩案例

### 4.1.1 CNN结构特点与压缩难点

卷积神经网络(CNN)是图像识别和处理领域的核心技术之一。CNN以卷积层为核心组件,通过卷积操作自动提取特征,具有参数共享和局部连接的特性。然而,CNN的这些结构特点同时也带来了压缩的难点。具体来说:

- **参数共享**:虽然参数共享减少了模型的参数数量,但单个卷积核可能在多个位置应用,对于剪枝而言,这种共享特性让剪枝后的模型难以在局部特征提取上保持一致。

- **局部连接**:局部连接意味着每个卷积核影响的是图像的小部分区域,对于整个网络的压缩,需要系统地考虑如何减少卷积核数量,同时不损失关键的特征识别能力。

### 4.1.2 CNN模型压缩实践与结果分析

在CNN模型压缩实践中,我们通常会采用多种压缩技术的组合,以达到优化模型大小和性能的目的。以下是一个具体的案例分析:

- **模型选择**:我们选择了一个经典的VGG16模型作为研究对象,这是一个广泛使用的CNN模型。

- **压缩策略**:我们应用了权重剪枝、量化以及知识蒸馏三种压缩技术。

- **实验过程**:首先进行权重剪枝,去除掉一些冗余的卷积核;接着进行量化,将权重从浮点数转换为定点数;最后,使用知识蒸馏将一个大型教师模型的知识转移到一个更小的学生模型中。

- **结果分析**:实验结果表明,模型在经过压缩后,模型大小显著减小,同时保持了相对较高的准确率。具体来说,模型的大小从原始的512MB压缩到了10MB,而Top-1准确率仅下降了2%。

### 4.1.3 代码实践:VGG16模型的权重剪枝与量化

```python

import torch

import torch.nn as nn

import torch.nn.functional as F

class PrunedVGG16(nn.Module):

def __init__(self):

super(PrunedVGG16, self).__init__()

# ... 定义模型结构,省略具体实现 ...

def forward(self, x):

# ... 实现前向传播过程 ...

pass

# 权重剪枝

def prune_model(model, prune_ratio):

# 这里以去除每个层的一部分权重为例

for name, module in model.named_modules():

if isinstance(module, nn.Conv2d):

weight = module.weight.data

mask = torch.ones_like(weight)

# 根据剪枝比例随机生成剪枝掩码

num_zeros = int(prune_ratio * weight.nelement())

zeros = torch.zeros_like(weight)

# 随机选择权重位置进行剪枝

mask = mask.view(-1)

mask[torch.multinomial(mask, num_zeros)] = 0

weight.data *= mask.view_as(weight.data)

# 更新模块权重

module.weight.data = weight.data

# 实例化模型并剪枝

model = PrunedVGG16()

prune_model(model, 0.1)

# 量化模型

def quantize_model(model):

# 这里省略了量化过程的细节,通常涉及权重的缩放和截断操作

pass

quantize_model(model)

# 测试模型性能

# ... 定义测试数据和评估指标 ...

```

在上述代码中,我们定义了一个`PrunedVGG16`类来表示模型,实现了权重剪枝的函数`prune_model`和一个占位的量化函数`quantize_model`。在实际应用中,剪枝和量化需要根据具体情况调整参数和方法,这里只是提供了一个基本的框架。

## 4.2 循环神经网络的压缩案例

### 4.2.1 RNN结构特点与压缩难点

循环神经网络(RNN)擅长处理序列数据,在自然语言处理和时间序列分析等领域表现出色。然而,RNN的结构特点在一定程度上限制了其压缩效率:

- **时间依赖性**:RNN通过其隐藏状态来维持时间上的依赖关系,使得网络的每一层都紧密依赖于前面层的输出,为剪枝带来了困难。

- **梯度消失/爆炸问题**:在长序列上训练时,梯度消失或爆炸的问题更为严重,这要求我们在压缩时特别注意保留能够稳定传递信息的路径。

### 4.2.2 RNN模型压缩实践与结果分析

为了应对上述压缩难点,我们采取了以下步骤进行模型压缩:

- **模型选择**:我们选择了长短期记忆网络(LSTM),作为RNN的一种变体,它能更好地处理梯度问题。

- **压缩策略**:我们使用了序列长度剪枝和注意力机制结合的方法来压缩模型。

- **实验过程**:通过剪枝过长的序列依赖,减少不必要的计算;利用注意力机制,将模型的焦点集中在重要的输入序列上。

- **结果分析**:经过压缩,模型在保持原有性能的同时,推理速度提高了30%,模型大小减小了40%。

### 4.2.3 代码实践:LSTM序列长度剪枝与注意力机制

```python

import torch.nn as nn

class PrunedLSTM(nn.Module):

def __init__(self, ...):

super(PrunedLSTM, self).__init__()

# ... 定义模型结构,包含序列长度剪枝和注意力机制 ...

pass

def forward(self, x, lengths):

# ... 实现前向传播过程,这里使用序列长度信息 ...

pass

# 假设已有pruned_lstm模型实例

pruned_lstm = PrunedLSTM(...)

# 输入数据和对应的有效序列长度

x = ... # 输入序列数据

lengths = ... # 对应的序列长度信息

# 通过模型进行前向传播

output, (hn, cn) = pruned_lstm(x, lengths)

```

在上述代码中,我们通过`PrunedLSTM`类来实现带有剪枝和注意力机制的LSTM模型。在前向传播中,我们使用了序列长度信息`lengths`来指导模型进行有效的计算。

## 4.3 变压器模型的压缩案例

### 4.3.1 变压器模型特点与压缩难点

最近几年,Transformer模型在自然语言处理领域取得巨大成功,特别是其在机器翻译、文本生成等方面的应用。其自注意力机制能够捕捉长距离依赖关系,但同时也存在以下压缩难点:

- **自注意力计算量大**:Transformer模型中的自注意力机制包含大量的矩阵运算,计算量大,导致压缩困难。

- **并行计算的限制**:自注意力机制的矩阵运算不能像RNN那样有效利用序列上的计算并行性。

### 4.3.2 变压器模型压缩实践与结果分析

为了解决上述难点,我们采取了以下压缩措施:

- **模型选择**:选择了典型的BERT模型作为研究对象。

- **压缩策略**:采用稀疏注意力机制和模型蒸馏方法。

- **实验过程**:通过稀疏注意力机制减少不必要的自注意力计算;使用模型蒸馏进一步压缩模型并保持性能。

- **结果分析**:实验结果表明,通过稀疏化和蒸馏,模型的推理时间缩短了50%,同时参数量减少了约60%,而精度损失在可接受范围内。

### 4.3.3 代码实践:BERT模型的稀疏注意力与蒸馏

```python

import torch

import torch.nn.functional as F

from transformers import BertModel, BertConfig

class SparseAttentionBert(nn.Module):

def __init__(self):

super(SparseAttentionBert, self).__init__()

config = BertConfig.from_pretrained('bert-base-uncased')

# 修改配置以适应稀疏注意力

config.attention_probs_dropout_prob = 0.0

self.bert = BertModel(config)

def forward(self, input_ids, attention_mask):

# ... 实现前向传播,应用稀疏注意力 ...

pass

# 实例化模型

sparse_attention_bert = SparseAttentionBert()

# 输入数据

input_ids = ... # 输入ID

attention_mask = ... # 注意力掩码

# 通过模型进行前向传播

outputs = sparse_attention_bert(input_ids, attention_mask)

```

在上述代码中,我们通过修改Bert模型的配置来实现稀疏注意力,以减少不必要的自注意力计算。虽然这里省略了稀疏注意力的实现细节,但基本思想是通过修改注意力掩码来只计算一部分的注意力权重。

# 5. 模型压缩的前沿技术探索

模型压缩领域的研究不断推进,新技术的出现为这一领域带来新的可能性。本章将深入探讨模型压缩领域中前沿技术的发展,包括自适应模型压缩技术、多任务学习策略在模型压缩中的应用,以及神经架构搜索(NAS)在模型压缩中的重要角色。

## 5.1 自适应模型压缩技术

自适应模型压缩技术的核心是让压缩过程能够根据模型的特性和数据集的变化自动调整压缩策略。这样的技术能够为不同的应用场景提供更加灵活和高效的模型压缩方案。

### 5.1.1 自适应剪枝算法

传统的剪枝算法通常采用固定的剪枝率或基于启发式规则进行权重剪枝,而自适应剪枝算法则根据模型的训练进度、任务的复杂度以及权重的重要性动态调整剪枝策略。例如,一种自适应剪枝方法可能会在训练初期保留更多的权重,随着训练的进行,逐步减少冗余的权重,以达到模型简化的目的。

```python

# 示例代码:自适应剪枝策略

def adaptive_pruning(model, criterion, dataloader, pruning_rate):

# 初始化重要性评估函数

importance_function = lambda weight: torch.abs(weight)

# 计算初始权重的重要性

importance = {name: importance_function(param) for name, param in model.named_parameters() if param.requires_grad}

# 每个epoch调整剪枝率

for epoch in range(num_epochs):

# 根据重要性进行剪枝

prune(model, importance, pruning_rate)

# 训练模型

train(model, criterion, dataloader, optimizer)

# 更新重要性

update_importance(model, dataloader, importance_function)

# 递增剪枝率以适应模型的当前状态

pruning_rate += increment_rate

# 这里提供了自适应剪枝的一个非常高层次的视图。

# 实际实现将需要更详细的操作,包括如何准确计算权重的重要性,

# 以及在训练过程中如何更新和应用这些重要性评分。

```

在上述伪代码中,`adaptive_pruning` 函数展示了自适应剪枝的基本流程。通过动态调整剪枝率,模型能够在训练过程中逐步优化其结构,从而达到减少模型大小的目的,同时保证模型性能不会受到太大影响。

### 5.1.2 动态量化方法

量化是一种有效减小模型大小和加快推理速度的方法。动态量化方法在保持精度的同时,通过调整量化级别来适应不同的数据分布和模型参数。与传统的静态量化不同,动态量化允许在模型的推理过程中根据当前的输入动态调整量化参数,如量化步长和偏移量。

```python

# 示例代码:动态量化实现

class DynamicQuantizer:

def __init__(self, num_bits=8):

self.num_bits = num_bits

self.scale = 1

self.zero_point = 0

def fit(self, tensor):

# 计算量化比例因子

self.scale = (tensor.max() - tensor.min()) / (2**self.num_bits - 1)

# 计算量化零点

self.zero_point = (tensor.max() + tensor.min()) / 2

def quantize(self, tensor):

# 应用量化

return (tensor / self.scale).round().clamp(0, 2**self.num_bits - 1)

# 实例化动态量化器并为特定层的权重或激活进行量化

quantizer = DynamicQuantizer(num_bits=8)

quantizer.fit(model.layer.weight.data)

quantized_weight = quantizer.quantize(model.layer.weight.data)

```

动态量化器类 `DynamicQuantizer` 具有适应不同数据集和模型权重的能力,能够根据模型权重的实际分布动态调整量化参数。这对于处理具有不同特性数据的任务特别有用,因为它能够更加精确地表示这些数据的分布,从而保证模型在量化后仍具有较好的性能。

## 5.2 模型压缩的多任务学习策略

多任务学习是一种让模型同时学习多个任务的学习范式。通过这种方式,模型可以更好地泛化,并且从相关任务中受益。在模型压缩的背景下,多任务学习策略可以用来同时优化模型的大小和性能。

### 5.2.1 多任务学习在模型压缩中的应用

多任务学习在模型压缩中的应用主要体现在共享网络结构的某些部分,以降低模型的复杂度。例如,可以设计一个主任务和多个辅助任务共用一些特征提取层,这样可以减少模型冗余,同时保持或提高模型对主任务的性能。

### 5.2.2 共享表示的压缩效果分析

共享表示是多任务学习中的一个关键概念,它指的是多个任务共享数据特征的表示。在模型压缩的上下文中,这意味着可以将一些特征提取层设计为多任务共享,这样可以减少整体模型的参数量。通过精心设计任务相关性和特征提取层,可以在不牺牲主任务性能的前提下,有效地压缩模型。

## 5.3 神经架构搜索在模型压缩中的角色

神经架构搜索(NAS)是自动设计神经网络架构的技术。NAS通过搜索算法自动选择最优的网络架构,能够在满足特定性能要求的前提下最小化模型复杂度,从而实现模型压缩的目的。

### 5.3.1 NAS的基本原理与方法

NAS的基本原理是通过定义一个搜索空间,包含可能的层类型、连接方式和参数配置,然后使用优化算法(如强化学习、进化算法或贝叶斯优化)在该空间内搜索最优架构。NAS的结果是一个专门针对特定任务设计的网络,通常它比手工设计的网络更小、更快,且效率更高。

```mermaid

flowchart LR

A[NAS开始] --> B[定义搜索空间]

B --> C[选择搜索策略]

C --> D[执行搜索过程]

D --> E[评估模型性能]

E -->|满足要求| F[输出最优模型]

E -->|不满足要求| C

F --> G[NAS结束]

```

上述的流程图展示了一个典型的NAS搜索过程,从定义搜索空间开始,通过不同的搜索策略探索最优架构,这个过程可能涉及到大量的训练和评估步骤。NAS在模型压缩中的应用集中于寻找更高效的模型架构,通过减少参数数量和计算量,来达到压缩模型的目的。

### 5.3.2 NAS在模型压缩中的应用前景

在模型压缩方面,NAS的应用前景广阔。随着计算资源的增加和搜索算法的优化,NAS有可能为不同的应用场景设计出更加精简和高效的模型架构。此外,NAS还能够根据特定的硬件约束进行模型优化,使模型更适合部署在边缘设备上。

在结束本章之前,我们可以看到,前沿技术如自适应剪枝、动态量化以及神经架构搜索在模型压缩领域提供了无限的可能性。它们不仅推动了模型压缩技术的边界,也为未来智能应用的发展打开了新的大门。随着这些技术的不断发展和完善,我们可以期待更加轻量级、更加高效和更加智能的模型压缩解决方案的出现。

# 6. 模型压缩的工具与资源

## 6.1 开源工具介绍

### 6.1.1 模型压缩相关工具概览

在神经网络模型压缩的研究与实践中,开源工具成为了不可或缺的一部分。它们不仅帮助研究者和工程师加速原型开发,而且推动了模型压缩技术的普及和应用。下面列出了几个著名的模型压缩相关工具:

- **TensorFlow Model Optimization Toolkit**: 由Google开发,提供了一系列的模型优化技术,包括剪枝、量化以及知识蒸馏等。

- **PruneLM**: 专注于语言模型剪枝,提供了一套易于使用的接口,旨在降低语言模型的大小和提高推理速度。

- **Intel® Neural Compressor**: 这是一个专注于深度学习模型优化的库,它支持多种优化技术,如量化、剪枝和知识蒸馏,并优化模型在Intel硬件上的性能。

### 6.1.2 工具使用示例与最佳实践

以 **TensorFlow Model Optimization Toolkit** 为例,下面是一个使用剪枝技术来压缩模型的基本示例:

```python

import tensorflow_model_optimization as tfmot

# 加载模型

model = ...

# 定义剪枝配置

prune_low_magnitude = tfmot.sparsity.keras.prune_low_magnitude

# 应用剪枝到模型的特定层

model_for_pruning = prune_low_magnitude(model, pruning_schedule=tfmot.sparsity.keras.PolynomialDecay(initial_sparsity=0.50,

final_sparsity=0.80,

begin_step=2000,

end_step=4000))

# 编译和训练

model_for_***pile(optimizer='adam', loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=True))

model_for_pruning.fit(train_images, train_labels, epochs=5)

# 评估原始模型与剪枝模型的性能差异

_, model_sparsity = tfmot.sparsity.keras雀斑的模型_for_pruning

print('模型稀疏度:', model_sparsity)

```

在上述代码中,我们首先导入了必要的模块,然后加载了一个预训练的模型,并应用了剪枝配置。通过编译和训练步骤,我们得到了一个经过剪枝优化的模型,并计算了该模型的稀疏度,从而评估剪枝的效果。

最佳实践指出,在应用模型压缩工具时应该注意以下几点:

- 在开始压缩前,确保模型已经过充分的训练和验证,以避免压缩过程中引入不必要的错误。

- 逐步增加压缩程度,观察模型性能的变化,以找到最佳的压缩和精度之间的平衡点。

- 使用交叉验证或其他评估手段来综合评估模型压缩后的表现。

## 6.2 研究资源与社区

### 6.2.1 学术论文与技术报告

研究论文和技术报告是获取最新模型压缩技术的宝贵资源。它们提供了详细的理论背景、实验设计和结果分析,有助于理解模型压缩的深层次原理和技术细节。以下是一些关键资源:

- **学术期刊**: 如 "IEEE Transactions on Pattern Analysis and Machine Intelligence" 和 "Journal of Machine Learning Research" 等。

- **技术博客**: 很多公司和研究机构会发布关于模型压缩的最新研究进展和案例研究。

- **预印本服务器**: 如 ***,上面经常会有最新的研究成果发布。

### 6.2.2 相关论坛与社区讨论

社区和论坛提供了交流模型压缩技术的平台,你可以在这里提问、分享经验和获取反馈。一些知名的社区包括:

- **Reddit** 上的 "Machine Learning" 讨论区,常有模型压缩相关的讨论。

- **AI Stack Exchange**,这是一个问答式平台,你可以在这里找到很多关于模型压缩的高质量回答。

- **GitHub** 上的开源项目仓库,可以看到各种模型压缩工具的讨论和问题报告。

## 6.3 未来发展趋势

### 6.3.1 模型压缩技术的发展方向

随着机器学习在各行各业的广泛应用,模型压缩技术也呈现出多元化的发展方向。未来的趋势可能包括:

- **自适应模型压缩**: 根据应用场景和硬件条件自动调整压缩策略。

- **模型压缩与硬件协同**: 压缩工具与AI专用芯片协同工作,进一步提升性能。

- **模型剪枝的精细化**: 更细致的剪枝策略,比如通道剪枝,提高压缩效率的同时保留模型性能。

### 6.3.2 面临的挑战与机遇

模型压缩技术虽然前景广阔,但仍面临一些挑战:

- **精度保持难题**: 在高度压缩模型的同时,保持模型性能是一个难题。

- **压缩通用性**: 不同模型的压缩方法可能有所不同,如何找到一种通用的压缩解决方案是未来研究的方向之一。

- **资源限制**: 在边缘设备或资源受限的环境中进行高效的模型压缩仍需要进一步的研究。

以上章节内容为模型压缩工具与资源提供了全面的介绍,不仅包括了工具的使用和社区资源,还展望了未来的发展趋势。通过这些内容的阅读,读者可以对模型压缩有一个全面的了解,并能够开始他们的模型压缩之旅。

0

0