神经网络模型压缩评估指标详解:如何测试与优化性能

发布时间: 2024-09-06 07:15:36 阅读量: 130 订阅数: 57

# 1. 神经网络模型压缩的概念与重要性

## 1.1 神经网络模型压缩背景

在深度学习领域,随着模型复杂度的不断增加,模型的尺寸和计算需求也呈指数级增长。这导致部署在资源受限的设备上,如移动设备和嵌入式系统,变得具有挑战性。神经网络模型压缩技术应运而生,它旨在减少模型大小,降低计算复杂度,同时保持模型性能,以满足实际应用的需求。

## 1.2 模型压缩的定义

模型压缩可以定义为一系列减少神经网络参数数量和计算资源需求的技术。这些技术可以包括但不限于参数剪枝、权重量化、知识蒸馏、低秩分解等。通过这些方法,模型可以变得更加轻量,更易于部署在边缘设备上,同时减少推理时的能耗。

## 1.3 模型压缩的重要性

模型压缩对于深度学习的广泛应用至关重要。首先,它能够显著降低存储和传输成本,因为更小的模型需要更少的存储空间和带宽。其次,压缩后的模型在相同的硬件条件下运行更快,有助于提供实时响应,特别是在延迟敏感的应用中。此外,模型压缩还能提高能效,延长电池寿命,使得深度学习技术在移动和边缘计算环境中更为可行。

# 2. 模型压缩评估指标的理论基础

在深度学习领域,神经网络模型越来越庞大,处理这些模型所需的计算资源和存储空间也不断上升。模型压缩技术应运而生,旨在减少模型大小,降低计算复杂度,同时保持模型的性能不受太大影响。本章节将深入探讨模型压缩的评估指标,为读者提供模型压缩效果的量化分析方法。

## 2.1 模型大小的评估

### 2.1.1 参数数量与压缩比例

在模型压缩的众多评估指标中,参数数量是最直接的量化指标。模型的复杂度通常与参数的数量成正比,参数越多,模型越复杂。压缩比例则是压缩前后模型参数数量的比值,它反映压缩效果的显著性。

例如,一个具有100万个参数的模型被压缩至只有10万个参数,压缩比例则为0.1或者10%。一个较高的压缩比例意味着模型可以更有效地存储和传输。

### 2.1.2 模型存储空间要求

模型的存储空间要求不仅取决于参数数量,还与参数的表示形式有关。例如,32位浮点数表示的参数需要4字节,而使用8位整数表示则只需要1字节。因此,在评估模型大小时,不仅要看参数的数量,也要考虑参数的存储格式。

对于那些在边缘设备上运行的模型,存储空间是一个尤为重要的指标。比如,在移动设备上,模型需要适应有限的存储和带宽,压缩技术可以显著提升模型的可部署性。

## 2.2 计算复杂度的评估

### 2.2.1 浮点运算次数(FLOPs)分析

计算复杂度通常用浮点运算次数(FLOPs)来衡量,它表示模型在进行一次前向传播过程中所执行的浮点操作次数。FLOPs是一个重要的指标,因为它直接关联到模型的计算效率。

减少FLOPs并不总是等同于减少实际的运行时间,因为实际的运行时间也受到硬件架构、内存访问延迟和并行计算能力等因素的影响。不过,FLOPs提供了一个重要的理论基准,可用来比较不同模型或压缩策略的复杂度。

### 2.2.2 实际运行时间与能耗评估

实际运行时间是指模型在特定硬件上进行一次前向传播所需的时间。能耗评估则关注压缩模型在运行时所需消耗的能量。这些指标对于资源受限的环境尤其重要,如移动设备、嵌入式系统和IoT设备。

能耗和运行时间的评估通常需要在具体的硬件平台上进行。开发者可以通过使用诸如TensorFlow Lite或PyTorch Mobile这样的轻量级框架,针对不同硬件优化模型的执行效率。

## 2.3 泛化能力与精度的评估

### 2.3.1 精度损失的量化方法

模型压缩不可避免地会带来一定程度的精度损失。量化精度损失是压缩效果评估中不可或缺的一部分。通常,精度的损失是通过在验证集上测试压缩模型的性能来进行评估的。一般使用的是与未压缩模型的性能相比较,通过指标如准确率下降的百分点来量化。

例如,如果一个模型压缩前在测试集上的准确率为95%,而压缩后准确率为92%,那么精度损失就是3个百分点。

### 2.3.2 泛化能力的测试框架

泛化能力是指模型对未见过的数据的处理能力。测试泛化能力需要一个与训练数据分布不同的测试数据集。测试框架应包含不同的数据集,以便评估模型在现实世界数据上的表现。

一个好的测试框架需要确保测试集既包含数据集内的变化(intra-dataset variation),也应包含跨数据集的变化(inter-dataset variation),以便全面评估模型的泛化能力。

在下一章节中,将具体探讨模型压缩实践与技术,其中包括参数剪枝、量化与二值化、知识蒸馏等技术。我们将进一步分析如何在保持模型性能的同时实现有效的压缩。

# 3. 模型压缩实践与技术

模型压缩是提高神经网络模型应用效率的关键技术。通过减少模型的存储需求、计算需求和能耗,同时尽可能保持模型的准确性和泛化能力,模型压缩使得模型可以部署在计算能力有限的硬件上,例如移动设备、嵌入式系统等。在本章节中,我们将深入探讨三种主要的模型压缩技术:参数剪枝技术、量化与二值化技术、知识蒸馏技术,以及它们的实践和性能测试。

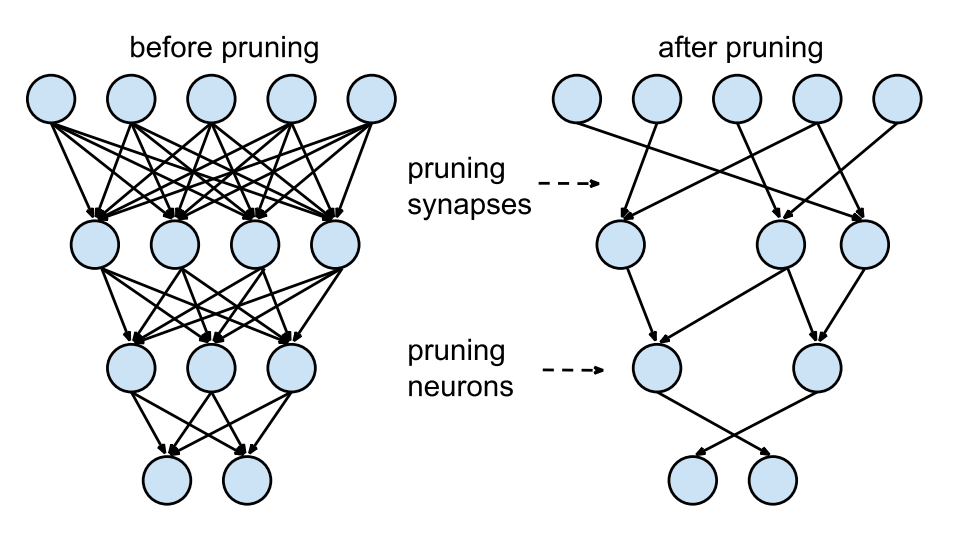

## 3.1 参数剪枝技术

参数剪枝技术旨在去除神经网络中不重要的参数,以此来减小模型的大小。参数的重要性可以通过多种方式来评估,包括基于梯度的方法、基于Hessian的方法或基于权值的敏感性方法等。

### 3.1.1 重要性评估与剪枝策略

在模型训练过程中,可以通过评估参数的重要性来决定哪些参数可以被剪枝。重要性评估的结果可以是基于参数的权重大小,也可以是基于参数对模型输出变化的影响程度。

- **基于梯度的方法**:分析每个参数的梯度大小,梯度大的参数对模型输出变化的影响大,因此被认为是重要的,应保留;梯度小的参数相对不重要,可以被剪枝。

- **基于Hessian的方法**:Hessian矩阵包含了二阶导数信息,可以用来评估参数对输出影响的曲率。曲率小的参数更容易被剪枝。

参数剪枝策略可以是**非结构化剪枝**,随机剪枝掉不重要的参数,这种剪枝方法实现简单,但会导致稀疏矩阵,难以在传统硬件上加速计算;或者是**结构化剪枝**,按照特定的模式剪枝,比如剪枝掉整个卷积核,这使得模型结构保持规则,适合硬件加速。

### 3.1.2 剪枝后模型的性能测试

剪枝后的模型需要进行性能测试以评估剪枝对模型性能的影响。测试通常包括模型在验证集和测试集上的准确率,以及模型的存储大小和推理时间。

- **准确率测试**:验证剪枝后的模型是否在验证集上保持了足够的准确率。如果准确率下降过大,则需要调整剪枝策略。

- **模型大小测试**:计算剪枝后模型的参数数量和存储大小,以评估压缩效率。

- **推理时间测试**:测量模型在实际硬件上的推理时间,以评估模型的运行效率。

```python

import torch

i

```

0

0