MapReduce Shuffle数据分布均衡术:自定义分区器的终极指南

发布时间: 2024-10-30 22:31:51 阅读量: 28 订阅数: 27

MapReduce编程模型基础实战教程:理解并实现大规模数据处理

# 1. MapReduce Shuffle机制概述

MapReduce作为一种编程模型,广泛用于大数据处理。Shuffle机制是其核心组成部分之一,承担着数据在Map和Reduce阶段传输的关键角色。在Shuffle阶段,中间数据从Map任务输出,经过排序、分组,最终传输给Reduce任务处理。这一过程的效率直接影响到整个作业的性能。接下来的章节将深入探讨Shuffle机制,特别是在数据分布不均衡问题上的影响,以及如何通过自定义分区器来优化数据处理流程。

# 2. 理解数据分布不均衡问题

### 2.1 MapReduce中Shuffle过程简介

#### 2.1.1 Shuffle阶段的作用和重要性

Shuffle阶段是MapReduce处理流程中最为关键的一个环节,它不仅涉及到数据在Map和Reduce任务之间的传输,还决定了最终数据的分布是否均衡,以及计算任务的执行效率。

- **数据传输**:在MapReduce的处理流程中,Map任务完成后,其输出结果需要通过网络传输给Reduce任务。这个过程中,Shuffle负责对数据进行排序、合并以及分组,并最终将数据送到对应的Reduce任务。

- **数据分布均衡**:Shuffle阶段还需要保证数据在各个Reduce任务间分布均匀,避免出现某些Reduce任务处理时间过长,而另一些却空闲的情况,即负载均衡。

- **性能影响**:不合理的数据分布会导致某些节点负载过高而成为瓶颈,进而影响整体计算性能。因此,优化Shuffle阶段对于提升MapReduce计算效率至关重要。

在大数据处理中,Shuffle效率的高低直接影响到作业的运行时间,因此理解Shuffle过程并合理调整相关参数和策略对于调优MapReduce作业具有举足轻重的作用。

#### 2.1.2 数据分布不均衡的影响分析

数据分布不均衡会对MapReduce作业的性能造成极大的影响。在Shuffle阶段,数据分布不均匀可能导致以下问题:

- **资源浪费**:由于数据在某些Reduce任务上过度集中,造成这部分节点资源的过度使用,而其他节点却空闲,造成资源分配的不均衡。

- **性能瓶颈**:部分Reduce任务因为数据量过大而处理缓慢,导致整个作业的执行时间被拉长。

- **作业失败**:极端情况下,某些Reduce任务可能因超时失败,进而导致整个MapReduce作业失败。

由于MapReduce作业依赖于Shuffle阶段的高效运行,因此需要通过分析和优化Shuffle过程来避免数据分布不均衡对作业性能造成影响。

### 2.2 标准分区器的局限性

#### 2.2.1 标准分区器的工作原理

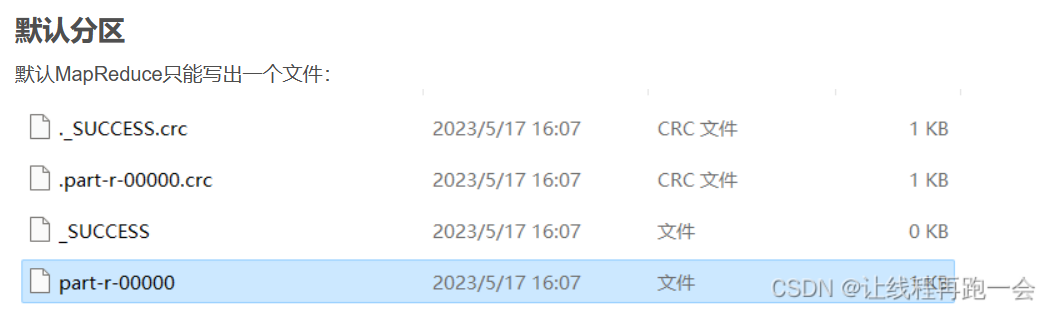

MapReduce框架提供了一个默认的分区器,即`HashPartitioner`,它根据键(key)的哈希值来决定数据归属到哪个Reduce任务。

- **哈希值计算**:通过一个哈希函数对键进行处理,得到一个整数,然后根据Reduce任务的数量(通过`getPartition`方法)对这个整数取模,得到一个索引值。

- **数据分配**:将键值对发送到根据上述索引值确定的对应Reduce任务。

该分区器操作简单,易于理解,但在处理数据分布不均匀的情况时显得力不从心。尤其是当数据倾斜明显时,某些Reduce任务处理的数据量会显著大于其他任务,导致Shuffle阶段的性能瓶颈。

#### 2.2.2 在实际应用中遇到的问题

在实际应用中,使用标准的`HashPartitioner`会导致一些具体问题:

- **数据倾斜**:对于一些热点键(key),大量数据都会被分配到同一个Reduce任务上,造成该任务负载过高。

- **低效的资源利用**:由于数据倾斜,一部分节点处理速度远高于其他节点,导致集群资源未能得到充分、高效的利用。

- **长尾效应**:数据倾斜会导致处理速度较慢的节点成为整个作业的瓶颈,这种长尾效应延长了作业的总执行时间。

这些问题对于需要处理大规模数据的MapReduce作业来说,是不可忽视的。因此,在遇到数据分布不均时,调整分区策略是非常重要的。

## 第三章:自定义分区器的理论基础

### 3.1 分区器的工作原理

#### 3.1.1 分区器的作用和分类

分区器主要负责在MapReduce作业中决定Map任务输出的中间数据如何分配到各个Reduce任务上。它直接影响到数据在Shuffle阶段的传输路径和最终的数据分布。

分区器可以根据实现策略进行分类:

- **基于哈希的分区器**:如标准的`HashPartitioner`,基于键的哈希值来进行数据划分。

- **范围分区器**:根据键的范围将数据分组,每个Reduce任务处理一组连续范围内的数据。

- **自定义分区器**:允许开发者根据具体业务逻辑来编写分区逻辑,适用于特定场景下的数据分布需求。

不同类型的分区器各有优势,针对实际应用场景选择合适的分区器,对提高MapReduce作业性能至关重要。

#### 3.1.2 自定义分区器的设计要点

设计一个高效的自定义分区器需要考虑以下几个要点:

- **数据均衡**:分区策略需保证各个Reduce任务处理的数据量大致相等,避免资源浪费和性能瓶颈。

- **键值空间分布**:对键值空间的理解有助于设计合理的分区策略,防止数据倾斜。

- **性能考量**:分区操作不应该成为瓶颈,需要在保证数据均衡的同时,尽量减少计算复杂度。

- **扩展性和可维护性**:在设计分区逻辑时,考虑作业规模变化带来的影响,保证自定义分区器的可扩展性和维护性。

在理解了这些设计要点后,开发者可以着手编写自定义分区器,以更好地适应特定的数据分布需求。

### 3.2 数据分布策略

#### 3.2.1 如何评估数据分布的均衡性

数据分布的均衡性对MapReduce作业的性能至关重要。评估数据分布是否均衡,可以从以下几个方面考虑:

- **负载平衡**:首先检查各个Reduce任务处理的数据量是否大致相等,这可以通过监控各个任务的执行时间和资源消耗来判断。

- **瓶颈识别**:通过分析日志和性能报告,查找是否存在执行时间异常的节点,这些节点可能就是数据倾斜的受害者。

- **数据倾斜识别**:如果某些节点处理的数据量远大于平均值,则可能存在数据倾斜的问题。

- **效率评估**:评估数据分布的改变是否带来了作业执行效率的提升,如果Shuffle阶段的时间缩短,作业总时间也相应减少,说明数据分布得到了改善。

#### 3.2.2 不同场景下的数据分布策略选择

根据不同的业务场景选择合适的数据分布策略是至关重要的:

- **离散型数据**:对于键值分布较为均匀的数据集,使用标准的`HashPartitioner`即可。

- **连续型数据**:如果键值具有一定的连续性,可以考虑使用范围分区器。

- **特定键值优先**:在某些情况下,可能需要优先处理特定的键值,此时可以设计一个优先级分区器,将这些特定键值的数据优先分发到特定的Reduce任务。

- **倾斜键值处理**:对于明显存在热点键值的情况,设计一个针对热点键值的数据集中处理策略,以减少对其他任务的影响。

选择适当的数据分布策略可以显著提高MapReduce作业的效率和性能。在实际应用中,开发者应根据数据特性、业务需求及集群资源状况进行综合考量。

# 3. 自定义分区器的理论基础

在本章节中

0

0