MapReduce Shuffle与HDFS交互优化:实战减少读写延迟技巧

发布时间: 2024-10-30 22:58:24 阅读量: 2 订阅数: 7

# 1. MapReduce Shuffle与HDFS交互优化概述

在大数据处理领域中,MapReduce作为一种经典的分布式计算模型,其性能优化对于提升整体数据处理效率至关重要。Shuffle阶段作为MapReduce中数据从Map任务传输到Reduce任务的关键过程,其效率直接影响到计算任务的执行速度和资源利用率。与此同时,Hadoop分布式文件系统(HDFS)是MapReduce任务的数据存储仓库,HDFS的读写性能也会显著影响Shuffle过程。因此,优化MapReduce Shuffle与HDFS之间的交互,对于提升大数据处理平台的效率和可靠性至关重要。

接下来,本章将首先概述Shuffle与HDFS交互过程中的基本概念和主要挑战,为读者提供一个优化的全局视角。我们将探讨Shuffle过程中存在的主要瓶颈和影响因素,如数据倾斜、资源分配不均以及I/O延迟等,并简要介绍业界通用的优化原则和方法。这将为深入分析Shuffle机制和HDFS读写优化策略打下坚实的基础。

# 2. MapReduce Shuffle机制深入分析

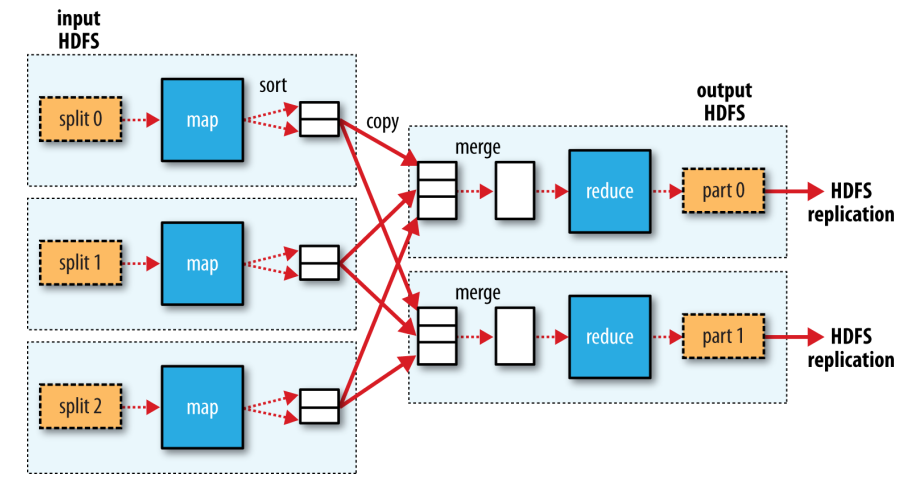

MapReduce Shuffle是Hadoop中的关键过程,负责在Map和Reduce任务间高效地传输中间数据。其性能直接影响到整个MapReduce作业的效率,因此对Shuffle机制的深入理解对于优化大数据处理至关重要。

## 2.1 Shuffle过程的关键步骤

Shuffle过程可以粗略地分为两个主要阶段:Map端Shuffle和Reduce端Shuffle。理解这两个阶段的细节,有助于我们针对性地进行性能调优。

### 2.1.1 Map端Shuffle

Map端Shuffle是将Map任务的输出结果排序后写入到本地磁盘的过程。具体步骤包括:

1. **Map输出处理**:Map任务完成后,其输出的键值对集合首先被写入到内存的缓冲区中。这一阶段缓冲区的大小可通过参数`mapreduce.task.io.sort.factor`来控制。

2. **排序与Spill**:缓冲区达到一定阈值(通常为80%)后,MapReduce框架启动后台线程将数据写入到磁盘,并进行分区和排序。这个过程称为Spill(溢写)。分区是通过`mapreduce.job.partitioner.class`参数设置的分区函数来决定的。

3. **归并排序**:在Spill过程中,多个溢写文件可能产生,最终会通过归并排序的方式将这些文件合并成最终的有序文件,等待Reduce端拉取。

### 2.1.2 Reduce端Shuffle

Reduce端Shuffle是指从Map端获取排序后的数据并进行合并的过程,主要步骤如下:

1. **数据拉取**:Reduce任务开始后,首先从各个Map任务拉取数据。这些数据首先会存储在Reduce任务的内存缓冲区中,由`mapreduce.reduce.shuffle.input.buffer.percent`参数来控制。

2. **合并数据**:当缓冲区中的数据达到一定阈值后,系统开始将数据写入磁盘,并根据需要进行归并排序。

3. **归并排序**:最终结果文件通过归并排序的方式写入到Reduce任务中进行后续的处理。

## 2.2 Shuffle性能的影响因素

Shuffle性能受到多方面因素的影响,优化这些因素可显著提高整体的MapReduce作业性能。

### 2.2.1 网络带宽和延迟

在 Shuffle 过程中,Map端将数据传到Reduce端,网络带宽和延迟对性能影响较大。使用高速网络设备、增加带宽或者使用网络优化技术(如流量调度和带宽管理)可以减少传输延迟。

### 2.2.2 硬盘I/O效率

硬盘I/O效率是Shuffle的瓶颈之一。使用SSD硬盘替代传统的机械硬盘,可以大幅提升I/O效率。同时,合理配置I/O调度策略,比如调整`fs.inotify.max_user_watches`参数,以减少I/O操作频率,也能提升性能。

### 2.2.3 CPU和内存资源

CPU和内存资源对Shuffle性能同样至关重要。合理的资源分配(如通过设置`mapreduce.map.java.opts`和`mapreduce.reduce.java.opts`参数)确保了足够的内存和CPU来处理数据排序和归并操作。

接下来将探讨HDFS读写机制的优化策略,为实现大数据处理的高效性铺平道路。

# 3. HDFS读写机制优化策略

## 3.1 HDFS读写性能

0

0