语音识别技术的神经网络驱动:从挑战到实践

发布时间: 2024-09-06 04:34:01 阅读量: 120 订阅数: 47

# 1. 语音识别技术概述

在信息技术的快速发展中,语音识别技术作为人工智能的一个重要分支,已经渗透到我们日常生活的方方面面。语音识别技术使机器能够通过听觉理解人类的语音信号,将其转化为文字或者执行相应的指令,极大地提高了人机交互的效率和便捷性。从最早的基于规则的方法,到如今的深度学习方法,语音识别技术的发展经历了质的飞跃,成为连接现实世界与数字世界的桥梁。本章将对语音识别技术的发展历史、基本原理、应用领域以及未来的发展趋势进行简要介绍。

# 2. 神经网络基础与应用

## 2.1 神经网络的基本原理

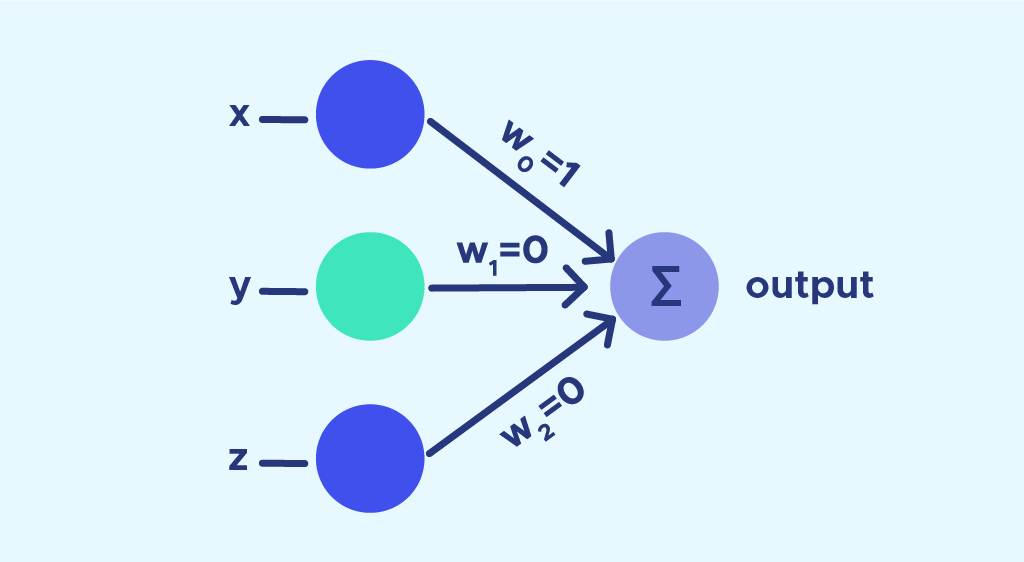

### 2.1.1 神经元和网络结构

神经网络是由大量的简单计算单元构成,这些计算单元被称为神经元。每个神经元模拟人类大脑中的神经元,能够接收输入信息,处理后输出结果。

在神经网络中,神经元通常被组织成不同的层次。最简单的神经网络是单层感知器,其中包含输入层和输出层。多层神经网络,尤其是深度神经网络,包含隐藏层。隐藏层使得网络能够学习数据中的更复杂的模式。

```python

# 示例:构建简单的单层感知器模型

import numpy as np

def sigmoid(x):

"""Sigmoid激活函数"""

return 1 / (1 + np.exp(-x))

class Perceptron:

def __init__(self, input_size):

self.weights = np.random.rand(input_size + 1)

def forward(self, x):

"""前向传播函数"""

input_with_bias = np.insert(x, 0, 1) # 加入偏置项

output = sigmoid(np.dot(self.weights, input_with_bias))

return output

# 创建感知器实例

perceptron = Perceptron(input_size=3)

# 示例输入向量

input_vector = np.array([0.5, 0.2, 0.8])

# 执行前向传播计算

output = perceptron.forward(input_vector)

print(output)

```

上述代码构建了一个简单的单层感知器模型,并演示了如何将输入向量通过模型进行前向传播并输出。权重和偏置是随机初始化的,激活函数使用的是Sigmoid函数。

### 2.1.2 激活函数和前向传播

激活函数在神经元中起到了至关重要的作用。它决定神经元是否应该被激活,即是否应该向后一层传递信号。常见的激活函数包括Sigmoid、ReLU和Tanh等。不同的激活函数具有不同的数学特性和应用场合。

前向传播是指数据在神经网络中从输入层向后层传递的过程。每个神经元的输出成为下一个层次神经元的输入,直至输出层产生最终的预测结果。

```python

# 示例:前向传播过程中的激活函数应用

class NeuralNetwork:

def __init__(self, input_size, hidden_size, output_size):

self.weights_input_hidden = np.random.rand(input_size, hidden_size)

self.weights_hidden_output = np.random.rand(hidden_size, output_size)

self.activation_function = sigmoid # 使用Sigmoid激活函数

def forward(self, x):

"""前向传播函数"""

hidden_layer_input = np.dot(x, self.weights_input_hidden)

hidden_layer_output = self.activation_function(hidden_layer_input)

output_layer_input = np.dot(hidden_layer_output, self.weights_hidden_output)

output = self.activation_function(output_layer_input)

return output

# 创建神经网络实例

nn = NeuralNetwork(input_size=3, hidden_size=2, output_size=1)

# 示例输入向量

input_vector = np.array([0.5, 0.2, 0.8])

# 执行前向传播计算

output = nn.forward(input_vector)

print(output)

```

上述代码实现了一个具有隐藏层的简单神经网络,并在前向传播过程中应用了Sigmoid激活函数。这演示了如何处理输入数据,并通过隐藏层传递到输出层。

## 2.2 神经网络的训练技术

### 2.2.1 反向传播算法

反向传播算法是神经网络训练中的核心算法,用于计算梯度并更新网络权重。算法通过计算损失函数关于网络参数的导数,然后利用链式法则进行梯度的反向传播。通过这种方式,网络能够学习到如何调整参数以最小化预测误差。

```python

# 示例:计算损失函数关于权重的梯度

def compute_loss(y_true, y_pred):

"""计算均方误差损失函数"""

return np.mean((y_true - y_pred) ** 2)

def compute_gradient(y_true, y_pred, x):

"""计算损失函数关于权重的梯度"""

return np.dot(x.T, (y_pred - y_true)) / len(y_true)

# 假设已经有一些训练数据和真实标签

x_train = np.array([[0.5, 0.2, 0.8], [0.3, 0.1, 0.2], ...])

y_true = np.array([0.7, 0.2, ...])

# 假设已经执行了前向传播得到预测结果 y_pred

# 计算损失

loss = compute_loss(y_true, y_pred)

# 计算梯度

gradient = compute_gradient(y_true, y_pred, x_train)

print("损失值: ", loss)

print("权重梯度: \n", gradient)

```

上述代码演示了如何计算损失函数以及损失函数关于权重的梯度。在实际的神经网络训练过程中,这些计算会被反复执行,并结合优化器来更新权重。

### 2.2.2 权重优化和正则化

权重优化是指调整神经网络参数以提高模型性能的过程。常见的权重优化算法包括梯度下降及其变体,比如SGD(随机梯度下降)、Adam等。正则化技术如L1和L2正则化被用来防止过拟合,保证模型的泛化能力。

```python

# 示例:权重优化和正则化

# 假设在神经网络类中已经定义了权重优化的函数

# 初始化权重

weights = np.random.rand(input_size, hidden_size)

# 设置超参数:学习率和正则化参数

learning_rate = 0.01

l2_lambda = 0.01

# 在训练循环中优化权重

for iteration in range(num_iterations):

# 前向传播

y_pred = ... # 通过当前权重得到预测结果

# 计算损失和梯度

loss, gradient = compute_loss_and_gradient(y_true, y_pred, x_train)

# 权重更新规则,结合L2正则化

weights -= learning_rate * (gradient + l2_lambda * weights)

print("优化后的权重: \n", weights)

```

在上述示例中,演示了如何在训练过程中使用梯度下降算法优化权重。同时加入了L2正则化项,以避免权重过大导致模型过拟合。

## 2.3 神经网络在语音识别中的应用

### 2.3.1 特征提取技术

语音识别系统通常需要从原始音频信号中提取有用的特征。这些特征包括MFCC(梅尔频率倒谱系数)、FBANK(滤波器组特征)等。特征提取是语音识别中至关重要的步骤,因为所选特征直接决定了识别的准确性。

```python

# 示例:使用librosa库提取MFCC特征

import librosa

import numpy as np

def extract_mfcc(audio_signal, sample_rate):

"""提取MFCC特征"""

mfccs = librosa.feature.mfcc(y=audio_signal, sr=sample_rate)

return mfccs

# 加载音频信号

audio_signal, sample_rate = librosa.load('path_to_audio_file.wav')

# 提取MFCC特征

mfcc_features = extract_mfcc(audio_signal, sample_rate)

print("MFCC特征: \n", mfcc_features)

```

在上面的代码中,展示了如何使用librosa库提取音频信号的MFCC特征。提取的特征可以用于训练语音识别模型。

### 2.3.2 端到端语音识别系统

端到端的语音识别系统是指可以直接从原始音频输入到文字输出的系统。深度学习的兴起使得端到端系统变得越来越流行,例如基于CTC(Connectionist Temporal Classification)或注意力机制的模型。这些系统通常在特定数据集上进行训练,以达到最优的识别效果。

```python

# 示例:构建一个简单的端到端语音识别模型结构

import tensorflow as tf

from tensorflow.keras.layers import Input, Dense, LSTM, Bidirectional

from tensorflow.keras.models import Model

# 定义输入层

input_layer = Input(shape=(None, mfcc_features.shape[1]))

# 定义双向LSTM层

lstm_layer = Bidirectional(LSTM(512, return_sequences=True))(input_layer)

# 定义输出层

o

```

0

0