实体识别的神经网络应用:案例与原理深度解析

发布时间: 2024-09-06 04:36:55 阅读量: 123 订阅数: 45

# 1. 实体识别技术概述与应用背景

## 1.1 实体识别技术简介

实体识别(Named Entity Recognition, NER),是自然语言处理(Natural Language Processing, NLP)的一项核心任务,旨在从文本数据中识别并分类特定的有意义实体,如人名、地点、组织机构名、时间表达等。通过对实体的识别,可以实现对文本的深层次理解和知识抽取,从而构建起知识图谱、提供智能搜索、情感分析、问答系统等高级信息服务。

## 1.2 实体识别的应用背景

在信息化时代,实体识别技术已经成为许多行业不可或缺的一部分,尤其在情报分析、社交媒体监控、法律和医疗文档处理等领域。随着人工智能的发展,实体识别技术不仅提高了数据处理的效率,而且在增强数据可用性和驱动决策支持系统方面发挥着重要作用。

# 2. 实体识别的理论基础

## 2.1 自然语言处理中的实体识别概念

实体识别(Named Entity Recognition,简称NER),是自然语言处理(NLP)领域的一个基础且重要的任务,旨在从文本中识别出具有特定意义的实体。这些实体可以是人名、地名、机构名、时间表达式等。实体识别的准确度直接影响到信息抽取、问答系统、机器翻译等其他NLP应用的质量。

### 2.1.1 实体识别的定义与重要性

实体识别,一般指将文本中的特定词组或短语识别为预定义类别的实体的过程。例如,在句子“Michael Jordan is considered one of the greatest basketball players of all time.”中,实体识别技术能够识别出“Michael Jordan”为人名,“basketball players”为职业类实体。

实体识别的重要性在于,它为后续的信息提取工作奠定了基础。在文本分析和数据挖掘中,正确地识别出实体,可以帮助我们更好地理解文本内容,从而进行有效的数据分析和决策支持。

### 2.1.2 实体识别的常见类型和应用场景

实体识别主要可以分为以下几类:

- 专有名词识别:识别出文本中的人名、地名、机构名等。

- 数值实体识别:包括时间、日期、货币、百分比等。

- 一般实体识别:如产品名称、地址、职称等。

实体识别在多个应用场景中都起着关键作用:

- 搜索引擎:通过识别实体,可以提高搜索的精确度和相关性。

- 社交媒体监控:自动检测品牌、产品或个人名称在社交媒体上的提及。

- 机器翻译:识别实体有助于翻译的连贯性和准确性。

## 2.2 神经网络在实体识别中的角色

### 2.2.1 神经网络基础与工作原理

神经网络是一系列受人类大脑启发的算法模型,它们能够通过学习从大量数据中获得规律和特征,并用于新的数据预测。神经网络通常包含大量的节点(或称为“神经元”),这些节点之间通过带权重的连接相连接,网络通过调整连接的权重来学习数据中的特征。

一个简单的神经网络由输入层、隐藏层和输出层组成。数据首先输入到输入层,然后通过隐藏层进行处理,最后到达输出层,输出预测结果。深度神经网络通过增加隐藏层数量来增强模型的表达能力。

### 2.2.2 神经网络模型的分类及其选择标准

神经网络模型根据不同的结构和学习方式,可以分为多种类型,其中包括:

- 前馈神经网络(Feedforward Neural Network,FNN):是最基本的神经网络模型,信息沿着一个方向流动,没有反馈。

- 卷积神经网络(Convolutional Neural Network,CNN):主要用于处理图像数据,但也可以用于序列数据的特征提取。

- 循环神经网络(Recurrent Neural Network,RNN):能够处理序列数据,适用于文本、语音等。

- 长短时记忆网络(Long Short-Term Memory,LSTM):一种特殊的RNN,能够学习长序列数据中的长期依赖关系。

- Transformer模型:以自注意力机制为核心,无需递归处理,适合并行计算,近年来在NLP领域大放异彩。

选择合适的神经网络模型,应考虑数据的类型和特征、任务的复杂性、计算资源等因素。例如,对于处理文本数据,一般首选RNN或Transformer模型,尤其是对于实体识别这类序列标注任务。

## 2.3 实体识别的关键技术分析

### 2.3.1 特征工程与上下文理解

在实体识别中,正确地提取和利用特征是至关重要的。特征工程主要关注于如何将原始文本数据转换为模型能够有效处理的数值形式。

- 单词表示:使用词嵌入(如Word2Vec、GloVe)将单词转化为稠密的向量。

- 上下文特征:考虑单词周围的上下文信息,通常利用双向模型,如BiLSTM,来捕获。

- 外部知识:整合如词典、知识图谱等外部知识源,增强模型对实体的认知能力。

上下文理解是指模型必须能够利用句子中其他部分的信息来识别一个实体。例如,一个名词前后的形容词和限定词通常为识别名词实体提供有用的线索。

### 2.3.2 模型训练与评估方法

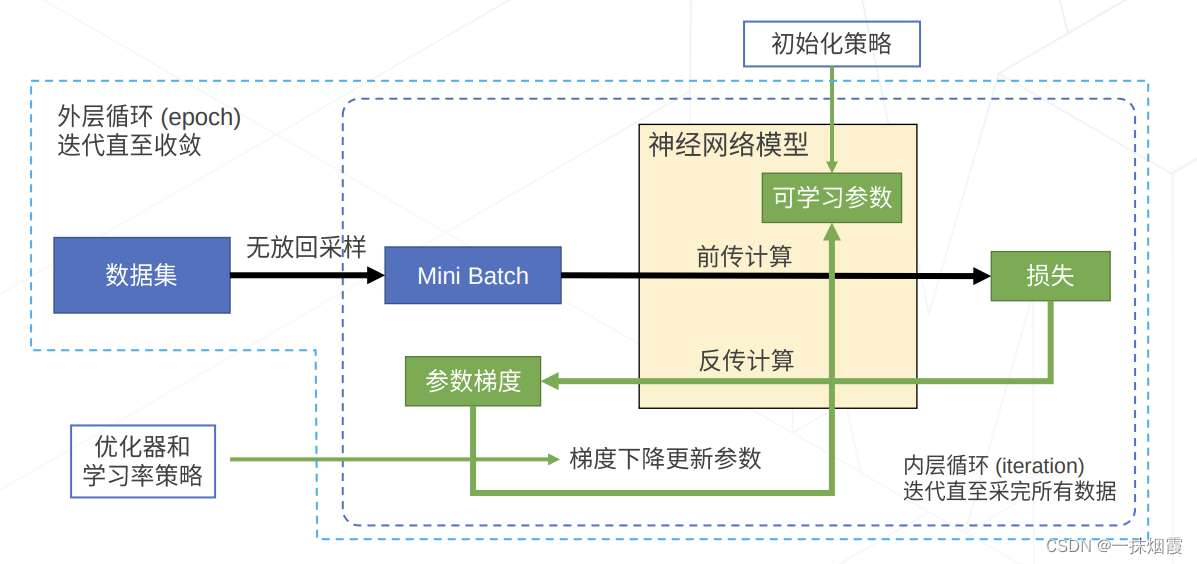

模型训练是实体识别过程中关键的一步。神经网络模型通过从标注好的训练数据中学习,不断调整自身的参数。训练过程通常包括以下几个步骤:

- 损失函数的选择:常用的损失函数包括交叉熵损失(Cross-Entropy Loss)。

- 优化算法:如SGD、Adam等,用于更新网络权重。

- 批处理和梯度累积:为了有效利用内存和计算资源,通常采用批处理的方法,并在必要时进行梯度累积。

模型评估主要使用以下指标:

- 准确率(Precision):预测为正例的样本中实际为正例的比例。

- 召回率(Recall):实际为正例的样本中被正确预测的比例。

- F1分数(F1 Score):准确率和召回率的调和平均数,用于平衡两者。

为了评估实体识别的性能,通常将测试数据集分为不同的类别,分别计算每一类的指标,然后计算总体的宏平均和微平均指标。

实体识别技术的发展是一个不断进步的过程,随着深度学习技术的不断发展,该领域出现了许多新的模型和方法。下面章节将具体介绍这些模型在实体识别中的应用案例。

# 3. 神经网络在实体识别中的应用案例

神经网络因其强大的特征提取和模式识别能力,已经在实体识别领域展现出了显著的优势。本章节将深入探讨神经网络在构建实体识别模型中的具体应用案例,包括在不同领域内的使用方法、面对的挑战以及解决方案。我们将从金融和医疗两个具有代表性的应用案例入手,分析神经网络如何助力实体识别技术在实践中取得成功。

## 3.1 神经网络模型的构建过程

在开始案例分析之前,我们首先要了解神经网络模型的构建过程。这个过程包括数据预处理、设计嵌入层、选择模型架构和优化策略等关键步骤。

### 3.1.1 数据预处理与嵌入层的设计

数据预处理是构建任何机器学习模型的关键步骤,神经网络也不例外。在实体识别任务中,预处理包括文本清洗、分词、去除停用词等操作,旨在提高数据的质量和模型的性能。

```python

import nltk

from nltk.corpus import stopwords

from nltk.tokenize import word_tokenize

# 示例代码:文本预处理步骤

nltk.download('punkt')

nltk.download('stopwords')

# 假设有一个原始文本

original_text = "Entity recognition is an essential part of NLP."

# 分词处理

tokens = word_tokenize(original_text)

# 去除停用词

filtered_tokens = [word for word in tokens if word.lower() not in stopwords.words('englis

```

0

0