文本分类轻松做:利用SpaCy快速搭建高效分类系统

发布时间: 2024-09-30 19:35:16 阅读量: 55 订阅数: 32

# 1. 文本分类简介与重要性

## 1.1 什么是文本分类

文本分类是将文本数据根据内容或特征分配到不同的类别中的过程。例如,垃圾邮件检测、新闻分类、情感分析都是常见的文本分类应用。这个过程对于自动信息检索、智能推荐系统和自然语言处理(NLP)等众多领域至关重要。

## 1.2 文本分类的重要性

文本分类的重要性体现在能够帮助我们从大量未排序的文本中快速提取有价值的信息。随着互联网的爆炸式增长,文本数据呈现指数级增长,有效的文本分类可以极大地提高信息检索的效率。此外,文本分类在内容过滤、监控和个性化服务等方面也发挥着关键作用。

## 1.3 文本分类的发展历程

文本分类的发展历程可以追溯到早期的基于规则和模板的方法,随后逐渐发展到统计模型方法,如朴素贝叶斯和支持向量机。近年来,随着深度学习技术的兴起,尤其是循环神经网络(RNN)和Transformer架构的流行,文本分类在准确度和效率上都取得了显著进步。

# 2. SpaCy框架基础

## 2.1 SpaCy的核心特性

### 2.1.1 高效的NLP流程

SpaCy 是一个开源的自然语言处理库,专为生产环境而设计,提供了最先进的速度和准确度,是处理大规模文本数据的首选。SpaCy 的核心特性之一就是其高效的NLP流程。这一特性为从事自然语言处理任务的开发者们提供了一个强大的工具集。

核心算法优化是 SpaCy 高效的关键所在。SpacPy 使用了 Cython,一种C语言的扩展,能够实现底层功能的编译,从而加速运行。这一特性使得 SpaCy 在处理自然语言任务时比许多其他框架更快。在大规模文本数据集上,SpaCy 的速度优势尤其明显,这对于需要处理大量数据的应用程序来说至关重要。

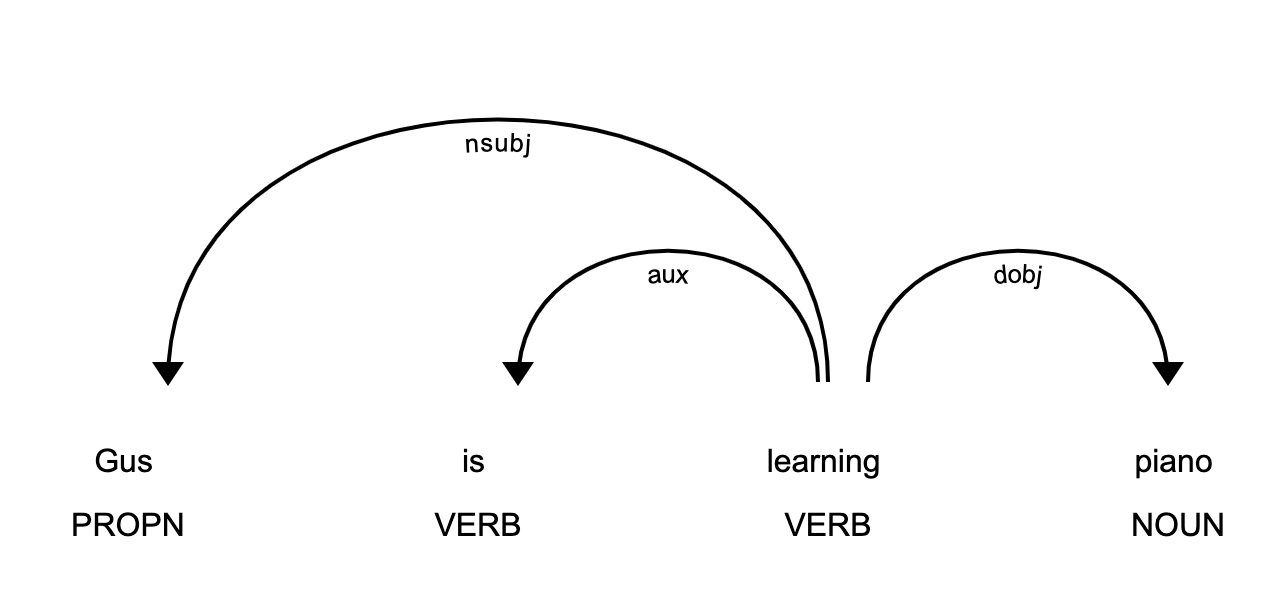

此外,SpaCy 的处理流程是经过高度优化的。从文本的分词(tokenization)开始,到词性标注(part-of-speech tagging)、命名实体识别(named entity recognition)和依存句法分析(dependency parsing),每个步骤都设计得非常高效。这对于实时或准实时的应用场景至关重要,如聊天机器人、自动新闻摘要或语言翻译等。

```python

import spacy

# 加载英文模型

nlp = spacy.load("en_core_web_sm")

# 处理一段文本

doc = nlp("Apple is looking at buying U.K. startup for $1 billion")

# 打印结果

print([(token.text, token.pos_, token.dep_) for token in doc])

```

在上面的代码中,我们加载了一个英文的小模型,并处理了一句示例文本。通过这种方式,SpaCy 快速地完成了一个文本的分词、词性标注和依存句法分析,展示了其高效处理NLP任务的能力。

### 2.1.2 内建的管道和模型

SpaCy 不仅仅是高效的NLP工具,它还具有强大的预训练模型,这些模型使得 SpaCy 在多种NLP任务上都拥有卓越的表现。SpaCy 内建了多个预训练的管道,包括语言模型、词向量、文本分类器等。

SpaCy 通过一系列的预处理和预训练的管道来实现这些功能。这些管道是由大量数据训练得到的,能够捕捉文本中的丰富语义信息。对于许多常见的NLP任务,如文本分类、命名实体识别等,我们可以直接利用这些预训练的管道获得非常不错的结果,这对于快速原型开发和产品迭代尤其有用。

```python

import spacy

from spacy.tokens import Doc

# 加载英文模型

nlp = spacy.load("en_core_web_sm")

# 创建一个空的管道

with nlp.disable_pipes('ner', 'textcat'):

# 处理一段文本

doc = nlp("Apple is looking at buying U.K. startup for $1 billion")

# 执行自定义任务:例如计算某些词出现的次数

word_count = {}

for token in doc:

word_count[token.text] = word_count.get(token.text, 0) + 1

```

上面的代码展示了如何使用 SpaCy 禁用特定的管道(如命名实体识别NER和文本分类器),并手动遍历文档中的每个词,执行自定义任务。即使在禁用了一些高级管道后,SpaCy 的基础管道仍可以高效地完成文本的分词和基础处理。

## 2.2 SpaCy的安装与配置

### 2.2.1 安装SpaCy及依赖

安装 SpaCy 相对简单,但需要一些必要的系统依赖。在安装 SpaCy 之前,需要确保系统已经安装了Python。然后,可以使用 Python 的包管理器 pip 来安装 SpaCy。对于 Windows 用户,可能需要使用 pip 附带的 wheel 工具来安装二进制包,以避免编译依赖的问题。

在 Linux 或 macOS 上,可以使用以下命令安装 SpaCy:

```shell

pip install spacy

python -m spacy download en_core_web_sm

```

对于 Windows 用户,可以使用:

```shell

pip install spacy

python -m spacy download en_core_web_sm --force

```

安装 SpaCy 的同时,也需要安装特定语言的模型。如上面的命令中,`en_core_web_sm` 是英文的小型模型。如果需要其他语言或更大型的模型,可以通过命令行下载对应的模型包。

### 2.2.2 初始化SpaCy环境

安装完 SpaCy 及其依赖后,下一步就是初始化环境,准备进行NLP任务的处理。这一部分涉及到加载预训练的模型、创建 SpaCy 的处理管道,以及准备处理文本所需的环境。

初始化环境涉及到加载预训练的模型和设置 SpaCy 的管道。预训练的模型包含了模型的权重和参数,这是文本处理的基础。每个模型针对不同的任务进行了训练,如分词、命名实体识别等。

```python

import spacy

# 加载英文的小型模型

nlp = spacy.load("en_core_web_sm")

# 创建一个新的文档

doc = nlp("Apple is looking at buying U.K. startup for $1 billion")

# 打印文档中的命名实体

for ent in doc.ents:

print(ent.text, ent.label_)

```

在上述示例代码中,我们首先导入了 spacy 包,并加载了英文的小型模型。接着,我们用这个模型来处理一段文本,并打印出文档中的命名实体。这个过程就是初始化环境和处理文本的一个简单示例,展示了 SpaCy 环境如何快速开始工作。

## 2.3 SpaCy的基本操作

### 2.3.1 文本处理和分词

文本处理和分词是文本分析的第一步,也是进行更深入NLP分析的基础。SpaCy 提供了非常强大的文本处理和分词工具,可以帮助开发者快速将文本分解为可分析的单元。

```python

import spacy

# 加载英文的小型模型

nlp = spacy.load("en_core_web_sm")

# 将一段文本分割成单独的词元

text = "Apple is looking at buying U.K. startup for $1 billion"

doc = nlp(text)

# 遍历文档中的所有词元

for token in doc:

print(token.text, token.pos_, token.dep_, token.shape_, token.is_alpha, token.is_stop)

```

在这段代码中,我们使用 SpaCy 加载了一个英文的小型模型,并使用该模型处理了一个包含货币、公司名和国家代码的句子。代码输出了每个词元的文本、词性、依存关系、形状、是否是字母和是否是停用词等信息,这有助于我们理解文本处理和分词过程。

### 2.3.2 词性标注和实体识别

词性标注(Part-of-Speech tagging, POS tagging)和命名实体识别(Named Entity Recognition, NER)是两个重要的NLP任务,它们能够帮助我们进一步理解文本的内容和结构。

```python

import spacy

# 加载英文的小型模型

nlp = spacy.load("en_core_web_sm")

# 处理一段文本

doc = nlp("Apple is looking at buying U.K. startup for $1 billion")

# 打印每个词元的词性和实体类型

for token in doc:

print(token.text, token.pos_, token.ent_type_)

```

通过运行上述代码,我们得到了每个词元的词性标注和实体类型。SpaCy 不仅能够识别出像数字和货币这样的简单实体,也能够识别出公司名、地名等更复杂的命名实体。

## 2.4 SpaCy的高级管道操作

### 2.4.1 自定义管道组件的添加与配置

SpaCy 支持自定义管道组件,这允许开发者在预处理流程中添加自己定义的功能。这在需要预处理特定格式的数据或执行一些定制化任务时非常有用。

```python

import spacy

from spacy.pipeline import Pipe

# 定义一个自定义的管道组件

class CustomComponent(Pipe):

name = "custom_component"

def __init__(self, nlp):

# 可以在这里初始化一些参数

super().__init__()

def __call__(self, doc):

# 在这里实现管道的功能

for token in doc:

token._.custom_extension = "附加信息"

return doc

# 加载英文模型

nlp = spacy.load("en_core_web_sm")

# 添加自定义组件到处理管道

nlp.add_pipe("custom_component", last=True)

# 使用模型处理文本

doc = nlp("This is a sample text.")

print([(token.text, token._.custom_extension) for token in doc])

```

上面的代码定义了一个自定义的管道组件,并将其添加到 SpaCy 的处理管道中。在管道组件中,我们为每个词元添加了一个自定义的属性。在处理文本后,我们打印出每个词元的文本及其自定义属性,展示了自定义管道组件的功能。

通过这种方式,开发者可以根据自己的需求灵活地扩展 SpaCy 的功能,增强其处理特定任务的能力。这使得 SpaCy 不仅仅是一个简单的NLP工具,而是可以变成一个强大、可定制的平台。

# 3. 理论框架与SpaCy实现

在探讨文本分类的理论框架之前,我们首先要明白文本分类的目的。文本分类是一种将文本自动归入一个或多个预定义类别的技术,它在自然语言处理(NLP)领域扮演着重要角色。其应用范围包括垃圾邮件检测、情感分析、新闻文章的自动分类等。掌握理论基础对于在实际项目中应用SpaCy等NLP工具至关重要。

## 3.1 文本分类的理论基础

### 3.1.1 分类算法概述

文本分类算法主要分为监督学习和非监督学习两大类。监督学习算法依赖于标注好的训练数据集,常见的算法包括朴素贝叶斯、支持向量机(SVM)、决策树、随机森林和神经网络等。非监督学习算法则不需要标注数据,常用的有聚类算法,如K-means、层次聚类等。在选择算法时,需要根据数据特性、分类任务的复杂度以及计算资源等因素来决定。

### 3.1.2 特征提取方法

文本数据是非结构化的,为了将其用于机器学习模型,我们需要将文本转化为数值型特征。常见的特征提取方法有:

- 词袋模型(Bag of Words,BoW):将文本转换为词频向量,忽略单词之间的顺序。

- TF-IDF(Term Frequency-Inverse Document Frequency):在BoW的基础上对频繁出现的词进行权重调整。

- Word Embeddings:使用预训练的词向量模型(如Word2Vec或GloVe)将词语转换为密集型向量。

在本章节中,我们将详细探讨如何使用SpaCy来实现这些理论概念,并将其应用到具体的文本分类任务中。

## 3.2 SpaCy在文本分类中的应用

### 3.2.1 构建文档向量

SpaCy提供了强大的文本处理功能,但原始的SpaCy模型不直接支持构建用于分类的文档向量。为了实现这一点,我们需要对文档进行一些预处理,将文档拆分成句子或段落,并将每个句子或段落转换为向量。这可以通过SpaCy的句子分割功能实现,然后可以应用TF-IDF或Word Embeddings来创建这些向量。

### 3.2.2 使用SpaCy进行分类任务

SpaCy本身主要用于文本处理而不是直接的文本分类,但可以结合其他机器学习库(如scikit-learn或TensorFlow)来完成分类任务。具体步骤包括:

1. 使用SpaCy处理文本数据,并提取特征。

2. 使用提取的特征训练一个分类器(比如scikit-learn中的支持向量机)。

3. 使用该分类器对新的文本数据进行分类预测。

这里是一个简单的示例代码,展示了如何使用SpaCy和scikit-learn库来进行文本分类:

```python

import spacy

from sklearn.feature_extraction.text import TfidfVectorizer

from sklearn.svm import LinearSVC

from sklear

```

0

0