SpaCy可视化工具指南:直观理解文本数据的最佳实践

发布时间: 2024-09-30 20:18:30 阅读量: 30 订阅数: 44

# 1. SpaCy可视化工具概述

自然语言处理(NLP)是人工智能领域中一个充满活力的分支,它致力于使计算机能够理解、解释和生成人类语言。SpaCy作为一个现代的自然语言处理库,以简洁的API、快速处理能力和丰富的功能著称。本章将探讨SpaCy可视化工具的基本概念,包括其在NLP工作流程中的作用和重要性。

## 1.1 SpaCy可视化工具的必要性

在NLP的复杂任务中,可视化不仅有助于快速理解文本数据的结构和特征,还能促进算法决策的透明度。SpaCy的可视化工具为用户提供了直观地分析和解释文本数据的方式,从而提高了数据处理的效率和准确性。

## 1.2 SpaCy可视化工具的种类

SpaCy支持多种内置和第三方可视化工具,使得用户可以根据具体需求选择合适的工具。内置工具如`displaCy`提供了句子结构的可视化,而第三方库如`spacy-displacy-ent`可以增强实体识别的可视化展示。这为SpaCy在不同场景下的应用提供了灵活性和扩展性。

# 2. SpaCy的基础知识与文本处理

## 2.1 SpaCy文本处理入门

### 2.1.1 SpaCy的安装和导入

SpaCy是一个高级自然语言处理库,它提供了简单的接口来处理各种自然语言处理任务。首先,我们需要安装SpaCy包及其预训练的语言模型。在Python环境中,可以通过以下命令安装:

```bash

pip install spacy

python -m spacy download en_core_web_sm

```

安装完成后,导入SpaCy及其语言模型如下所示:

```python

import spacy

# 加载预训练的小型英文模型

nlp = spacy.load("en_core_web_sm")

```

上述代码中,`spacy.load`函数用于加载预训练的语言模型。在这个例子中,我们加载的是`en_core_web_sm`,它是针对英语的模型。SpaCy支持多种语言和模型,可以根据需要选择合适的模型。

### 2.1.2 文本的加载和基本处理

一旦SpaCy库和模型被正确导入,文本处理就变得非常简单。首先,我们创建一个文本字符串,然后使用`nlp`对象进行处理:

```python

# 创建一个文本字符串

text = "Apple is looking at buying a U.K. startup for $1 billion."

# 使用nlp对象处理文本

doc = nlp(text)

```

上述代码创建了一个名为`doc`的文档对象,该对象包含了有关文本的丰富信息,包括分词、词性标注、实体识别等。接下来,我们可以遍历这个文档,提取文本中的单词、标点符号以及它们的属性:

```python

# 遍历文档中的每个令牌(Token)

for token in doc:

print(f"Token: {token.text}, Lemma: {token.lemma_}, POS: {token.pos_}, Dependency: {token.dep_}")

```

这段代码将输出文本中每个单词的文本、词干、词性以及它们的依存关系。SpaCy将帮助我们处理常见的文本处理任务,如分词、词性标注和依存解析,这些是任何文本分析任务的基础。

## 2.2 SpaCy中的自然语言处理

### 2.2.1 分词和词性标注

分词(Tokenization)是将文本分割成单个的词汇单位,而词性标注(Part-of-Speech Tagging)则是识别每个词汇的词性(如名词、动词等)。在SpaCy中,这些任务可以通过上述创建的`doc`对象轻松完成。

```python

# 获取词性标注的完整列表

pos_tags = [(token.text, token.pos_) for token in doc]

print(pos_tags)

```

这段代码生成一个包含每个令牌及其对应词性的元组列表。词性标记是基于一个特定的标记集,对于英文,SpaCy使用的是`Universal POS Tags`。掌握这些基本的NLP任务对于后续的高级分析至关重要。

### 2.2.2 实体识别与依存解析

实体识别(Named Entity Recognition,NER)是识别文本中具有特定意义的实体(如人名、地点、组织等)的过程。依存解析(Dependency Parsing)则是分析单词之间的依存关系,揭示句子的结构。

```python

# 打印文档中的实体

print([(ent.text, ent.label_) for ent in doc.ents])

# 打印文档的依存关系树

from spacy import displacy

displacy.render(doc, style="dep", jupyter=True)

```

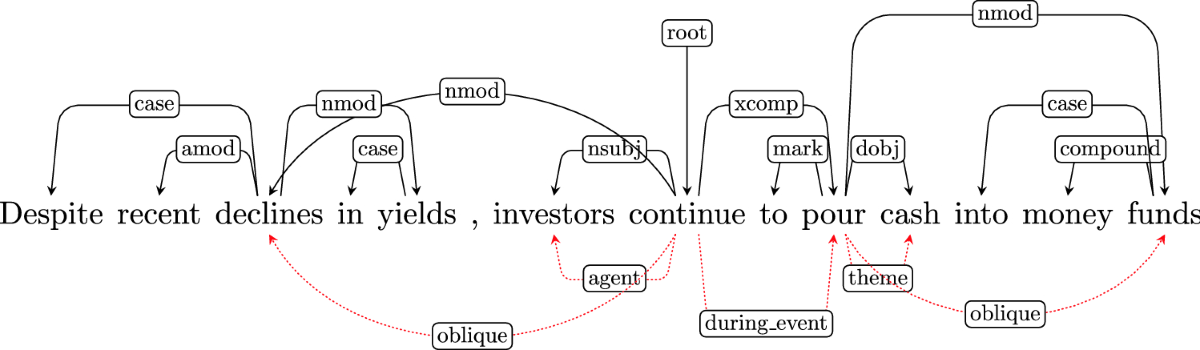

第一个代码块识别并打印了文档中的实体及其类型。第二个代码块使用了SpaCy的`displacy`模块来绘制文档的依存关系树,以便我们可以直观地理解句子的结构。

## 2.3 SpaCy的可视化概念

### 2.3.1 可视化的目的和重要性

文本数据虽然包含大量信息,但通常不易于直接分析。可视化文本数据有助于简化复杂信息,使得人们能够更容易地识别模式和趋势。在自然语言处理中,可视化能够帮助我们更好地理解语言结构、实体关系以及情感倾向等。

例如,使用词云可以快速识别文本中的关键词;依存解析图能够揭示句子的语法结构。SpaCy提供了多种可视化工具,适用于不同的分析需求,无论是在研究还是产品开发中都有其独特的价值。

### 2.3.2 SpaCy可视化工具种类和选择

SpaCy本身提供了简单的可视化功能,但也有其他优秀的可视化库可以和SpaCy配合使用。SpaCy的`displacy`是一个非常实用的可视化工具,它可以展示实体识别结果和依存关系图。对于更复杂的数据可视化需求,我们可以借助如matplotlib、seaborn或plotly等第三方库。

选择合适的可视化工具取决于我们想要传达的信息类型和目标受众。例如,`displacy`适合在报告中快速插入漂亮的视觉元素;而matplotlib和seaborn等库则更加灵活,能够创建高度定制化的图形。

在下一章,我们将深入探讨如何将这些可视化技术应用于实际的文本分析任务中,从生成词云到创建复杂的依存解析图。我们将看到代码如何被转化为直观的视觉表示,以及如何利用这些工具进行实际的数据探索和解释。

# 3. SpaCy可视化工具的实践应用

SpaCy可视化工具的实践应用是将自然语言处理(NLP)的抽象操作具象化的过程,它将文本数据转化为直观的图形表示,以便我们更容易理解文本的结构和内容。本章将详细介绍如何使用SpaCy的可视化功能来展示和分析文本数据。

## 3.1 文本数据的可视化展示

在文本分析中,可视化可以揭示数据中不易察觉的模式和关联。我们将探讨如何生成词云以及如何以图形化方式表现句子结构。

### 3.1.1 词云的生成与分析

词云是一种直观的文本分析可视化技术,它通过单词的大小来表示其在文档中的频率和重要性。在SpaCy中,虽然没有内置的词云生成工具,但我们可以通过结合Python的`wordcloud`库来实现。

```python

from wordcloud import WordCloud

import matplotlib.pyplot as plt

import spacy

# 加载SpaCy的英文模型

nlp = spacy.load('en_core_web_sm')

# 处理文本

doc = nlp(u"SpaCy is a free, open-source library for advanced Natural Language Processing in Python.")

words = [token.text for token in doc if not token.is_stop and not token.is_punct]

# 生成词云

wordcloud = WordCloud(width=800, height=400, background_color='white').generate(' '.join(words))

# 展示词云

plt.figure(figsize=(10, 5))

plt.imshow(wordcloud, interpolation='bilinear')

plt.axis('off')

plt.show()

```

此代码块首先导入必要的库,然后加载SpaCy模型并处理给定的文本。接着,它从处理的文本中筛选出非停用词和非标点符号的词汇,并生成词云。最后,展示出词云图形。通过词云,我们可以快速地识别出文本中最重要的词汇。

### 3.1.2 句子结构的图形化表现

除了词云,可视化句子的结构也十分重要。SpaCy提供了一种方式可以让我们以图形化方式表示句子的依存关系。

```python

import spacy

from spacy import displacy

# 加载SpaCy的英文模型

nlp = spacy.load('en_core_web_sm')

# 处理文本

doc = nlp(u"SpaCy is a free, open-source library for advanced Natural Language Processing in Python.")

# 使用displacy库来展示句子结构

displacy.render(doc, style='dep', jupyter=True, options={'distance': 120})

```

执行上述代码后,SpaCy的`displacy`库会在Jupyter Notebook中以图形化方式展示句子中单词间的依存关系。每个单词和词性标记,以及它们之间的关系,都被清晰地描绘出来。

## 3.2 实体和关系的图形化分析

文本分析的核心之一就是识别和理解文本中的实体以及它们之间的关系。SpaCy可视化工具可以帮助我们以图形化方式分析这些信息。

### 3.2.1 实体间关系的视觉图谱

在文本分析中,理解实体间关系是至关重要的。SpaCy允许我们识别文本中的实体,并可视化它们之间的关系。

```python

import spacy

from spacy import displacy

# 加载SpaCy的英文模型

nlp = spacy.load('en_core_web_sm')

# 处理文本

doc = nlp(u"Apple is looking at buying a U.K. startup for $1 billion")

# 使用displacy库来展示实体间的视觉图谱

displacy.render(doc, style='ent', jupyter=True)

```

执行

0

0