MapReduce Shuffle过程深度剖析:数据排序与聚合,效率优化之道

发布时间: 2024-10-26 05:36:16 阅读量: 32 订阅数: 50

大数据处理优化:Spark与Hadoop的深度应用与性能调优

# 1. MapReduce Shuffle过程解析

## 1.1 Shuffle过程概述

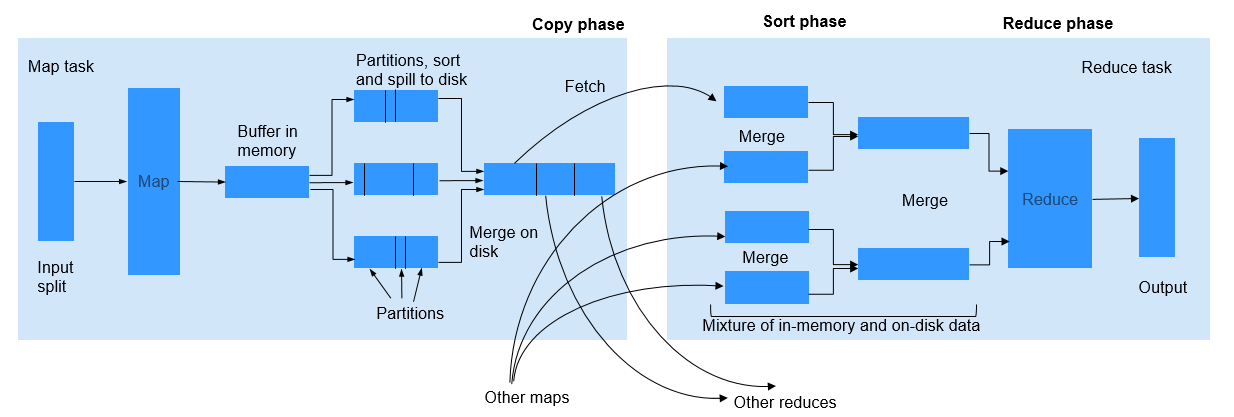

MapReduce是一种分布式计算框架,广泛应用于大规模数据处理中。Shuffle是MapReduce中一个核心环节,负责将Map任务输出的数据有效地分发给Reduce任务。Shuffle过程的效率直接影响到整个MapReduce作业的执行速度。理解Shuffle的每个步骤,对于优化大数据处理的性能至关重要。

## 1.2 Shuffle的步骤

Shuffle过程主要分为几个步骤:

1. **Map端输出**:Map任务处理输入的数据,输出键值对。

2. **分区**:根据键值对的键值,使用Partitioner确定每个键值对属于哪个Reducer处理。

3. **排序**:每个Map节点上对本地数据按Reducer的分区进行排序,保证相同键值的数据被送往同一Reducer。

4. **合并与溢写**:对内存中的数据进行合并、溢写到磁盘,以减少网络传输的数据量。

5. **复制**:将数据通过网络传输到对应Reducer节点的本地磁盘。

6. **合并与排序**:Reduce任务启动时,从各个Map节点的磁盘复制数据,进行合并、排序操作。

7. **输出**:最终数据被输入到Reduce函数,进行进一步的处理。

## 1.3 Shuffle的优化意义

优化Shuffle过程可以减少不必要的网络I/O和磁盘I/O,提高整体数据处理速度。通过理解Shuffle的每个步骤,开发者可以识别性能瓶颈并进行针对性优化。下一章将深入探讨Shuffle的数据排序机制,这是影响Shuffle性能的关键因素之一。

# 2. MapReduce Shuffle的数据排序机制

## 2.1 排序原理与方法

### 2.1.1 排序的重要性与基本原理

排序是数据处理中不可或缺的一个环节,它能够帮助我们在大量数据中快速查找、分析和理解信息。在MapReduce框架中,排序尤为重要,它保证了数据以有序的形式从Map端传送到Reduce端,确保了数据处理的准确性和效率。

排序的基本原理是将数据集中的元素与一个排序函数进行比较,然后按照排序函数定义的顺序来重新排列这些元素。对于MapReduce而言,排序主要发生在Shuffle阶段,分为两个部分:Map端的局部排序和Reduce端的全局排序。

在Map端,排序通常是在内存中进行的,Map任务完成后,输出的数据会根据key进行局部排序,然后写入到磁盘。在Reduce端,排序是全局性的,所有来自Map端的数据会根据key进行合并排序,然后才输入到Reduce函数中进行处理。

### 2.1.2 Map端和Reduce端的排序过程

Map端的排序过程如下:

1. Map任务处理输入数据,对数据集中的每个记录进行处理。

2. 根据key进行分区(Partitioning),将具有相同key的记录分配到同一个分区。

3. 在内存中创建一个或多个环形缓冲区(Buffer),对每个分区的数据进行排序。

4. 排序完成的数据被写入磁盘,作为Map任务的输出。

Reduce端的排序过程如下:

1. Shuffle过程中,所有Map任务的输出数据被传输到Reduce端。

2. Reduce任务开始从每个Map任务拉取排序后的数据。

3. 拉取到的数据被写入内存中的缓冲区,同时进行合并排序。

4. 当所有的数据都拉取完毕,排序完成,可以将数据分批次输入到Reduce函数中处理。

## 2.2 排序的实现技术

### 2.2.1 Map端的排序技术细节

Map端的排序技术主要依赖于两个核心组件:Partitioner和排序算法。Partitioner负责将Map的输出分配到不同的Reduce任务,而排序算法则确保每个分区内部的数据是有序的。

```java

// Java代码示例:Map端的排序逻辑(伪代码)

public void map(LongWritable key, Text value, OutputCollector< Text, IntWritable > output, Reporter reporter) throws IOException {

// key: LongWritable (偏移量)

// value: Text (行文本)

// 处理输入数据,创建中间key-value对

...

// 调用Partitioner进行分区操作

int partition = partitioner.getPartition(key, value, numPartitions);

// 写入环形缓冲区,根据key进行排序

...

}

```

### 2.2.2 Reduce端的排序技术细节

Reduce端的排序涉及到合并多个Map任务输出的数据流。由于Map的输出是有序的,因此Reduce端可以采用多路归并排序的方式。

```java

// Java代码示例:Reduce端的归并排序(伪代码)

public void reduce(Text key, Iterable< IntWritable > values, OutputCollector< Text, IntWritable > output, Reporter reporter) throws IOException {

// key: Text (排序后的key)

// values: Iterable<IntWritable> (排序后的值列表)

// 对拉取到的每个Map任务的数据进行归并排序

...

// 对排序后的数据进行分组处理

...

}

```

## 2.3 排序优化策略

### 2.3.1 减少排序阶段的内存消耗

排序阶段消耗的内存主要取决于环形缓冲区的大小和Map任务的输出数据量。为了优化内存使用,我们可以采取以下策略:

1. 调整环形缓冲区大小,避免内存溢出。

2. 对于排序后的数据,根

0

0