【Python特征选择实战】:掌握方法与应用,提升机器学习效果

发布时间: 2024-08-31 07:29:32 阅读量: 112 订阅数: 35

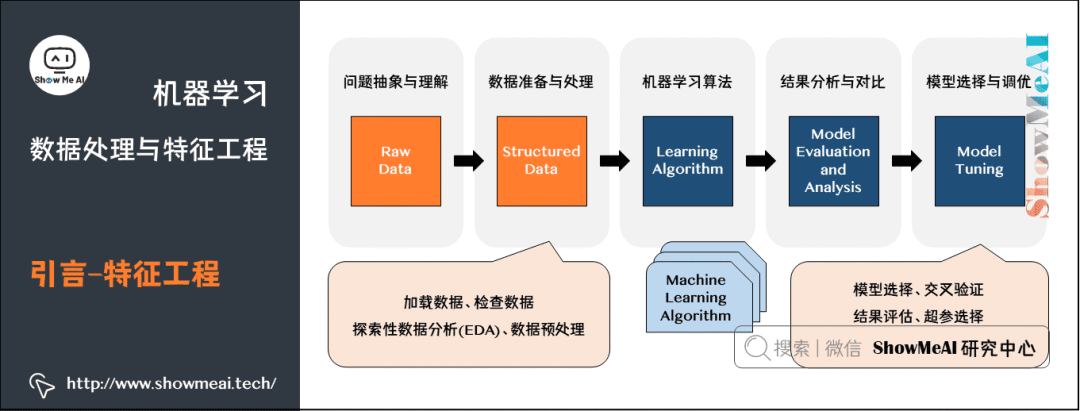

# 1. 特征选择的基本概念和重要性

在数据挖掘和机器学习中,数据预处理是构建预测模型的关键步骤之一。特征选择作为数据预处理的一个重要环节,直接关系到模型的性能和结果的可解释性。特征选择的目标是从原始特征集中挑选出最有利于模型训练和预测的特征子集。这不仅能减少数据维度,提高模型的计算效率,还能有效避免过拟合,提升模型的泛化能力。此外,优秀的特征选择策略有助于提高数据的可理解性,这对于业务决策和模型解释尤为关键。因此,理解和掌握特征选择的基本概念及其重要性是每个数据科学工作者必须具备的能力。接下来的章节,我们将深入探讨特征选择在Python中的理论和实践,以及如何应用各种方法和技巧优化特征选择的过程。

# 2. Python中的特征选择理论

## 2.1 特征选择的目标和方法

### 2.1.1 特征选择的定义和目标

特征选择是机器学习和数据挖掘领域的一个关键步骤,指的是从原始特征集合中选择一个子集,该子集可以尽可能保持原有数据集的特征信息,同时去除冗余或不相关特征的过程。正确的特征选择能够有效减少模型复杂度、防止过拟合,并提高模型的泛化能力。

特征选择的目标可以归纳为以下几点:

- **去除冗余信息**:消除数据中的不必要特征,这些特征可能包含噪声或无用信息。

- **提升模型性能**:通过减少特征数量,提高模型训练速度,并可能避免过拟合。

- **增强模型解释性**:精简后的特征集更容易解释,帮助理解模型的决策过程。

- **降低计算成本**:减少特征数量可以减少模型训练和预测所需的计算资源。

### 2.1.2 特征选择的主要方法分类

特征选择方法可以分为以下三类:

- **过滤方法**:依据统计测试对特征进行排序,选择排序较高的特征。这种方法速度快,独立于模型,但可能不会找到最优的特征子集。

- **包装方法**:基于模型对特征子集进行评分,通过优化算法来选择特征。这种方法能直接优化最终模型的性能,但计算成本高。

- **降维方法**:通过转换数据到一个较低维度空间来减少特征数量。这些方法专注于特征之间的线性或非线性组合,适用于高维数据集。

## 2.2 特征选择的评价指标

### 2.2.1 基于模型的评价指标

基于模型的评价指标通常用于包装方法的特征选择,其核心思想是使用特定的机器学习模型来评估特征子集的性能。常用的评价指标包括:

- **模型准确率**:利用模型在验证集上的准确率作为特征选择的评价标准。

- **交叉验证分数**:通过交叉验证(如k-fold交叉验证)得到模型的平均表现。

- **模型复杂度**:考虑模型的复杂度,以防止过拟合为目标选择特征。

### 2.2.2 基于信息的评价指标

基于信息的评价指标侧重于衡量特征与目标变量之间的信息量,常用的包括:

- **互信息**(Mutual Information):测量特征和目标变量之间共享的信息量。

- **卡方检验**(Chi-Squared Test):基于特征和目标变量独立性假设的统计检验。

- **信息增益**(Information Gain):特征对于预测目标变量的贡献程度。

### 2.2.3 基于距离的评价指标

基于距离的评价指标利用距离度量来衡量样本间的相似性,如:

- **欧氏距离**(Euclidean Distance):计算两个点在多维空间中的直线距离。

- **曼哈顿距离**(Manhattan Distance):计算两个点在标准坐标系上的绝对轴距总和。

## 2.3 特征选择的流程和实践

### 2.3.1 特征选择的典型流程

典型特征选择流程包含以下几个步骤:

- **数据预处理**:包括数据清洗、数据标准化或归一化等。

- **特征评估**:使用上述提到的评价指标来评估特征的重要性。

- **特征排序**:根据评估结果对特征进行排序。

- **特征选择**:根据排序结果和模型需求选择特征子集。

- **模型训练**:使用选定的特征子集训练模型。

- **模型评估**:验证模型的性能来反馈特征选择的有效性。

### 2.3.2 特征选择在Python中的实践

在Python中,我们可以使用`scikit-learn`等库来实践特征选择。下面是一个使用`SelectKBest`类实现的特征选择的示例代码:

```python

from sklearn.feature_selection import SelectKBest, f_classif

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

# 加载数据集

iris = load_iris()

X, y = iris.data, iris.target

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3)

# 使用SelectKBest进行特征选择

selector = SelectKBest(f_classif, k=2)

X_train_selected = selector.fit_transform(X_train, y_train)

X_test_selected = selector.transform(X_test)

# 训练模型并评估

model = RandomForestClassifier()

model.fit(X_train_selected, y_train)

print("模型在测试集上的准确率:", model.score(X_test_selected, y_test))

```

在这个例子中,我们使用了`SelectKBest`类来选择最重要的两个特征,然后使用随机森林模型来评估特征选择的效果。通过比较模型在原始数据集和特征选择后数据集上的表现,我们可以了解特征选择的有效性。

以上就是Python中特征选择的理论基础,以及如何在Python中进行实践。接下来的章节将深入探讨不同特征选择算法的实现方法及其在Python中的应用。

# 3. 特征选择的算法实现与比较

## 3.1 基于过滤方法的特征选择

过滤方法基于数据的统计属性来选择特征,这些方法独立于任何特定的机器学习算法。它们的目的是以一种快速而有效的方式对特征进行初步排序,并去除明显不相关的特征。

### 3.1.1 单变量特征选择方法

单变量特征选择,又称为单变量统计测试,是过滤方法中最简单、最快的一种。它通过单个特征的统计检验来选择特征,常用方法包括卡方检验、ANOVA、互信息和最大信息系数(MIC)。

#### 卡方检验

卡方检验是一种用于分类数据的方法,用于确定两个分类变量之间是否有统计学上的显著性关联。在特征选择中,它通常用来判断一个分类特征和目标变量之间的关系强度。

```python

from sklearn.feature_selection import SelectKBest, chi2

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

# 加载iris数据集

iris = load_iris()

X, y = iris.data, iris.target

# 选择2个最佳特征

select_k_best = SelectKBest(chi2, k=2)

X_new = select_k_best.fit_transform(X, y)

# 输出被选中的特征索引

print(select_k_best.get_support(indices=True))

```

上述代码中,`SelectKBest`类将保留与目标变量相关性最高的k个特征,此处为2。`chi2`则是卡方检验函数。执行完毕后,会输出被选中的特征索引。

#### 最大信息系数(MIC)

最大信息系数(MIC)是衡量两个变量之间依赖程度的方法,它能够检测出非线性关系,并且其值的范围是[0,1],接近1表示两个变量之间存在强烈的依赖关系。

```python

from minepy import MINE

# 假设X为特征矩阵,y为目标变量

mic = MINE()

***pute_score(X[:, 0], y) # 只对第一个特征进行计算

print(mic.mic())

```

在这个例子中,我们使用了`minepy`库中的MINE类来计算第一个特征与目标变量之间的MIC值。

### 3.1.2 相关性特征选择方法

相关性特征选择方法基于特征和目标变量之间的相关性。相关系数越高,表示特征与目标变量之间的线性关系越强。

#### 皮尔逊相关系数

皮尔逊相关系数(Pearson correlation coefficient)是度量两个变量X和Y之间线性相关程度的方法。取值范围在-1到1之间,1表示完全正相关,-1表示完全负相关。

```python

import numpy as np

from scipy.stats import pearsonr

# 假设X为特征矩阵中的某一特征,y为目标变量

correlation, _ = pearsonr(X[:, 0], y)

print(correlation)

```

上述代码使用`pearsonr`函数计算了特征矩阵中第一个特征与目标变量之间的皮尔逊相关系数。

#### 斯皮尔曼等级相关系数

斯皮尔曼等级相关系数(Spearman's rank correlation coefficient)是评估两个变量的依赖性强度的方法。它不需要两个变量是线性关系,也不需要两个变量的分布是正态的。

```python

from s

```

0

0