大数据处理技术:从Hadoop到Spark,掌握大数据处理实战

发布时间: 2024-08-05 02:10:56 阅读量: 8 订阅数: 20

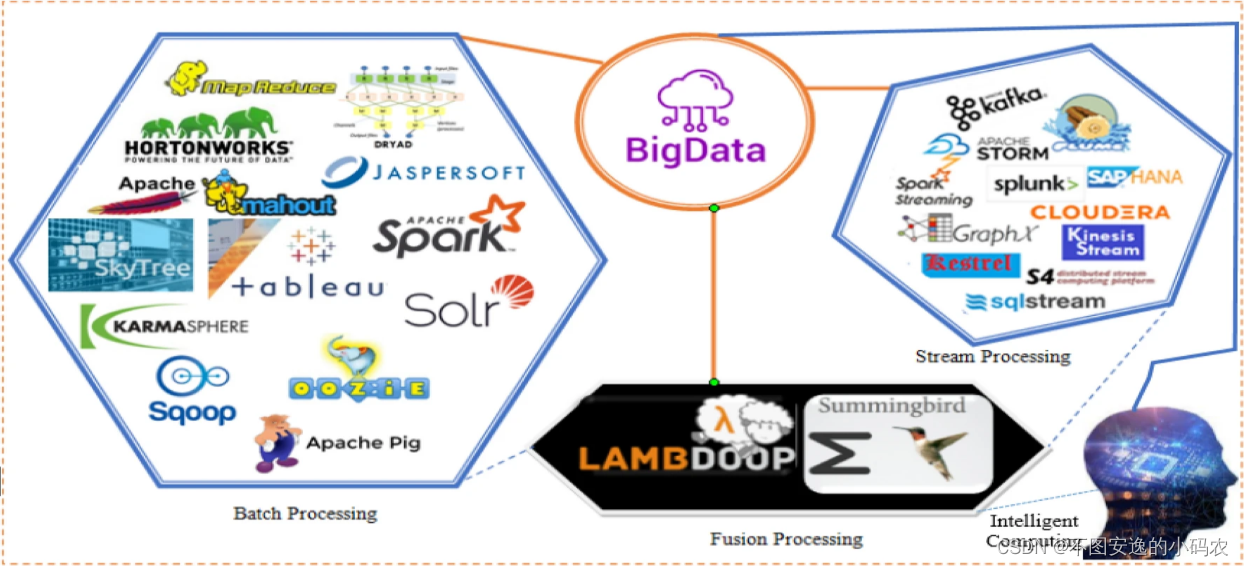

# 1. 大数据处理概述**

大数据处理是指处理和分析超出传统数据库和软件工具处理能力的海量、复杂和快速增长的数据集。大数据通常以“4V”特征为特征:

- **Volume(容量)**:数据量巨大,从 TB 到 PB 甚至 EB。

- **Variety(多样性)**:数据类型多样,包括结构化、半结构化和非结构化数据。

- **Velocity(速度)**:数据生成和处理速度快,需要实时或近实时处理。

- **Veracity(真实性)**:数据质量和准确性至关重要,需要数据清洗和验证。

大数据处理的目标是从这些海量数据中提取有价值的见解,以支持决策制定、优化运营和创造新的商业机会。

# 2. Hadoop生态系统

Hadoop生态系统是一个由一系列开源组件组成的软件框架,用于处理和存储大规模数据集。它提供了分布式文件系统、数据处理引擎和各种工具,使组织能够有效地管理和分析海量数据。

### 2.1 Hadoop分布式文件系统(HDFS)

#### 2.1.1 HDFS架构和原理

HDFS是一种分布式文件系统,旨在存储和管理大数据集。它采用主从架构,其中NameNode充当中心服务器,管理文件系统元数据(例如文件位置和块信息),而DataNode充当存储服务器,存储实际数据块。

HDFS将数据分解成较小的块(通常为128MB),并将其存储在多个DataNode上。这提供了数据冗余,如果一个DataNode发生故障,数据仍可从其他DataNode访问。

#### 2.1.2 HDFS数据块管理和容错机制

HDFS使用块管理机制来有效管理数据块。它将文件分成大小相等的块,并使用校验和机制来确保数据的完整性。

HDFS还提供了容错机制,可以自动检测和恢复数据块损坏。当DataNode发生故障时,NameNode会将损坏的块复制到其他DataNode上,从而保持数据的冗余。

### 2.2 MapReduce编程模型

#### 2.2.1 MapReduce作业流程和原理

MapReduce是一种编程模型,用于处理大数据集。它将数据处理任务分解为两个阶段:

* **Map阶段:**将输入数据集映射到中间键值对。

* **Reduce阶段:**将具有相同键的中间键值对聚合在一起。

MapReduce作业在分布式集群上运行,其中每个节点负责处理数据集的一部分。这允许并行处理,从而显着提高性能。

#### 2.2.2 MapReduce作业配置和优化

MapReduce作业可以通过配置各种参数进行优化,例如:

* **Map任务数:**指定Map阶段中使用的任务数。

* **Reduce任务数:**指定Reduce阶段中使用的任务数。

* **输入分片大小:**指定输入数据集的分片大小。

* **输出分片大小:**指定输出数据集的分片大小。

通过调整这些参数,可以优化作业性能,以满足特定数据集和处理要求。

### 2.3 Hadoop生态系统中的其他组件

#### 2.3.1 Hive:数据仓库工具

Hive是一个数据仓库工具,用于在HDFS上存储和查询结构化数据。它提供类似于SQL的查询语言,允许用户轻松地从大数据集提取信息。

#### 2.3.2 HBase:NoSQL数据库

HBase是一个NoSQL数据库,用于存储和管理大规模非结构化数据。它提供了一个键值存储模型,允许快速访问和处理数据。

# 3. Spark大数据处理框架

### 3.1 Spark架构和优势

#### 3.1.1 Spark内存计算模型

Spark采用内存计算模型,将数据加载到内存中进行处理,显著提高了处理速度。这种模型与传统的基于磁盘的处理方式不同,后者需要频繁地将数据从磁盘读入内存,导致性能低下。

#### 3.1.2 Spark弹性分布式数据集(RDD)

RDD(Resilient Distributed Dataset)是Spark的核心数据结构,它表示一个分布在集群中的一组不可变数据元素。RDD具有弹性特性,这意味着它可以自动恢复从故障中丢失的数据分区。

### 3.2 Spark核心API

#### 3.2.1 Spark SQL:结构化数据处理

Spark SQL是一个用于处理结构化数据的模块。它提供了SQL查询语言和数据帧API,允许用户以类似于SQL的方式查询和操作数据。

#### 3.2.2 Spark Streaming:实时数据处理

Spark Streaming是用于处理实时数据流的模块。它提供了连续处理数据流的机制,并支持多种数据源和输出格式。

### 3.3 Spark生态系统中的其他

0

0