【优化之路】:C++标准库sort算法时间复杂度优化的探索之旅

发布时间: 2024-10-19 14:49:20 阅读量: 34 订阅数: 30

# 1. C++标准库sort算法概述

C++语言中,排序是一项基础而重要的操作,标准库提供的sort函数是实现排序的最主要工具之一。本章将概述sort算法的基本用法,并介绍其在C++标准库中的重要地位。我们将从sort的调用方式开始,逐步深入到如何理解和应用这个功能强大的工具。

## 1.1 标准库sort函数的基本用法

sort函数在C++标准库的<algorithm>头文件中定义,其基本用法如下:

```cpp

#include <algorithm>

#include <vector>

int main() {

std::vector<int> vec = {3, 1, 4, 1, 5, 9};

std::sort(vec.begin(), vec.end());

// vec现在是{1, 1, 3, 4, 5, 9}

}

```

这里,`vec.begin()`和`vec.end()`分别定义了对vector中的元素进行排序的范围。默认情况下,sort函数使用`std::less<>()`作为比较函数,它按照升序对元素进行排序。

## 1.2 sort函数的灵活性

标准库的sort算法不仅能够处理简单的数据类型,还可以通过重载比较函数来处理复杂的排序逻辑。例如,如果你想根据对象的特定属性来排序,可以通过传递自定义比较器来实现。

```cpp

struct Person {

std::string name;

int age;

};

bool compareByAge(const Person& a, const Person& b) {

return a.age < b.age;

}

std::vector<Person> people = {{ "Alice", 30 }, { "Bob", 25 }, { "Charlie", 35 }};

std::sort(people.begin(), people.end(), compareByAge);

```

在这个例子中,`std::sort`使用了`compareByAge`函数来按照人的年龄进行升序排序。

## 1.3 标准库sort的效率

sort函数是经过高度优化的,通常情况下,其内部实现依赖于快速排序算法,它平均时间复杂度为O(n log n)。然而,当数据量非常大或有特殊需求时,你可能需要考虑更高级的排序技术,如部分排序或并行排序,这将在后续章节中进行探讨。

通过本章的学习,您应该能够熟练使用sort函数对数据进行基本排序,并对其灵活性和性能有一个初步的理解。接下来,我们将深入探讨sort算法的内部原理,以及如何进一步优化排序操作。

# 2. 深入理解sort算法的原理

### 2.1 排序算法基础

#### 2.1.1 排序算法的基本概念

排序算法是计算机科学中一个非常基础且重要的算法领域。在程序设计中,排序是将一组数据按照一定的顺序排列成特定的顺序,常见的顺序有升序和降序。为了实现排序,需要通过一系列的比较和交换操作,将数据调整到我们期望的位置。排序算法的效率直接影响了程序的性能,特别是当处理大量数据时,一个高效的排序算法可以大幅提高程序的运行效率和响应速度。

在数据处理、数据库查询优化以及算法竞赛中,排序算法都是关键的操作。对开发者来说,了解不同排序算法的特点和适用场景,能够帮助选择最合适的排序方法,以达到事半功倍的效果。

#### 2.1.2 常见排序算法对比

在众多排序算法中,按照不同的标准可以分为不同的类别。按照是否需要比较元素,可以分为比较排序和非比较排序。按照操作方式,可以分为交换排序、选择排序和插入排序等。以下是一些常见排序算法的对比分析:

- **冒泡排序**:通过重复遍历待排序的数组,比较相邻元素并交换顺序错误的元素,直到没有需要交换的元素为止。尽管冒泡排序简单易实现,但其时间复杂度较高(平均为O(n^2)),不适用于大规模数据排序。

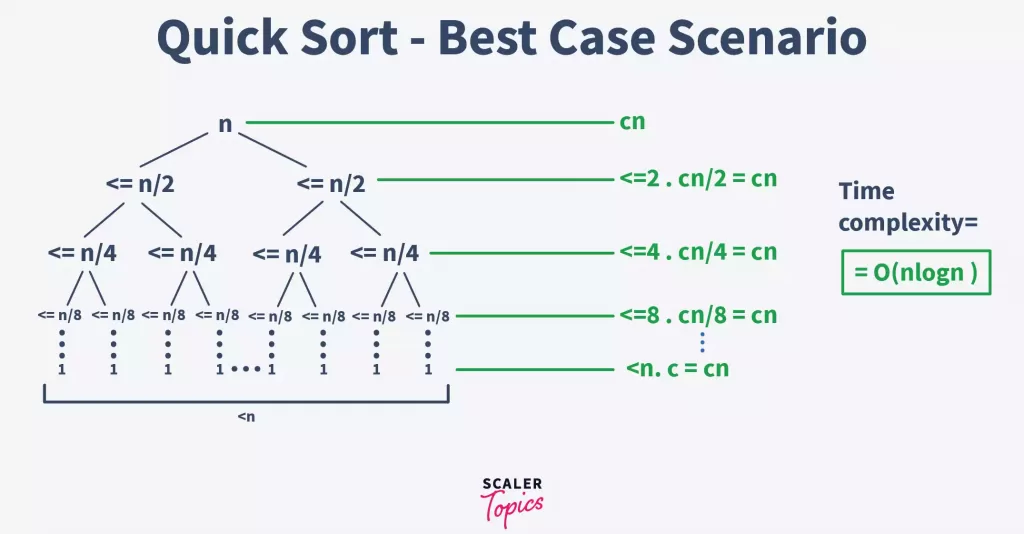

- **快速排序**:通过一个分区操作将数据分为两个部分,使得一部分的所有元素都比另一部分的所有元素小,然后再递归地对这两部分数据分别进行快速排序。快速排序的平均时间复杂度为O(n log n),但是当数据分布不均时,其性能可能退化到O(n^2)。

- **归并排序**:采用分治法的一个典型应用,它将数组分成两部分,分别对这两部分递归排序,然后将排序好的两部分合并。归并排序在任何情况下都有稳定的时间复杂度O(n log n),但需要额外的空间来存储临时数组。

- **堆排序**:将数组组织成一个最大堆或最小堆,在每个元素被移除时,都能保持堆的特性。堆排序的时间复杂度同样是O(n log n),并且是原地排序算法。

- **计数排序、桶排序和基数排序**:这类排序算法不基于比较,而是利用数据的特性进行排序。它们的时间复杂度可以达到O(n),但是空间复杂度较高,且存在一些适用场景的限制。

### 2.2 标准库sort函数的内部机制

#### 2.2.1 sort函数的工作原理

C++标准模板库(STL)中的`sort`函数是快速排序的实现,它提供了灵活的接口,可以适应不同的需求。在最简单的形式下,`sort`接受两个迭代器参数,分别指向容器的开始和结束位置,它会将指定范围内的元素按照升序进行排序。

对于随机访问迭代器(例如`std::vector`和`std::deque`的迭代器),`sort`函数使用三路分割的快速排序算法。这种算法首先选择一个"枢轴"(pivot),然后将小于枢轴的元素放在前面,大于枢轴的元素放在后面,最后递归地对枢轴两边的子序列进行排序。

对于不支持随机访问的迭代器(如`std::list`),则使用链表的特殊排序算法,例如归并排序。这种特殊处理确保了对所有容器类型都能提供高效的排序方法。

#### 2.2.2 标准库sort的时间复杂度分析

`sort`函数在平均情况下的时间复杂度为O(n log n),这是由于其基于快速排序算法。然而,在某些特定情况下,如所有元素都相同或者数据已经基本有序时,快速排序的性能会退化到O(n^2)。

为了克服快速排序的最坏情况性能,C++标准库中`sort`的实现可能还包含了一些优化措施。比如使用尾递归优化技术,减少递归调用栈的深度。另外,在分治递归过程中会通过小数组优化、多路分割等方法避免递归调用的开销。

### 2.3 排序算法的时间复杂度理论

#### 2.3.1 时间复杂度的概念和重要性

时间复杂度是衡量算法运行时间随输入数据量增长的变化趋势的一种表达方式。它是算法性能的理论评估,帮助我们预测算法在面对不同大小的数据集时的表现。

时间复杂度通常用大O符号(如O(n), O(n^2), O(log n))来表示。其中n表示输入数据的大小,大O符号后面的部分表示算法性能与数据量增长关系的上界。理解时间复杂度能够帮助我们选择合适的算法来解决实际问题,尤其是在处理大规模数据时能显著提升效率。

#### 2.3.2 不同复杂度排序算法的分类和比较

根据时间复杂度的不同,我们可以将排序算法分为几个不同的类别:

- **O(n^2)算法**:例如冒泡排序、插入排序和选择排序。这类算法实现简单,适用于小规模数据,但在处理大量数据时效率较低。

- **O(n log n)算法**:例如快速排序、归并排序和堆排序。这些算法在大多数情况下表现较好,是实际应用中常用的选择,尤其是在数据量较大时。

- **O(n)算法**:例如计数排序、桶排序和基数排序。这些算法在某些特定条件下非常高效,但需要额外的空间,并且只适用于数据范围较小且集中的情况。

在选择合适的排序算法时,需要考虑到数据的规模、数据的分布特性、是否对原数据有特定要求(是否需要稳定排序)以及对算法的时间和空间复杂度的容忍度。

在本章中,我们深入了解了排序算法的基础知识,包括其基本概念和常见排序算法的对比。随后,我们探讨了C++标准库中`sort`函数的内部工作原理,并对其时间复杂度进行了分析。了解这些底层原理将有助于我们更有效地使用排序算法,并为后续章节中探讨的优化策略提供理论基础。

# 3. sort算法优化实践

随着软件系统的复杂性增长,对C++标准库sort算法的优化实践变得尤为关键。本章将探讨在不同应用场景下,如何通过各种技巧和高级特性提升sort算法的性能。

## 3.1 标准库sort的使用技巧

### 3.1.1 自定义比较函数

在C++中,sort函数允许我们传递一个自定义的比较函数或lambda表达式,以适应各种排序需求。自定义比较函数可以改变排序的规则,比如按元素的某个属性进行排序。通过这种方式,我们可以更精确地控制排序过程,有时还能获得性能上的提升。

```cpp

#include <algorithm>

#include <vector>

#include <iostream>

struct Person {

std::string name;

int age;

};

// 自定义比较函数

bool compareAge(const Person &a, const Person &b) {

return a.age < b.age;

}

i

```

0

0