【神经网络正则化】:防止过拟合,优化模型泛化能力

发布时间: 2024-09-06 01:29:25 阅读量: 81 订阅数: 47

tensorflow使用L2 regularization正则化修正overfitting过拟合方式

# 1. 神经网络正则化的基础概念

在机器学习和深度学习领域,模型的泛化能力是衡量一个模型是否优秀的标准之一。而神经网络正则化,作为一种提高模型泛化能力的技术,是每个从业者都需要掌握的基础概念。

正则化,简单来说,就是在模型的损失函数中添加一个额外的项,这个项通常与模型的复杂度有关,其目的是防止模型在训练数据上过拟合,从而提高模型在未知数据上的表现。

在接下来的章节中,我们将详细探讨正则化的理论框架,实践应用,以及高级应用与案例分析,帮助你更深入地理解和掌握正则化技术。

# 2. 正则化技术的理论框架

## 2.1 正则化的目的与重要性

正则化是机器学习和深度学习中的一种技术,用于防止模型过拟合,并增强模型在新数据上的泛化能力。在训练过程中,正则化通过在损失函数中添加一个额外的项来实现,这个额外的项通常与模型参数的复杂度有关。它的引入有助于引导模型学习到更加平滑的决策边界,避免对训练数据中的噪声和异常值过于敏感。

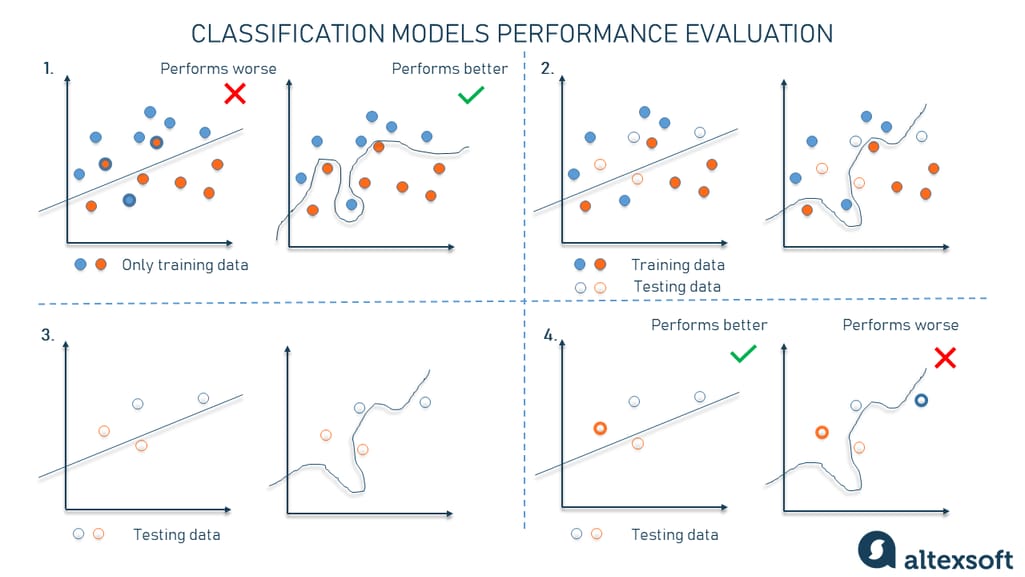

### 2.1.1 过拟合与模型泛化的定义

过拟合现象是指模型在训练数据上表现非常好,但在未见过的测试数据上表现不佳。这种现象通常发生在模型过于复杂,以至于捕获了训练数据中的噪声而非真正的信号。过拟合的主要原因是模型的复杂度超过了数据本身的复杂度,导致模型学习到的是训练数据的特性而非潜在的分布规律。

在深度学习中,模型泛化能力是指模型对未知数据进行准确预测的能力。理想情况下,我们希望构建的模型既能很好地拟合训练数据,也能保持良好的泛化性能。而正则化技术正是实现这一目标的关键工具之一。

### 2.1.2 正则化在防止过拟合中的作用

正则化通过惩罚模型复杂度来减少过拟合的风险。在损失函数中加入正则化项后,模型在学习过程中不仅要最小化数据拟合误差,还要尽可能地保持参数的简洁。这种约束使得模型倾向于学习更简单的函数,从而减小了在独立测试数据上表现不佳的风险。

正则化项可以是L1或L2范数,或者这两者的组合。L1正则化会倾向于产生稀疏的权重矩阵,有助于特征选择和模型压缩;而L2正则化则倾向于使权重值均匀地小,有助于维持模型的平滑性和稳定性。通过适当选择正则化参数,可以有效地控制模型复杂度和泛化能力之间的平衡。

## 2.2 正则化技术的分类与原理

正则化技术可以根据其数学形式和作用机制分类。最著名的正则化技术包括L1和L2正则化,以及Dropout正则化和早停法。它们各自有不同的理论基础和应用场合。

### 2.2.1 L1与L2正则化对比

L1正则化(也称为Lasso正则化)通过向损失函数添加参数权重的绝对值之和作为惩罚项。其数学表达形式为:

```

J(θ) = J(θ) + λ ∑|θi|

```

其中,`J(θ)` 是原始的损失函数,`θ` 是模型参数,`λ` 是正则化强度参数,`∑|θi|` 是所有参数的绝对值之和。L1正则化具有稀疏性质,这意味着它倾向于将一些参数缩减至零,从而实现特征选择和模型简化。

L2正则化(也称为Ridge正则化)则向损失函数中添加参数权重的平方和作为惩罚项。其数学表达形式为:

```

J(θ) = J(θ) + λ ∑θi^2

```

L2正则化倾向于使权重值均匀地小,因此它有助于防止任何一个参数对于整体输出的贡献过大。这有助于维护模型的稳定性,尤其在参数的数量很大时。

### 2.2.2 Dropout正则化的机制

Dropout是一种在训练过程中临时“丢弃”神经网络中一部分节点的方法。在每次训练迭代过程中,每个节点都会以一定的概率被随机移除,这意味着网络的每个节点都不会总是依赖于前一层的每个节点,从而减少了节点间的共适应性。Dropout在训练过程中引入了噪声,迫使网络学习更加鲁棒的特征表示。

Dropout正则化的核心思想是模拟多个不同神经网络结构的集成效果。在测试时,所有神经元都保持激活状态,但是它们的输出会被缩放,以补偿训练过程中丢失神经元的影响。通过这种方式,网络能够在保持性能的同时防止过拟合。

### 2.2.3 早停法(early stopping)的原理

早停法是一种简单但有效的正则化技术,它通过在验证集上的表现来决定何时停止训练过程。训练开始时,模型在训练集上进行训练,并在每个epoch后在验证集上评估其性能。当模型在验证集上的性能不再提升或者开始下降时,训练过程会提前终止,即使模型在训练集上可能还能继续提升性能。

早停法有效地防止了模型在训练集上的过拟合,同时避免了不必要的计算,因为它会在模型性能达到最优时停止训练。这种方法对于一些容易过拟合的模型特别有效,比如高容量的神经网络。

## 2.3 正则化参数的选择与调整

正则化参数的选择对于模型性能至关重要。这些参数直接控制了正则化项对最终模型的影响大小。

### 2.3.1 正则化参数对模型的影响

正则化参数(如L1和L2正则化中的λ)对模型的复杂度和泛化能力有着决定性的影响。参数较大时,正则化项占主导,会导致模型更加倾向于简化,这可能会导致欠拟合;参数较小时,模型过于复杂,容易过拟合。因此,合理选择正则化参数是避免过拟合和欠拟合,找到模型最优复杂度的关键。

### 2.3.2 超参数搜索方法

确定最优的正则化参数通常需要通过超参数搜索来完成。常见的搜索方法包括网格搜索、随机搜索和贝叶斯优化等。网格搜索通过尝试参数值的网格来寻找最优组合;随机搜索则在给定范围内随机选择参数,通常更高效;贝叶斯优化则利用先验知识和历史搜索结果,智能地选择下一个参数组合,从而找到最优解。

### 2.3.3 正则化与模型性能的权衡

在实际应用中,模型设计者需要在模型的拟合能力和泛化能力之间寻找一个平衡点。正则化强度的调整是实现这一平衡的重要手段。一方面,需要足够的正则化来防止过拟合;另一方面,正则化强度过大可能会限制模型对数据的学习能力,导致欠拟合。因此,在实践中经常需要根据模型在验证集上的表现来调整正则化参数,直到找到性能最佳的平衡点。

以上是对第二章内容的详细展开,接下来的章节我们将深入探讨正则化技术在实践中的应用以及具体的实现方法。

# 3. 正则化技术的实践应用

在实际的深度学习项目中,选择和应用合适的正则化技术对于防止过拟合并提升模型泛化能力至关重要。本章将详细介绍三种主流正则化技术——L1正则化、L2正则化和Dropout,在深度学习中的具体实践方法。此外,还会探讨如何在模型训练过程中有效应用早停法(early stopping)技巧。

## 3.1 L1与L2正则化在深度学习中的实现

L1和L2正则化是最常见的两种正则化技术,它们通过在损失函数中引入权重的绝对值或平方项,来抑制模型权重的过度增长,从而防止过拟合。在深度学习框架中,如TensorFlow和PyTorch,实现这两种正则化的方法各有特点。

### 3.1.1 在不同框架下应用L1正则化

L1正则化通过对模型权重的绝对值进行惩罚,可以使得模型的部分权重趋向于零,从而产生稀疏模型。在TensorFlow中,可以通过`tf.keras`模块中的`regularizers.l1`实现L1正则化。下面是一个简单的代码示例:

```python

import tensorflow as tf

from tensorflow.keras import layers, models

# 使用L1正则化

l1 = tf.keras.regularizers.l1(0.01)

model = models.Sequential([

layers.Dense(64, activation='relu', input_shape=(input_shape,),

kernel_regularizer=l1),

layers.Dense(10, activation='softmax')

])

```

在PyTorch中,L1正则化可以通过在损失函数中直接添加权重的绝对值之和来实现:

```python

import torch

import torch.nn as nn

import torch.optim as optim

# 定义模型

model = torch.nn.Sequential(

torch.nn.Linear(input_size, hidden_size),

torch.nn.ReLU(),

torch.nn.Linear(hidden_size, output_size)

)

# L1正则化项

l1_lambda = 0.01

l1_norm = sum(p.abs().sum() for p in model.parameters())

# 定义损失函数和优化器

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(model.parameters(), lr=learning_rate, weight_decay=l1_lambda)

# 在训练过程中,需要手动将L1正则化项加到损失中

for epoch in range(num_epochs):

optimizer.zero_grad()

outputs = model(inputs)

loss = criterion(outputs, targets) + l1_lambda * l1_norm

loss.backward()

optimizer.step()

```

### 3.1.2 在不同框架下应用L2正则化

与L1正则化相比,L2正则化对模型权重的惩罚更加温和,它倾向于将权重缩小到较小的非零值。在TensorFlow和PyTorch中实现L2正则化的方法类似:

在TensorFlow中:

```python

l2 = tf.keras.regularizers.l2(0.01)

model = models.Sequential([

layers.Dense(64, activation='relu', input_shape=(input_shape,),

kernel_regularizer=l2),

layers.Dense(10, activation='softmax')

])

```

在PyTorch中:

```python

l2_lambda = 0.01

l2_norm = sum(p.pow(2).sum() for p in model.parameters())

# 定义

```

0

0